数据采集与融合技术_实验五

码云链接:实验五

作业①:

-

要求:

- 熟练掌握 Selenium 查找HTML元素、爬取Ajax网页数据、等待HTML元素等内容。

- 使用Selenium框架爬取京东商城某类商品信息及图片。

-

候选网站:http://www.jd.com/

-

关键词:学生自由选择

-

输出信息:MYSQL的输出信息如下

mNo mMark mPrice mNote mFile 000001 三星Galaxy 9199.00 三星Galaxy Note20 Ultra 5G... 000001.jpg 000002......

1.思路及代码

1.1 初始化数据库

def startUp(self, url, key):

# Initializing Chrome browser

chrome_options = Options()

chrome_options.add_argument('--headless')

chrome_options.add_argument('--disable-gpu')

self.driver = webdriver.Chrome(chrome_options=chrome_options)

# Initializing variables

self.threads = []

self.No = 0

self.imgNo = 0

# Initializing database

try:

self.con = pymysql.connect(host='localhost', port=3306, user='root', password='123456', charset='utf8')

self.cursor = self.con.cursor()

self.cursor.execute("CREATE DATABASE IF NOT EXISTS jd")

self.cursor.execute("USE jd")

try:

# 如果有表就删除

self.cursor.execute("drop table phones")

except:

pass

try:

# 建立新的表

sql = "create table phones (mNo varchar(32) primary key, mMark varchar(256),mPrice varchar(32)," \

"mNote varchar(1024),mFile varchar(256))"\

"ENGINE=InnoDB DEFAULT CHARSET=utf8"

self.cursor.execute(sql)

except:

pass

except Exception as err:

print(err)

# Initializing images folder

try:

if not os.path.exists(MySpider.imagePath):

os.mkdir(MySpider.imagePath)

images = os.listdir(MySpider.imagePath)

for img in images:

s = os.path.join(MySpider.imagePath, img)

os.remove(s)

except Exception as err:

print(err)

self.driver.get(url)

keyInput = self.driver.find_element_by_id("key")

keyInput.send_keys(key)

keyInput.send_keys(Keys.ENTER)

def closeUp(self):

try:

self.con.commit()

self.con.close()

self.driver.close()

except Exception as err:

print(err);

def insertDB(self, mNo, mMark, mPrice, mNote, mFile):

try:

self.cursor.execute("INSERT INTO phones VALUES (%s,%s,%s,%s,%s)"

, (mNo, mMark, mPrice, mNote, mFile))

except Exception as err:

print(err)

1.2 核心爬虫部分代码

def processSpider(self):

try:

time.sleep(1)

print(self.driver.current_url)

lis = self.driver.find_elements_by_xpath("//div[@id='J_goodsList']//li[@class='gl-item']")

for li in lis:

try:

src1 = li.find_element_by_xpath(".//div[@class='p-img']//a//img").get_attribute("src")

except:

src1 = ""

try:

src2 = li.find_element_by_xpath(".//div[@class='p-img']//a//img").get_attribute("data-lazy-img")

except:

src2 = ""

try:

price = li.find_element_by_xpath(".//div[@class='p-price']//i").text

except:

price = "0"

try:

note = li.find_element_by_xpath(".//div[@class='p-name p-name-type-2']//em").text

mark = note.split(" ")[0]

mark = mark.replace("爱心东东\n", "")

mark = mark.replace(",", "")

note = note.replace("爱心东东\n", "")

note = note.replace(",", "")

except:

note = ""

mark = ""

self.No = self.No + 1

no = str(self.No)

while len(no) < 6:

no = "0" + no

print(no, mark, price)

if src1:

src1 = urllib.request.urljoin(self.driver.current_url, src1)

p = src1.rfind(".")

mFile = no + src1[p:]

elif src2:

src2 = urllib.request.urljoin(self.driver.current_url, src2)

p = src2.rfind(".")

mFile = no + src2[p:]

if src1 or src2:

T = threading.Thread(target=self.download, args=(src1, src2, mFile))

T.setDaemon(False)

T.start()

self.threads.append(T)

else:

mFile = ""

self.insertDB(no, mark, price, note, mFile)

try:

self.driver.find_element_by_xpath("//span[@class='p-num']//a[@class='pn-next disabled']")

except:

nextPage = self.driver.find_element_by_xpath("//span[@class='p-num']//a[@class='pn-next']")

time.sleep(10)

nextPage.click()

self.processSpider()

except Exception as err:

print(err)

1.3 下载相关图片至指定路径

def download(self, src1, src2, mFile):

data = None

if src1:

try:

req = urllib.request.Request(src1, headers=MySpider.headers)

resp = urllib.request.urlopen(req, timeout=10)

data = resp.read()

except:

pass

if not data and src2:

try:

req = urllib.request.Request(src2, headers=MySpider.headers)

resp = urllib.request.urlopen(req, timeout=10)

data = resp.read()

except:

pass

if data:

print("download begin", mFile)

fobj = open(MySpider.imagePath + "\\" + mFile, "wb")

fobj.write(data)

fobj.close()

print("download finish", mFile)

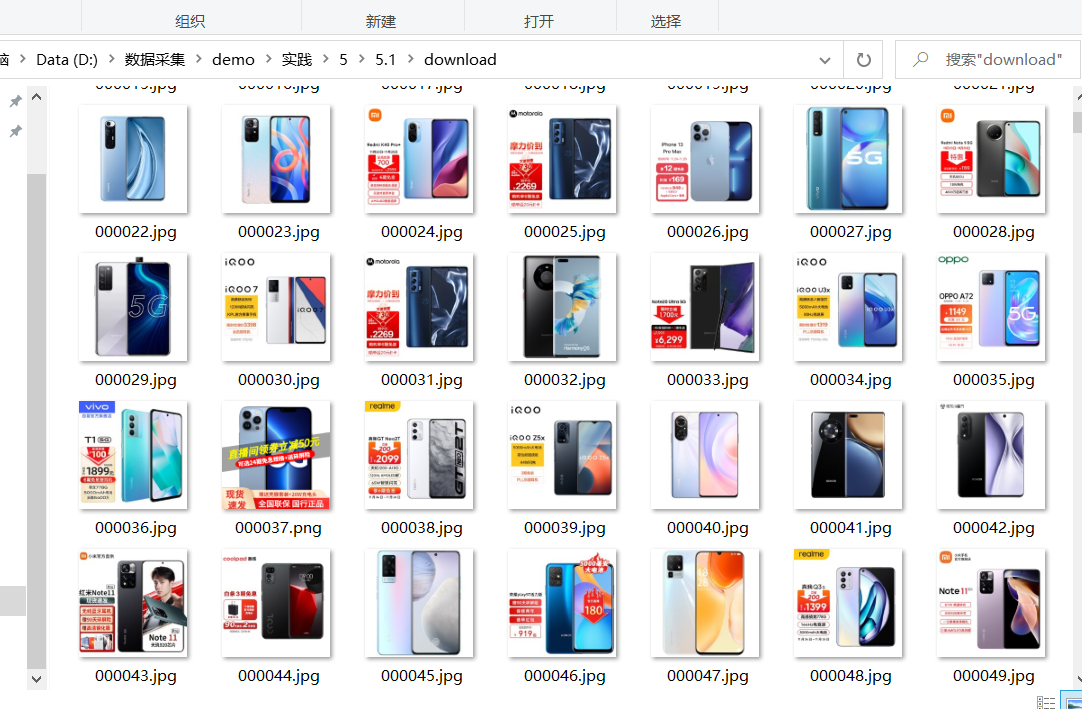

1.4 运行结果

图片

数据库

2.心得体会

- 善用time.sleep(),有时候爬取的 太快页面还没加载完成会爬取出错误的结果

- 输入内容后Selenium可以直接模拟键盘回车keyinput.send_keys(Keys.ENTER)来实现跳转

- 复现代码,难度不大,让我对selenium查找HTML元素,爬取网页更加的了解。

作业②:

-

要求:

- 熟练掌握 Selenium 查找HTML元素、实现用户模拟登录、爬取Ajax网页数据、等待HTML元素等内容。

- 使用Selenium框架+MySQL模拟登录慕课网,并获取学生自己账户中已学课程的信息保存到MySQL中(课程号、课程名称、授课单位、教学进度、课程状态,课程图片地址),同时存储图片到本地项目根目录下的imgs文件夹中,图片的名称用课程名来存储。

-

候选网站:中国mooc网:https://www.icourse163.org

-

输出信息:MYSQL数据库存储和输出格式

表头应是英文命名例如:课程号ID,课程名称:cCourse……,由同学们自行定义设计表头:

Id cCourse cCollege cSchedule cCourseStatus cImgUrl 1 Python网络爬虫与信息提取 北京理工大学 已学3/18课时 2021年5月18日已结束 http://edu-image.nosdn.127.net/C0AB6FA791150F0DFC0946B9A01C8CB2.jpg 2......

1.思路及代码

1.1 模拟登入

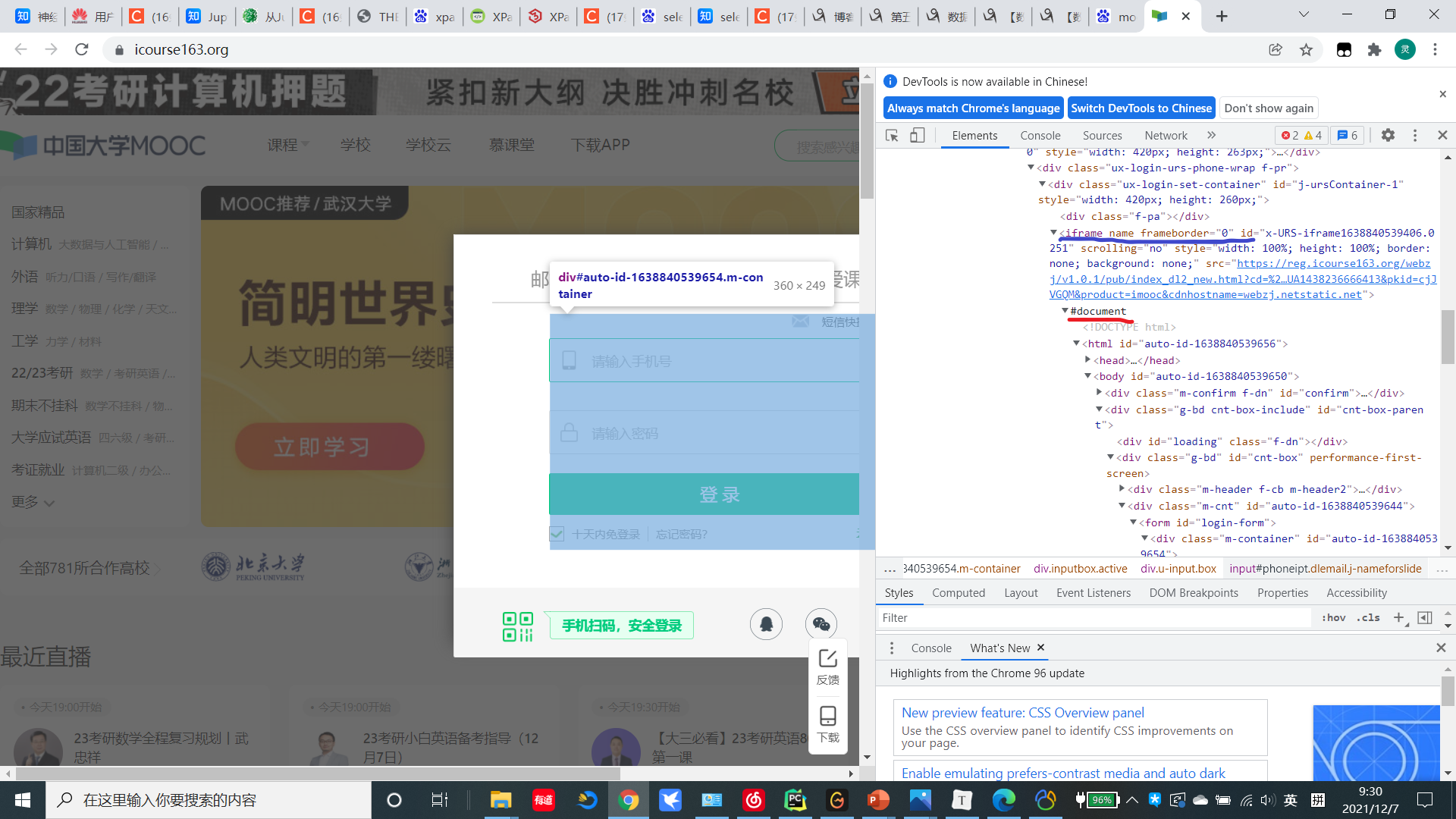

如下图,mooc登入输入的账号密码在弹窗中,该弹窗的html代码段在 iframe 标签下的内联框架中,要用driver.switch_to.frame方法切换iframe,去该 iframe 标签下进行输入框查找,我这里使用手机号登入:

代码:

login = driver.find_element_by_xpath('//div[@class="_3uWA6"]').click()

time.sleep(1)

driver.find_element_by_xpath('//span[@class="ux-login-set-scan-code_ft_back"]').click()

time.sleep(1)

driver.find_element_by_xpath('//ul[@class="ux-tabs-underline_hd"]/li[2]').click()

time.sleep(1)

driver.switch_to.frame(driver.find_element_by_xpath('//div[@class="ux-login-urs-phone-wrap f-pr"]//iframe'))

phoneInput = driver.find_element_by_id("phoneipt")

phoneInput.send_keys("手机号")

passwordInput = driver.find_element_by_xpath('//input[@type="password"][2]')

passwordInput.send_keys("密码")

passwordInput.send_keys(Keys.ENTER)

time.sleep(5)

1.2 进入我的课程并爬取课程信息

我的课程按钮的xpath定位语句为'//div[@class="_3uWA6"]',但由于元素定位相互覆盖,不能直接点击,要用driver.execute_script("arguments[0].click();", element)方法

代码:

myCourse = driver.find_element_by_xpath('//div[@class="_3uWA6"]')

driver.execute_script("arguments[0].click();", myCourse)

time.sleep(3)

driver.execute_script("window.scrollTo(0,document.body.scrollHeight);") #划到底部

time.sleep(3)

count = 1

#获取数据uuu

while True:

courses = driver.find_elements(By.XPATH, '//div[@class="course-panel-body-wrapper"]'

'/div[@class="course-card-wrapper"]')

for c in courses:

course_data = []

course_data.append(count)

try:

cCourse = c.find_element_by_xpath('.//div[@class="title"]/div/span[2]').text

except:

cCourse = ""

course_data.append(cCourse)

try:

cCollege = c.find_element_by_xpath('.//div[@class="school"]/a').text

except:

cCollege = ""

course_data.append(cCollege)

try:

cSchedule = c.find_element_by_xpath('.//div[@class="status"]//span[1]').text

except:

cSchedule = ""

course_data.append(cSchedule)

try:

cCourseStatus = c.find_element_by_xpath('.//div[@class="course-status"]').text

except:

cCourseStatus = ""

course_data.append(cCourseStatus)

try:

cImgUrl = c.find_element_by_xpath(".//img").get_attribute("src")

except:

cImgUrl = ""

course_data.append(cImgUrl)

data = requests.get(cImgUrl).content

path = r"./img/" + str(cCourse) + ".jpg" # 指定下载路径

with open(path, 'wb') as f:

f.write(data)

f.close()

courses_data.append(course_data)

count += 1

1.3 翻页处理

当下一页的按钮class属性为th-bk-disable-gh无下一页。

next_page=driver.find_element_by_xpath('.//li[@class="ux-pager_btn ux-pager_btn__next"]/a')

if next_page.get_attribute("class")=="th-bk-disable-gh":

break

else:

next_page.click()

time.sleep(3)

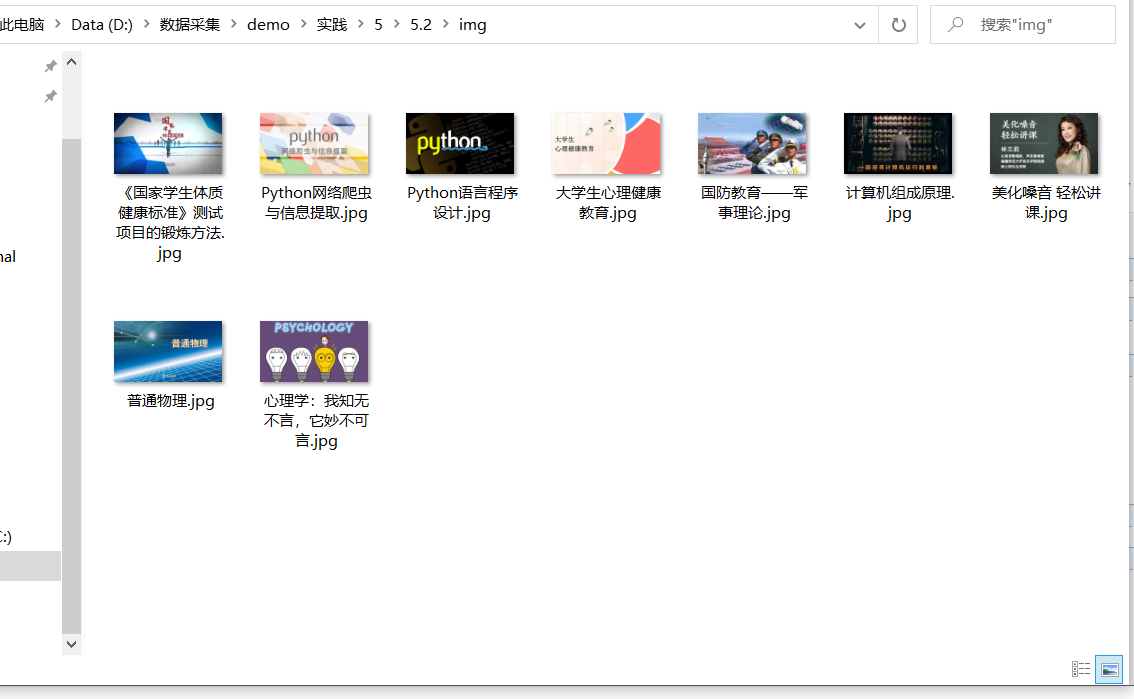

1.4 运行结果

imgs

mysql

2. 心得体会

本题我在登录环节困扰许久,一直在尝试让机器自动登录,但无法绕过人机验证,该代码只能在mooc不跳验证时自动登入。

更加熟悉了Selenium的操作

作业③:Flume日志采集实验

-

要求

:掌握大数据相关服务,熟悉Xshell的使用

- 完成文档 华为云_大数据实时分析处理实验手册-Flume日志采集实验(部分)v2.docx 中的任务,即为下面5个任务,具体操作见文档。

- 环境搭建

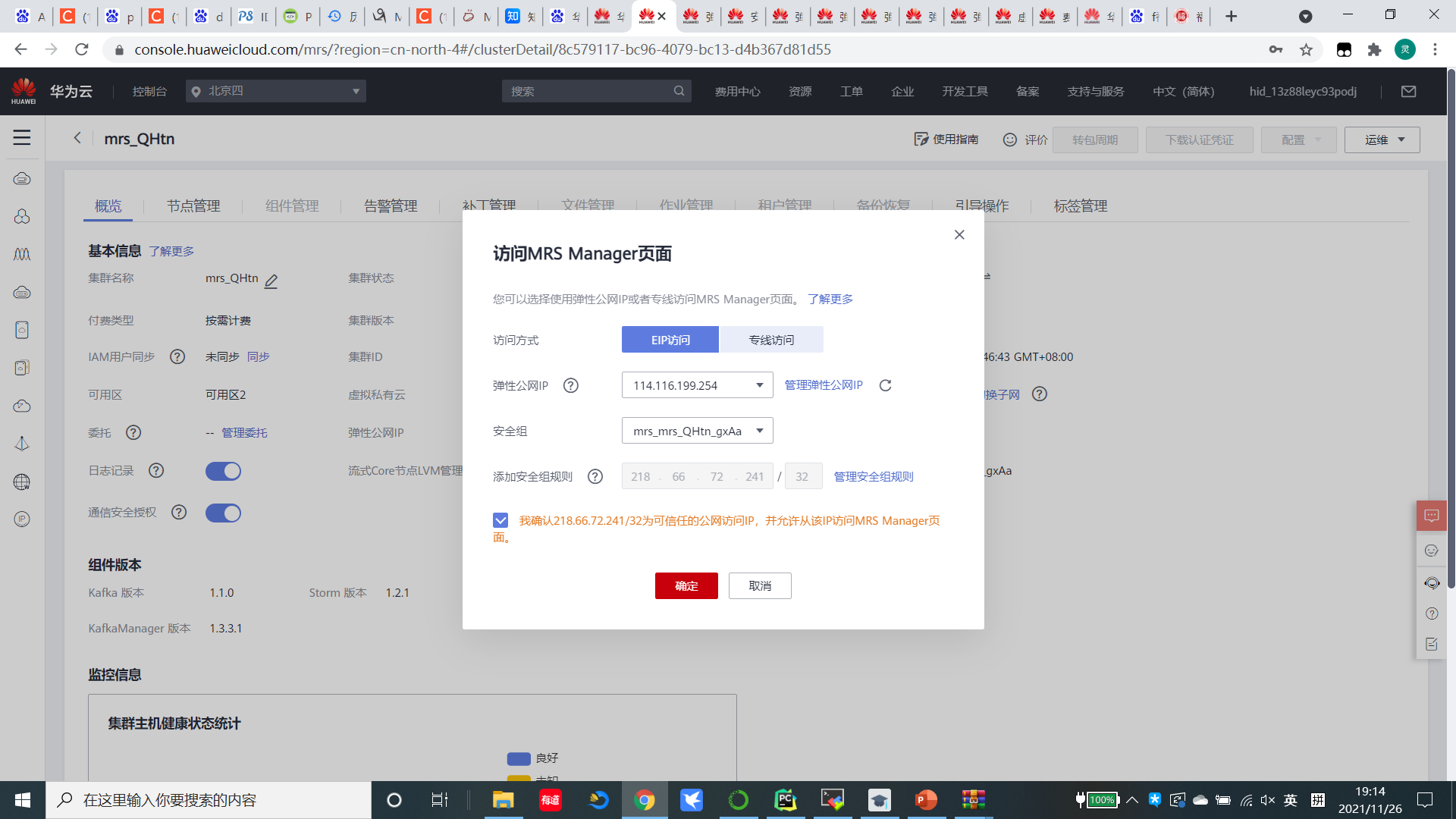

- 任务一:开通MapReduce服务

- 实时分析开发实战:

- 任务二:Python脚本生成测试数据

- 任务三:配置Kafka

- 任务四:安装Flume客户端

- 任务五:配置Flume采集数据

1.实验步骤

照说明一步步做下去,很多地方忘截图了。。。

1.1 开通MapReduce服务

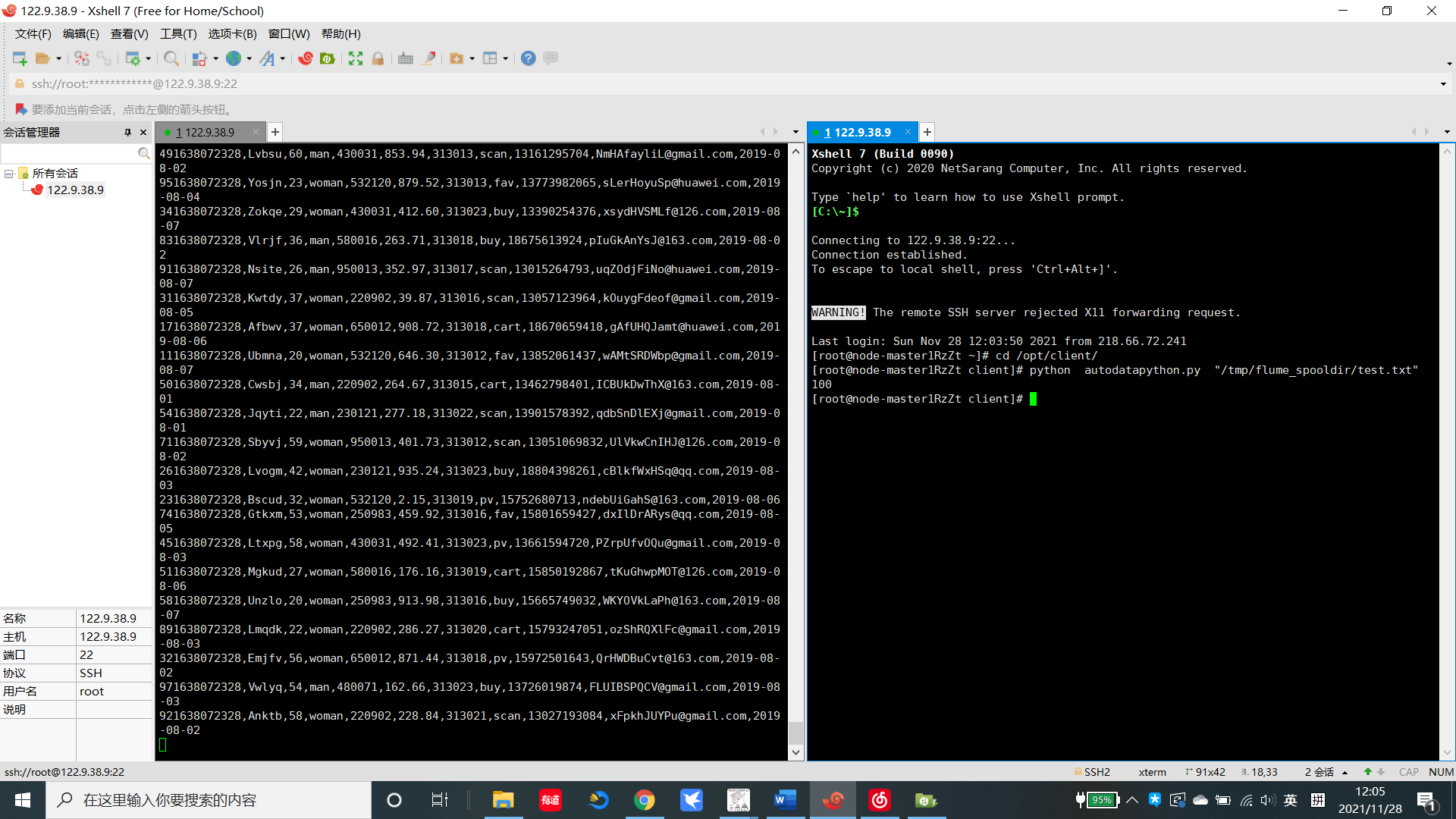

1.2 Python脚本生成测试数据

1.传输autodatapython.py文件到opt/client/文件夹内

2.执行该程序

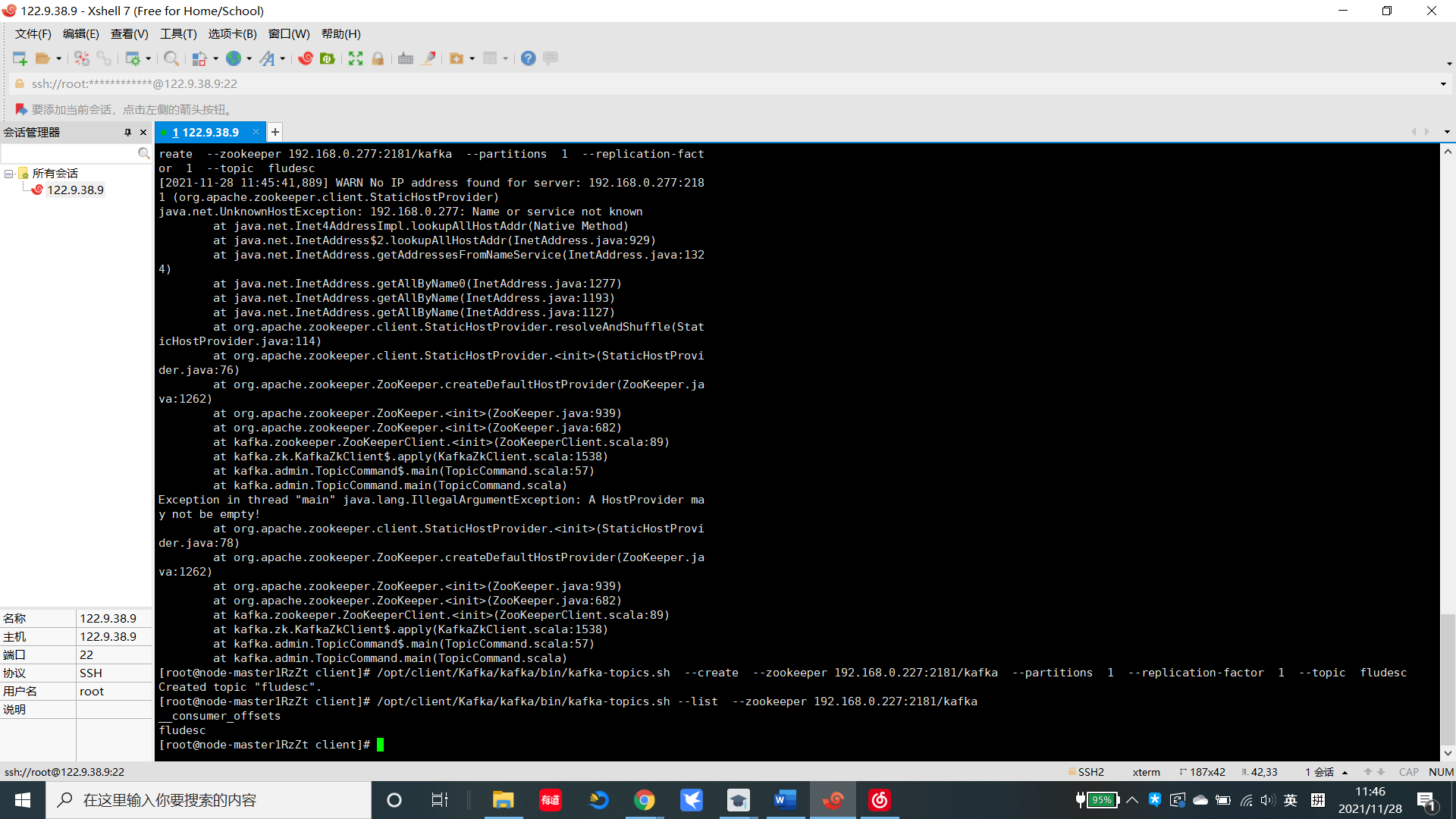

1.3 配置Kafka

1、设置环境变量,执行source命令,使变量生效

2、在kafka中创建topic

3、查看topic信息

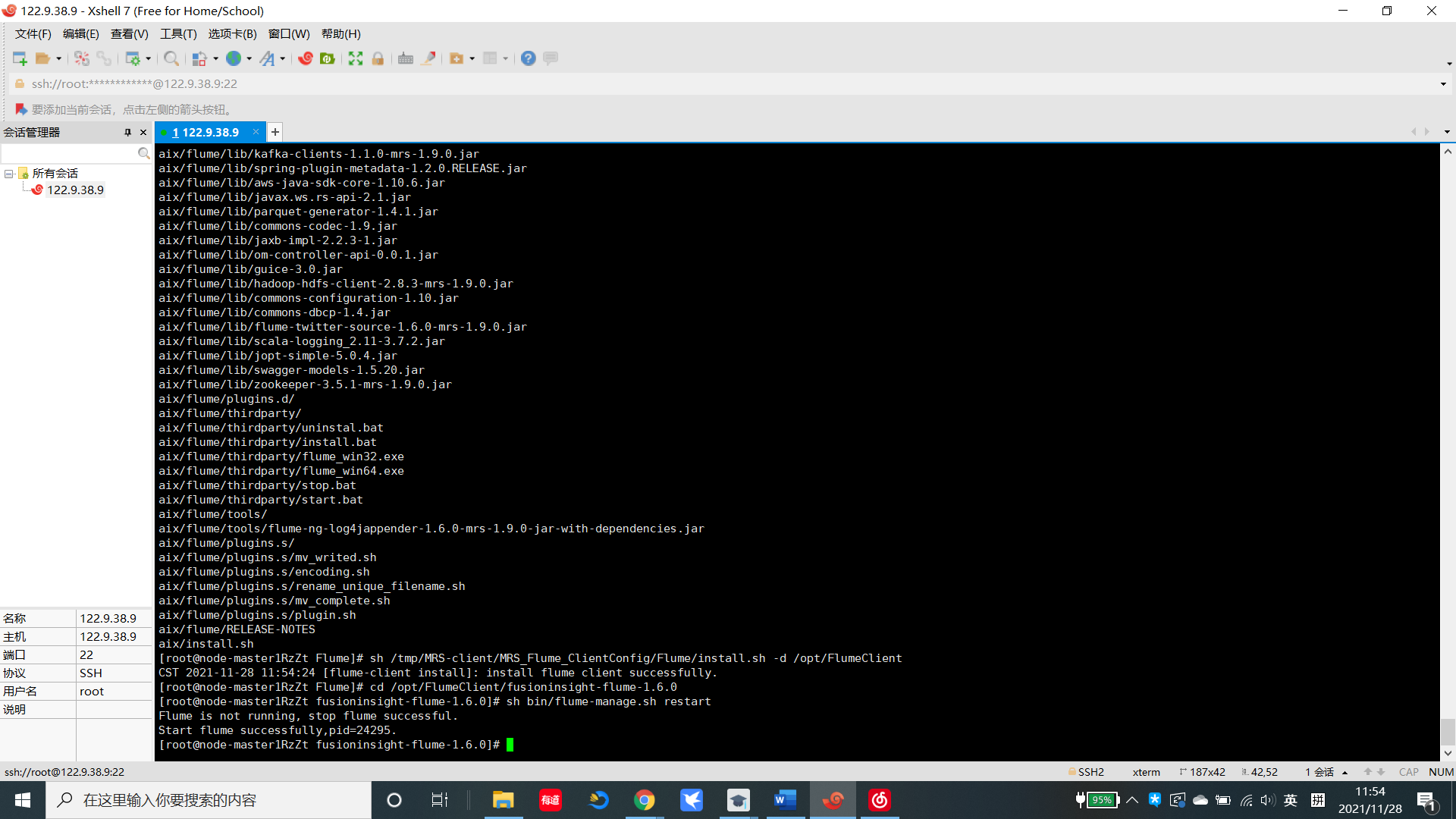

1.4 安装Flume客户端

1、在flume 服务界面安装

2、重启Flume服务

1.5 配置Flume采集数据

2. 心得体会

通过此次实验搭建了Mapreduce流式计算环境,初步了解了Flume日志采集相关知识。

浙公网安备 33010602011771号

浙公网安备 33010602011771号