第3次作业:卷积神经网络

心得体会

程传奇

卷积神经网络是基于全连接神经网络提出的,其开创性的提出了卷积的应用,即考虑图片的总体特征,并在之后分析这些特征,而非像全连接网络那样仅考虑单个点。这样的神经网络十分适合图像识别工作,其原因有三个:1. 卷积神经网络摆脱了特征像素分布位置的束缚(并不会因为图片的旋转、某些位置的变化而将其认为是另一种图片,而是整体分析图片),而全连接神经网络对图片局部的变化更加敏感。2、卷积神经网络的复杂度小于全连接神经网络,卷积核池化层的应用使得卷积神经网络每一层在逐渐变小,在映射时也是多个像素合并为像素向前传递,相比较,全连接神经网络的连接较多。3. 卷积神经网络的识别方式更贴近人对物体的识别,这有利于对卷积神经网络的构造和结果的理论研究。

余子豪

在深度学习领域中,传统的全连接神经网络可能会由于参数过多出现结果过拟合的情况。为了解决这一问题,卷积神经网络应运而生。相较传统的神经网络而言,卷积神经网络采取“局部关联,参数共享”的解决问题的方式,引入“池化”来减少参数。当然,CNN也含有全连接层,只不过全连接层通常在CNN的尾部。也了解到,目前CNN的典型结构有:AlexNet,ZFNet,VGG,GoogleNet,ResNet等。

陈能全

卷积神经网络的研究始于二十世纪80至90年代,由深度学习理论的提出和数值计算设备的改进,卷积神经网络快速发展。其广泛应用于人脸识别,表情识别,图像生成等。卷积神经网络的结构分为输入层和隐含层。输入层使用梯度下降算法进行学习。隐含层包含卷积层、池化层和全连接层。卷积层包含三个重要部分卷积核和卷积层参数及激励函数。典型结构卷积层神经网络结构AlexNet甚至采用了百万级imageNet图像数据的训练,可见其训练强度之大。其学习范式又分为监督学习和非监督学习。

付坤

定义:卷积神经网络(Convolutional Neural Networks)是一种深度学习模型或类似于人工神经网络的多层感知器,卷积神经网络依旧是层级网络,只是层的功能和形式做了变化,是传统神经网络的一个改进。

层级:一个卷积神经网络主要由 5 层组成:数据输入层,卷积计算层,ReLU 激励层 ,池化层 ,全连接层 。

数据输入层:对原始数据进行预处理,去均值,归一化,白化

卷积计算层:没看懂

激励层:把卷积层结果做非线性映射。

池化层:减少过拟合,就是进行一个优化,如果输入的是图像,就进行一个图像的压缩

全连接层:各层之间的连接,和传统的网络神经元的连接是一样的

优缺点:优点:共享卷积核,对高维数据处理无压力,无需手动选取特征,训练好权重,即得特征分类效果好

缺点:需要调参,需要大样本量,训练最好要 GPU,物理含义不明确(也就说,我们并不知道没个卷积层到底提取到的是什么特征,而且神经网络本身就是一种难以解释的“黑箱模型”)

张木华

卷积神经网络是一类包含卷积计算且具有深度结构的前馈神经网络,是深度学习的代表算法之一。而在现如今,被利用在了计算机视觉,自然语言处理等等很多领域,发挥了很大的作用。卷积神经网络是仿照生物的视知觉来构建的,可以进行监督学习和非监督学习。在音频和图像方面有很好的效果

代码练习

练习1 卷积神经网络与全连接网络对比

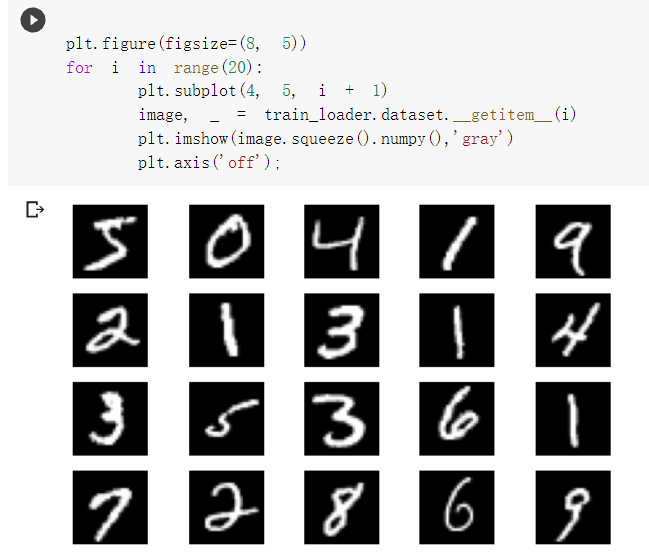

1.显示数据集中图像

2.分别构建全连接网络和卷积神经网络,定义训练函数。

在后续过程中可以分别利用这两种网络对数据集进行训练、分类,便于我们更好地了解两者的不同特点。

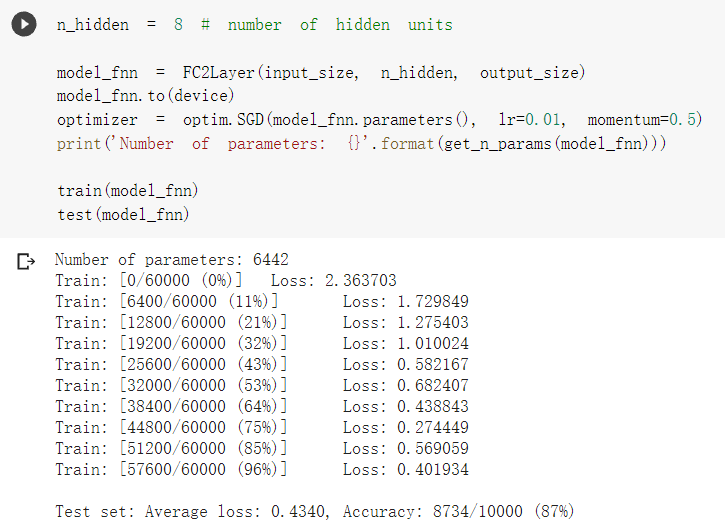

3.在全连接网络上的训练结果

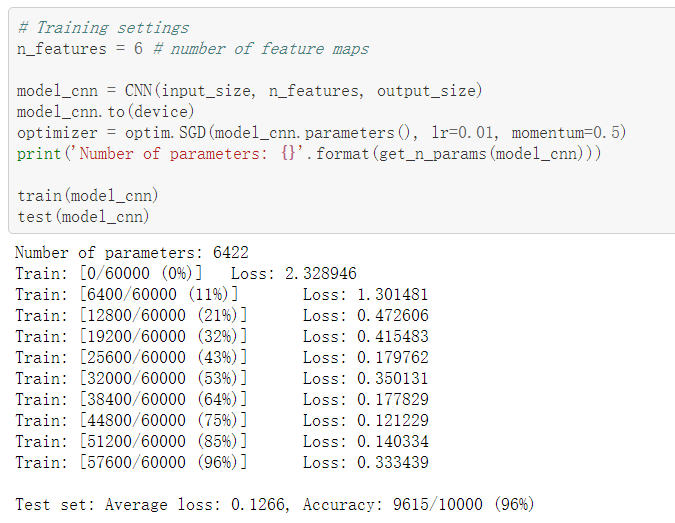

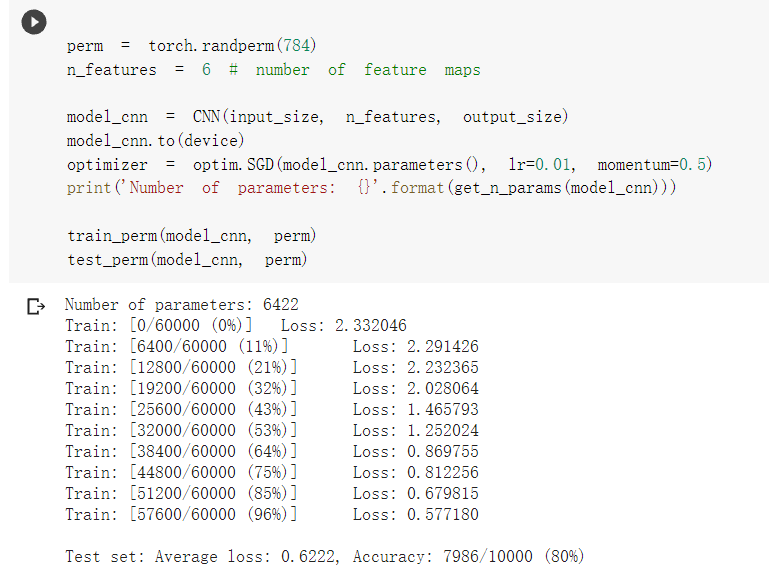

4.在CNN上的训练结果

可见在CNN上训练的正确率更高,原因是CNN利用卷积和池化,两者相互配合,能更好地发掘图像信息

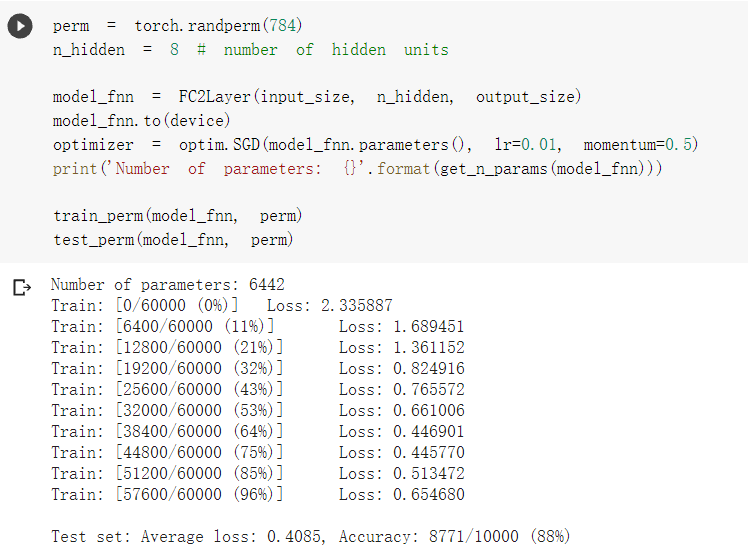

5.然而在打乱图像的像素之后,发现CNN的训练效果降低,全连接网络反而没有影响

这是因为卷积和池化更好地利用了图像的局部特征,但是打乱像素之后,显然图像的局部特征与整体间的联系不那么紧密,CNN训练效果下降。

练习2 使用卷积神经网络对CIFAR10数据集进行识别

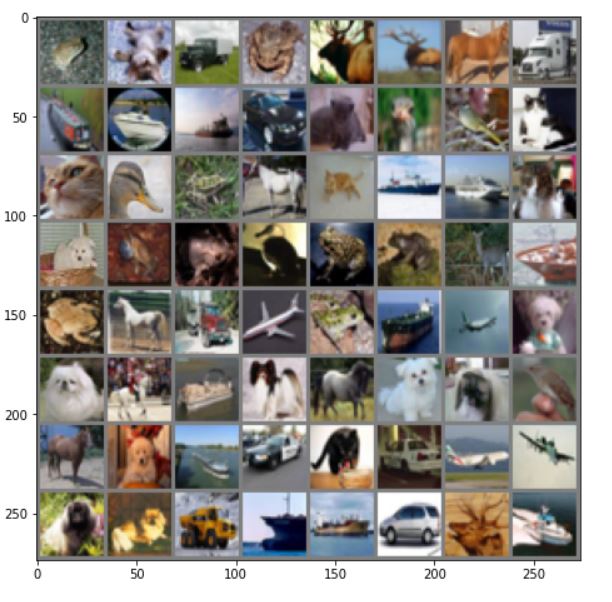

练习使用的数据集为CIFAR10,其中包含了10种不同物体的图片,图片的特征较清晰

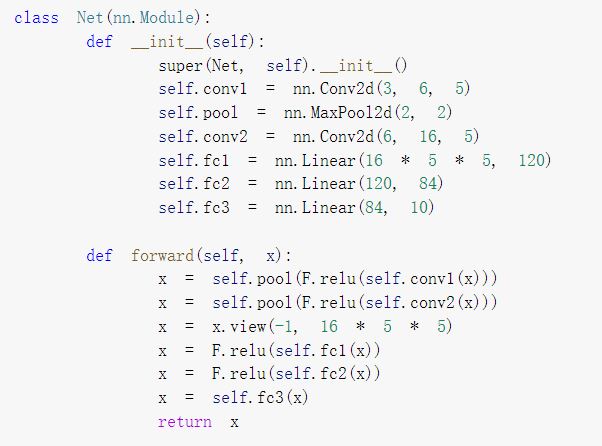

接下来定义网络模型,根据网络模型我们可以看到网络包含了2个卷积层、1个池化层和3个全连接层。根据forward方法我们可以得知网络向前传递的方式为卷积-relu-池化-卷积-relu-池化-全连接-全连接-全连接。最终输出对应10个物体的分类结果,缩放到了0-1之间

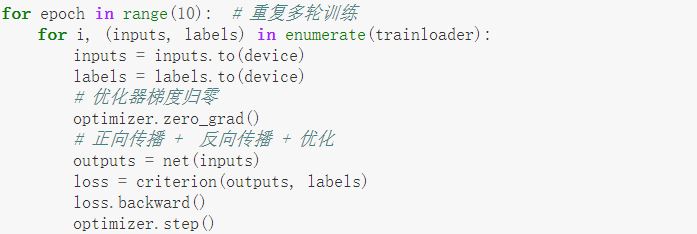

将定义好的网络进行10轮训练,获得训练好的神经网络,可以对传入的符合格式的数据进行分类

浙公网安备 33010602011771号

浙公网安备 33010602011771号