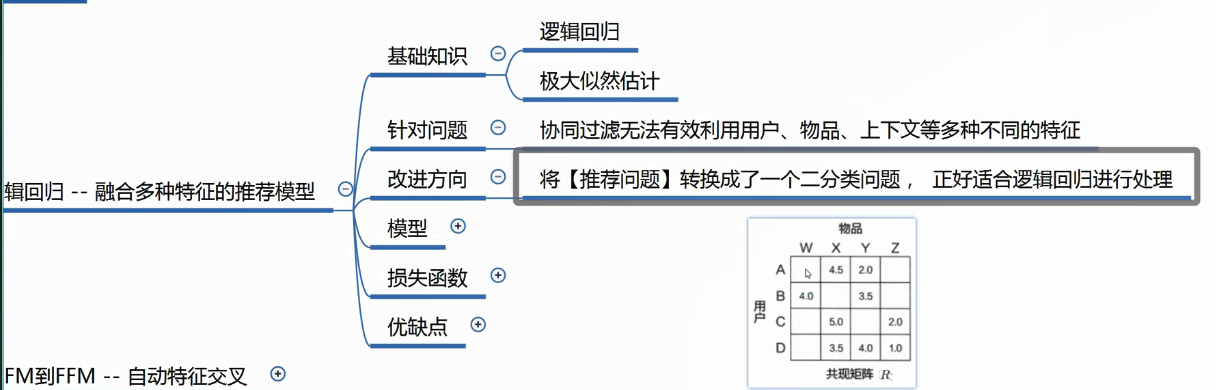

重学逻辑回归【学习笔记】

逻辑回归很简单 但是一直不明确

来源B站的 视频 老弓箭

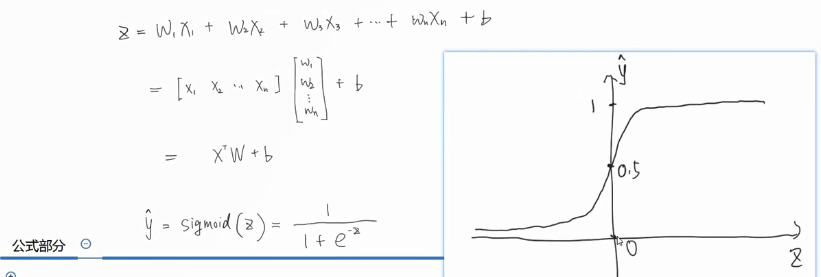

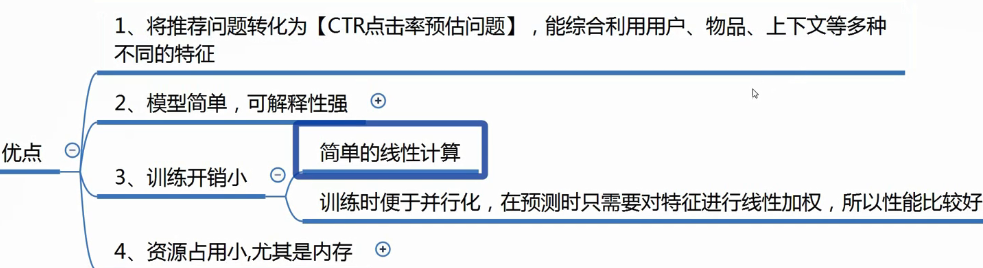

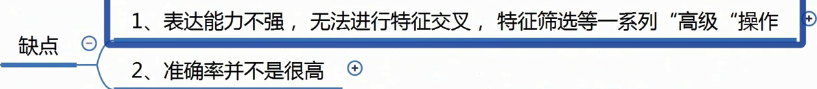

【模型】

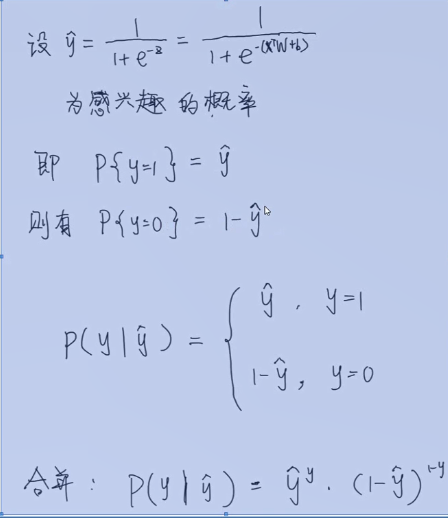

对每个特征加一个权重 然后放入sigmoid函数中,得到0-1的值 表示概率

【公式】

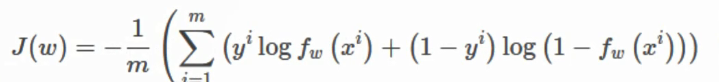

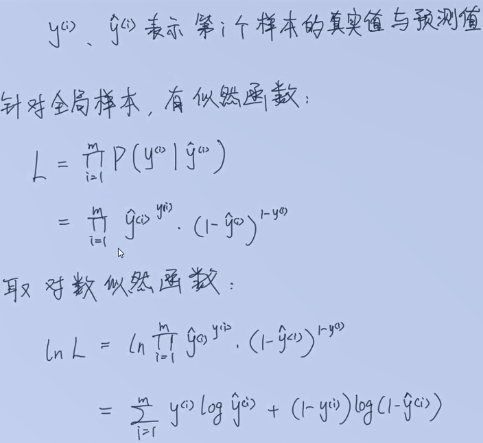

【损失函数】

交叉熵损失

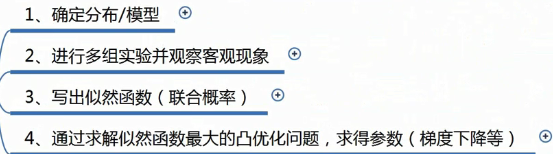

确定损失函数的步骤 其实就是极大似然估计步骤.

(这里可以看统计学习方法6.1.3模型参数估计,即先写出似然函数)(此处突然忘了似然函数是什么了)

1.

(这里不太懂为什么写成P(y|y^)的形式

(这里不太懂为什么写成P(y|y^)的形式

2.

3

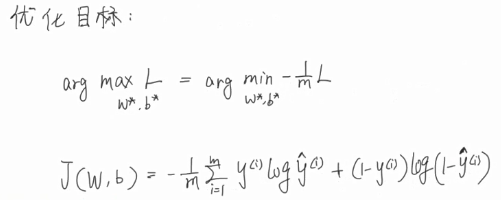

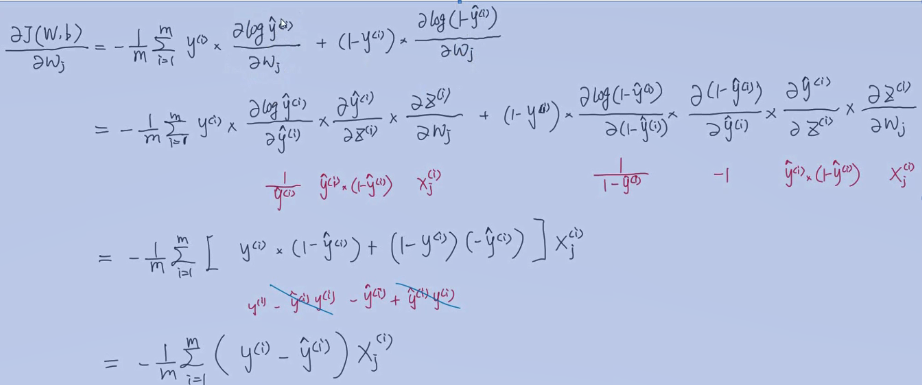

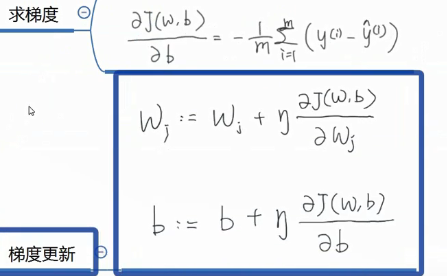

【优化目标】

这里-1\m应该有个中括号

这里-1\m应该有个中括号

(这里有个问题 损失函数到底是求最大还是最小?)

更新不应该是w=w-a吗 这里怎么成了加了

查看吴恩达视频 2.3提到 之所以不用损失误差当作损失函数 是因为会产生非凸优化问题

浙公网安备 33010602011771号

浙公网安备 33010602011771号