python第三方库之requests库

requests模块

1.requests 模块介绍

requests文档

重点阅读:快速上手、高级用法

1.1 requests 模块的作用

发送 http 请求,获取响应数据

1.2 requests 模块是一个第三方模块,需要在 python 环境中额外安装

# 安装requests模块

pip/pip3 install requests

# 查看是否安装指定模块

pip3 show requests

# 查看所有已经安装的模块

pip3 list

1.3 调用get方法,对目标URL发送请求

import requests

# 目标url

url = 'https://www.baidu.com'

# 向目标url发送get请求

responses = requests.get(url)

# 打印响应内容

print(responses.text)

2.response 响应对象

观察上面代码打印出来的响应内容有许多乱码,这是因为编解码的字符集不同造成的

import requests

# 目标url

url = 'https://www.baidu.com'

# 向目标url发送get请求

responses = requests.get(url)

# response.text 打印响应包源代码

# 打印默认编码类型

print(responses.encoding)

# 指定 utf8 编码,解决中文乱码

responses.encoding = 'utf8'

# 打印响应内容

print(responses.text)

---------------------------------

# response.content 打印响应包源代码

# 打印响应内容

print(responses.content.decode()) # 默认utf-8,response.content是存储bytes类型的响应源码,可以进行decode操作

1、response.text是requests模块安装chardet模块推测出的编码字符集进行解码的结果

2、网络传输的字符串都是bytes类型的,所以response.text = response.content.decode('推测出的编码字符集')

3、我们可以在网页源码中搜索 charset ,尝试参考该编码字符集,注意存在不准确的情况

2.1 response.text 和 response.content的区别:

· response.text

类型:str

解码类型:requests 模块自动根据HTTP头部对响应的编码作出有根据的推测,推测的文本编码

· response.content

类型:bytes

解码类型:没有指定

2.2 通过对response.content进行decode,来解决中文乱码

- response.content.decode() 默认utf-8

- response.content.decode("GBK")

- 常见的编码字符集

utf-8

gbk

gb2312

ascii

iso-8859-1

2.3 response响应对象的其它常用属性或方法

- response.url 响应的url,有时候响应的url和请求的url并不一致

- response.status_code 响应状态码

- response.request.headers 响应对应的请求头

- response.headers 响应头

- response.request._cookies 响应对应请求的cookie,反馈cookieJar类型

- response.cookies 响应的cookie(经过set-cookie动作,返回cookieJar类型

- response.json() 自动将json字符串类型的响应内容转换为python对象(dict or list)

# 常见的响应对象参数和方法

# 响应url

print(responses.url)

# 状态码

print(responses.status_code)

# 响应对应请求头

print(responses.request.headers)

# 响应头

print(responses.headers)

# 打印响应设置的cookie值

print(responses.cookies)

3.requests模块发送请求

知识点:

- headers 参数的使用

- 发送带有参数的请求

- headers 中携带 cookie

- cookies 参数的使用

- cookieJar 的转换方法

- 超时参数 timeout 的使用

- 代理 ip 参数 proxies 的使用

- 使用 verify 参数忽略 CA 证书

- requests 模块发送 post 请求

- 利用 requests.session 进行状态保持

3.1 发送带header的请求

获取百度首页代码并获取请求头

import requests

# 目标url

url = 'https://www.baidu.com'

# 向目标url发送get请求

responses = requests.get(url)

# 打印响应内容

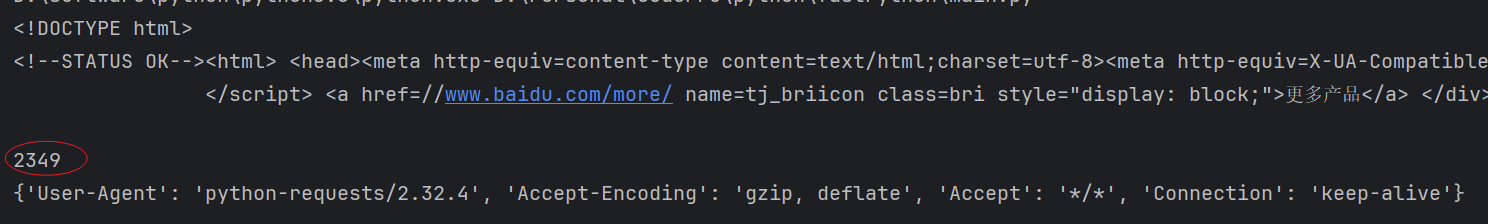

print(responses.content.decode())

# 统计响应内容字符串长度

print(len(responses.content.decode()))

# 打印请求头

print(responses.request.headers)

3.1.1 思考

可以看到响应包内容很少,对比浏览器正常获取的少了很多,这是因为服务器识别导爬虫后进行了反爬

回顾爬虫的概念,模拟浏览器,欺骗服务器,获取和浏览器一致的内容

- 请求头中有很多字段,其中User-Agent字段比不可少,表示客户端的操作系统以及浏览器的信息

3.1.2 携带请求头发送请求的方法

requests.get(url, headers=headers)

- headers参数接收字典形式的请求头

- 请求头字段名作为key,字段对应的值作为value

3.1.3 实现代码

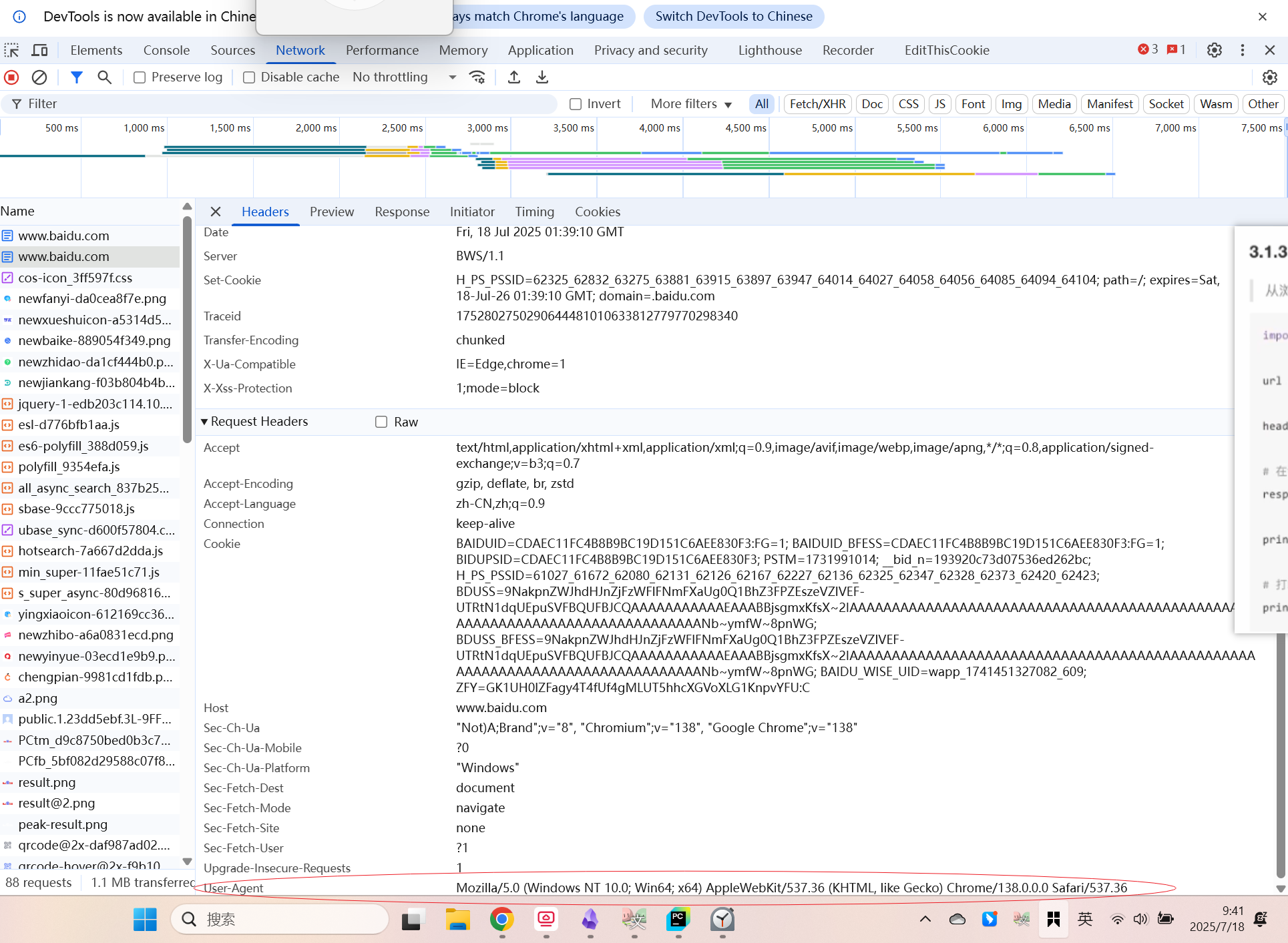

从浏览器中复制User-Agent,构造headers字典;

谷歌浏览器为例,F12—》Network—》Headers—》User-Agent

import requests

# 目标url

url = 'https://www.baidu.com'

headers = {"User-Agent": "浏览器User-Agent值"}

# 在请求头中带上User-Agent,模拟浏览器

responses = requests.get(url,headers=headers)

# 打印响应内容

print(responses.content)

# 打印请求头信息

print(responses.request.headers)

3.2 发送带参数的请求

我们在使用百度搜索的时候经常发现url地址中会有一个 ?,那么这个问好后边的就是请求参数,又叫查询字符串

tips:浏览器抓包,发现传参很多,那么如何确定哪些是有效参数呢?一个一个删除,直到查询结果与正常不一样

3.2.1 在url携带参数

直接对含有参数的url发起请求

import requests

# 带参数url,python作为需要查询内容

url = 'https://www.baidu.com/s?wd=python'

headers = {"User-Agent": "浏览器User-Agent值"}

# 在请求头中带上User-Agent,模拟浏览器

responses = requests.get(url,headers=headers)

# 打印响应内容

print(responses.content)

# 将响应内容写入baidu.html中

with open('baidu.html', 'wb')as f:

f.write(responses.content)

3.2.2 通过params携带参数字典

- 构建请求参数字典

- 向接口发送请求的时候带上参数字典,参数字典设置给params

import requests

url = 'https://www.baidu.com/s?'

headers = {"User-Agent": "浏览器User-Agent值"}

# 请求参数是一个字典 即wd=python

data= {

'wd': 'python'

}

# 在请求头中带上User-Agent、params,模拟浏览器

responses = requests.get(url, headers=headers, params=data)

# 打印响应内容

print(responses.content)

with open('baidu_python.html', 'wb')as f:

f.write(responses.content)

如果百度被反爬了可以用bing测试原理一样的

3.3 在headers参数中携带cookie

网站经常利用请求头中的Cookie字段来做用户访问状态的报错,那么我们可以在headers参数中添加Cookie,模拟普通用户的请求。我们以GitHub登录为例:

3.3.1 GitHub登录抓包分析

- 打开浏览器,右键-检查,点击Net work,勾选Preserve log

- 访问GitHub登录的url地址 http://github.com/login

- 输入账号密码点击登录后,访问一个需要登录后才能获取正确内容的url,比如点击右上角的Your profile访问 https://github.com/USER_NAME

- 确定url之后,再确定发送该请求所需要的请求头信息中的User-Agent和Cookie

3.3.2 完成代码

- 从浏览器中复制User-Agent和Cookie

- 浏览器中的请求头字段和值与headers参数中必须一致

- headers请求参数字典中的Cookie键对应的值是字符串

import requests

url = 'https://github.com/Muzili233'

headers = {

'user-agent' : 浏览器值,

'cookie' : 浏览器值

}

# 在请求头中带上包含User-Agent和cookie请求头

response = requests.get(url,headers=headers)

# 保存响应包

with open('github.html','wb')as f:

f.write(response.content)

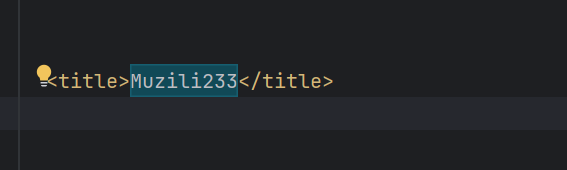

3.3.3 运行代码验证结果

在打印的输出结果中搜索title,html中的标题文本内容如果是你的github账号,则成功利用headers参数携带cookie,获取登录后才能访问的页面

请求头带cookie访问成功

3.4 cookies参数的使用

上面我们在headers参数中携带cookie,也可以使用专门的cookies参数

1、cookies参数的形式:字典

cookies = {"cookie的name":"cookie的value"}

- 该字典对应请求头中Cookie字符串,以分号、空格分割每一对字典键值对

- 等号左边的是一个cookie的name,对应cookies字典的key

- 等号右边对应cookies字典的value

2、cookies参数的使用方法

response = requests.get(url, cookies)

3、将cookie字符串转换为cookies参数所需的字典:

cookies_dict = {cookie.split('='[0]:cookie.split('=')[-1] for cookie in cookies_str.split(';')}

4、注意:cookie一般是有过期时间的,一旦过期需要重新获取

import requests

url = 'https://github.com/Muzili233'

# 构建请求头

headers = {

'user-agent' : '浏览器user-agent值'

}

# 构建cookie字典

temp = '浏览器cookie值'

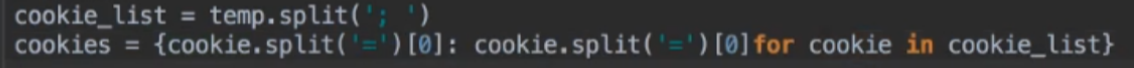

# 稳妥方案

cookie_list = temp.split('; ')

cookies = {}

for cookie in cookie_list:

cookies[cookie.split('=')[0]] = cookie.split('=')[-1]

# 打印cookies字典

print(cookies)

# 发送携带headers和cookies的请求头

response = requests.get(url,headers=headers,cookies=cookies)

with open('githubC.html','wb')as f:

f.write(response.content)

稳妥方案代码可以替换成如下代码:

3.5 cookieJar对象转换为cookies字典的方法

使用request获取的resposne对象,具有cookies属性。该属性是一个cookieJar类型,包含了对方服务器设置在本地的cookie。我们如何将其转换为cookies字典呢?

1、转换方法

cookies_dict = requests.utils.dict_from_cookiejar(response.cookies)

2、其中response.cookies返回的就是cookieJar类型的对象

3、requests.utils.dict_from_cookiejar 函数返回cookies字典

import requests

# 定义目标 URL

url = 'https://www.baidu.com'

# 发送 GET 请求并获取响应

response = requests.get(url)

# 打印原始 cookies(cookieJar 对象)

print(response.cookies)

# 将 cookieJar 转换为字典

dict_cookies = requests.utils.dict_from_cookiejar(response.cookies)

print(dict_cookies)

# 将字典转换回 cookieJar 对象

jar_cookies = requests.utils.cookiejar_from_dict(dict_cookies)

print(jar_cookies)

登录后使用CookieJar维持会话状态

大部分时间使用的是cookie字典的形式

3.6 超时参数timeout的使用

在平时网上冲浪的过程中,我们经常会遇到网络波动,这个时候,一个请求等了很久可能任然没有结果。

在爬虫中,一个请求很久没有结果,就会让整个项目的效率变得非常低,这个时候我们就需要对请求进行强制要求,让他必须在特定的时间内返回结果,否则就报错。

1、超时参数 timeout 的使用方法

response = requests.get(url, timeout=3)

2、timeout=3 表示:发生请求后,3秒钟内返回响应,否则就抛出异常

import requests

url = ''

response = requests.get(url, timeout=3) #设置超时时间

3.7 代理ip参数proxies的使用

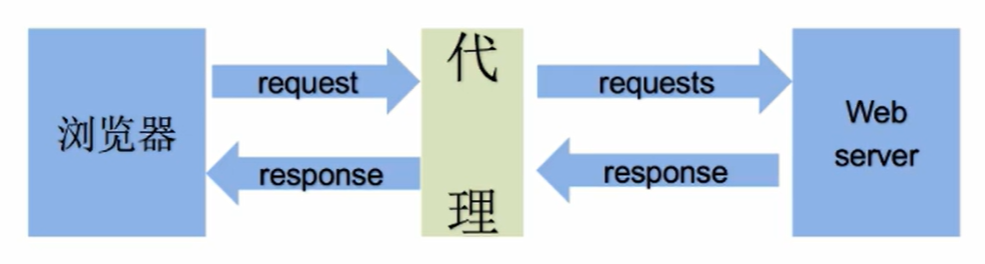

3.7.1 理解使用代理的

1、代理ip是一个ip,指向的是一个代理服务器

2、代理服务器能够帮我们向目标服务器转发请求

3.7.2 正向代理和反向代理的区别

前边提到proxy参数指定的代理ip指向的是正向的代理服务器,那么响应的就有反向服务器;现在来了解一下正向代理服务器和反向代理服务器的区别

1、从发送请求的一方的角度,来区分正向或反向代理

2、为浏览器或客户端(发送请求的一方)转发请求的,叫做正向代理

浏览器知道最终处理请求的服务器的真实ip地址,例如vpn

3、不为浏览器或客户端(发送请求的一方)转发请求、而是为最终处理请求的服务器转发的,叫做反向代理

浏览器不知道服务器的真实地址,例如nginx

3.7.3 代理ip(代理服务器)的分类

1、根据代理ip的匿名程度,代理ip可以分为下面三类:

· 透明代理(Transparent Proxy):透明代理虽然可以直接“隐藏”你的ip地址,但是还是可以查到你是谁。目标服务器接收到的请求头如下:

RENOTE_ADDR = Proxy IP

HTTP_VIA = Proxy IP

HTTP_X_FORWAREDE_FOR = Your IP

· 匿名代理(Anonymous Proxy):使用匿名代理,别人只能知道你用了代理,无法知道你是谁。目标服务器接收到的请求头如下:

REMOTE_ADDR = proxy IP

HTTP_VIA = proxy IP

HTTP_X_FORWARDED_FOR = proxy IP

· 高匿代理(Elite proxy或Anonymity Proxy):高匿代理让别人根本无法发现你是在用代理,所以最好的选择。毫无疑问使用高匿代理效果最好。目标服务器接收到的请求头如下:

REMOTE_ADDR = Proxy IP

HTTP_VIA = not determined

HTTP_X_FORWARDED_FOR = not determined

2.根据网站所使用的协议不同,需要使用相应协议的代理服务。从代理服务请求使用的协议可以分为:

· http代理:目标 url 为 http 协议

· https代理:目标 url 为 https 协议

· socks隧道代理(例如socks5代理)等:

(1)socks 代理只是简单地传递数据包,不关心是何种应用协议(FTP、HTTP和HTTPS等)。

(2)socks 代理比http、https代理耗时少。

(3)socks 代理可以转发http和https的请求。

3.7.4 proxies 代理参数的使用

为了让服务器以为不是同一个客户端在请求:为了防止频繁向一个域名发送请求被封ip,所以我们需要使用代理ip;那么我们接下来要学习requests模块是如何使用代理ip的

· 用法

response = requests.get(url,proxies=proxies)

· proxies的形式:字典

proxies = {

"http":"http://12.24.56.79:9527",

"https":"https://12.24.56.79:9527",

}

· 注意:如果proxies字典中包含有多个键值对,发送请求时将按照url地址的协议来选择使用相应的代理ip

实践

代理使用成功不会有任何报错,能成功获取响应,如果失败,要么卡滞,要么报错

# coding:utf-8

import requests

url = 'http://www.bing.com'

proxies = {

'htttps': 'https://114.231.58.238:20474'

}

response = requests.get(url ,proxies=proxies)

print(response.text)

为什么需要使用代理?当你的IP被对方服务器封禁的时候就需要使用代理。

3.8 使用verify参数忽略CA证书

在使用浏览器上网的时候,有时能够看到下面的提示

· 原因:该网站的CA证书没有经过【受信任的根证书颁发机构】的认证

什么是CA证书?CA证书是网络世界中的“数字身份证”,由受信任的第三方机构(CA中心)颁发,用于在互联网上验证身份、确保通信安全。常见到CA证书的场景就是访问HTTPS网站。

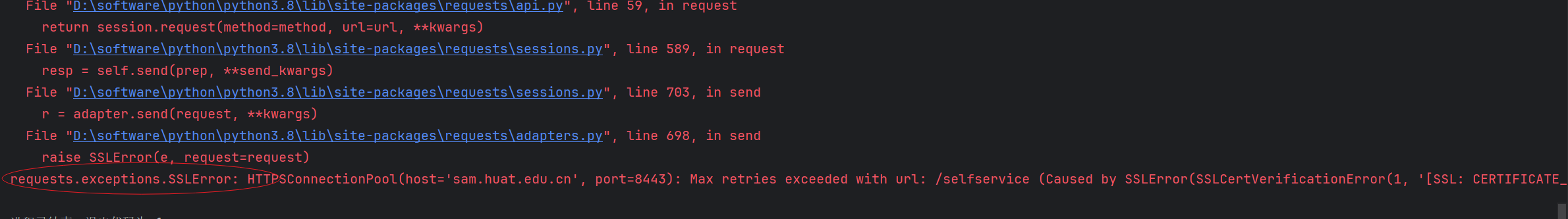

3.8.1 运行代码查看代码中向不安全的链接发起请求的效果

运行下面的代码将会抛出包含 ssl.CertificateError ...字样的异常

improt requests

url = "https://sam.huat.edu.cn:8443/selfservice/"

response = requests.get(url)

ssl.CertificateError异常报错

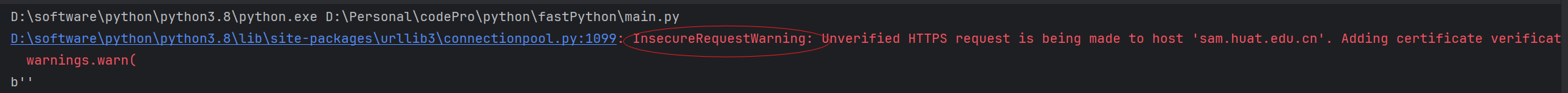

3.8.2 解决办法

为了在代码中能够正常的请求,我们使用 verify=False 参数,此时requests模块发生请求将不做CA证书的验证:verify参数能够忽略CA证书的认证

import requests

url = "https://sam.huat.edu.cn:8443/selfservice"

response = requests.get(url,verify=False)

InsecureReguestwarning告警而非报错

4.requests模块发送post请求

思考:哪些地方我们会用到POST请求?

1、登录注册(在web工程师看来POST比GET更安全,url地址中不会暴漏用户的账号密码等信息)

2、需要传输大文本内容的时候(POST请求对数据长度没有要求)

所以同样的,我们的爬虫也需要在这两个地方回去模拟浏览器发送post请求

4.1 requests发送post请求的方法

· response = requests.post(url, date)

· data 参数接收一个字典

· requests 模块发送post请求函数的其它参数和发送get请求的参数完全一致

4.2 POST请求练习

下面我们通过锤子在线工具的例子看看post请求如何使用:

1、地址:https://www.toolhelper.cn/EncodeDecode/Base64

思路分析

1、抓包确定请求的url地址

# base64在线翻译

# 思路:

# 1、抓包确定post请求url地址

# 2、确定headers

# 3、确定data字典

# 4、发送请求获取响应

# 5、json数据解析

import requests

import json

class MyBase(object):

def __init__(self):

# post请求url地址

self.url = 'https://www.toolhelper.cn/EncodeDecode/Base64Encode?gts=1760057577767&gv=232&r_=0.07559544828228426'

# headers请求头

self.headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/140.0.0.0 Safari/537.36'

}

# post请求传参,input值需要进行base64编码的值

self.date = {

"input": "china",

"encoding": "UTF-8",

"isFilterNonBase64": "1"

}

# 发送POST请求获取数据

def get_data(self):

response = requests.post(self.url, headers=self.headers, data=self.date)

# print(response.content)

return response.content

# 读取响应包中的数据

def parse_data(self, data):

# loads方法将json字符串转换成python字典

dict_data = json.loads(data)

# 响应包json数据解析,英译中和中译英返回值在json数据不同键值下,通过try方法判断

print( dict_data['Data'])

# 运行爬虫代码

def run(self):

# 发送请求获取响应

response = self.get_data()

# 数据解析

self.parse_data(response)

if __name__ == '__main__':

myBase64 = MyBase()

myBase64.run()

4.3 requests-post数据来源

quests模块发送post请求

1.实现方法

requests.post(url, data)

data是一个字典

2.post数据来源

1)固定值:抓包比较不变值

2)输入值:抓包比较根据自身变化值

3)预设值:静态文件中-需要提前从静态html中获取

4)预设值:发请求-需要对指定地址发送请求获取数据

5)在客户端生成的:分析JS,模拟生成数据

5.利用requests.session进行状态保持

requests模块中的Session类能够自动处理发送请求获取响应过程中产生的cookie,进而达到状态保持的目的,接下来我们就来学习他

5.1 requests.session的作用以及应用场景

· requests.session的作用

· 自动处理cookie,即下一次请求会带上前一次的cookie

· requests.session的应用场景

· 自动处理连续的多次请求过程中产生的cookie

5.2 requests.session使用方法

session实例在请求了一个网站后,对方服务器设置在本地的cookie会保存session中,下一次再使用session请求对方服务器的时候,会带上前一次的cookie

session = requests.session() # 实例化session对象

response = session.get(url, headers, ···)

response = session.post(url, data,···)

· session对象发送get或post请求的参数,与requests模块发送请求的参数完全一致

5.3 实操练习

使用requests.session来完成github登录,并获取需要登录后才能访问的页面

5.3.1 提示

1.对github登录以及访问登录后才能访问的页面的整个完成过程进行抓包

2.确定登录请求的url地址、请求方法和所需的请求参数

· 部分请求参数在别的url对应的响应内容中,可以使用re模块获取

3.确定登录后才能访问的页面的url地址和请求方法

4.利用requests.session完成代码

5.3.2 参考代码

# coding:utf-8

import requests

import re

def login():

# session

session = requests.session()

# headers

session.headers = {

'user-agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/140.0.0.0 Safari/537.36'

}

# url1-获取token

url1 = 'https://github.com/login'

# 发送请求获取响应

res_1 = session.get(url1).content.decode()

# 正则提取token值

token = re.findall('name="authenticity_token" value="(.*?)" />', res_1)[0]

# print(token)

# url2-登录

url2 = 'https://github.com/session'

# 构建表单数据

data = {

'commit' : 'Sign in',

'authenticity_token' : token,

'login' : '用户名',

'password' : '密码',

'webauthn-support' : 'supported'

}

# 发送请求登录

session.post(url2, data=data)

# print(data)

# url3-验证

url3 = 'https://github.com/Muzili233'

response = session.get(url3)

with open('github.html', 'wb')as f:

f.write(response.content)

if __name__ == '__main__':

login()

本文来自博客园,作者:南舟树,转载请注明原文链接:https://www.cnblogs.com/nanzhoushu/p/18989005

浙公网安备 33010602011771号

浙公网安备 33010602011771号