13-神经网络-模型预测

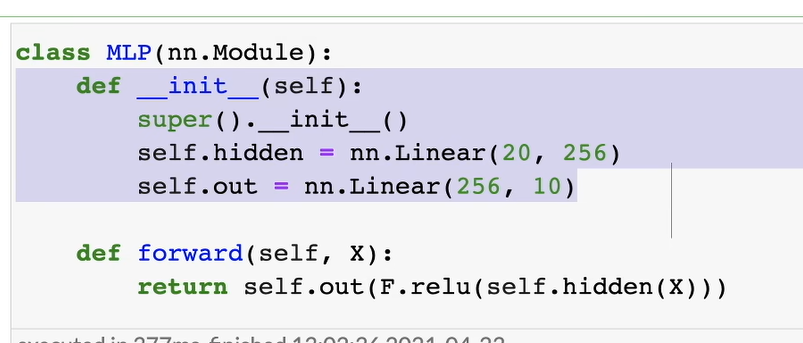

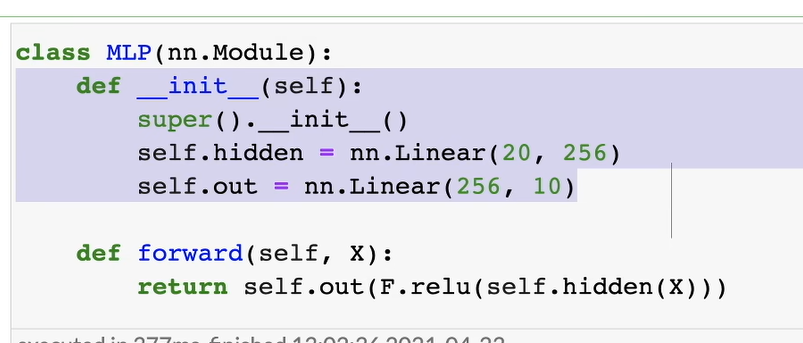

nn.ReLU()是构造了一个ReLU对象,并不是函数调用,而F.ReLU()是函数调用

类似于这样来构造我们的层和块,可以比直接用nn.Sequential有更高的灵活性。当然我们也可以在我们的class中使用nn.Sequential,这样组合使用也可以提高灵活性

nn.ReLU()是构造了一个ReLU对象,并不是函数调用,而F.ReLU()是函数调用

类似于这样来构造我们的层和块,可以比直接用nn.Sequential有更高的灵活性。当然我们也可以在我们的class中使用nn.Sequential,这样组合使用也可以提高灵活性