本文介绍了小红书的一键图文生成平台,并提供了系统的基本执行流程及原理。同时分享了本人基于本地部署后,生成的图文效果,眼过千遍不如手过一遍,实践方能出真知。

1. 背景

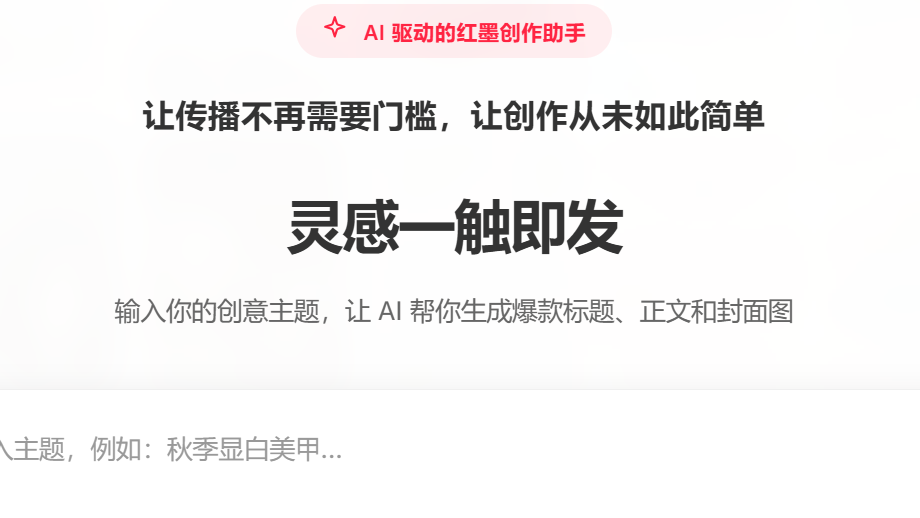

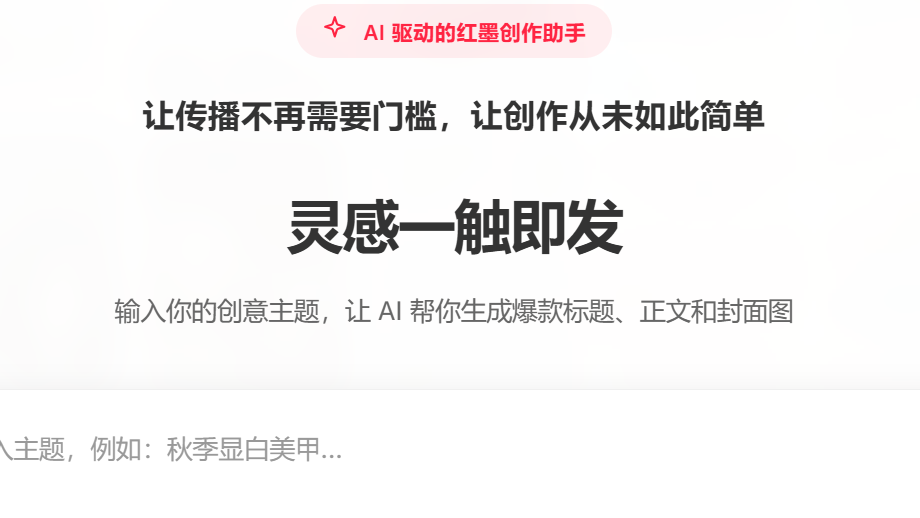

- 花了近一周时间,深入研究了Github近几天比较有意思的一个项目,小红书AI图文生成器RedInk。仅需输入一个主题以及可选的参考图片,系统则会自动生成大纲,然后针对每个章节生成对应的图片。

- 项目前端采用Vue+TypeScript,后端采用Flask。

- 支持docker部署及编译部署,文本模型及图像模型支持系统编辑。

- Ps: 国内有哪些平台可以访问nano banana 2 pro? 本人使用的是七牛,免费试用额度还不少哦。

2. 系统效果

- 模型选择: Qwen3-14B大语言模型,Nano Banana2生图模型。

- 输入: 3岁宝宝冬季保暖攻略

- 输出效果:

![生成效果图]()

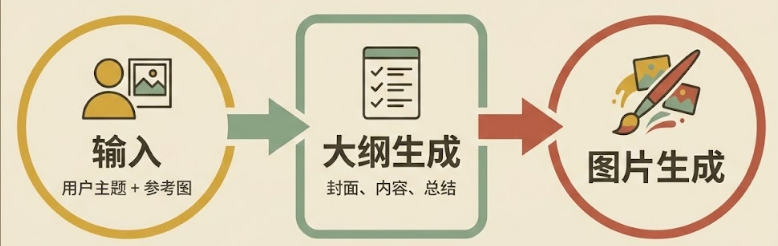

3. 整体流程

![流程]()

- (1) 用户通过系统输入关注的主题,也可同时上传参考的多个图片

- (2) 系统会调用LLM生成大纲,包含封面、多个内容片段以及总结,如果针对生成效果不满意,可以直接在线编辑。

- (3) 编辑好每个段落后,即可开始一键生图,可根据服务商模型特性,采用串行及并行两种方式。

- (4) 生成好的图片后,如果针对其中某些不满意,可以执行重新生成,最终可以一键生成。

4. 代码浅析

- (1) 前后端代码的可读性很强,建议可以本地进行调试。如果想要在vscode中同时联调前端和后端,可以采用如下vscode的调试配置文件launch.json

{

"version": "0.2.0",

"configurations": [

{

"type": "chrome",

"request": "launch",

"name": "调试 Vue 应用",

"url": "http://localhost:5173", // 你的开发服务器地址

"webRoot": "${workspaceFolder}/frontend/src",

"breakOnLoad": true,

"sourceMapPathOverrides": {

"/src/*": "${webRoot}/*",

"/@fs/*": "${webRoot}/*",

"vite://@fs/*": "${webRoot}/*"

},

"runtimeArgs": [

"--remote-allow-origins=*"

],

"skipFiles": [

"<node_internals>/**",

"${workspaceFolder}/frontend/node_modules/**"

]

},

{

"type": "node",

"request": "launch",

"name": "调试构建脚本",

"program": "${workspaceFolder}/frontend/node_modules/vite/bin/vite.js",

"args": ["dev"]

},

{

"name": "Python 调试程序: 当前文件",

"type": "debugpy",

"request": "launch",

"program": "${file}",

"console": "integratedTerminal",

"justMyCode": false,

"purpose": ["debug-in-terminal"],

"cwd": "${workspaceFolder}",

"env": {

"PYTHONPATH": "${workspaceFolder}"

},

"args": [

]

}

]

}

# 大语言模型

active_provider: qwen

providers:

qwen:

api_key: test

base_url: http://172.16.0.32:20080

endpoint_type: /v1/chat/completions

model: Qwen3-14B

type: openai_compatible

# 生图模型

active_provider: 七牛

providers:

七牛:

api_key: sk-34xxxxx0

base_url: https://api.qnaigc.com

endpoint_type: /v1/images/edits

high_concurrency: false

model: gemini-3.0-pro-image-preview

short_prompt: false

type: image_api

5. 总结与思考

- 本文介绍了小红书的一键图文生成平台,并提供了系统的基本执行流程及原理。同时分享了本人基于本地部署后,生成的图文效果,眼过千遍不如手过一遍,实践方能出真知。

6. 参考

![公众号]()

本文介绍了小红书的一键图文生成平台,并提供了系统的基本执行流程及原理。同时分享了本人基于本地部署后,生成的图文效果,眼过千遍不如手过一遍,实践方能出真知。

本文介绍了小红书的一键图文生成平台,并提供了系统的基本执行流程及原理。同时分享了本人基于本地部署后,生成的图文效果,眼过千遍不如手过一遍,实践方能出真知。

浙公网安备 33010602011771号

浙公网安备 33010602011771号