A Novel Noise Injection-based Training Scheme for Better Model Robustness

郑重声明:原文参见标题,如有侵权,请联系作者,将会撤销发布!

https://arxiv.org/abs/2302.10802

Abstract

在以前的工作中,基于噪声注入的方法已经被证明能够提高人工神经网络的鲁棒性。在这项工作中,我们提出了一种新的基于噪声注入的训练方案,以提高模型的鲁棒性。具体来说,我们首先开发了一种似然比方法来估计随机梯度下降训练的突触权重和噪声水平的梯度。然后,我们设计了一种基于朴素噪声注入的近似训练方法,以减少内存并提高计算效率。接下来,我们将我们提出的方案应用于脉冲神经网络,并在MNIST和Fashion-MNIST数据集上评估分类准确性和鲁棒性的性能。实验结果表明,与传统的基于梯度的训练方法相比,我们提出的方法在对抗鲁棒性方面取得了更好的性能,在原始精度方面取得了略好的性能。

1 Introduction

人工神经网络(ANN)的应用越来越成功,如人脸识别[24, 34, 45, 59]、语音验证[12, 19, 39, 44]和自动化车辆[42, 46, 47]。虽然各种研究设计算法和架构来提高ANN的预测精度,但专注于提高鲁棒性的工作要少得多[31]。

对于给定的输入x,ANN应该为以x为中心的半径为δ的球内的所有输入![]() 输出鲁棒性预测。ANN表现出较差的鲁棒性,导致结果的不公平性[1, 29, 49]、私有信息的泄露[5, 6, 16]以及对输入扰动的易感性[15, 18, 21]。我们的工作重点是提高ANN对输入扰动的鲁棒性,特别是对于对抗扰动。最近的研究发现,ANN极易受到对抗扰动的影响,这种扰动是在原始示例上添加的精心制作的噪声,人眼无法察觉,但可能会误导ANN。对抗攻击对ANN在各种应用中的安全构成严重威胁[4, 27, 43, 56, 58]。

输出鲁棒性预测。ANN表现出较差的鲁棒性,导致结果的不公平性[1, 29, 49]、私有信息的泄露[5, 6, 16]以及对输入扰动的易感性[15, 18, 21]。我们的工作重点是提高ANN对输入扰动的鲁棒性,特别是对于对抗扰动。最近的研究发现,ANN极易受到对抗扰动的影响,这种扰动是在原始示例上添加的精心制作的噪声,人眼无法察觉,但可能会误导ANN。对抗攻击对ANN在各种应用中的安全构成严重威胁[4, 27, 43, 56, 58]。

基于噪声注入的方法可以有效地提高ANN在对抗攻击下的鲁棒性。You等人[57]将高斯随机噪声添加到ANN中的层中以提高鲁棒性,这可以被视为一种缓解过拟合的正则化方法。Xiao等人[54]进一步优化噪声水平,以更好地抵御输入扰动,而不会损失分类精度。我们进一步探讨了如何利用添加的噪声来优化模型的参数,以获得更好的鲁棒性。

似然比(LR)方法是一种无偏随机梯度估计技术,已应用于许多模拟优化问题[17, 37, 38]。Peng等人[38]使用该技术训练ANN,并实现与反向传播(BP)方法相当的精度性能。然而,还有许多潜力有待发掘,例如提高效率和可扩展性。

我们提出了一种新的基于噪声注入的训练方案,该方案比原始LR更有效地优化模型参数,并将其应用于训练脉冲神经网络(SNN)。我们评估了我们在MNIST和Fashion-MNIST上提出的方法在各种类型的对抗攻击下的准确性和鲁棒性。实验结果表明,我们的方法对于对抗攻击具有更好的鲁棒性,对原始样本的准确率略高。

2 Related Work

Neural Networks and Training Methods: 已经提出了许多优化方法来训练人工神经网络(ANN),如反向传播(BP)[41]、启发式算法[32]和一些生物启发方法[22, 35, 36]。其中,BP是最常用的训练传统ANN的方法。其变体,时空BP (STBP)算法[52, 53]也可用于训练脉冲神经网络(SNN)。对于传统ANN,BP算法通过链式规则计算损失函数相对于权重参数的梯度,这需要损失函数和激活函数的可微性。SNN采用不连续阈值函数作为激活函数,并采用一定的记忆机制进行前馈处理。STBP算法使用阈值函数的近似导数,并结合逐层空间域和时间相关时域进行随机梯度下降。然而,BP和STBP都会导致鲁棒性较差。我们提出的方法提高了传统ANN和SNN的模型鲁棒性。

Adversarial Attack: 在Szegedy等人[48]发现ANN对于对抗攻击的脆弱性后,提出了各种生成对抗样本的方法,包括基于梯度的攻击[14, 21, 30]、基于转移的攻击[7, 51, 55]、基于分数的攻击[9, 33, 40]、基于决策的攻击[3, 23, 50]。现有的对抗攻击通常可分为两类:1)白盒攻击,攻击者可以访问目标ANN模型的架构和参数;2) 黑盒攻击,攻击者只能访问目标模型的输出。基于梯度的攻击是研究最多的白盒攻击方法之一。Goodfellow等人[14]提出了一种快速梯度符号方法(FGSM)来生成对抗样本。Kurakin等人[20]提出了一种用于基本迭代方法(BIM)的多步骤FGSM。Madry等人[30]提出了一种投影梯度下降(PGD)攻击,该攻击将随机初始化应用于BIM,并显著提高了攻击的成功率。Dong等人[7]进一步利用动量对BIM进行改进,提出了动量迭代法(MIM)来提高基于梯度的攻击性能。Li等[25]针对具有防御的模型,提出了一种基于进化梯度搜索的块盒对抗攻击。基于传输的攻击不需要访问该模型,这使得它在现实世界的应用程序中很受欢迎。Xie等人[55]对输入应用多样性图像变换(DIM)来生成可转移的对抗样本,Dong等人[8]提出了一种平移不变方法(TIM),该方法使用预定义的核来卷积梯度,以改进针对具有防御机制的ANN的可转移对抗攻击。在我们的工作中,我们将评估模型在这些攻击下的对抗鲁棒性。

3 Methodology

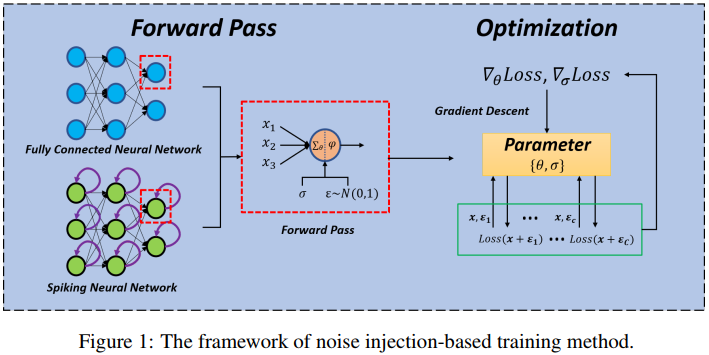

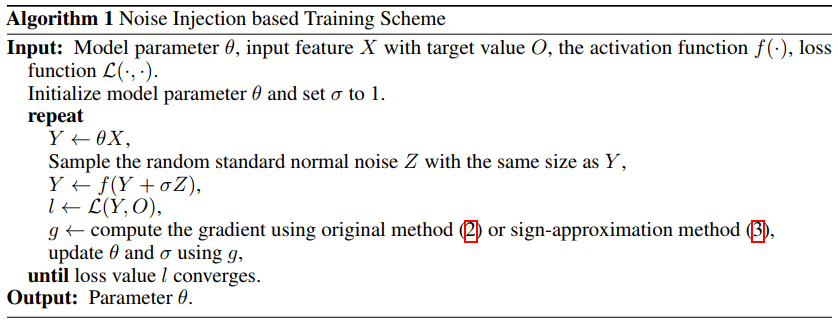

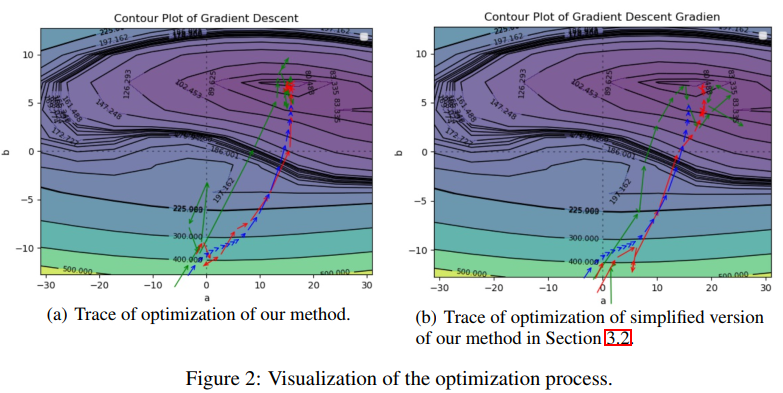

我们首先介绍了一个如图1所示的通用框架,用于使用LR方法训练ANN和SNN。然后,我们提出了一种近似方法来降低内存成本和提高计算效率,并提供了收敛性的证明。最后,我们将该方法扩展到训练SNN。

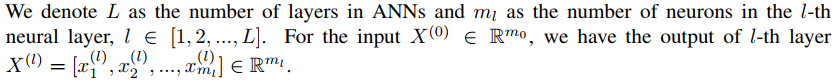

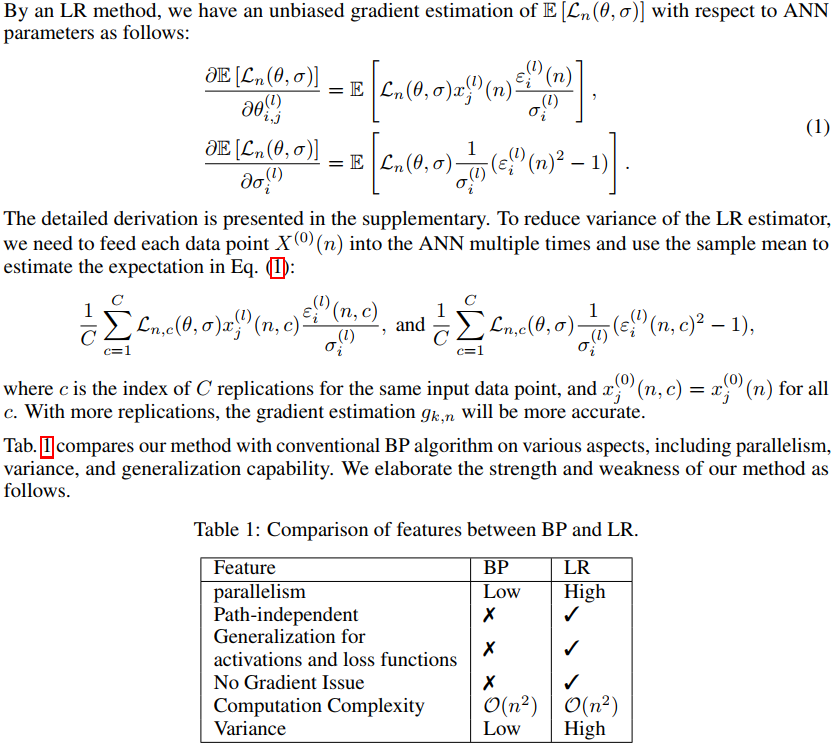

3.1 The Likelihood Method for Training ANNs

Parallelism: 我们的方法在并行计算方面比BP和STBP更有效。传统BP方法依靠链式规则,使用矩阵乘法将误差从损失值向后传播到第一个神经元层。通过简单地计算输入、添加的噪声和损失值的逐元素乘积,可以在没有反向传播的情况下估计我们方法的梯度。因此,使用公式(1)的训练过程只涉及前向传播,并且可以对每个神经元并行计算梯度,这可以充分利用GPU的计算能力。

No gradient issues: 在BP中,激活函数的梯度与每层的残差相乘,这可能导致梯度消失或爆炸问题。我们的方法没有这个问题,因为它计算每个神经元内参数的梯度。

Generalization: 我们的方法可以应用于任何激活函数和损失函数,并且可以将ANN的结构视为块盒。

然而,对于l = 1, 2, ..., L,我们需要存储![]() 和

和![]() 在LR的计算中,有限的内存阻碍了该方法在复杂实例中的应用。因此,我们进一步提出了LR方法的近似值,以降低内存和计算成本。

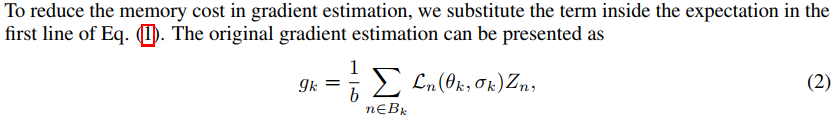

在LR的计算中,有限的内存阻碍了该方法在复杂实例中的应用。因此,我们进一步提出了LR方法的近似值,以降低内存和计算成本。

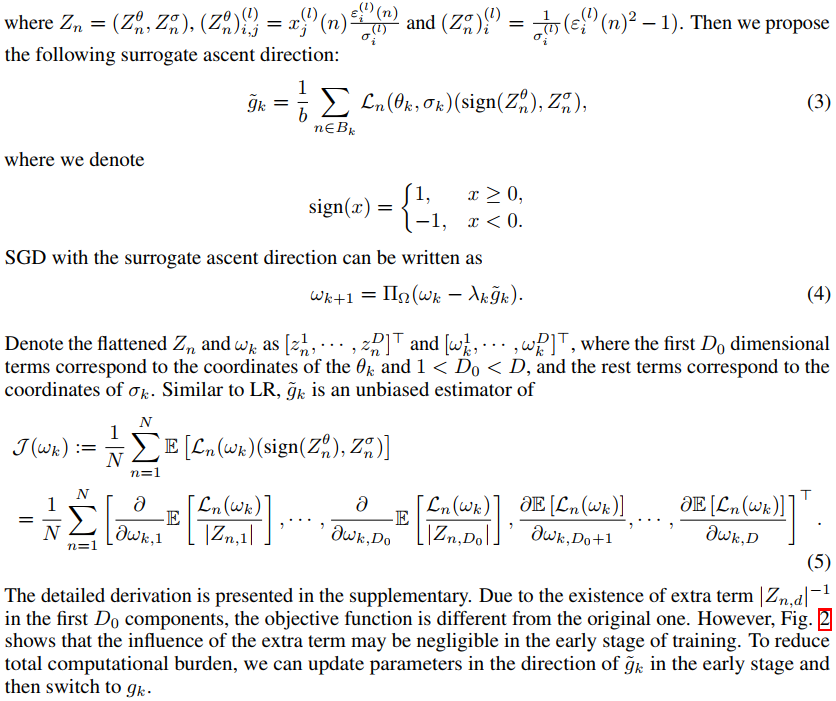

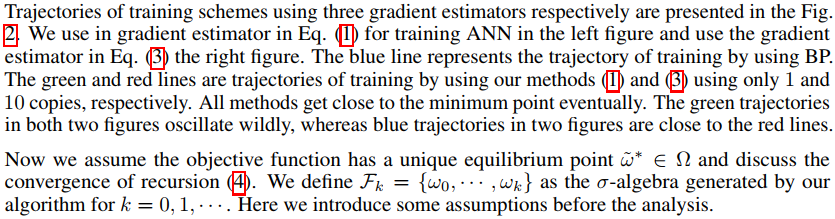

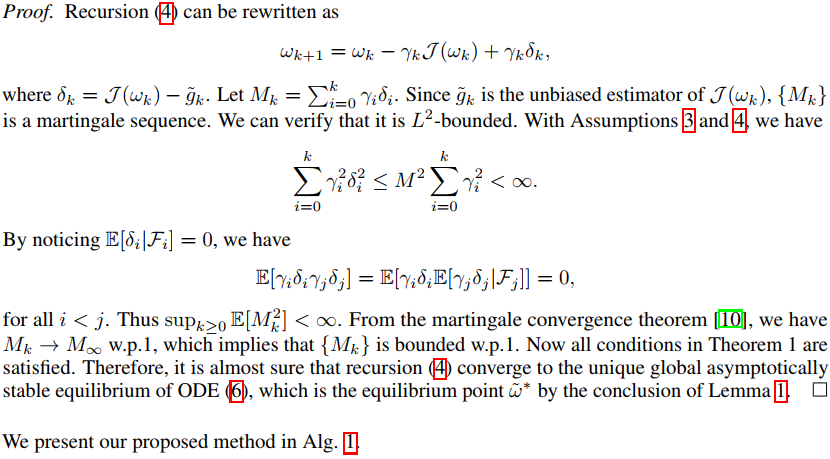

3.2 An Approximation to the Likelihood Ratio Method

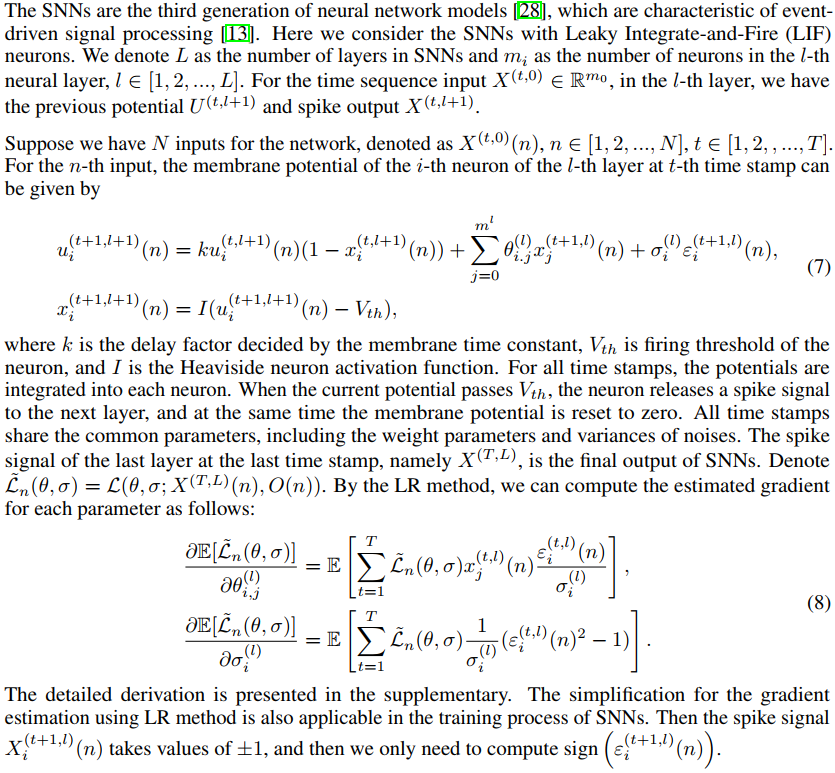

3.3 Training for Spiking Neural Networks

4 Experiment

4.1 Settings

4.2 Evaluation for SNN on MNIST

4.3 Evaluation for SNN on Fashion-MNIST

4.4 More Discussion on NIT-S

5 Conclusion

浙公网安备 33010602011771号

浙公网安备 33010602011771号