Networks of Spiking Neurons: The Third Generation of Neural Network Models

郑重声明:原文参见标题,如有侵权,请联系作者,将会撤销发布!

顺便安利一下同组的大佬做的SNN教程:spikingjelly.readthedocs.io

Abstract

本文在计算能力上对脉冲神经网络模型与基于McCulloch-Pitts神经元(阈值门)和基于sigmoidal门的其他神经网络模型加以比较。特别是,研究表明,就所需神经元数量而言,脉冲神经网络的计算能力比其他神经网络模型更强。这显示了一个具体的生物学相关函数,它可以由一个单一的脉冲神经元(为其参数的生物学合理值)计算,但它需要一个sigmoidal神经网络上的数百个隐含单元。另一方面,我们知道,任何可以由一个小的sigmoidal神经网络计算的函数也可以由一个小的脉冲神经网络计算。这篇文章并没有假设关于脉冲神经元的先验知识,它包含了一个广泛的参考文献列表,这些文献涉及脉冲神经元网络的计算和神经生物学的相关结果。版权所有:1997 Elsevier Science Ltd。保留所有权利。

Keywords

脉冲神经元,IF神经元,计算复杂性,Sigmoidal网络,下界。

1. DEFINITIONS AND MOTIVATIONS

如果根据神经网络模型的计算单元对其进行分类,就可以区分三个不同的代。第一代是以McCulloch-Pitts神经元为计算单元的。这些也被称为感知机或阈值门。它们产生了多种神经网络模型,如多层感知机(也称为阈值电路)、Hopfield网络和Boltzmann机。这些模型的一个特点是只能给出数字输出。事实上,它们对于具有数字输入和输出的计算是通用的,并且每个布尔函数都可以由具有单个隐含层的多层感知机来计算。

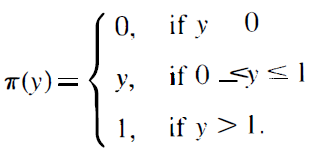

第二代是基于对输入的加权和(或多项式)应用有一组连续的可能输出值的“激活函数”的计算单元。常见的激活函数有sigmoid函数σ(y)=1/(1+e-y)和线性饱和函数π,π(y)=y (0≤y≤1),π(y)=0 (y<0),π(y)=1 (y>1)。除分段多项式激活函数外,本文还考虑了“分段指数”激活函数,其分段可由包含指数的表达式(如σ的定义)定义。第二代网络的典型例子是前馈和递归sigmoidal神经网络,以及径向基函数单元网络。这些网络还能够计算(借助于网络输出的阈值)任意布尔函数。事实上,已经证明,与第一代神经网络(Maass, Schnitger, & Sontag, 1991;DasGupta & Schnitger, 1993)相比,第二代神经网络可以用更少的门计算某些布尔函数。此外,第二代神经网络能够用模拟输入和输出计算函数。事实上,它们在模拟计算中是通用的,因为任何具有紧域和范围的连续函数都可以通过这种具有单一隐含层的网络任意好地逼近(关于一致收敛,即L∞范数)。第二代神经网络模型的另一个特点是支持基于梯度下降的学习算法,如反向传播。

对于第二代神经网络的生物学解释,人们将sigmoidal单元的输出视为生物神经元当前发放率的表示。由于生物神经元,特别是在较高的皮层区域,已知在其最小频率和最大频率之间以不同的中间频率发放,因此第二代的神经网络在生物学上比第一代的模型更逼真。

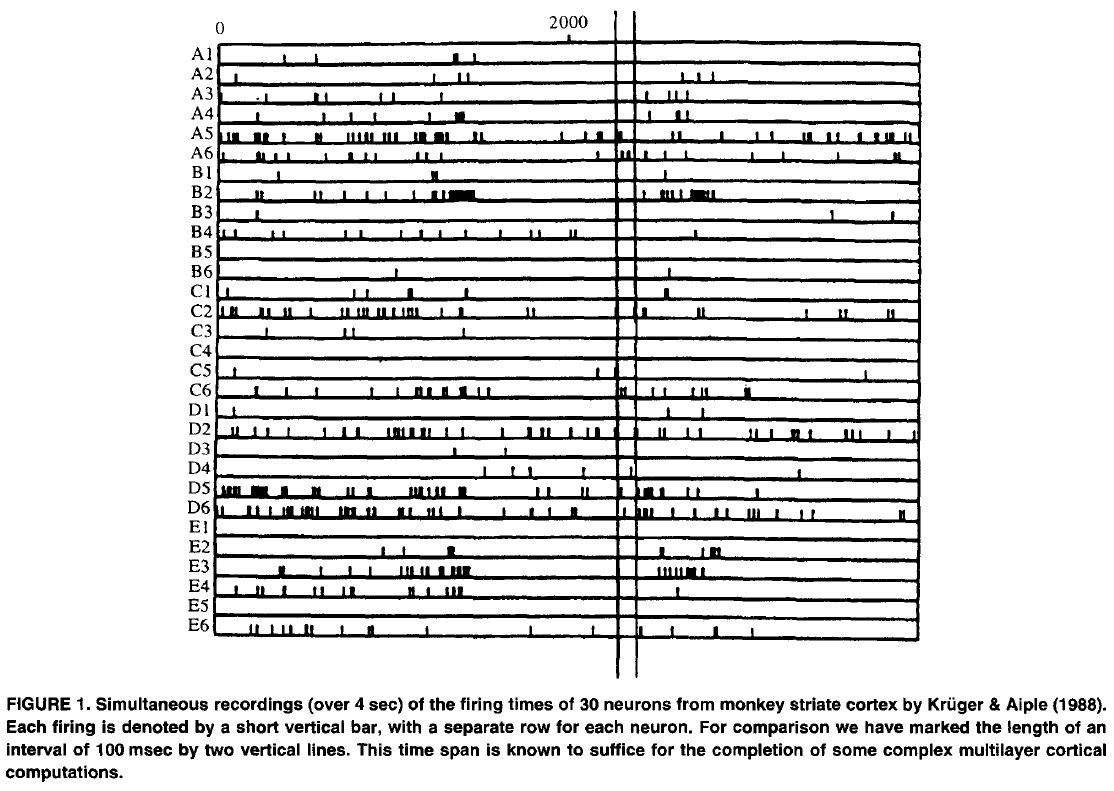

然而,至少在大脑皮层神经元网络的快速模拟计算中,“发放率解释”本身就成了一个问题。Perrett, Rolls, and Caan (1982) 以及Thorpe and Imbert (1989) 已经证明视觉模式分析和模式分类可以在100毫秒内由人类完成,尽管它至少涉及从视网膜到颞叶的10个突触阶段(见图1),但是Rolls and Tovee (1994) 在猕猴身上测量到了同样的视觉处理速度。此外,他们还表明,参与视觉处理的单个皮层区域可以在20-30毫秒内完成计算(Rolls, 1994;Rolls & Tovee, 1994)。另一方面,参与这些计算的神经元的发放率通常低于100hz,因此至少需要20-30 msec来采样神经元的当前发放率。因此,在快速皮层计算的背景下,通过发放率对模拟变量进行编码似乎相当可疑。

另一方面,在过去的几年里,实验证据已经积累起来,表明许多生物神经系统使用单一动作电位(或“脉冲”)的时间来编码信息(Abeles, 1991;Abeles, Bergman, Margalit, & Vaadia, 1993;Aertsen, 1993;Arbib, 1995;Bair, Koch, Newsome, & Britten, 1994;Bialek & Rieke, 1992;Ferster & Spurston, 1995;Hopfield, 1995;Kempter, Gerstner, van Hemmen, & Wagner, 1996;Lestienne, 1996;Rieke, Warland, van Stevenick, & Bialek, 1996;Sejnowski, 1995;Singer, 1995;Softky, 1994;Thorpe & Imbert, 1989)。

神经生物学的这些实验结果导致了第三代神经网络模型的研究,该模型以脉冲神经元(或“IF神经元”)为计算单元。最近,人们也开始用相关的新型电子硬件进行实验,如脉冲流VLSI(见,例如De Yong, Findley, & Fields, 1992;Douglas, Koch, Mahowald, Martin, & Suarez, 1995;Horinchi, Lazzaro, Moore, & Koch, 1991;Jahnke, Roth, & Klar, 1996;Jiu & Leong, 1996;Mahowald, 1992, 1994;Mead, 1989;Meador, Wu, Cole, Nintunze, & Chintrakulchai, 1991;Murray & Tarassenko, 1994;Northmore & Elias, 1996;Pratt, 1989;Zaghloul, Meador, & Newcomb, 1994)。在这些新的芯片中,人们可以通过脉冲之间的时差对模拟变量进行编码,这比其他编码方法具有实际优势。了解这种新型模拟神经硬件的能力和局限性的目的为第三代神经网络模型的理论研究提供了额外的动力。

人们还可以将阈值电路(即第一代神经网络)视为脉冲神经网络上数字计算的抽象模型,其中神经元在某一短时间窗口内的发放被编码表示为比特1,在该时间窗口内该神经元的未发放被编码表示为比特0(见例如Valiant, 1994)。然而,在这种编码方案下,只有当为另一个脉冲神经元提供输入位的所有神经元的发放时间同步(高达几毫秒)时,阈值电路才能为脉冲神经网络提供一个相当好的模型。显然,这种强烈的同步活动确实发生在生物神经系统中(见Abeles et al., 1993年;Bair et al., 1994年),但许多人认为这不是他们典型的操作模式。

“IF神经元”(或最近称之为“脉冲神经元”)的数学模型可以追溯到Lapique(1907)(见Tuckwell, 1988)。该模型存在许多变体,在最近的一次调研中进行了描述和比较(见Gerstner, 1995)。关于这些数学模型与已知生物神经元行为的关系,我们参考了Abeles(1991);Aertsen(1993);Arbib(1995);Bower and Beeman(1995);Churchland and Sejnowski(1993);Hopfield(1995);Johnston and Wu(1995);Rieke et al.(1996);Shepherd(1990,1994);Tuckwell(1988);以及Taylor and Alavi(1993)。这些脉冲神经元的数学模型并不能完全描述生物神经元极其复杂的计算功能。相反,就像前两代神经网络模型的计算单元一样,这些都是简化模型,只关注生物神经元的几个方面。然而,与前两种模型相比,它们实际上更为现实。尤其是,它们能更好地描述生物神经元的实际输出,因此,它们使我们能够在理论上研究将时间用作计算和通信资源的可能性。在前两代的模型中,计算步骤的时间通常是“平凡化”的(通过假设的同步,或通过假设的随机异步),而单个计算步骤的时间对于脉冲神经网络中的计算起着关键作用。事实上,脉冲神经元v的输出包括当v“发放”时,![]() 的点集(其中R+={x∈R: x≥0})。

的点集(其中R+={x∈R: x≥0})。

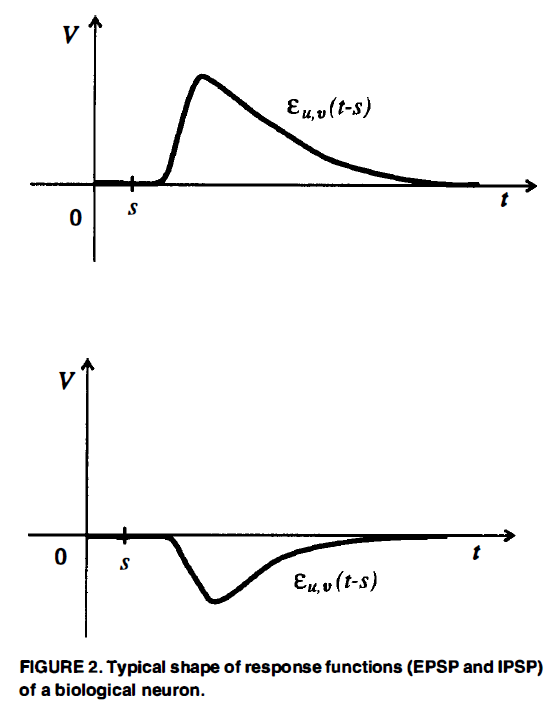

在脉冲神经元的最简单(确定性)模型中,假设一个神经元v在其“电位”Pv(在神经元v的“触发区”模拟电膜电位)达到某一阈值Θv时激发,该电位Pv是所谓的兴奋性突触后电位(“EPSP”)和抑制性突触后电位(“IPSP”)之和,这是由其他通过“突触”连接到神经元v的神经元u的发放引起的。"突触前"神经元u在s时刻的发放对t时刻的电位Pv有一定的贡献,该贡献由项wu,v·εu,v(t-s)来建模,即由一个“权重”wu,v≥0和一个响应函数εu,v(t-s)组成的量。图2显示了这种响应函数的生物学真实形状。

项wu,v·εu,v(t-s)中的“权重”wu,v≥0反映了神经元u和神经元v之间突触的“强度”(在神经生物学中称为“效能”)。在学习的背景下,可以用一个函数wu,v(t)来代替wu,v。此外,有人推测,wu,v(t)值的快速变化对于生物神经系统的计算也是必不可少的。然而,为了简单起见,我们在这里把wu,v看作一个常数。

将wu,v限制为非负值的动机是假设生物突触是“兴奋性”或“抑制性”的,并且在“学习过程”中不会改变其“符号”。此外,对于大多数生物神经元u,突触后神经元v的所有响应函数εu,v(t-s)要么是“兴奋性”(即正),要么都是“抑制性”(即负)。显然,这些约束基本上对理论复杂性研究没有影响(只考虑兴奋性和抑制性神经元对,而不是单个神经元),除非人们关心网络大小中的小常数因素,或者想要模拟皮质电路的实际结构(见Douglas et al., 1995;Shepherd, 1990)。

数学上更方便地假设,在没有突触后电位的情况下,电位Pv值为0,并且阈值Θv始终大于0。在“典型”生物神经元中,静息膜电位约为-70mV,“静息”神经元的发放阈值约为-50mV,突触后电位(即EPSP或IPSP)暂时改变膜电位的幅度最多为几mV。

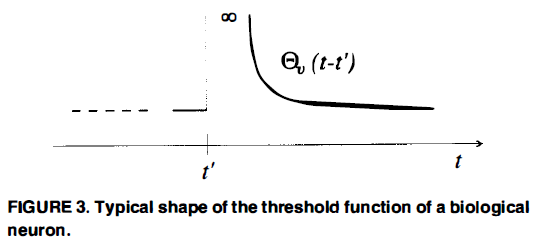

如果一个神经元v在t'时刻已经发放,那么它在t'之后的几毫秒内不会再次发放,不管它的电流电位Pv(t)有多大(“绝对不应期”)。然后再过几毫秒,它仍然“不愿意”发放,即,发放需要比通常更大的Pv(t)值(“相对不应期”)。这两种难处理的效应都是由一个合适的“阈值函数”Θv(t-t')来模拟的,其中t'是v最近一次发放的时间。在确定(即无噪声)的脉冲神经元模型中,假设v在Pv(t)从函数Θv(t-t')下方穿过时发放。生物神经元Θv(t-t')函数的典型形状如图3所示。我们假设对于t-t'的大值,Θv(t-t')=Θv(0)。在本文中,我们将只考虑脉冲神经元网络模型中的计算,其中可以假设每个神经元v在一段时间内没有发放(即t-t'很大)。因此,其阈值函数已返回到其“静息值”Θv(0)。因此,Θv的形状与这些参数无关,前提是对于足够大的x,Θv(x)=Θv(0)。

Maass(1995b,1996a)引入了一种形式的脉冲神经网络(SNN),它由脉冲神经元的有限集合V、突触的集合![]() 、权重wu,v≥0、每个突触<u,v>∈E的响应函数εu,v : R+→R组成(其中R+:={x∈R : x≥0})以及对于每个神经元v∈V的一个阈值函数Θv : R+→R+。

、权重wu,v≥0、每个突触<u,v>∈E的响应函数εu,v : R+→R组成(其中R+:={x∈R : x≥0})以及对于每个神经元v∈V的一个阈值函数Θv : R+→R+。

如果![]() 是神经元u的一组发放时间,那么t时刻神经元v触发区的电位由下式给出:

是神经元u的一组发放时间,那么t时刻神经元v触发区的电位由下式给出:

在无噪声模型中,当Pv(t)达到Θv(t-t')时,神经元v在时间t处发放,其中t'是v最近一次发放的时间。

对于输入神经元的某些特定的子集![]() ,我们假设神经元u∈Vinput的发放时间(“脉冲序列”)Fu不是由之前约定所定义的,而是由外部给出的。所有其他神经元v∈V的发放时间Fv由前面描述的约定确定,网络的输出以神经元v在一组特定的输出神经元

,我们假设神经元u∈Vinput的发放时间(“脉冲序列”)Fu不是由之前约定所定义的,而是由外部给出的。所有其他神经元v∈V的发放时间Fv由前面描述的约定确定,网络的输出以神经元v在一组特定的输出神经元![]() 中的脉冲序列Fv的形式给出。

中的脉冲序列Fv的形式给出。

实验表明,对同一电流重复注射的反应,体外生物神经元发放具有轻微不同的延迟(Aertsen, 1993)。只有在某些条件下,神经元才会以更可靠的方式发放(Mainen & Sejnowski, 1995)。因此,我们还考虑了SNN模型的随机或噪声版本(Maass, 1996b),其中Pv(t)-Θv(t-t')的差值仅控制神经元v在t时刻上的发放概率。确切发放时间的选择取决于一些未知的随机过程,例如,可能出现v在时间间隔I内Pv(t)-Θv(t-t')>0,却没有发放;或者,当Pv(t)-Θv(t-t')<0时,v在t时刻自发发放。

先前描述的SNN模型的噪声版本与Gerstner(1995)中的脉冲响应模型基本相同(另见Gerstner & van Hemmen, 1994),与脉冲神经网络的其他常见数学模型基本相同(见,例如,Abeles et al., 1993;Arbib, 1995;Tuckwell, 1988)。这些模型在处理难处理效应和发放后膜电位“重置”方面存在细微差异。但这些差异与本文所考虑的结果无关。

关于脉冲神经网络中稳定态、同步发放链、联想记忆等的理论结果,我们参考了Abeles(1991);Aityuan and Barrow(1993);Bienenstock(1995);Crair and Bialek(1990);Gerstner(1991);Gerstner and van Hemmen(1994);Gerstner, Ritz, van Hemmen(1993);Herrmann, Hertz, and Prügel-Bennett(印刷中);Hopfield and Herz(1995);Ritz, Gerstner, Fuentes and van Hemmen(1994)。关于随机脉冲神经元在发放率编码计算的结果可见Koch and Poggio(1992);Shawe-Taylor, Jeavons and Van Daalen(1991),而关于脉冲神经元的信息传输的结果可见Stevens and Zador(1996)。Judd and Aihara(1993)研究了随机脉冲神经元不同模型的计算(另见Maass, 1996a;Shawe-Taylor et al., 1991;Zhao, 1995中的讨论)。Shastri and Ajjanagadde(1993)研究了周期性发放神经元的相位对变量动态结合的可能作用。

在本文中,我们使用模拟、数值和实值等术语来表示R或R区间上的变量。为了简单起见,我们假设前两代中的所有神经网络都具有前馈结构。

2. SIMULATION AND SEPARATION RESULTS

在SNN模型范围内,数学上最简单的一个是发放是确定的,响应函数和阈值函数都是分段常数(即“阶跃函数”),如图4所示。在下文中,我们将此版本称为A型。此版本的SNN模型实际上很好地捕获了脉冲流VLSI中人工脉冲神经元的预期功能。

我们稍后还将讨论B型SNN模型,其中我们假设响应函数和阈值函数是连续且分段线性的。图5显示了B型最简单的非平凡响应函数的示例。通过使用四个或五个线性分段,可以很好地近似于具有连续分段线性函数的生物神经元的响应和阈值函数(因此也可以近似于B型脉冲神经元)。

2.1. Computation of Boolean Functions

我们首先观察到,对于布尔输入,这个模型的计算能力至少和第一代神经网络一样强大。我们假设n个输入比特x1,… ,xn通过n个输入神经元a1,… ,an被赋予给SNN,其中如果xi=1,ai在特定时间Tinput发放;如果xi=0,ai根本不发放。我们假设SNN的输出比特是由特定输出神经元在特定时间窗内的发放或不发放所给出的。然后,人们可以通过A型SNN N,其结构与N基本相同,来模拟第一代的任何分层前馈神经网络N。只有当一个人想要在N'中重视生物激励的约束,即N'中的每个神经元应该只触发EPSP,或者只触发IPSP,那么N'的每个门都必须由一对由兴奋性和抑制性脉冲神经元组成的对来模拟,这对神经元都会得到相同的输入。在N'中,对于不同的神经元u,<u,v>∈E,不需要利用给神经元v的延迟Δu,v(它模拟了u的发放对Pv(t)产生影响所经过的时间;参见图4)分配不同值的可能性。对于生物神经元,这些延迟Δu,v可能非常不同,这取决于u的轴突长度和从突触到v的触发区的距离,也与v的树突树中离子通道的分布有关。事实上,在生物神经系统中,通常假设延迟Δu,v=Δu,v(t)是由某些学习算法调整的参数(见,例如,Kempter et al., 1996)。最近的理论结果(Maass & Schmitt, 1997)表明,具有n个可变延迟的A型神经元的表达能力大于具有n个可变权重的A型神经元:前者的VC维数为Θ(n·log n),后者的VC维数仅为Θ(n)。

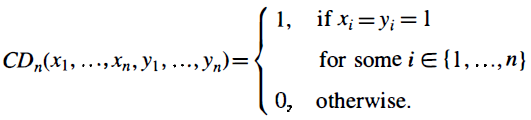

如果我们利用这种可能性,对某些神经元v和不同的神经元u采用不同的延迟Δu,v,那么我们可以证明,A型SNN实际上比第一代或第二代相同或相似大小的神经网络在计算上更强大。为此,我们考虑具体的布尔函数CDn: {0, 1}2n → {0, 1},它由下式所定义:

这个函数在生物学背景中似乎是相关的,因为它公式化了某种形式的模式匹配,即,符合检测。

这个函数在生物学背景中似乎是相关的,因为它公式化了某种形式的模式匹配,即,符合检测。

A型(或任何其他“合理”类型)的单个脉冲神经元v可以计算CDn。只需从输入节点a1,… ,an(用于x1,... ,xn)和输入节点b1,... ,bn(用于y1,... ,yn)中选择到v的延迟,其方式为Δai,v=Δbi,v(for i=1, ... ,n)以及对于j>i,当aj和ai同时发放时,响应函数εaj,v和εai,v的非零部分不会重叠,Δaj,v比Δai,v大得多。所有权重都可以选择等于1。

另一方面,我们想指出的是,A型(或B型)的单个脉冲神经元可以用抗噪声的方式计算该函数CDn,其中输入神经元a1,… ,an的发放时间的小偏差是来自这些输入神经元的延迟,在权重或在发放阈值中不影响输出的正确性。为了达到这一目的,只需给脉冲神经元的发放阈值Θv(0)分配一个值,例如1.5(EPSP的最大值)。

定理1.

1. 计算CDn的任意阈值电路N至少有n/log(n+1)个门。

2. 具有分段多项式的任意sigmoidal神经网络N计算CDn的激活函数具有Ω(n1/2)门。对于分段指数激活函数(如σ),我们可以得到Ω(n1/4)的下界。

证明. 设a1,… ,an,b1,… ,bn为N的输入节点,其中它接收其2n个输入变量的值x1,… ,xn,y1,… ,yn。事实上,我们给出了一个比所宣称的结果稍强的结果:在N中那些至少有一个输入节点b1,… ,bn的直接边的门,它们的数目的下界已经成立,因此在分层神经网络的情况下,这些是第一个隐含层中门的数目的下界。

我们考虑N的计算,其中一些“固定”向量q∈{0, 1}n被分配给输入节点b1,… ,bn,因此N的输出可以看作是分配给输入节点a1,… ,an的函数。我们只考虑这些n个赋值e1,... ,en∈{0, 1}n的集合S,其中n个输入变量中正好有一个值为1。由于N计算CDn,显然对于选择2n个不同的q∈{0, 1}n,网络计算2n个从S到{0, 1}的不同函数。

为了证明第一部分,我们在N中的计算节点上固定了一个线性顺序<,使得每个计算节点g接收(除了输入节点a1,… ,an和b1,… ,bn)仅来自N中其他计算节点的边,这些边在该线性顺序中位于g之前。考虑N中的一些任意计算节点g,以及b1,… ,bn的赋值q∈{0, 1}n集合Q,以便g之前的每个计算节点计算从S到{0, 1}的函数(关于从S到输入节点a1,... , an的输入赋值),这对于b1,… ,bn的每个赋值q∈Q是相同的。注意,对于N中的第一个计算节点,我们可以设置Q:={0, 1}n。

然后,对于从S到a1,… ,an的赋值,门g从其他计算节点接收的值不依赖于选择的b1,… ,bn的赋值q∈Q。因此,g经由直接边从输入节点a1,…,an和在<中位于g之前的计算节点接收的值的加权和,对于n个不同的从S到a1,… ,an的赋值和从Q到b1,… ,bn的任意赋值,假定至多n个不同的值r1 ≤ ... ≤ rn。显然,g的输出仅取决于该加权和的值以及g通过直接边从输入节点b1,… ,bn接收的那些值的加权和r。如果Θ是阈值门g的阈值,那么最小 i 使得ri + r ≥ Θ最多可以假定n+1个不同的值(假如rn + r < Θ,则包括值i=n+1)。因此,在b1,…,bn的不同固定赋值q∈Q下,节点g最多可以计算从S到{0, 1}的n+1个不同的函数。这会将Q划分为n+1个等价类,并且可以对每个等价类应用相同的参数到N中的后继节点(关于线性顺序<)。

如果用Q={0, 1}n开始这个构造,在第k个节点之后,N中的第一个计算节点将Q划分为至多(n+1)k个等价类。另一方面,N计算CDn意味着N的输出节点为b1,… ,bn的每个赋值计算从S到{0, 1}的不同函数,也就是说,它将{0, 1}n划分为2n个不同的等价类Q。因此,N中具有来自至少一个输入节点b1,… ,bn的直接边的计算节点的数目s满足(n+1)s ≥ 2n,即s ≥ n/log(n+1)。

在第二部分的证明中,我们从N构造了一个相关的sigmoidal神经网络N',我们可以证明它具有“高”的VC维数,因此必须包含大量的sigmoidal门。这种证明结构最初是由Koiran(1996)在一个稍有不同的背景下使用的。

如果只考虑a1,… ,an作为N的输入节点,则b1,… ,bn的不同固定赋值只能将N中具有直接边的那些s个计算节点的阈值从b1,… ,bn移动。我们现在考虑N的一个变体N',其中输入节点b1,… ,bn被删除,并且在N中上述s个门的阈值被视为神经网络通常意义上的VC维理论中的唯一“可编程参数”(或“权重”)(关于简要的调查,见Maass(1995a))。N计算CDn这一事实意味着N'分解S(关于这些s个可编程参数的不同赋值)。因此,N'具有至少为n的VC-维数。另一方面,Goldberg & Jerrum(1995)和Karpinski & Macintyre(印刷中)的结果表明,在这种情况下,N中的可编程参数的数目s在分段多项式激活函数的情况下满足n=O(s2),而对于分段指数激活函数,则为n=O(s4)。

2.2. Computation of Functions with Analog Input and Boolean Output

我们已经证明,对于布尔输入,A型脉冲神经网络具有与第一代相似大小的神经网络完全相同的计算能力,而且实际上更强大。然而,来自所有三代的神经网络也能够处理来自Rn或[0, 1]n的数字输入,而不是来自{0, 1}n的布尔输入。对于脉冲神经网络,通过输入神经元ai的发放时间Tinput - xi · c编码数字输入变量xi∈R(参见Hopfield,1995)是很自然的,其中C> 0是常数,Tinput是取决于输入到达的时间的参数,而不是输入变量xi的值。类似地,我们期望通过在Toutput - y · c时刻某个“输出神经元”发放在SNN中实现数字输出y∈R,其中Toutput > Tinput与输入变量的值x1,… ,xn无关。我们将这种通过单脉冲时间对模拟变量进行编码的方法称为“线性时间编码”。对于布尔输出函数的计算,可以采用与以前相同的输出约定,也可以采用舍入(即,将在某个固定时间T之前输出神经元发放视为输出"I")。

有模拟输入和布尔输出的有趣函数的一个具体例子是由下式定义的"元素特异性函数"EDn: (R+)n → {0, 1}:

如果对输入变量xi的值进行编码作为发放时间Tinput - xi · c(输入神经元ai),那么对于常数c>0的足够大的值,单个脉冲神经元v可以计算EDn(即使对于所有i, j ∈ {1, ... , n},Δai,v=Δaj,v)。这适用于任何合理类型的响应函数,如下文所述的A型或B型。

我们还想指出,EDn可以由一个单脉冲神经元以非常抗噪声的方式计算出来。设εmax为EPSP所假定的最大值,设ε(c)为两个EPSP之和所能达到的最大值,这两个EPSP的时差至少为c。通过选择“静息”神经元v的发放阈值的值![]() ,对于一些i≠j与时间编码中任意两个不同的输入xi,xj,假如xi=xj,可以实现v一定会发放;假如|xi - xj|≥1,它一定不会发放。除此之外,选择Θv(0),即使神经元的膜电位、发放阈值和输入-EPSP的到达时间受到噪声的影响,神经元v也能给出正确的输出。此外,如果c选择得太大,以至于ε(c)=εmax,则其“安全边缘”

,对于一些i≠j与时间编码中任意两个不同的输入xi,xj,假如xi=xj,可以实现v一定会发放;假如|xi - xj|≥1,它一定不会发放。除此之外,选择Θv(0),即使神经元的膜电位、发放阈值和输入-EPSP的到达时间受到噪声的影响,神经元v也能给出正确的输出。此外,如果c选择得太大,以至于ε(c)=εmax,则其“安全边缘”![]() 可以增加到值

可以增加到值![]() 。

。

通过定义函数EDn,这种由脉冲神经元对EDn的抗噪声计算成为可能:如果min{|xi - xj|: i≠j}对于某些输入<x1, ... , xn>∈Rn有一个介于0和1之间的值,那么神经元是否发放并不重要。因此,EDn定义中的“任意”一词确保了计算EDn的脉冲神经元可以避免“一触即发的情况”。

定理2. 任何计算EDn的分层阈值电路N在它的第一个隐含层上都有Ω(n·logn)个门。

证明. 设k为第一个隐含层上N的门数。相应的k个半空间将输入空间Rn划分为至多2k个不同的多面体(即,半空间的交集),使得N为来自同一个多面体的所有输入提供相同的输出。为了这个考虑,必须允许多面体是封闭半空间和开放半空间的交集。

我们现在考虑那些n!个输入xn=<π(1), ... , π(n)>∈{1, ... , n}n,它表示所有n!个{1,… ,n}的置换π。证明每个xπ位于不同的多面体就足够了,因为这意味着2k ≥ n!。因此,假设一个矛盾,两个置换xπ和![]() 位于同一个多面体P中。通过构造阈值电路N,为所有x∈P提供相同的输出。由于P是凸的,N不仅为xπ和

位于同一个多面体P中。通过构造阈值电路N,为所有x∈P提供相同的输出。由于P是凸的,N不仅为xπ和![]() 提供相同的输出,也适用于L线上连接这两点的所有点。这就产生了一个矛盾,因为

提供相同的输出,也适用于L线上连接这两点的所有点。这就产生了一个矛盾,因为![]() ,但是对于这条线L上的某个点x,EDn(x)=1。

,但是对于这条线L上的某个点x,EDn(x)=1。

为了分析具有布尔输出的sigmoidal神经网络函数的复杂性,需要确定一个合适的约定来舍入此类网络的实值输出。为了使我们随后的下限结果尽可能强,这里可以假设最弱的舍入约定,其中对于某个任意参数Θ,如果r≥Θ,则网络输出节点的实值输出r取整为1。分别取整为0和1的输出之间不需要间隔。

与CDn一样,我们可以证明,任何计算EDn的第二代神经网络都需要有Ω(n1/4)个门。在下面的定理中,这个下界将提升为(n-1)/4。这种强分离结果的证明利用了Sontag的2w+1(Sontag,1997)作为最大数d的更佳上界,而不是VC维数的上界,使得具有w个可编程参数的sigmoidal神经网络可以破坏一般位置上的每一组d个不同的输入。为了将他的结果应用到我们的下界论证中,我们必须从任意的sigmoidal神经网络中构造一个相关的网络来计算EDn,这个网络破坏了每一组n-1输入。

定理3. 任何计算EDn的sigmoidal神经网络至少有![]() 个隐含单元。

个隐含单元。

证明. 设N是一个具有k个门的任意sigmoidal神经网络,它计算EDn。

考虑任何大小为n-1的集合![]() 。设λ>0足够大,使得λ·S中的数字的成对距离≥2。设A是一组n-1个数>max(λ·S)+2,成对距离≥2。

。设λ>0足够大,使得λ·S中的数字的成对距离≥2。设A是一组n-1个数>max(λ·S)+2,成对距离≥2。

通过假设N可以决定来自λ·S ∪ A的任意n个输入是否都是不同的。设Nλ是N的一个变体,其中第一个输入变量的所有边上的权重都乘以λ。然后通过将n-1对不同的数的适当固定集指派给其他n-1个输入变量,Nλ计算S上的任何特征函数。

因此,如果将N的第一个输入变量的边上的≤k权重和连接到另一个n-1输入变量的门的≤k阈值视为N的可编程参数,则N用2k个可编程参数来破坏S。实际上,在随后参数的更一般的设置中,我们只有k+1个可编程参数,因为权重中因子λ的k次出现可以算作单个可编程参数。

由于大小为n-1的集合![]() 是任意选择的,我们现在可以应用Sontag(1997)的结果,这意味着n-1 ≤ 2(k+1)+1,因此k ≥ (n-4)/2。因此,N至少有(n-4)/2个计算节点,因此至少有(n-4)/2-1个隐含单元。

是任意选择的,我们现在可以应用Sontag(1997)的结果,这意味着n-1 ≤ 2(k+1)+1,因此k ≥ (n-4)/2。因此,N至少有(n-4)/2个计算节点,因此至少有(n-4)/2-1个隐含单元。

评述4.

1. 定理3中Ω(n)的下界是迄今为止所得到的sigmoidal神经网络大小的最大下界(不仅是EDn,而且是任何具体函数)。由于Koiran(1996),先前已知的一些其他函数的下界是Ω(n1/4)。

2. Sontag(1997)第4节的结果表明,如果神经网络N计算EDn同时使用了sigmoidal门和阈值门,则其上界和前面定理3的下界仍然有效。

显然,对于皮层中的大多数神经元v来说,其突触的“权重”wu,v不太可能大到仅仅两个同步的EPSP就足以使电位Pv增加到“静息”神经元v的发放阈值Θv(0)以上。在这方面,脉冲神经元的通用数学模型“高估”了生物神经元的计算能力。更现实的假设是,六个同时到达的EPSP可以引起一个神经元发放(见Valiant,1994中的讨论)。因此,我们考虑函数EDn的以下变体![]() :

:

在脉冲神经元的一般模型中,膜电位Pv(t)被假定为突触后电位的线性和。这无疑是一种理想化,因为到达远离触发区(位于轴突的开始)的突触的孤立EPSP在到达触发区的路上会受到指数衰减的影响。因此,这种分离的EPSP对触发区的膜电位Pv(t)几乎没有任何影响。另一方面,与相邻突触同步到达的EPSP在树突树的“热点”处被“增强”,因此可能对触发区的膜电位Pv(t)有显著影响(Shepherd,1994)。我们对![]() 的定义是这样的,尽管EPSP的整合存在这些非线性效应,但生物神经元在时间编码中计算

的定义是这样的,尽管EPSP的整合存在这些非线性效应,但生物神经元在时间编码中计算![]() 得到相当大的n值,这是很有可能的。只有当由三个相邻突触组成的两个“块”都接收到同步EPSP时,计算

得到相当大的n值,这是很有可能的。只有当由三个相邻突触组成的两个“块”都接收到同步EPSP时,计算![]() 的神经元才需要发放。此外,避免了“一触即发”的情况,因为当神经元仅接收到4或5个同步(或几乎同步)EPSP时,不需要任何条件。只有当神经元在长度为c的任何时间间隔内最多接收到3个EPSP时,才需要不发放。

的神经元才需要发放。此外,避免了“一触即发”的情况,因为当神经元仅接收到4或5个同步(或几乎同步)EPSP时,不需要任何条件。只有当神经元在长度为c的任何时间间隔内最多接收到3个EPSP时,才需要不发放。

为了证明用sigmoidal门和阈值门计算![]() 的任意神经网络N中隐含单元数的下界,我们继续证明定理3。现在,我们考虑大小为

的任意神经网络N中隐含单元数的下界,我们继续证明定理3。现在,我们考虑大小为![]() 的任意集合

的任意集合![]() ,并将剩余的n-3个输入变量分成

,并将剩余的n-3个输入变量分成![]() 个块,其中3个变量始终接收相同的输入值。设Nλ是N的一个变体,它标识前三个输入变量,并将它们的所有权重乘以一个公共因子λ。由于N计算

个块,其中3个变量始终接收相同的输入值。设Nλ是N的一个变体,它标识前三个输入变量,并将它们的所有权重乘以一个公共因子λ。由于N计算![]() ,网络Nλ用k个计算节点在k+1个可编程参数的帮助下破坏S。因此,Sontag的结果(Sontag,1997)得到

,网络Nλ用k个计算节点在k+1个可编程参数的帮助下破坏S。因此,Sontag的结果(Sontag,1997)得到![]() ,即,k ≥ (n-15)/6。

,即,k ≥ (n-15)/6。

如果我们插入一个生物神经元突触数目n的共同估计值,例如n=10000,则前面的不等式得到N中隐含单元的数目k-1的下限1663。因此,即使我们更愿意为上述常数中的某些常数插入稍有不同的值,![]() 在前面证明(分别为,对于反映所涉及参数的不同选择的

在前面证明(分别为,对于反映所涉及参数的不同选择的![]() 的变体)对于计算相同函数的sigmoidal神经网络的最小尺寸仍然产生几百的下限。因此,我们证明了生物神经元和sigmoidal“神经元”(即第二代的计算单元)的计算能力之间的巨大差异。

的变体)对于计算相同函数的sigmoidal神经网络的最小尺寸仍然产生几百的下限。因此,我们证明了生物神经元和sigmoidal“神经元”(即第二代的计算单元)的计算能力之间的巨大差异。

对于数值输入,我们先前通过一个A型脉冲神经网络对阈值电路(即第一代神经网络)进行了粗略模拟。更令人惊讶的是,人们可以证明,没有这样的模拟是可能的。设f: N→N为任意函数。对于数值输入,不存在通过A型f(s)脉冲神经网络模拟具有s个门的任意阈值电路的方法。考虑一个阈值电路,对于满足x1+x2=x3的输入x1, x2, x3∈[0, 1]输出为1,否则输出为0。显然,这可以通过一个只有三个阈值门的电路来实现:对于(x1+x2≤x3且x1+x2≥x3),电路输出为1。然而,已经证明,从[0,1]3到{0,1}(以及对某些γ>0的[0,γ]3的任何约束)的函数不能由任何A型脉冲神经网络计算,无论它使用多少神经元和多少计算时间。这是根据Maass & Ruf(1995)中给出的随机存取器(RAM)的公共模型的N=RAM约束的计算能力,对数值输入的A型脉冲神经网络的计算能力进行的一般描述。

因此,对于数值输入,我们已经达到了A型脉冲神经元计算能力的极限。问题是,这个限制是否表明了脉冲神经元的一般缺陷,或者A型极简单的响应函数和阈值函数的缺陷。为了回答这个问题,让我们考虑具有连续的分段线性(而不是分段常数)响应函数和阈值函数的脉冲神经元,我们称之为B型脉冲神经元。A型脉冲神经元最简单的非平凡响应函数如图5所示。

关于B型脉冲神经元的计算能力,只要我们只考虑前馈计算,并且阈值函数Θv对于小参数具有“∞”值,那么是否允许分段常数、分段线性或更一般类型的阈值函数Θv,就没有多大区别。此外,B型响应函数的具体形状与以下内容无关。

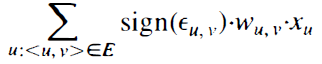

可以证明,与上述关于A型神经网络的负结果相比,具有B型响应函数的O(1)脉冲神经网络(如图5所示)可以模拟任何阈值门,即使对于n个实值输入变量也是如此。这种模拟利用了B型脉冲神经元的一个重要作用,这种作用是A型脉冲神经元无法实现的:传入的EPSP和IPSP可以连续地改变神经元的发放时间(Maass,1997)。更准确地说,在一定的参数范围内,对于突触前神经元u在Tinput - xu·c时刻的发放反应,神经元v的发放时间tv可以写成

其中Toutput不依赖于xu的值,如果是EPSP,则sign(εu,v)=-1,如果是IPSP,则sign(εu,v)=-1。因此,神经元v输出加权和

在时间编码中(响应于模拟输入xu,这在时间编码中给出)。

等式(1)揭示了一个令人惊讶的事实,即在时间编码的背景下,脉冲神经元突触的“权重”wu,v能够起到与前两代神经网络计算单元相同的作用。

在第一代分层神经网络的第一个隐含层之后的所有后续层仅接收布尔输入,即使网络输入是实值的。因此,这些随后的层可以很容易地被A型脉冲神经元模拟(如前所述)。然而,如果想要用B型脉冲神经元模拟具有布尔输入和输出(或任何其他类型布尔电路)的阈值电路,如图5所示的响应函数,它比A型响应函数更接近图2中的生物学原型,则会出现一个微妙但严重的问题。很明显,B型脉冲神经元只有在收到同步输入脉冲时才能模拟布尔门。问题是,即使一层B型脉冲神经元通过同步输入脉冲接收布尔输入(例如,在编码中,脉冲对应于“1”而没有脉冲对应于“0”),这一层神经元也不会以同步方式发放,而是在取决于具体输入“比特”的稍有不同的时间发放。这个问题的根源(A型脉冲神经元不存在这个问题)是一个电位Pv(t),即B型的几个EPSP和IPSP之和本身是连续且分段线性的,其线性部分的斜率将特别取决于它同时接收的EPSP的数量(因此在我们的解释中具体的“布尔”输入)。因此,Pv(t)超过阈值Θv(0)的精确时间通常取决脉冲神经元的“布尔”输入。这就给B型SNN模拟多层阈值电路(或其他多层布尔电路)带来了严重的问题,因为如果所考虑的层上的那些神经元v不以同步方式触发(因此在模拟布尔电路时代表“1”),则模拟阈值门,甚至简单的布尔门(如AND)也不可能被下一层B型脉冲神经元所控制。

定理5. 具有来自[0, 1]n的实值输入的s个门的任何阈值电路都可以用B型O(s)脉冲神经网络来模拟。

证明. 首先考虑具有来自[0, 1]n的输入<x1, ... , xn>的任意阈值门G,如果![]() 则输出1,否则输出0。我们证明,对于网络输入x1, ... , xn的时间编码(对于常数c的足够小的值),G可以由具有B型脉冲神经元的常数(即O(1))的网络来模拟。这里的结构与Maass(1997)给出的模拟线性(分别为sigmoidal)门的结构相同,后者产生一个脉冲神经元v,其发放时间表示时间编码中的加权和

则输出1,否则输出0。我们证明,对于网络输入x1, ... , xn的时间编码(对于常数c的足够小的值),G可以由具有B型脉冲神经元的常数(即O(1))的网络来模拟。这里的结构与Maass(1997)给出的模拟线性(分别为sigmoidal)门的结构相同,后者产生一个脉冲神经元v,其发放时间表示时间编码中的加权和![]() 。特别是,如果

。特别是,如果![]() ,v在固定时间T(不依赖于x1, ... , xn)时或之前发生,否则在时间T之后发生。我们安排从v产生的EPSP到达随后的脉冲神经元v',该脉冲神经元除从辅助脉冲神经元接收EPSP外,其发放时间取决于Tinput,但不取决于x1, ... , xn。在适当选择v'的权重和延迟后,当且仅当v在T时刻或之前激发时,神经元才会发放。

,v在固定时间T(不依赖于x1, ... , xn)时或之前发生,否则在时间T之后发生。我们安排从v产生的EPSP到达随后的脉冲神经元v',该脉冲神经元除从辅助脉冲神经元接收EPSP外,其发放时间取决于Tinput,但不取决于x1, ... , xn。在适当选择v'的权重和延迟后,当且仅当v在T时刻或之前激发时,神经元才会发放。

显然,我们可以用同样的方法模拟任何给定阈值电路C的整个第一层。为了用B型脉冲神经元模拟C的后续层,我们可以使用Maass(1996a)的结构。前面描述的脉冲神经元v'代表了第一层C的门的输出,当且仅当对应的C的门输出1时发放。然而,在这种情况下,v'发放的精确时间取决于x1, ... , xn。因此,在根据Maass(1996a)中的构造使用这些门v'的“布尔”输出作为其它B型脉冲神经元的输入来模拟C的后续层之前,必须使用Maass(1996a)中定理2.1的证明中构造的同步模块。

2.3. Further Results for Networks of Spiking Neurons of Type B

我们在前一节中已经表明,与A型SNN相比,B型脉冲神经网络可以模拟第一代神经网络,即使是在实值网络输入的情况下。因此,问题是B型脉冲神经网络是否也能模拟(分别近似)具有实值输入和输出的第二代神经网络。这个问题在Maass(1997)中得到了肯定的回答,它表明,对于实值变量x的时间编码,任何连续函数F: [0,1]n → [0,1]k都可以由一个B型脉冲神经元的单隐层网络近似任意逼近(关于一致收敛,即L∞)。

事实上,该结果不仅适用于在第2.2节开头描述的简单线性时间编码方案,也适用于通过与该方案“连续相关”的单脉冲时间来编码模拟变量的任何其他方案。因此,举例来说,如果在T - x·c时发放的神经元不编码模拟数x,而是编码e-x或x3,那么它也成立。

此外,有证据表明,许多实际相关的模拟函数F可以用B型脉冲神经元的小网络来逼近。大量关于sigmoidal神经网络上反向传播学习的实际应用的结果表明,通过具有相当少的sigmoidal门的sigmoidal神经网络可以学习这些应用的相关目标函数F(以及因此近似)。另外的经验证据表明,sigmoidal激活函数的精确形式对所需的sigmoid门数目并不重要。因此,我们可以认为,应用问题中出现的目标函数F通常可以很好地通过具有少量s个sigmoidal单元的sigmoidal神经网络来实现,这些s个sigmoidal单元采用以下线性饱和激活函数π:

Leshno, Lin, Pinkus and Schocken(1993)的近似结果表明,在这种情况下,F也可以很好地近似于B型O(s)脉冲神经网络。

因此,可以说,关于计算模拟函数的电路复杂度,B型脉冲神经网络至少与第二代神经网络一样强大。此外,我们之前描述的前两代神经网络大小的下限(对于计算函数CDn,EDn或![]() 的网络)暗示B型脉冲神经网络实际上比前两代的神经网络更强大:为了实现B型SNN和前两代神经网络之间的分离结果,只需验证,除了单个的A型脉冲神经元,还有一个单独的B型脉冲神经元能计算CDn,EDn和

的网络)暗示B型脉冲神经网络实际上比前两代的神经网络更强大:为了实现B型SNN和前两代神经网络之间的分离结果,只需验证,除了单个的A型脉冲神经元,还有一个单独的B型脉冲神经元能计算CDn,EDn和![]() 。

。

上述模拟结果的证明详见Maass(1996a,1997)。从这些证明可以看出,对于B型SNN计算能力的正面结果,它们实际上并不要求响应函数或阈值函数是分段线性的(即B型)。相反,假设EPSP有一些小的线性增长段和IPSP有一些小的线性下降段就足够了。生物神经元的EPSP和IPSP大致满足这些特性(见图2)。在Maass(1995a,c)中,根据随机存取器的常见模型的约束(称为N-RAM),给出了B型SNN计算能力的一个完整的刻画。

此外,Maass(1997)指出,SNN对sigmoidal神经网络的模拟也可以用随机或噪声脉冲神经元的生物学模型来实现。很容易看出,这里所考虑的函数CDn,EDn和![]() 可以由一个A或B型噪声脉冲神经元来计算。此外,Maass(1996b)中还表明,即使对于A或B型噪声非常大的脉冲神经元,原则上也可以以任何期望的可靠度来执行任意数字计算。然而,噪声当然会影响模拟输入的脉冲神经网络的计算能力,我们参考Maass和Orponen(1997)关于模拟输入的噪声脉冲神经元网络计算能力的限制。

可以由一个A或B型噪声脉冲神经元来计算。此外,Maass(1996b)中还表明,即使对于A或B型噪声非常大的脉冲神经元,原则上也可以以任何期望的可靠度来执行任意数字计算。然而,噪声当然会影响模拟输入的脉冲神经网络的计算能力,我们参考Maass和Orponen(1997)关于模拟输入的噪声脉冲神经元网络计算能力的限制。

3. CONCLUSIONS

本文分析了脉冲神经网络对单脉冲时间编码的计算能力。结果表明,这种计算模型的计算能力至少与前两代神经网络相同(即,多层感知机和sigmoidal神经网络)大小相似。此外,我们还展示了一些具体的函数,这些函数要求在脉冲神经网络中计算的神经元数量显著减少。

定理3的证明似乎对sigmoidal神经网络理论具有独立的兴趣,因为它为sigmoidal神经网络提供了目前已知的最强下界结果。它将先前已知的最大下限Ω(n1/4)(Koiran,1996)提高到Ω(n)。这个新的下界结果从技术的角度来看也是有趣的,因为它提供了关于神经网络“Sontag维”的最新结果Sontag(1997)的第一个已知应用。这是神经网络的一个新的“维度”概念,在某种意义上,它与神经网络的Vapnik-Chervonenkis维度的熟悉概念是双重的(在维度的定义中,可将“存在一组d个输入的集合S…”替换为“对于所有d个输入的集合S…”)。

正如本文中的参考文献所指出的,脉冲神经网络的理论研究并不是一个新的研究课题。事实上,它在理论神经生物学、生物物理学和理论物理学方面有着悠久的传统。然而,迄今为止,对脉冲神经网络的计算能力进行的严格的数学分析却一直没有。我们相信这种分析将有助于理解复杂生物神经系统中计算的组织。

此外,这种分析似乎有助于评估各种“脉冲神经元人工网络”设计的潜在能力,特别是用脉冲计算的集成电路的硅实现(De Yong et al., 1992;Douglas et al., 1995;Horinchi et al., 1991;Jahnke et al., 1996;Jiu & Leong, 1996;Mahowald, 1994;Mead, 1989;Meador et al., 1991;Murray & Tarassenko, 1994;Northmore & Elias, 1996;Pratt, 1989;Zaghloul et al., 1994;Zhao, 1995)。例如,本文的结果和Maass and Ruf(1995)的结果表明,用矩形脉冲(即A型)工作的脉冲神经网络和用三角形脉冲(即B型)工作的脉冲神经网络的计算能力之间存在着巨大的差异。

浙公网安备 33010602011771号

浙公网安备 33010602011771号