TimeDistributed层的理解与使用(tf2.keras)

TimeDistributed这个层还是比较难理解的。事实上通过这个层我们可以实现从二维像三维的过渡,甚至通过这个层的包装,我们可以实现图像分类视频分类的转化。

考虑一批32个样本,其中每个样本是一个由16个维度组成的10个向量的序列。该层的批输入形状然后(32, 10, 16)。

可以这么理解,输入数据是一个特征方程,X1+X2+...+X10=Y,从矩阵的角度看,拿出未知数,就是10个向量,每个向量有16个维度,这16个维度是评价Y的16个特征方向。

TimeDistributed层的作用就是把Dense层应用到这10个具体的向量上,对每一个向量进行了一个Dense操作,假设是下面这段代码:

model = Sequential()model.add(TimeDistributed(Dense(8), input_shape=(10, 16)))

输出还是10个向量,但是输出的维度由16变成了8,也就是(32,10,8)。

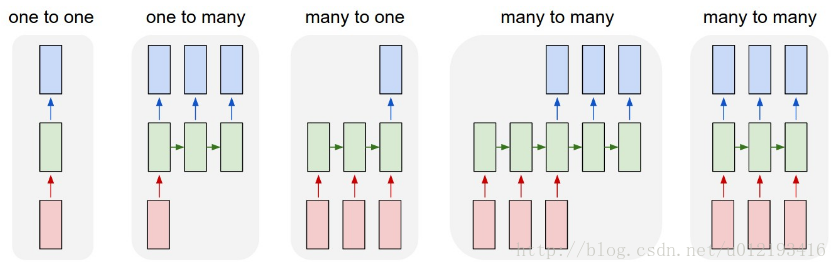

事实上,TimeDistributed层给予了模型一种一对多,多对多的能力,增加了模型的维度。

TimeDistributed层在每个时间步上均操作了Dense,由上面几个图明显可以看出了增加了模型实现一对多和多对多的能力。如果你使用正常的Dense层,你最后只会得到一个结果。

TimeDistributed层在卷积层上的应用:

from keras.models import Input,Model

from keras.layers import Dense,Conv2D,TimeDistributed

input_ = Input(shape=(12,32,32,3))

out = TimeDistributed(Conv2D(filters=32,kernel_size=(3,3),padding='same'))(input_)

model = Model(inputs=input_,outputs=out)

model.summary()

这里12代表就是时间序列,32,32,3指的是高,宽,通道数。卷积操作使用TimeDistributed就相当与这12个时间序列共享一个卷积层参数信息,无论时间序列值为多少,参数总量还是一定的。此处一共有896个参数,卷积核weights有3×3×3×32=864个,卷积核bias有32个。

再举一个例子:

TimeDistributed(Conv2D(512, (1, 1), kernel_initializer='normal'), input_shape=(128,14,14,1024), name=conv_name_base + '2a')

这里的128为时间序列,14、14、1024为高、宽、通道数。输出维度为:(128,14,14,512)。

TimeDistributed在mask-rcnn的用法在于:对FPN网络输出的多层卷积特征进行共享参数。因此,个人认为TimeDistributed的真正意义在于使不同层的特征图共享权重。

引用:https://blog.csdn.net/zh_JNU/article/details/85160379

浙公网安备 33010602011771号

浙公网安备 33010602011771号