逻辑回归

一、逻辑回归算法原理

逻辑回归(Logistic Regression) 属于机器学习 — 监督学习 — 分类。

逻辑回归(Logistic Regression)主要解决二分类问题,用来表示某件事情发生的可能性。

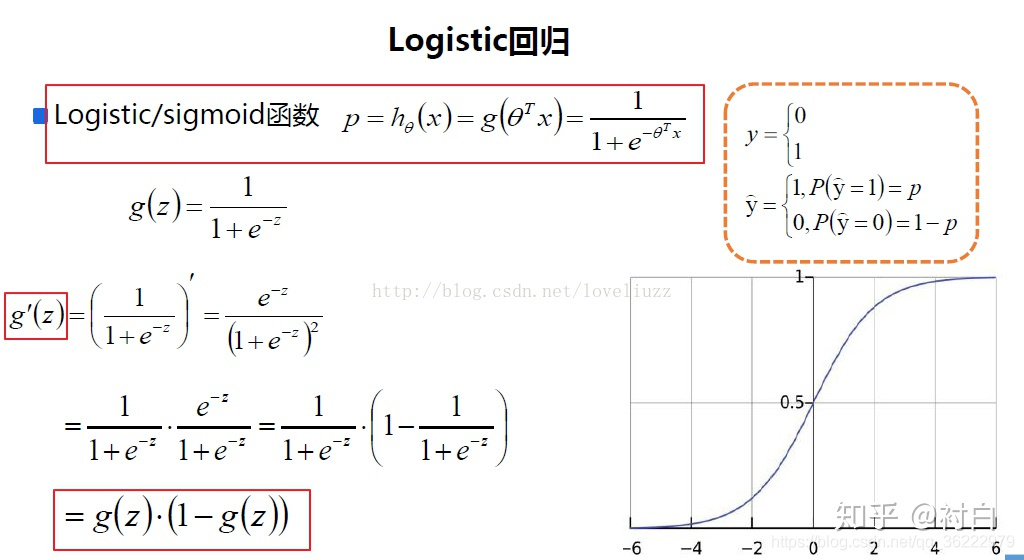

逻辑回归本质上是线性回归,只是在特征到结果的映射中加入了一层函数sigmoid函数映射,即先把特征线性求和,然后使用函数g(z)将做为假设函数来预测。g(z)函数可以将连续值映射到0和1上。logistic回归的假设函数如下所示,线性回归假设函数只是θx

二、逻辑回归的优缺点

优点:

实现简单,广泛的应用于工业问题上;

分类时计算量非常小,速度很快,存储资源低;

便利的观测样本概率分数;

对逻辑回归而言,多重共线性并不是问题,它可以结合L2正则化来解决该问题;

计算代价不高,易于理解和实现;

缺点:

当特征空间很大时,逻辑回归的性能不是很好;

容易欠拟合,一般准确度不太高

不能很好地处理大量多类特征或变量;

只能处理两分类问题(在此基础上衍生出来的softmax可以用于多分类),且必须线性可分;

对于非线性特征,需要进行转换;

浙公网安备 33010602011771号

浙公网安备 33010602011771号