Scrapy爬虫框架

简介

Scrapy一个开源和协作的框架,其最初是为了页面抓取所设计的,使用它可以以快速、简单、可扩展的方式从网站中提取所需的数据。

但目前Scrapy的用途十分广泛,可用于如数据挖掘、监测和自动化测试等领域,也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services )

或者通用的网络爬虫。

Scrapy 是基于twisted框架开发而来,twisted是一个流行的事件驱动的python网络框架。因此Scrapy使用了一种非阻塞(又名异步)的代码来实现并发。

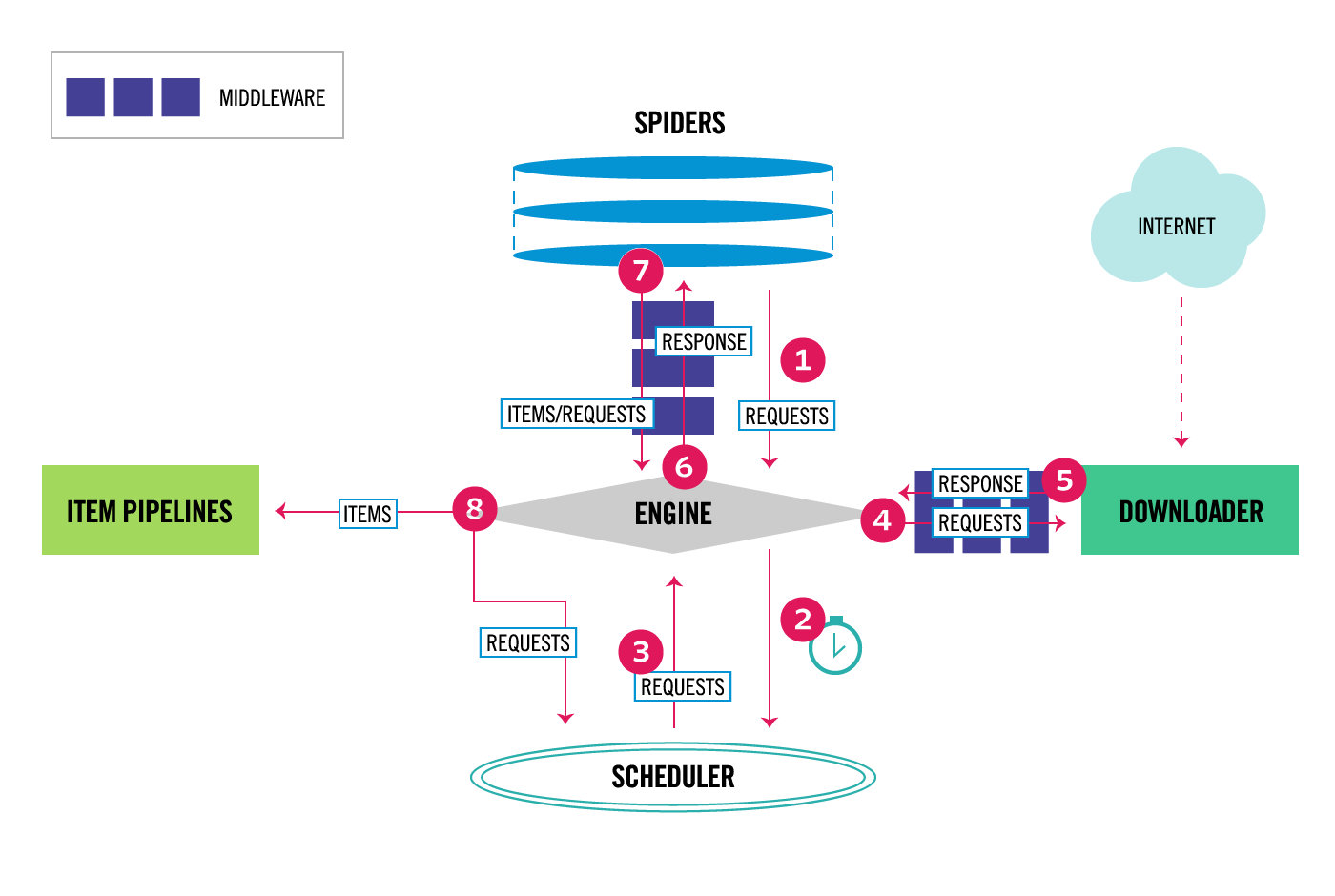

整体架构大致如下

架构

执行流程:

1.引擎从spider获取初始爬行请求。

2.引擎在调度程序中调度请求,并请求下一个要爬行的请求。

3.调度程序将下一个请求返回到引擎。

4.引擎将请求发送到下载器,并通过下载器中间件(请参见process_request())。

5.一旦页面完成下载,下载器将生成响应(使用该页面),并将其发送到引擎,并通过下载器中间软件(请参见process_response())。

6.引擎接收下载器的响应并将其发送给spider进行处理,并通过spider中间件进行处理(请参见process_spider_input())。

7.spider处理响应,并通过spider中间件(请参见process_spider_output())向引擎返回刮掉的项目和新请求(后续)。

8.引擎将已处理的项目发送到项目管道,然后将已处理的请求发送到计划程序,并请求可能的下一个请求进行爬网。

9.该过程重复(从步骤1开始),直到调度程序不再发出请求。

各组件以及作用

# 引擎(EGINE)

引擎负责控制系统所有组件之间的数据流,并在某些动作发生时触发事件。有关详细信息,请参见上面的数据流部分。

# 调度器(SCHEDULER)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL的优先级队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址

# 下载器(DOWLOADER)

用于下载网页内容, 并将网页内容返回给EGINE,下载器是建立在twisted这个高效的异步模型上的

# 爬虫(SPIDERS)

SPIDERS是开发人员自定义的类,用来解析responses,并且提取items,或者发送新的请求

# 项目管道(ITEM PIPLINES)

在items被提取后负责处理它们,主要包括清理、验证、持久化(比如存到数据库)等操作

# 下载器中间件(Downloader Middlewares)

位于Scrapy引擎和下载器之间,主要用来处理从EGINE传到DOWLOADER的请求request,已经从DOWNLOADER传到EGINE的响应response

# 爬虫中间件(Spider Middlewares)

位于EGINE和SPIDERS之间,主要工作是处理SPIDERS的输入(即responses)和输出(即requests

安装

# 安装 #Windows平台 pip3 install wheel #安装后,便支持通过wheel文件安装软件,wheel文件官网:https://www.lfd.uci.edu/~gohlke/pythonlibs pip3 install lxml pip3 install pyopenssl 下载并安装pywin32:https://sourceforge.net/projects/pywin32/files/pywin32/ 下载twisted的wheel文件:http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted 执行pip3 install 下载目录\Twisted-17.9.0-cp36-cp36m-win_amd64.whl #Linux平台 pip3 install scrapy

使用

创建项目

浙公网安备 33010602011771号

浙公网安备 33010602011771号