13-垃圾邮件分类2

1.读取

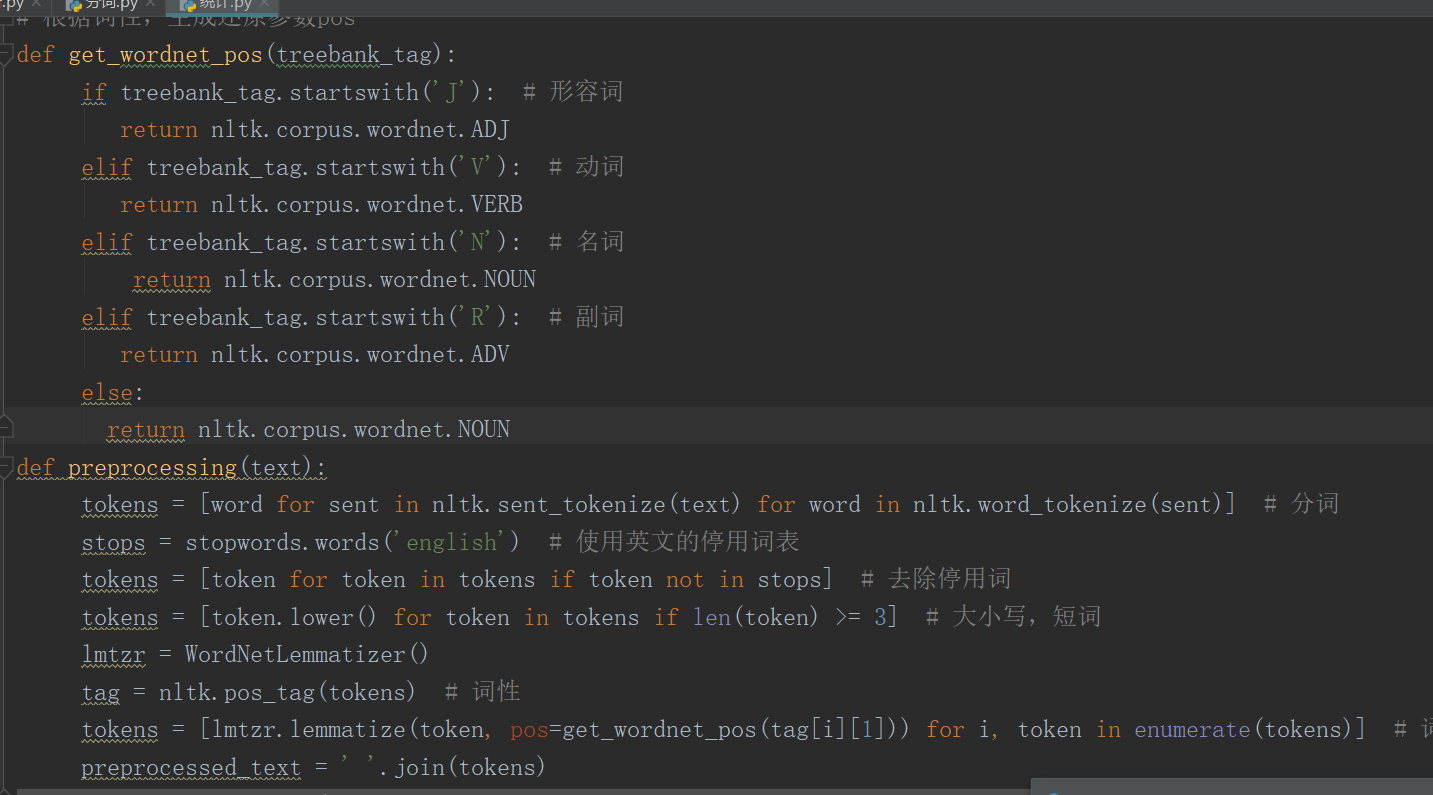

2.数据预处理

3.数据划分—训练集和测试集数据划分

from sklearn.model_selection import train_test_split

x_train,x_test, y_train, y_test = train_test_split(data, target, test_size=0.2, random_state=0, stratify=y_train)

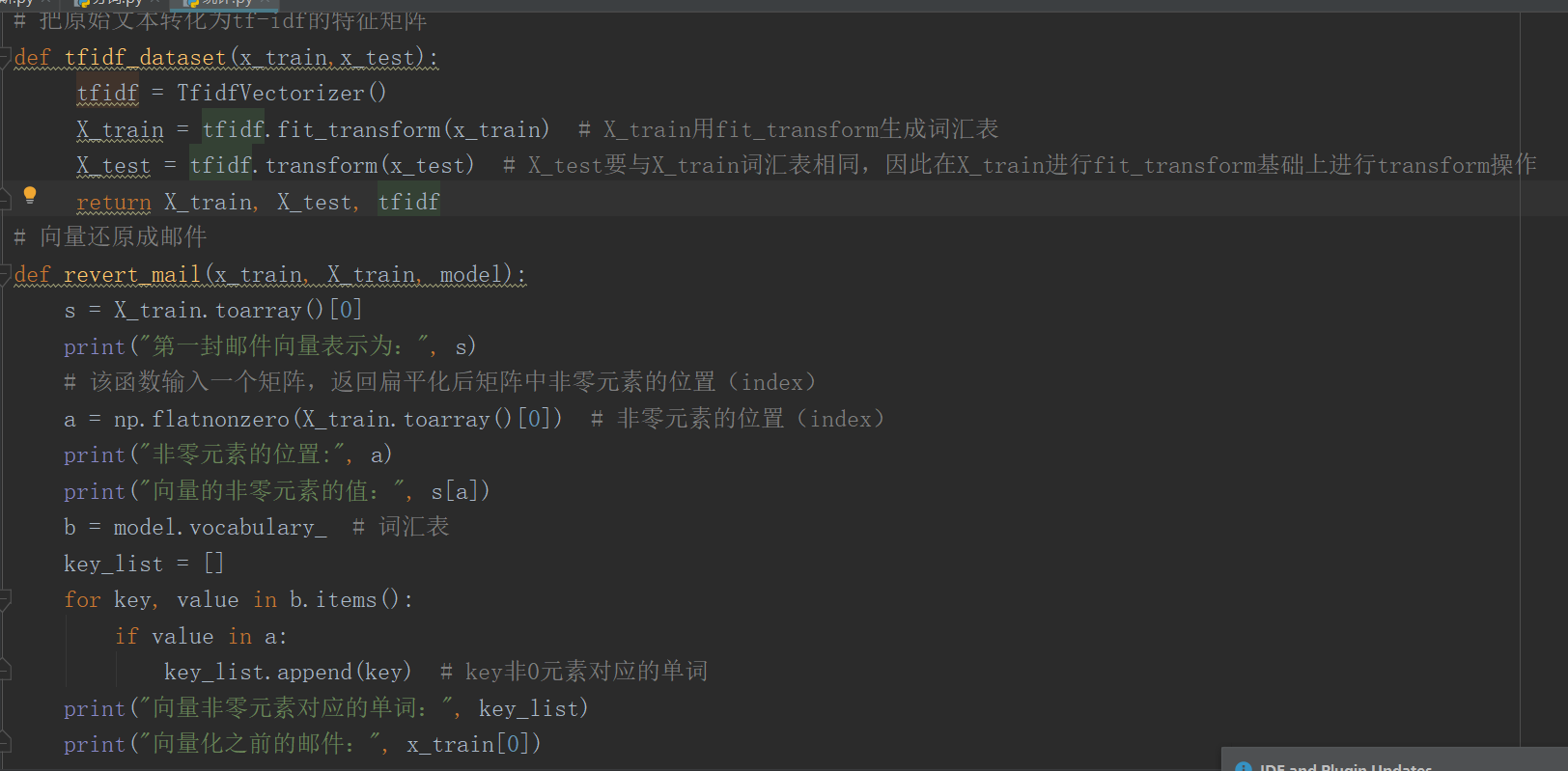

4.文本特征提取

sklearn.feature_extraction.text.CountVectorizer

sklearn.feature_extraction.text.TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf2 = TfidfVectorizer()

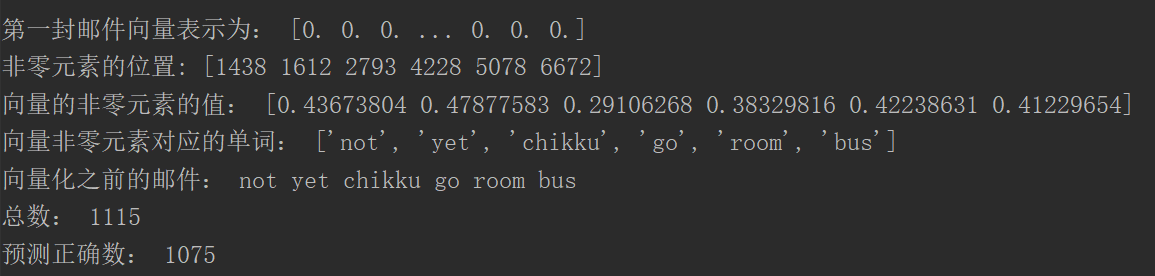

观察邮件与向量的关系

向量还原为邮件

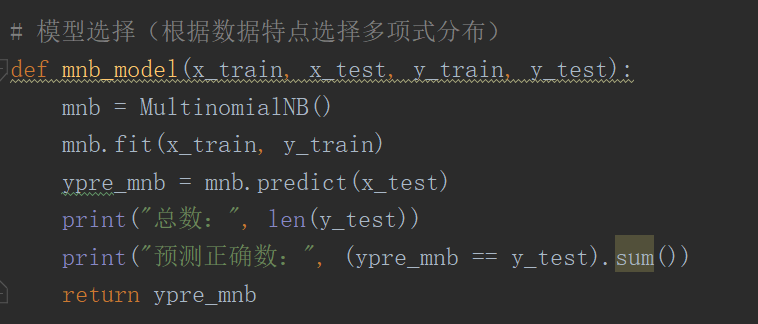

4.模型选择

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

说明为什么选择这个模型?

答:模型需要根据数据集中特征的特点来进行选取,垃圾邮件分类重点在于文档中单词出现的频率以及文档的重要性,数据并不符合正态分布的特征,并且垃圾邮件判定过程是一个随机事件,单词在邮件中出现的次数并不是固定的,因此不能选择高斯型分布模型,此处选择多项式分布模型。

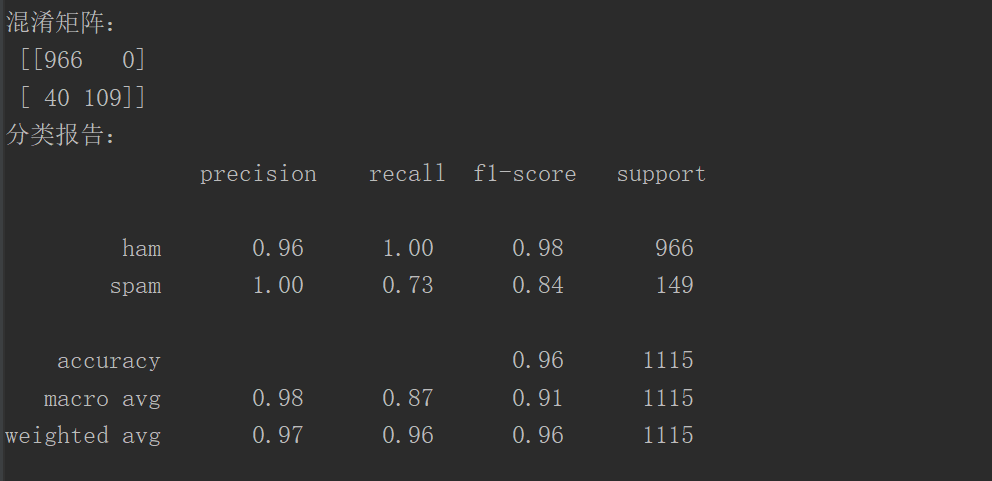

5.模型评价:混淆矩阵,分类报告

from sklearn.metrics import confusion_matrix

confusion_matrix = confusion_matrix(y_test, y_predict)

说明混淆矩阵的含义

答:混淆矩阵confusion-matrix

TP(True Positive):真实为0 ,预测也为0

FN(False Negative):真实为0 ,预测为1

FP(False Positive):真实为1 , 预测为0

TN(True Negative):真实为1 ,预测也为1

from sklearn.metrics import classification_report

说明准确率、精确率、召回率、F值分别代表的意义

答:准确率(正确率)=所有预测正确的样本/总的样本 , 即(TP+TN)/总

精确率= 将正类预测为正类 / 所有预测为正类 , 即TP/(TP+FP)

召回率 = 将正类预测为正类 / 所有正真的正类 , 即TP/(TP+FN)

F值 = 精确率 * 召回率 * 2 / ( 精确率 + 召回率) (F 值即为精确率和召回率的调和平均值)

6.比较与总结

如果用CountVectorizer进行文本特征生成,与TfidfVectorizer相比,效果如何?

答:CountVectorizer:只考虑词汇在文本中出现的频率

TfidfVectorizer:除了考量某词汇在文本出现的频率,还关注包含这个词汇的所有文本的数量,能够削减高频没有意义的词汇出现带来的影响, 挖掘更有意义的特征.

相比之下,文本条目越多,Tfid的效果会越显著

浙公网安备 33010602011771号

浙公网安备 33010602011771号