服务注册与发现是微服务架构中不可或缺的重要组件。

起初服务都是单节点的,不保障高可用性,也不考虑服务的压力承载,服务之间调用单纯的通过接口访问。直到后来出现了多个节点的分布式架构,起初的解决手段是在服务前端负载均衡,这样前端必须要知道所有后端服务的网络位置,并配置在配置文件中。

这里就会有几个问题:

- 如果需要调用后端服务A-N,就需要配置N个服务的网络位置,配置很麻烦

- 后端服务的网络位置变化,都需要改变每个调用者的配置

既然有这些问题,那么服务注册与发现就是解决这些问题的。

后端服务A-N可以把当前自己的网络位置注册到服务发现模块,服务发现就以K-V的方式记录下来, K一般是服务名, v就是IP: PORT

服务发现模块定时的进行健康检查,轮询查看这些后端服务能不能访问的了。前端在调用后端服务A-N的时候,就跑去服务发现模块问下它们的网络位置,然后再调用它们的服务。这样的方式就可以解决上面的问题了,前端完全不需要记录这些后端服务的网络位置,前端和后端完全解耦!

consul:

- consul是google开源的一个使用go语言开发的服务管理软件。支持多数据中心、分布式高可用的、服务发现和配置共享。

- 采用Raft算法,用来保证服务的高可用。

- 内置了服务注册与发现框架、分布一致性协议实现、健康检查、Key/Value存储、多数据中心方案,不再需要依赖其他工具(比如zookeeper等) 。

- 服务部署简单,只有一个可运行的二进制的包。

- 每个节点都需要运行agent,他有两种运行模式server和client。

- 每个数据中心官方建议需要3或5个server节点以保证数据安全,同时保证server-leader的选举能够正确的进行。

consul的的模式(client模式和sever模式):

- 在client模式下,所有注册到当前节点的服务会被转发到server节点,本身是不持久化这些信息。

- 在server模式下,功能和client模式相似,唯一不同的是,它会把所有的信息持久化到本地,这样遇到故障,信息是可以被保留的。

- server-leader是所有server节点的老大,它和其它server节点不同的是,它需要负责同步注册的信息给其它的server节点,同时也要负责各个节点的健康监测。

consul提供的一些关键特性:

- 服务注册与发现: consul通过DNS或者HTTP接口使服务注册和服务发现变的很容易,一些外部服务,例如saas提供的也可以一样注册。

- 健康检查: 健康检测使consu1可以快速的告警在集群中的操作。和服务发现的集成,可以防止服务转发到故障的服务上面。

- Key/Value存储:一个用来存储动态配置的系统。提供简单的HTTP接口,可以在任何地方操作。

- 多数据中心:无需复杂的配置,即可支持任意数量的区域。

安装consul是用于服务注册,也就是容器本身的一些信息注册到consul里面,其他程序可以通过consul获取注册的相关服务信息,这就是服务注册与发现。

Consul

[root@localhost ~]# mkdir -p /usr/local/consul [root@localhost ~]# unzip consul_1.11.3_linux_amd64.zip -d /usr/local/consul/ Archive: consul_1.11.3_linux_amd64.zip inflating: /usr/local/consul/consul

[root@localhost consul]# cp consul /usr/local/bin/

启动

[root@localhost consul]# consul agent -server -bootstrap -ui -data-dir=/var/lib/consul-data -bind=192.168.44.130 -client=0.0.0.0 -node=consul-server01 &> /var/log/consul.log & [1] 1793 [root@localhost consul]# ps -ef | grep consul root 1793 1711 4 17:26 pts/0 00:00:00 consul agent -server -bootstrap -ui -data-dir=/var/lib/consul-data -bind=192.168.44.130 -client=0.0.0.0 -node=consul-server01 root 1801 1711 0 17:26 pts/0 00:00:00 grep --color=auto consul

-server: 以server身份启动。默认是client。

-bootstrap :用来控制一个server是否在bootstrap模式,在一个数据中心中只能有一个server处于bootstrap模式,当一个server处于bootstrap模式时,可以自己选举为server-leader.

-bootstrap-expect=2 :集群要求的最少server数量,当低于这个数量,集群即失效。

-ui:指定开启UI界面,这样可以通过http://localhost:8500/ui这样的地址访问consul自带的web UI界面。

-data-dir:指定数据存储目录。

-bind :指定用来在集群内部的通讯地址,集群内的所有节点到此地址都必须是可达的,默认是0.0.0.0

-client :指定consul绑定在哪个client地址上,这个地址提供HTTP, DNS,RPC等服务,默认是127.0.0.1.

-node:节点在集群中的名称,在一个集群中必须是唯一的,默认是该节点的主机名。

-datacenter :指定数据中心名称,默认是dc1.

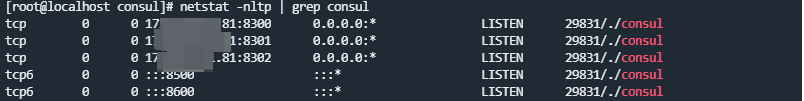

- 8300:集群内数据的读写和复制

- 8301:单个数据中心gossip协议通讯

- 8302:跨数据中心gossip协议通讯

- 8500:提供获取服务列表、注册服务、注销服务等HTTP接口;提供UI服务

- 8600:采用DNS协议提供服务发现功能

安装Gliderlabs/Registrator

Gliderlabs/Registrator可检查容器运行状态自动注册,还可以注销docker 容器的服务到服务配置中心。目前支持Consul,Etcd和SkyDNS2,

Registrator(原名Docksul)是一个为Docker而设计的服务注册项目,它监听跨主机运行的容器的启动和停止,检查并向Consul或者Etcd注册它们(容器)。

[root@host104 ~]# docker run -d \ --name=registrator \ --net=host \ -v /var/run/docker.sock:/tmp/docker.sock \ --restart=always \ gliderlabs/registrator:latest \ --ip=192.168.44.131 \ consul://192.168.44.130:8500

-net=host :把运行的docker容器设定为host网络模式。

-v /var/run/docker.sock:/tmp/docker.sock :把宿主机的Docker守护进程(Docker daemon)默认监听的Unix域套接字挂载到容器中。

--restart=always :设置在容器退出时总是重启容器。

--ip :刚才把network指定了host模式,所以我们指定ip为宿主机的ip。

consul :指定consul服务器的IP和端口

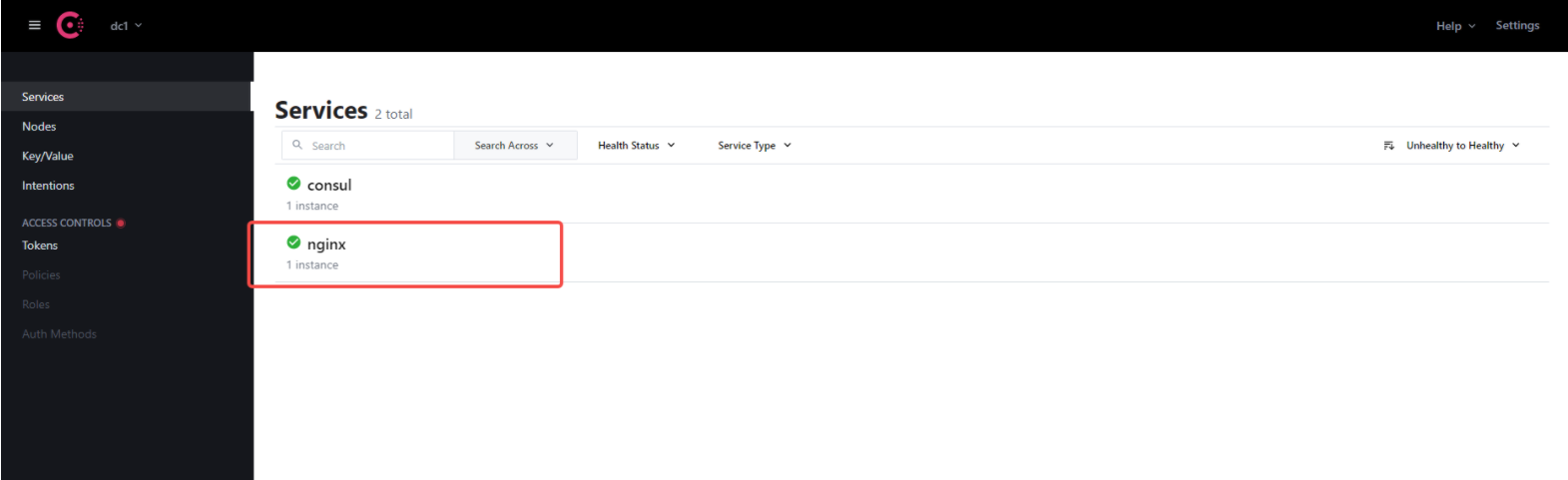

测试服务发现功能

#--name 指定容器名,-h指定容器主机名 [root@host104 ~]# docker run -itd -p:83:80 --name web-01 -h test01 nginx [root@host104 ~]# docker run -itd -p:84:80 --name web-02 -h test02 nginx [root@host104 ~]# docker run -itd -p:88:80 --name web-03 -h test03 httpd [root@host104 ~]# docker run -itd -p:89:80 --name web-04 -h test04 httpd

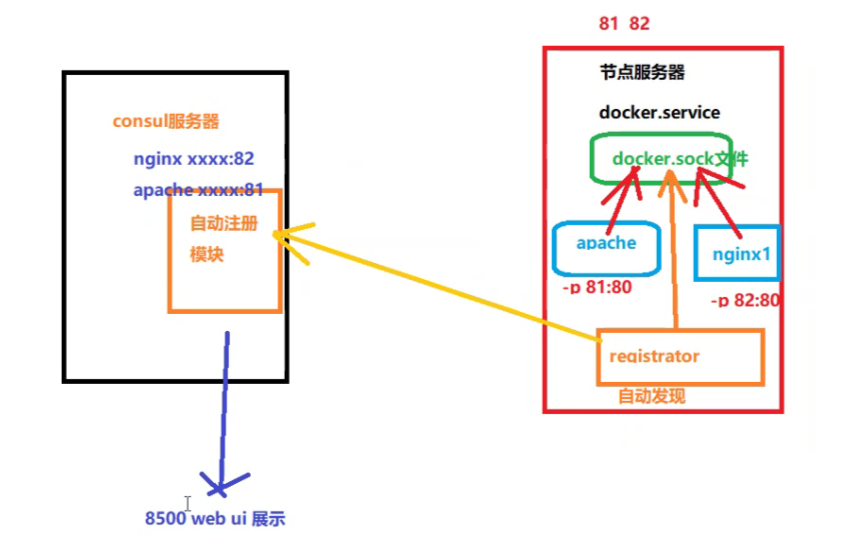

consul 为什么可以实现自动发现

被监控的节点服务器上,nginx容器的服务启动后,并做了端口映射后,会将映射的信息写入到宿主机的docker.sock文件

registrator自动发现模块会监控宿主机的docker.sock ,就会发现nginx服务。

registrator 会将信息写入到consul的自动注册模块,通过8500 web ui 展示

consul多节点

添加一台已有docker环境的服务器加入已有的群集中

[root@host105 opt]# ls consul_0.9.2_linux_amd64.zip consul_0.9.2_linux_amd64.zip [root@host105 opt]# unzip consul_0.9.2_linux_amd64.zip [root@host105 opt]# mv consul /usr/local/bin/ #将192.168.23.105/24加入已有的群集中 [root@host105 opt]# consul agent \ -server \ -ui \ -data-dir=/var/lib/consul-data \ -bind=192.168.23.105 \ -client=0.0.0.0 \ -node=consul-server02 \ -enable-script-checks=true \ -datacenter=dc1 \ -join 192.168.23.103 &> /var/log/consul.log &

-enable-script-checks=true :设置检查服务为可用

-datacenter : 数据中心名称

-join :加入到已有的集群中

-node: 指定节点名(节点名唯一,集群里不可以重复)

查看集群状态

[root@host105 opt]# consul members Node Address Status Type Build Protocol DC consul-server01 192.168.23.103:8301 alive server 0.9.2 2 dc1 consul-server02 192.168.23.105:8301 alive server 0.9.2 2 dc1 [root@host105 opt]# consul operator raft list-peers Node ID Address State Voter RaftProtocol consul-server01 192.168.23.103:8300 192.168.23.103:8300 leader true 2 consul-server02 192.168.23.105:8300 192.168.23.105:8300 follower true 2

浙公网安备 33010602011771号

浙公网安备 33010602011771号