(14)tensorflow神经网络基础

神经网络基础

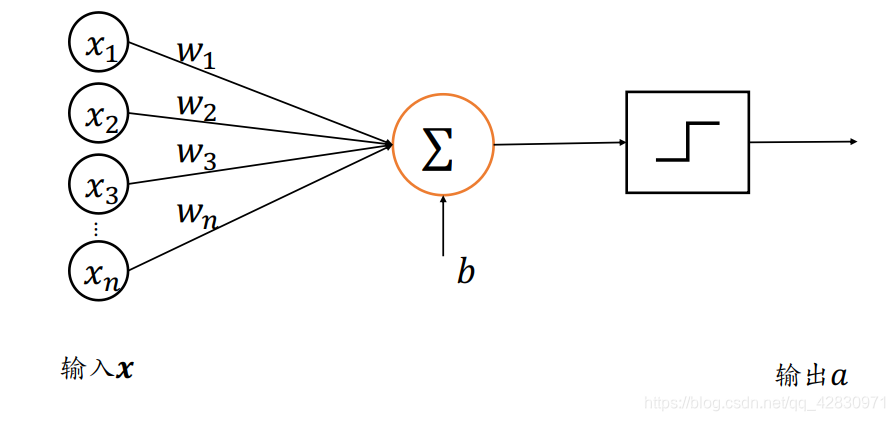

感知机

公式表达:

z

=

W

T

x

+

b

,

a

=

σ

(

z

)

=

σ

(

W

T

x

+

b

)

z= W^Tx + b , a = \sigma (z) = \sigma (W^Tx + b)

z=WTx+b,a=σ(z)=σ(WTx+b)

通过a与Y的误差调整W与b

**算法 1: 感知机训练算法

初始化参数𝒘 = 0, 𝑏 = 0

repeat

从训练集随机采样一个样本(𝒙𝑖, 𝑦𝑖)

计算感知机的输出a = sign(𝒘𝐓𝒙𝑖 + 𝑏)

如果a ≠ 𝑦𝑖:

𝒘′ ← 𝒘 + 𝜂 ∙ 𝑦𝑖 ∙ 𝒙𝒊

𝑏′ ← 𝑏 + 𝜂 ∙ 𝑦𝑖

until 训练次数达到要求

输出: 分类网络参数𝒘和𝑏**

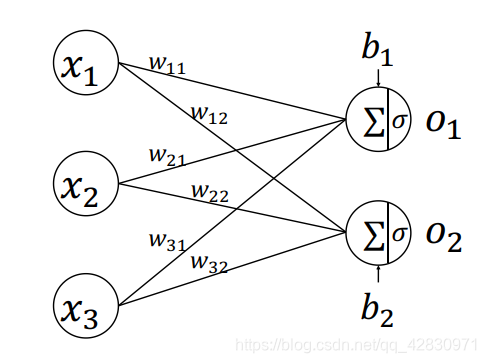

全连接层

𝑜1 = 𝜎(𝑤11 ∙ 𝑥1 + 𝑤21 ∙ 𝑥2 + 𝑤 1 ∙ 𝑥 + 𝑏1)

𝑜2 = 𝜎(𝑤12 ∙ 𝑥1 + 𝑤22 ∙ 𝑥2 + 𝑤 2 ∙ 𝑥 + 𝑏2)

即:

O=X@W+b

𝑶包含了𝑏个样本的输出特征

𝑾矩阵叫做全连接层的权值矩阵

𝒃向量叫做全连接层的偏置向量

浙公网安备 33010602011771号

浙公网安备 33010602011771号