第一次作业:深度学习基础

第一部分

心得体会

寇金娣:

通过视频学习,我对人工智能,深度学习,神经网络的概念有了浅层次的了解。人工智能是一个大的技术领域,深度学习和神经网络都是它的一个分支。深度学习技术的实现,涉及到各个领域,数学,计算机,生物学等等。在视频中,我看到了有许多模型,又涉及到很多数学知识,深度学习真的很有深度。我所掌握的知识都很基础,但是,计算机领域一直发展很迅速,要保持着终身学习的态度,才能掌握更多的知识。

李洁:

看完视频以后,对人工智能发展历史、涉及领域以及所用知识有了大概的了解。其实暑假期间,我学过一部分的视频了,当时因为讲到神经网络等的内容,涉及到很多函数,没看懂,就没继续学。果然应了一句话,之前欠下的都会补回来的。看了第二遍,对那些函数印象更深了,也懂了一些。但是总体来说,现在自己还是很迷糊,不知道人工智能到底需要掌握哪些知识,对于所使用的代码还不是特别懂。

慕洁:

目前中国的人工智能人才缺乏,中国拥有的人工智能企业数量占全世界的20%,但具有人工智能研究方向的高校不到全球的5.5%。

人工智能的定义:使一部机器像人一样进行感知、认知、决策、执行的人工程序或系统。

人工智能的三个层面:计算智能(能存能算)、感知智能(能听会说、能看会认)、认知智能(能理解会思考),我们现在的应用层面已经到了感知智能。

机器学习:学什么(数据、分析数据分布是否为有意义的模式等)、怎么学(问题建模→确定目标函数→求解模型参数)。

从概念的范围程度来说,人工智能>机器学习>深度理解,因为人工智能算是我们要实现的一个领域目标,机器学习只是实现人工智能的一类方法,而深度学习更是这一类方法中的一个点而已(神经网络中应用了深度学习)。

通过列举传统的知识工程与现在的机器学习之间的获取数据的必要条件和处理数据的方法,得到了机器学习从数据中自动提取知识、信息处理效率高、缺乏人的主观性以至于可信度高等一些优点,当然它的缺点也暴露了出来,由于缺乏人的主观性,所以产生的结果可能不易解释。

模型—数据标记层面:无监督学习模型可以从数据的分布中学习模式,用于描述数据;监督学习模型可以把数据标记分界面,用于预测数据标记。但在实际应用过程中,由于标记全部数据成本高,所以一般采用半监督学习模式:先标记一个数据判定分布,然后聚类假设&流形假设,这样就能推断出全部数据的分布。还有强化学习,数据标记未知,但知道与目标距离的奖励反馈。从而不断学习。

深度学习的三个推动剂:大数据、算法、计算力。

深度学习的不能:

1.算法输出不稳定,容易被攻击;

2.模型复杂度高,难以纠错和调试;

3.模型层级复合程度高,参数不透明;

4.端到端训练方式对数据依赖性强,模型增量性差;

5.专注直观感知类问题,对开放性推理问题无能为力;

6.人类知识无法有效进行监督,机器偏见难以避免。

以知识图谱为代表的符号主义(自上而下)和以深度学习为代表的连接主义(自下而上),逐渐走向协同发展的方向。

姚博涵:

通过绪论学习对于人工智能的三大层面,机器学习的内容及应用,知识工程与机器学习关系,人工智能、机器学习、深度学习之间关系也有清楚了解,以及对于深度学习的不能及相关研究也有了了解

通过第二节深度学习概述学习了激活函数,单多层感知器、万有逼近定理的内容,神经网络每层作用、梯度消失、受限玻尔兹曼机和自编码器也有所学习,内容好多

李晓庆

通过两节视频学习,自己首先对于机器学习、深度学习等有了大体上的系统了解。除此之外,还学习认识到了深度学习的“能”与“不能”,尽管深度学习尚还存有稳定性差、可调式性差、参数不透明、机器偏见等一系列问题,但它在现在的很多领域都是最领先且发挥着巨大作用的。而关于深度学习,从生物神经元,到多层感知器,以及万有逼近定理、梯度消失等,深度学习所包含的知识其实是十分庞大且深奥的,它是一个很大的课题,绝不是用一两天的功夫就能掌握的。关于两节课的视频学习,记了很多笔记,但毕竟是初次基础学习,对于很多概念性的定义、名词等只是书面化

王佳伟 整理了一些学习笔记在个人博客

神经网络的出现是为了解决一系列问题的,用最简单的说法描述就是“找规律问题”。人可以根据趋势找规律,但是计算机视角是一堆散点,只能先随便画一条线计算一下样本点和直线上的点的距离,看看误差大不大。发现有误差就一点一点的旋转及平移,直到误差为0或者低于一个很小的数时,计算机就认为“找到规律”了,便写出表达式并预测下一个数。这个问题实质是回归问题,计算机在做的就是曲线拟合,即用一根曲线描述这些点的分布。而这种平移旋转的方法为著名的梯度下降法,特点是在缓慢旋转的过程中,当误差越来越小时,旋转或移动的量也跟着逐渐变小,当误差小于某个很小的数就收敛。具体为在直线拟合中,计算机首先创建直线,然后不断修改的值,直到误差小于某个很小的数。但生活中的往往是由很多变量组成的。这些变量可以说是叫“特征”,像之前的曲线方程的多个变量也可以叫特征值。

神经网络的模型和人体的神经网络是比较类似的。 这时一个比较重要的概念是激活函数,比如常用的Sigmoid,还有一个概念是是网络结构,典型的三层网络包括输入层,隐藏层,输出层。初始特征值,偏移值,权重值,激活函数最终得到输出等。BP算法包括信号的正向传播和误差的反向传播两个过程。

学习告一段落,学理论的感受就是学完好像没讲什么, 不像学编程语言学完可以马上写一个简单程序,这只是加深我们对一些概念的理解,还需要各种知识储备作为基础,还要不断地学习其他的知识。

问题

1.深度学习解释性的第一个层次“看得懂”,如何判别哪些是重要特征?这是否仍需要专家系统?(寇金娣)

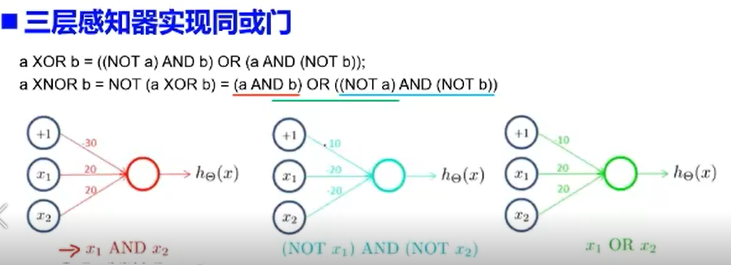

2.对于这张图片中的-30,20,20等不知道是怎么来的,没看明白。(李洁)

3.关于机器学习模型的其他两个层面(数据分布和建模对象),“深度学习的不能3和4“;符号主义和连接主义这几个概念还是没有理解(慕洁)

4.大概知道了激活函数的定义,但是对于那么多函数模型的使用途径没搞明白,以及感知器。(慕洁)

5.梯度消失和预训练的实际作用不太明白(姚博涵)

6.梯度和梯度下降部分,神经网络的参数学习,误差反向传播没有明白,它们又该如何应用?(李晓庆)

第二部分

附:截图较多的同学以博文链接形式展示

姚博涵

王佳伟

李洁

李晓庆

寇金娣

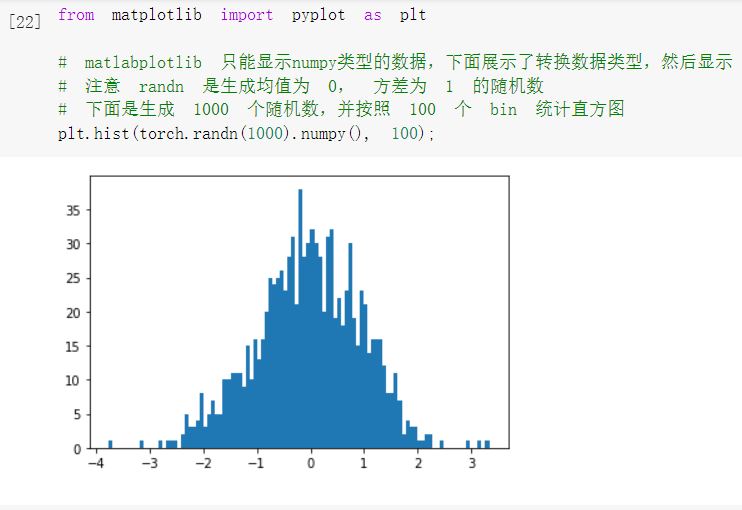

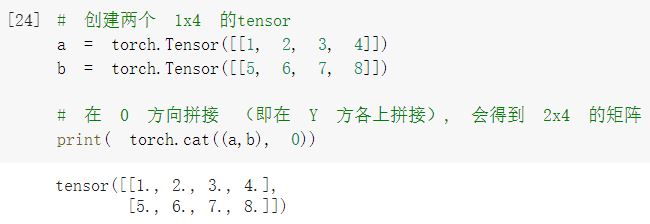

1.

2.

3.

这里出现编译错误:valueerror (most recent call last)值错误回溯(最近一次调用)

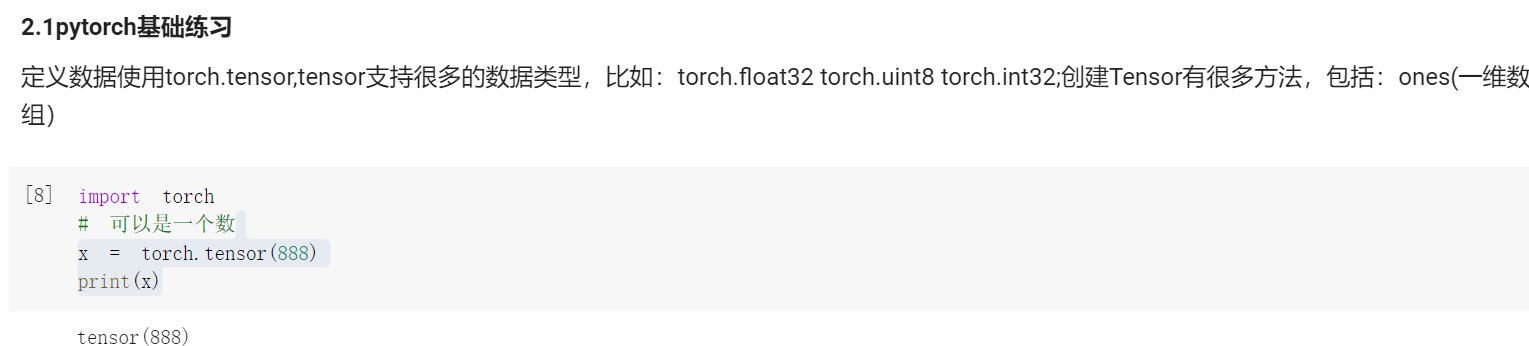

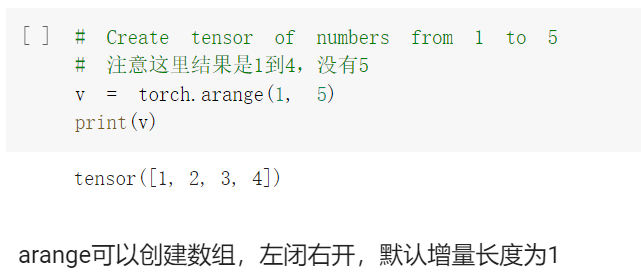

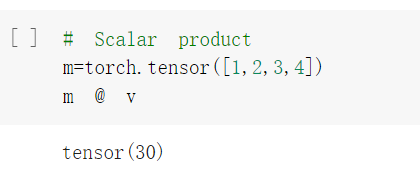

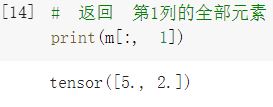

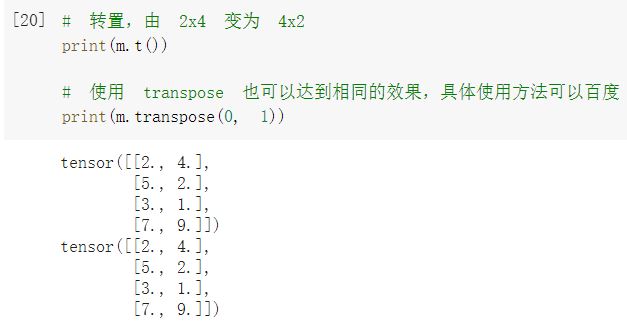

@一个用法是表引用,一个是表矩阵乘法。@可以用来作两个数组数据个数相同的乘法。我自己重新给m变量赋值,运行出结果。后来,在小组成员的帮助下,知道是v的类型不对,改为float可以运行

4.

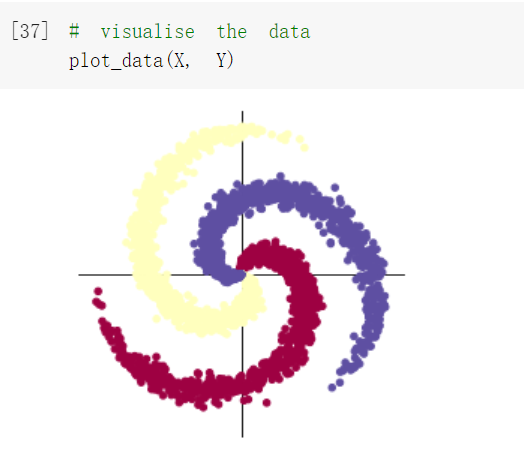

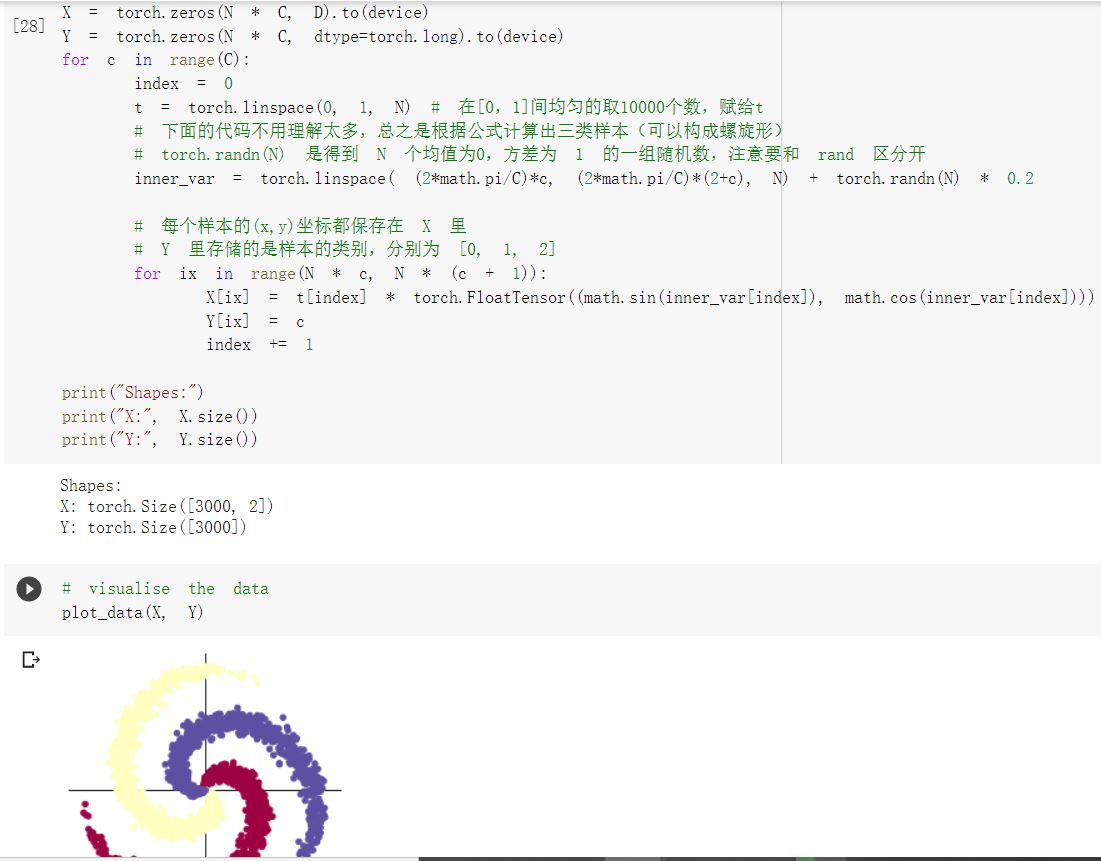

这张图给了我很震撼的感觉,引起我对深度学习的好奇。

慕洁

1.

2.

3.

4.

5.

6.

7.

浙公网安备 33010602011771号

浙公网安备 33010602011771号