hadoop视频学习---2

-----------------------------------------------------------------------------------------------------------------------------------------------------------------------

这个是特殊用法

-----------------------------------------------------------------------------------------------------------------------------------------------------------------------

创建密钥对。因为要连接集群,免密码

1.前提要配置这个(就是要远程连接机添加到这个配置文件里)

2.将公钥加到远程机授权列表中

另外可以给自己系统授权,以后不用总输入密码。(下图对远程机授权可加深理解)

0.

sudo vim /etc/hosts

//将别的主机添加到自己的目录里

1.

ssh-keygen -t rsa

//生成密钥

2.

scp id_rsa.pub weekend07:/home/hadoop

//将自己主机生成的密钥发送到另一台主机(weekend07)上

3.

cat ../id_rsa.pub >> ./authorized_keys

//将对方的公钥加到自己的主机里,但上面写的要和图片一起看,注意文件位置。

4.

ll -a //查看隐藏文件 5. touch authorized_keys

//创建文件 6. chmod 600 authorized_key

//给这个文件授权

7.

cat id_rsa.pub >> authorized_keys

//自己给自己授权,以后操作自己免密码执行

8.

cat authorized_keys

//查看自己的密钥列表都有谁

hadoop2.2.0伪分布式搭建(hadoop视频学习---1下面也有一个类似的这个)

1.准备Linux环境

1.0点击VMware快捷方式,右键打开文件所在位置 -> 双击vmnetcfg.exe -> VMnet1 host-only ->修改subnet ip 设置网段:192.168.1.0 子网掩码:255.255.255.0 -> apply -> ok

回到windows --> 打开网络和共享中心 -> 更改适配器设置 -> 右键VMnet1 -> 属性 -> 双击IPv4 -> 设置windows的IP:192.168.1.110 子网掩码:255.255.255.0 -> 点击确定

在虚拟软件上 --My Computer -> 选中虚拟机 -> 右键 -> settings -> network adapter -> host only -> ok

####让普通用户具备sudo执行权限

切换到root

然后 vi /ect/sudoers #加入一行

root ALL=(ALL) ALL

hadoop ALL=(ALL) ALL

1.1修改主机名

sudo vim /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=weekend110 ###

1.1.2主机名没有生效

sudo hostname weekend110

exit #重新登录

1.2修改IP(大多数情况下用窗口设置,不用下面的命令行)

两种方式:

第一种:通过Linux图形界面进行修改(强烈推荐)

进入Linux图形界面 -> 右键点击右上方的两个小电脑 -> 点击Edit connections -> 选中当前网络System eth0 -> 点击edit按钮 -> 选择IPv4 -> method选择为manual -> 点击add按钮 -> 添加IP:192.168.1.119 子网掩码:255.255.255.0 网关:192.168.1.1 -> apply

第二种:修改配置文件方式(屌丝程序猿专用)

vim /etc/sysconfig/network-scripts/ifcfg-eth0

DEVICE="eth0"

BOOTPROTO="static" ###

HWADDR="00:0C:29:3C:BF:E7"

IPV6INIT="yes"

NM_CONTROLLED="yes"

ONBOOT="yes"

TYPE="Ethernet"

UUID="ce22eeca-ecde-4536-8cc2-ef0dc36d4a8c"

IPADDR="192.168.1.44" ###

NETMASK="255.255.255.0" ###

GATEWAY="192.168.1.1" ###

1.3修改主机名和IP的映射关系

vim /etc/hosts

192.168.1.170 weekend00

192.168.1.171 weekend01

192.168.1.172 weekend02

192.168.1.173 weekend03

192.168.1.174 weekend04

192.168.1.175 weekend05

*linux7 永久修改 hostnamectl set-hostname xxx

1.4关闭防火墙

#查看防火墙状态

service iptables status

#关闭防火墙

service iptables stop

#查看防火墙开机启动状态

chkconfig iptables --list

#关闭防火墙开机启动

chkconfig iptables off

1.5重启Linux

reboot

2.安装JDK

2.1上传

2.2解压jdk

#创建文件夹

mkdir /usr/java

#解压

tar -zxvf jdk-7u55-linux-i586.tar.gz -C /usr/java/

2.3将java添加到环境变量中

vim /etc/profile

#在文件最后添加

export JAVA_HOME=/usr/java/jdk1.7.0_55

export PATH=$PATH:$JAVA_HOME/bin

#刷新配置

source /etc/profile

3.安装Hadoop

3.1上传hadoop安装包

3.2解压hadoop安装包

mkdir /cloud

#解压到/cloud/目录下

tar -zxvf hadoop-2.2.0.tar.gz -C /cloud/

3.3修改配置文件(5个)

第一个:hadoop-env.sh

#在27行修改

export JAVA_HOME=/usr/java/jdk1.7.0_55

第二个:core-site.xml

<configuration>

<!-- 指定HDFS老大(namenode)的通信地址 -->

<property>

<name>fs.defaultFS</name>

<!--下面指点主机名 -->

<value>hdfs://weekend110:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储路径 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/cloud/hadoop-2.2.0/tmp</value>

</property>

</configuration>

第三个:hdfs-site.xml

<configuration>

<!-- 设置hdfs副本数量 -->

<property>

<name>dfs.replication</name>

<!--3个比较合适。但本机就一个-->

<value>1</value>

</property>

</configuration>

第四个:mapred-site.xml.template 需要重命名: mv mapred-site.xml.template mapred-site.xml

<configuration>

<!-- 通知框架MR使用YARN -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

第五个:yarn-site.xml

<configuration>

<!-- reducer取数据的方式是mapreduce_shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

3.4将hadoop添加到环境变量

vim /etc/profile

export JAVA_HOME=/usr/java/jdk1.7.0_55

export HADOOP_HOME=/cloud/hadoop-2.2.0

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin

source /etc/profile

3.5格式化HDFS(namenode)第一次使用时要格式化

hadoop namenode -format

3.6启动hadoop

先启动HDFS

sbin/start-dfs.sh

再启动YARN

sbin/start-yarn.sh

3.7验证是否启动成功

使用jps命令验证

27408 NameNode

28218 Jps

27643 SecondaryNameNode

28066 NodeManager

27803 ResourceManager

27512 DataNode

http://192.168.1.44:50070 (HDFS管理界面)

在这个文件中添加linux主机名和IP的映射关系

C:\Windows\System32\drivers\etc\hosts

192.168.1.119 itcast

http://192.168.1.44:8088 (MR管理界面)

4.配置ssh免登陆

生成ssh免登陆密钥

cd ~,进入到我的home目录

cd .ssh/

ssh-keygen -t rsa (四个回车)

执行完这个命令后,会生成两个文件id_rsa(私钥)、id_rsa.pub(公钥)

将公钥拷贝到要免登陆的机器上

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

或

ssh-copy-id -i localhost

linux细节方面,重要

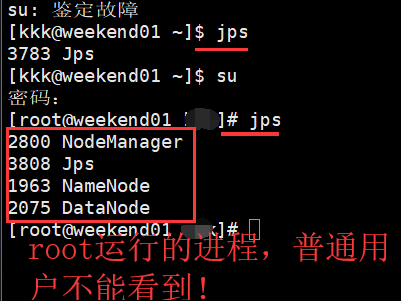

1)linux的root用户运行的进程,普通用户看不到。

2)linux建密钥时应该统一在/root目录下生成。这个需要特别注意。因为有时候linux会进入用户目录,例如:/root/xxx

3)普通用户设置的密钥只适合使用普通用户。一般学习或测试用root,在根目录生成密钥,并分发集群中。

--------上面是自己实际经验,特别有用!

---------------------------------------遇到的问题--------------------------------------------------

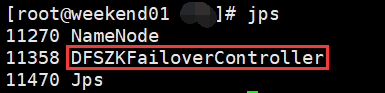

当集群都为standby 时。需要有zookeeper的DFSZKFailoverController这个进程。

出现这种情况之一是因为没有启动下面的

先启动HDFS

sbin/start-dfs.sh

----------------------------------------

./hadoop-daemon.sh start namenode

./hadoop-daemon.sh start secondarynamenode

./hadoop-daemon.sh start jobtracker

./hadoop-daemon.sh start datanode

./hadoop-daemon.sh start tasktracker

还有一种手动启动DFSZKFailoverController

./hadoop-daemon.sh start DFSZK\

启动单个进程

/hadoop/sbin/hadoop-daemon.sh start namenode

/hadoop/sbin/hadoop-daemon.sh start journalnode

/hadoop/sbin/hadoop-daemon.sh start datanode

/hadoop/sbin/hadoop-daemon.sh start zkfc

如果要停止可以运行如下命令

./hadoop-daemon.sh stop namenode

./hadoop-daemon.sh stop secondarynamenode

./hadoop-daemon.sh stop jobtracker

./hadoop-daemon.sh stop datanode

./hadoop-daemon.sh stop tasktracker

启动ResourceManager进程

/hadoop/sbin/yarn-daemon.sh start resourcemanager

/hadoop/sbin/yarn-daemon.sh stop resourcemanager

注意:启动和停止单个hdfs相关的进程使用的是"hadoop-daemon.sh"脚本,而启动和停止yarn使用的是"yarn-daemon.sh"脚本。

浙公网安备 33010602011771号

浙公网安备 33010602011771号