『NAS』老破小也能玩 AI?飞牛 NAS 部署 LocalAI

点赞 + 关注 + 收藏 = 学会了

💡整理了一个 NAS 专属玩法专栏,感兴趣的工友可以戳这里关注 👉 《NAS邪修》

LocalAI 是一个开源的"AI壳",它能让你在自己的硬件上(比如 NAS)离线运行各种大模型(LLM)、生成图片或语音,并提供与 OpenAI 兼容的 API 接口。

在开始折腾前,请确保你的 NAS 具备“留学上网”能力,否则下载模型会让你怀疑人生。

这次我用飞牛 NAS (fnOS) 进行演示,其他品牌 NAS(如群晖、威联通)逻辑通用。

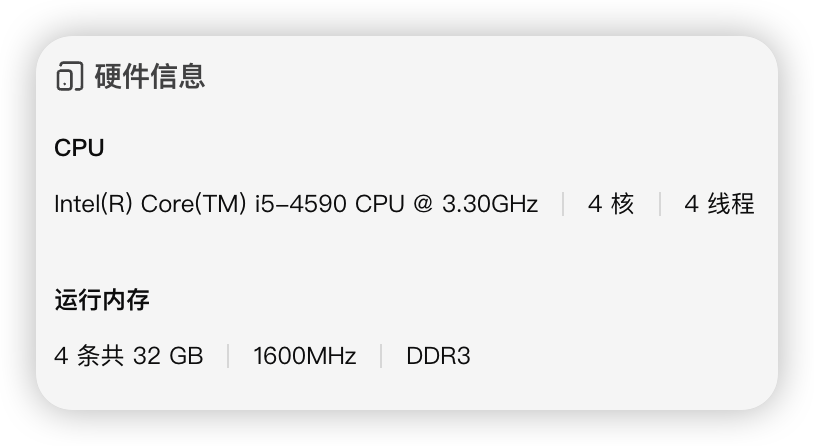

我用老爷机装了 fnOS,想顺便测测这台老爷机能不能跑得动小模型。

先开动。

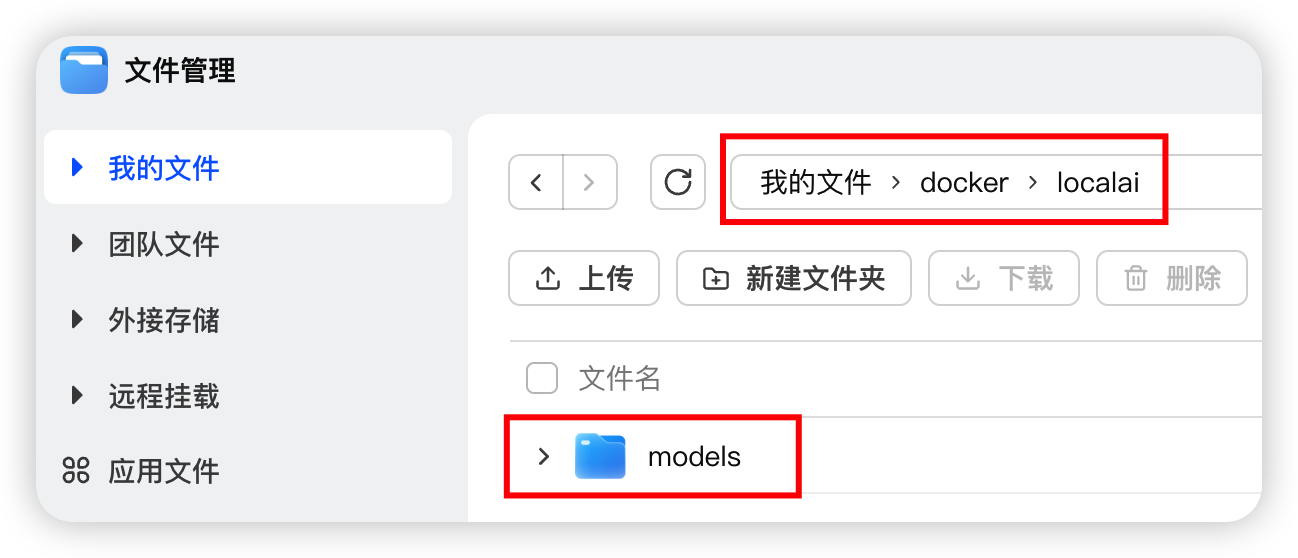

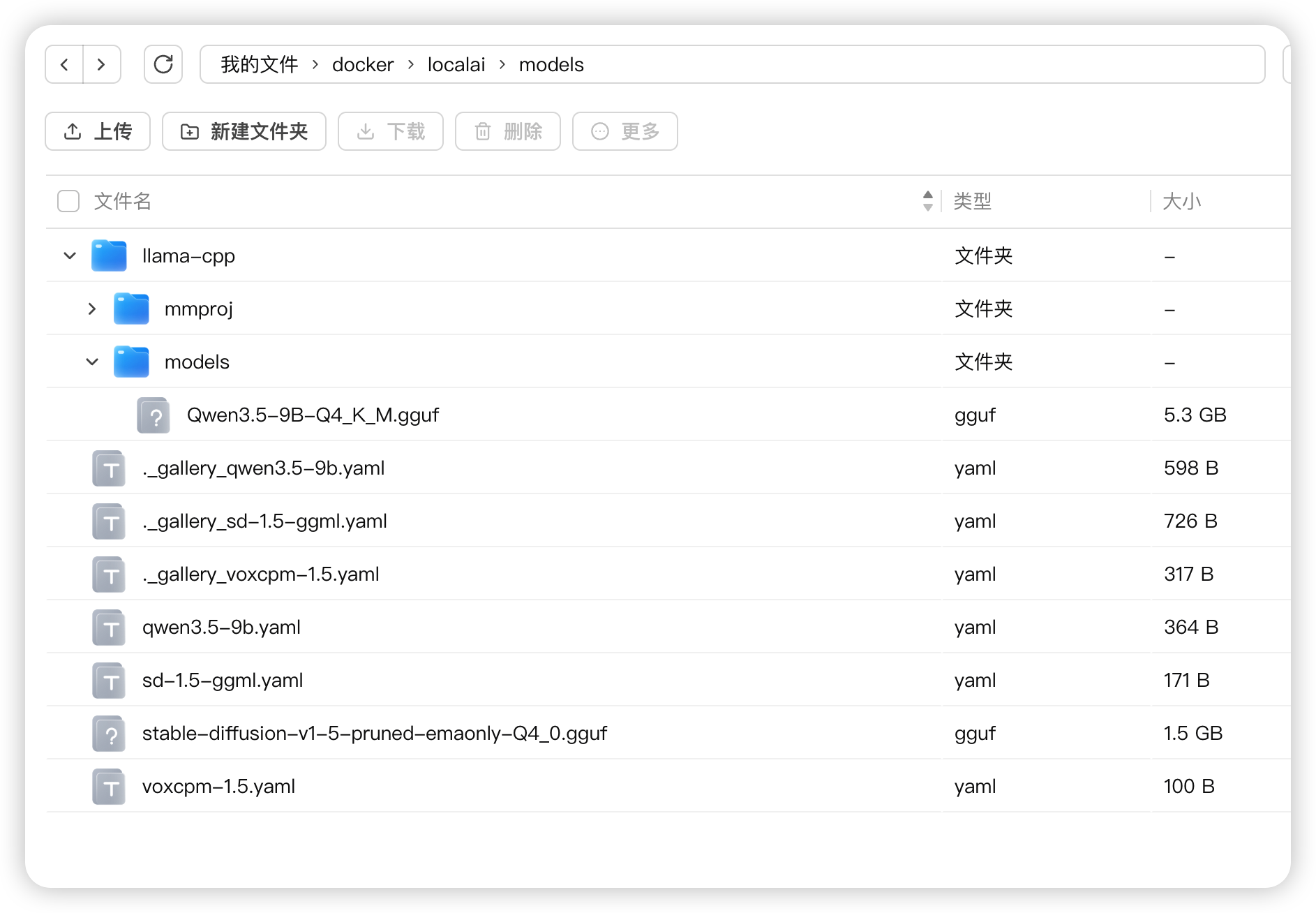

打开「文件管理」应用,找到 docker 文件夹,在里面创建一个 localai 文件夹,然后在 localai 里再创建一个 models 文件夹,之后下载的模型都是存放在这个位置的。

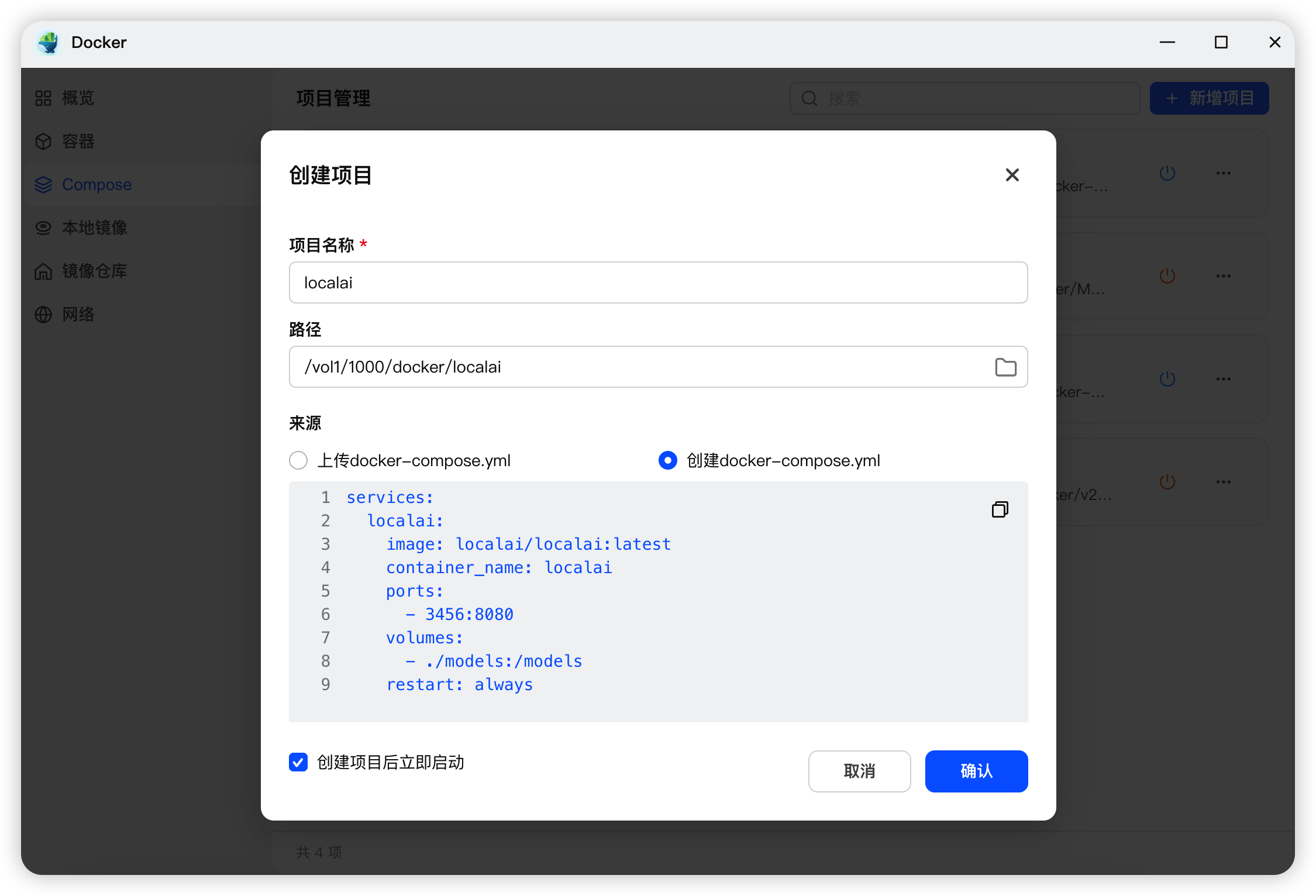

打开「Docker」应用,切换到 Compose 面板,新增一个项目。

- 项目名称:

localai - 路径:选择刚刚在「文件管理」应用里创建的

/docker/localai - 来源:创建 docker-compose.yml

输入以下代码:

services:

localai:

image: localai/localai:latest

container_name: localai

ports:

- 3456:8080 # 3456 可自定义映射端口

volumes:

- ./models:/models # 映射模型存放路径

restart: always

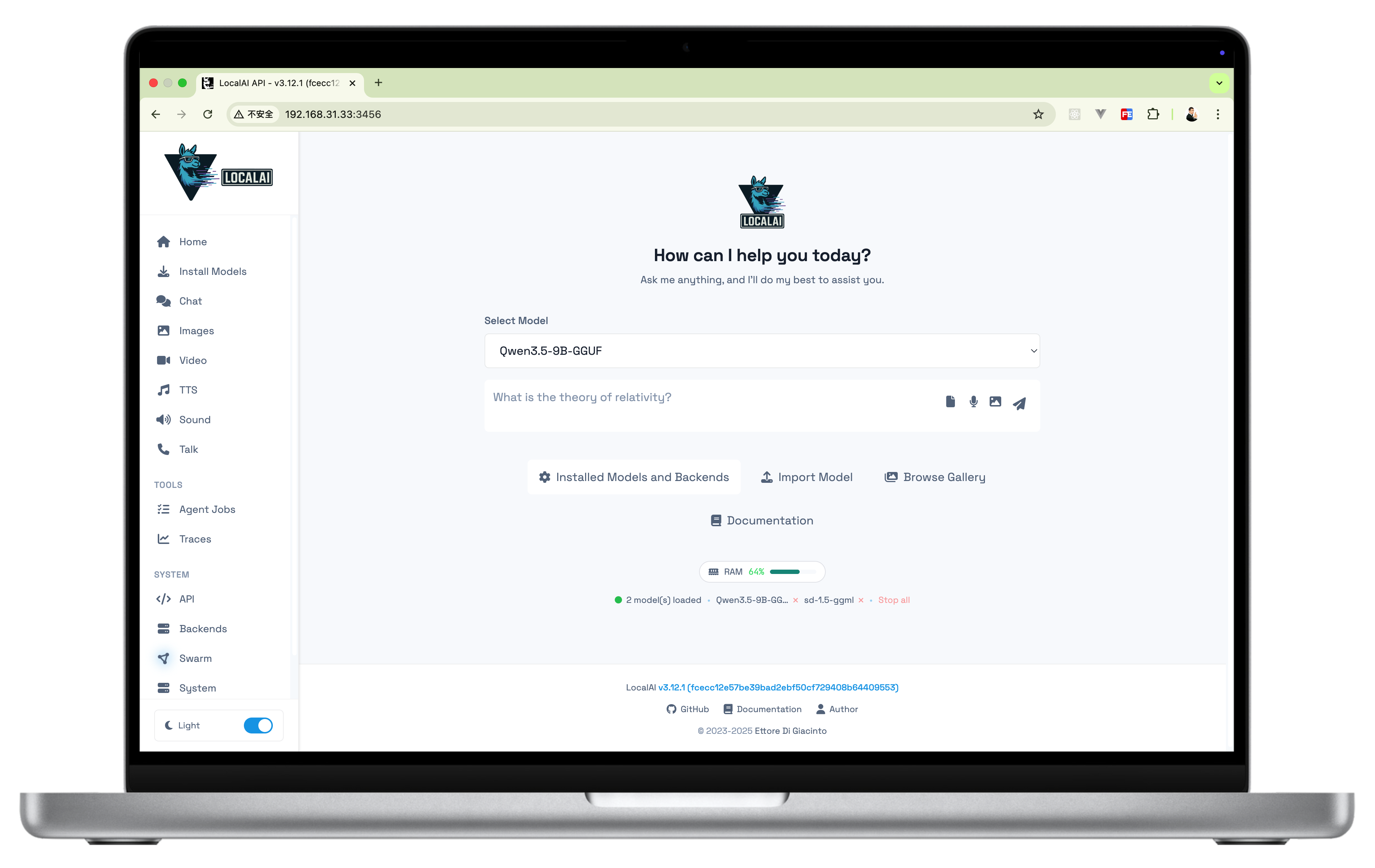

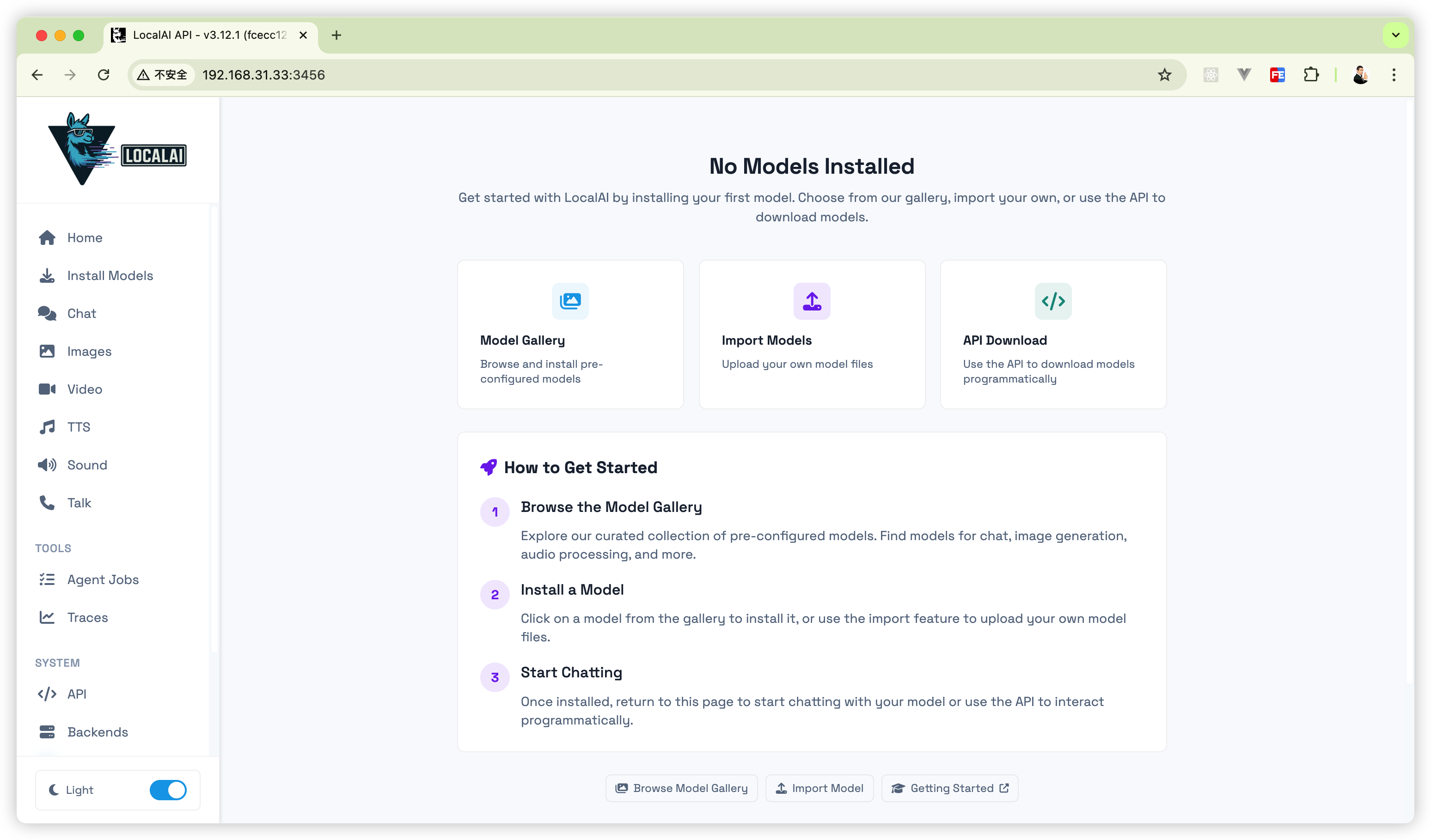

等项目构建成功后,在浏览器访问 NAS_IP:3456 就可以打开 LocalAI 了。

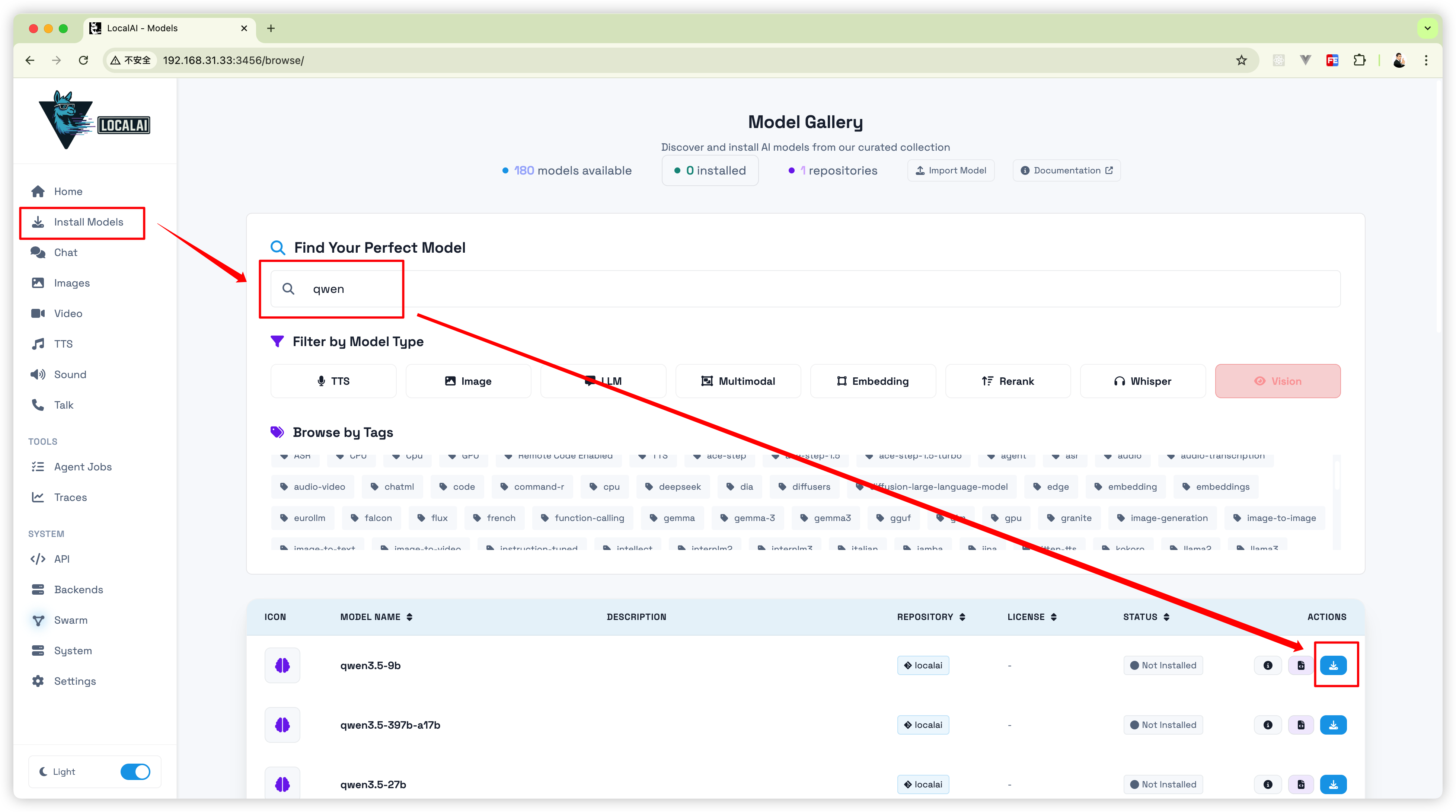

第一次使用需要下载模型,点击左侧菜单的“Install Models”,然后搜索你想下载的模型,我用千问举例。

搜索 qwen,然后选一个小尺寸的模型(我选了9b,参数量太大的模型我这台老爷机跑不动)点击下载。

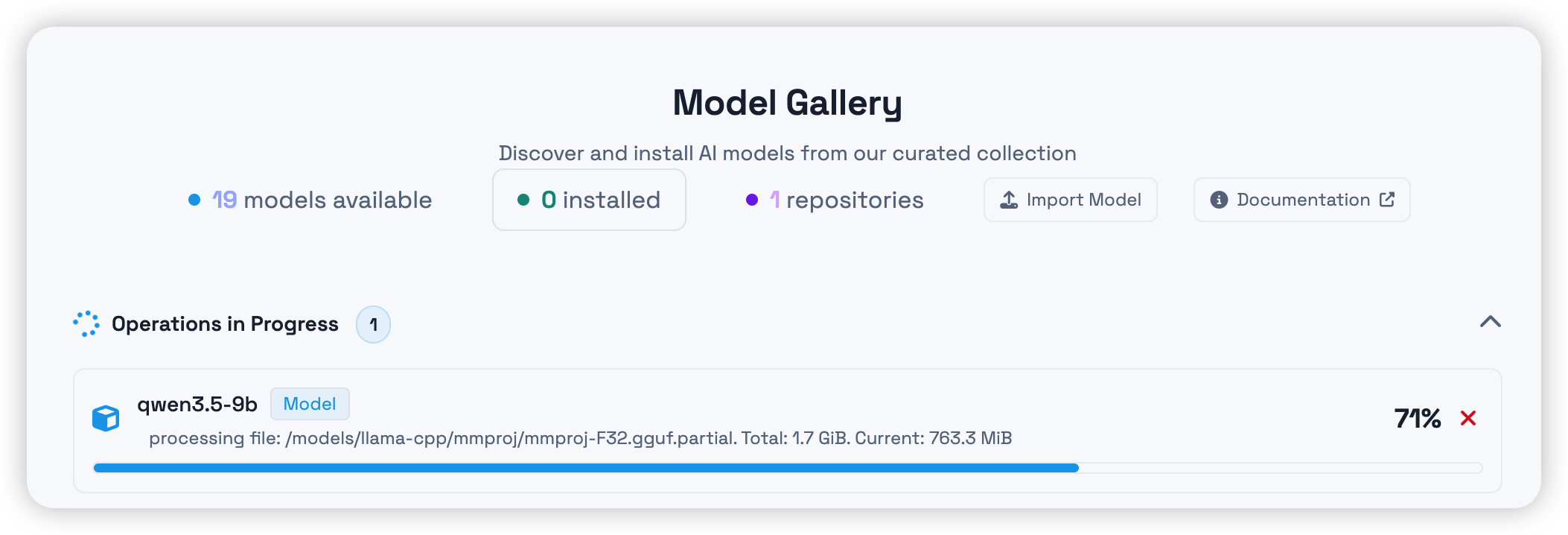

在页面头部可以看到模型下载的进度。

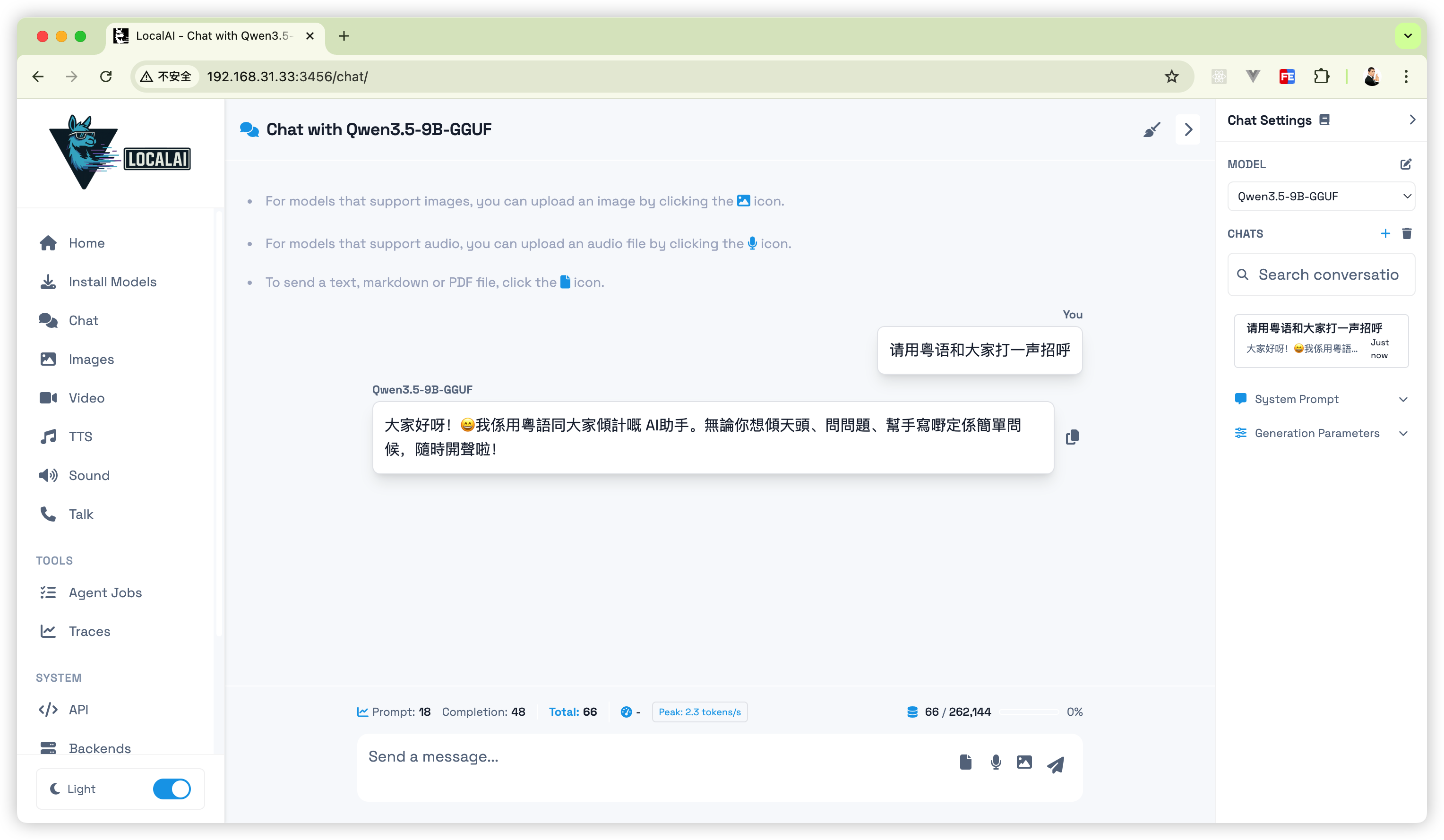

下载完模型后,回到首页(Home)或者聊天页(Chat)就可以开始聊天了。

我的老爷机跑9b模型,每秒吐2.3token出来,有点慢

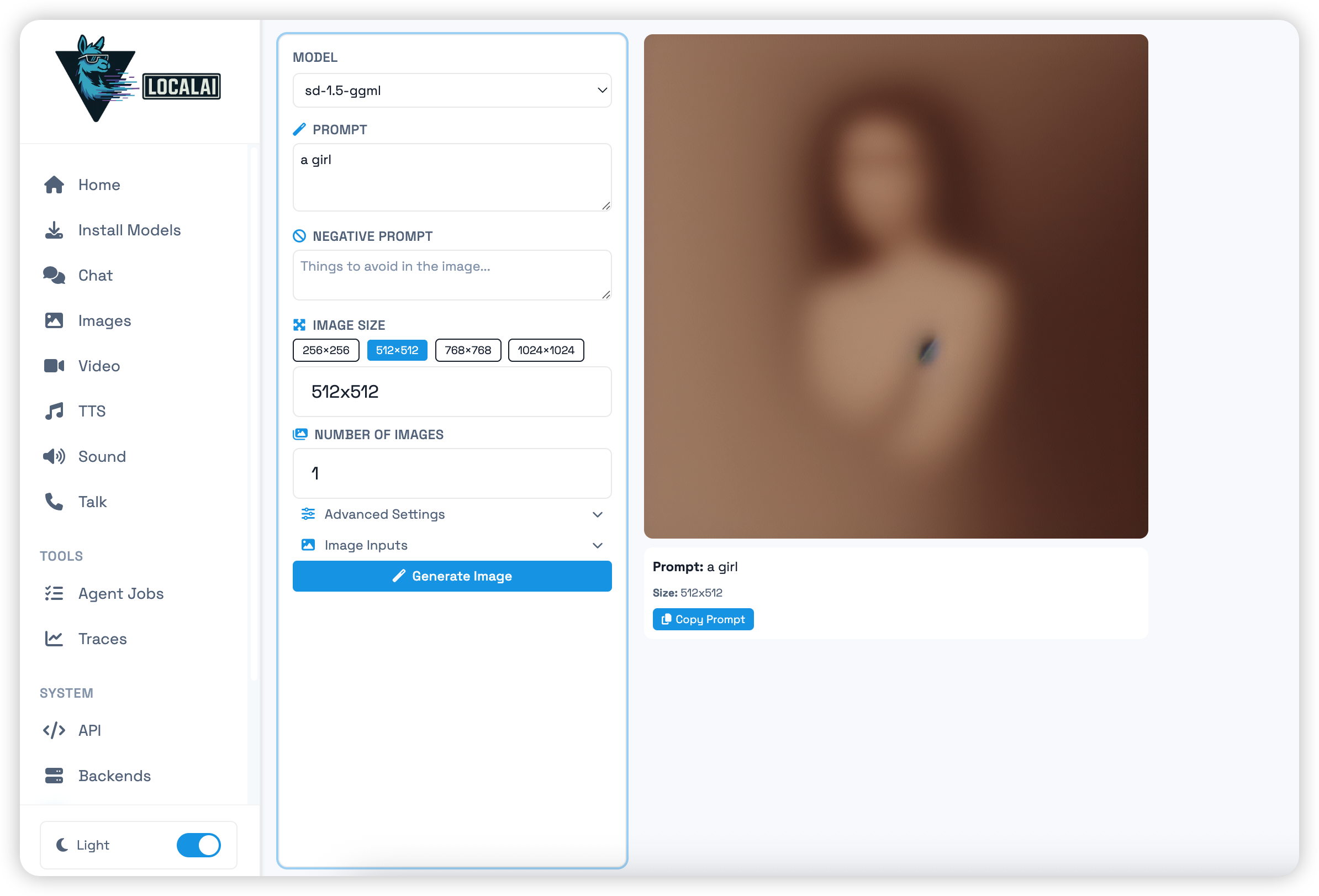

除了聊天之外,LocalAI还支持文生图、文生视频、文本转语音等功能,但都需要大模型支持。

比如文生图,我用 sd-1.5 这个老模型也能抽卡。

回到 /docker/localai/models 目录,可以看到我刚刚下载的 qwen 和 sd-1.5 这两个模型都在里面。

以上就是本文的全部内容啦,你有好玩的镜像推荐吗?欢迎在评论区留言讨论!

想了解更多NAS玩法记得关注《NAS邪修》👏

往期推荐:

- 『NAS』不止娱乐,NAS也是生产力,在绿联部署AI工作流工具-n8n

- 『NAS』在绿联部署DeepSeek,接入n8n工作流-ollama

- 『NAS』绿联NAS + AI Plugins,每天白嫖美团 5500万 Token 大模型!

点赞 + 关注 + 收藏 = 学会了

浙公网安备 33010602011771号

浙公网安备 33010602011771号