降AI工具价格差这么大,便宜的和贵的到底差在哪?

降AI工具价格差这么大,便宜的和贵的到底差在哪?

2块到8块一千字,价格差了4倍。

我第一次选降AI工具的时候也纳闷:这玩意不就是改改文字吗,凭什么有的卖2块有的卖8块?后来我花了差不多400块把市面上能找到的降AI工具都试了一遍,终于搞明白了价格差距背后的逻辑。

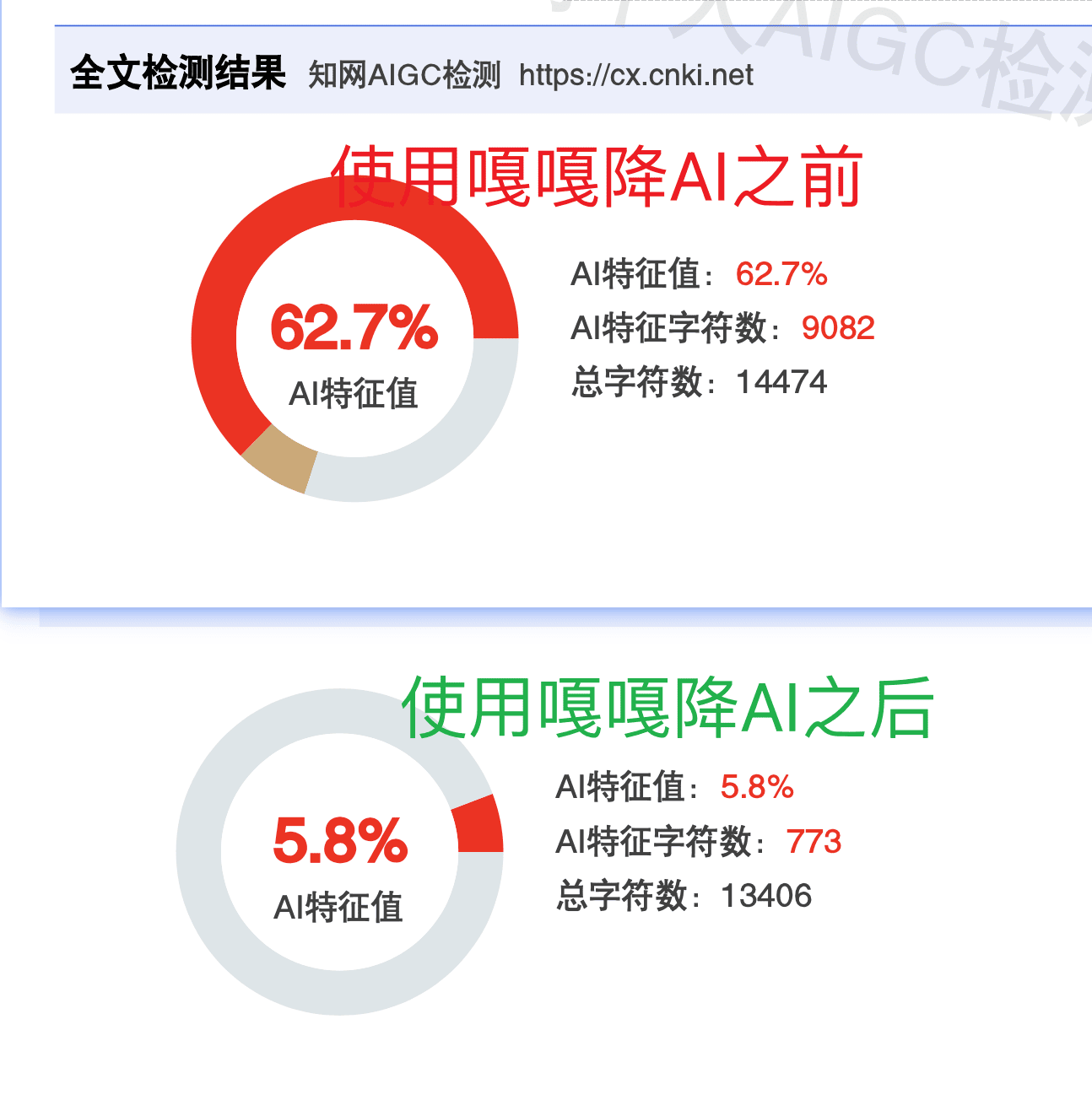

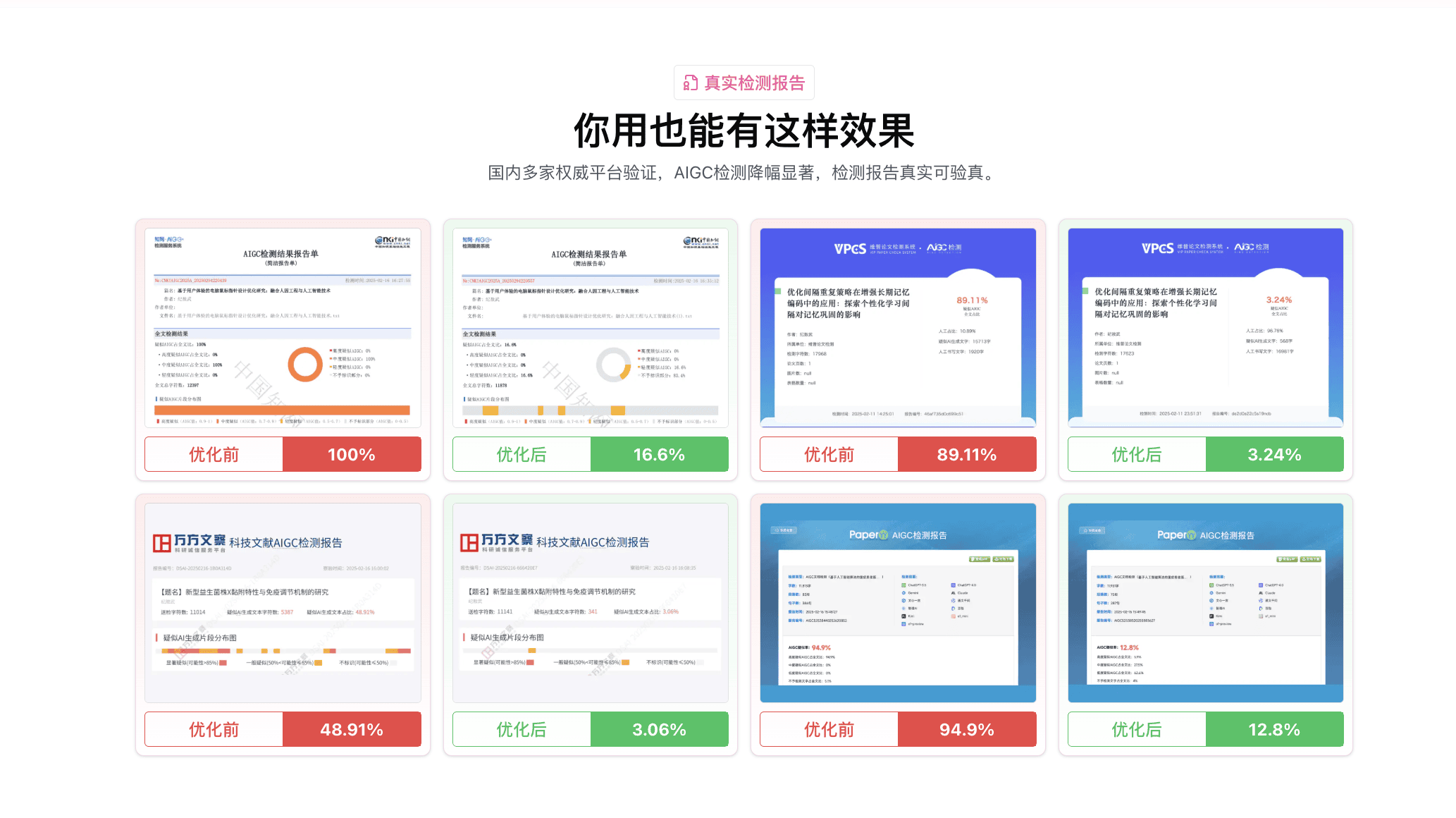

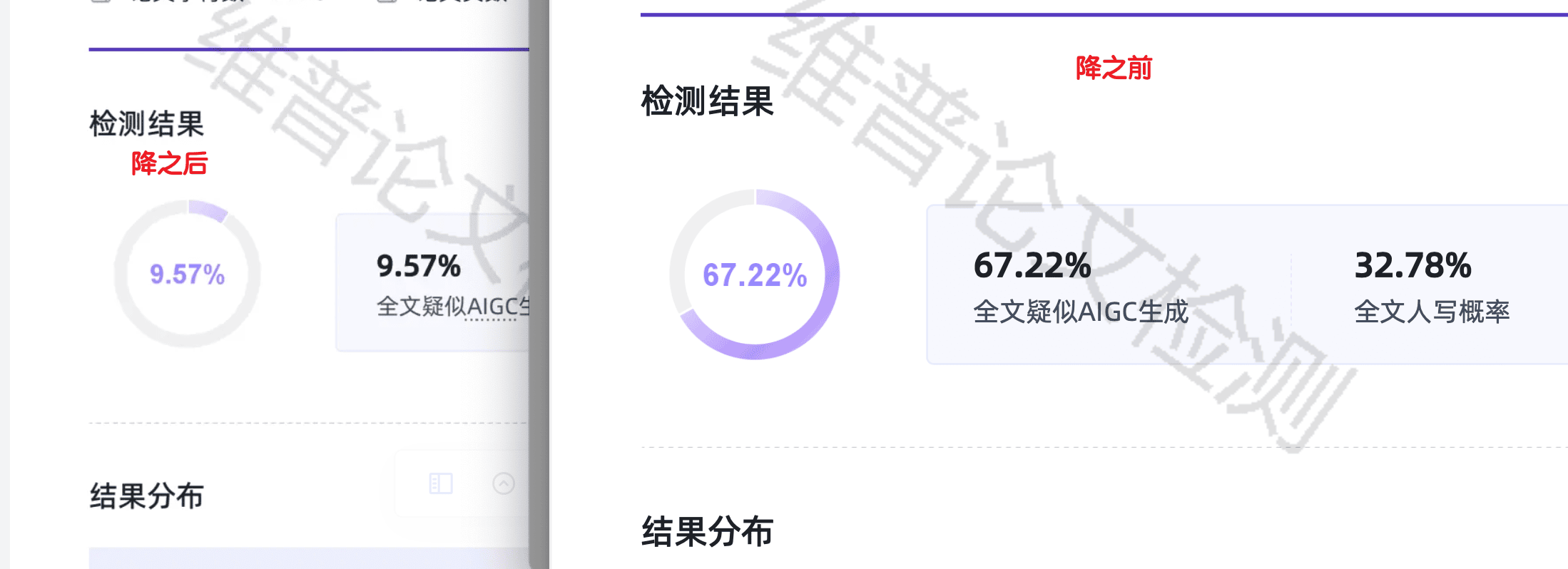

先说结论:贵的不一定最好,但最便宜的大概率有坑。性价比最高的是嘎嘎降AI(www.aigcleaner.com),4.8元/千字,效果和8块钱的工具差不多。下面详细拆解一下价格差到底差在哪。

价格差异的三个核心因素

因素一:技术引擎不同

这是价格差异最大的来源。便宜的工具基本都是"同义词替换",就是把"但是"换成"然而",把"因此"换成"所以"。这种方法成本低,但效果也差。稍微高级一点的检测系统就能识别出来。

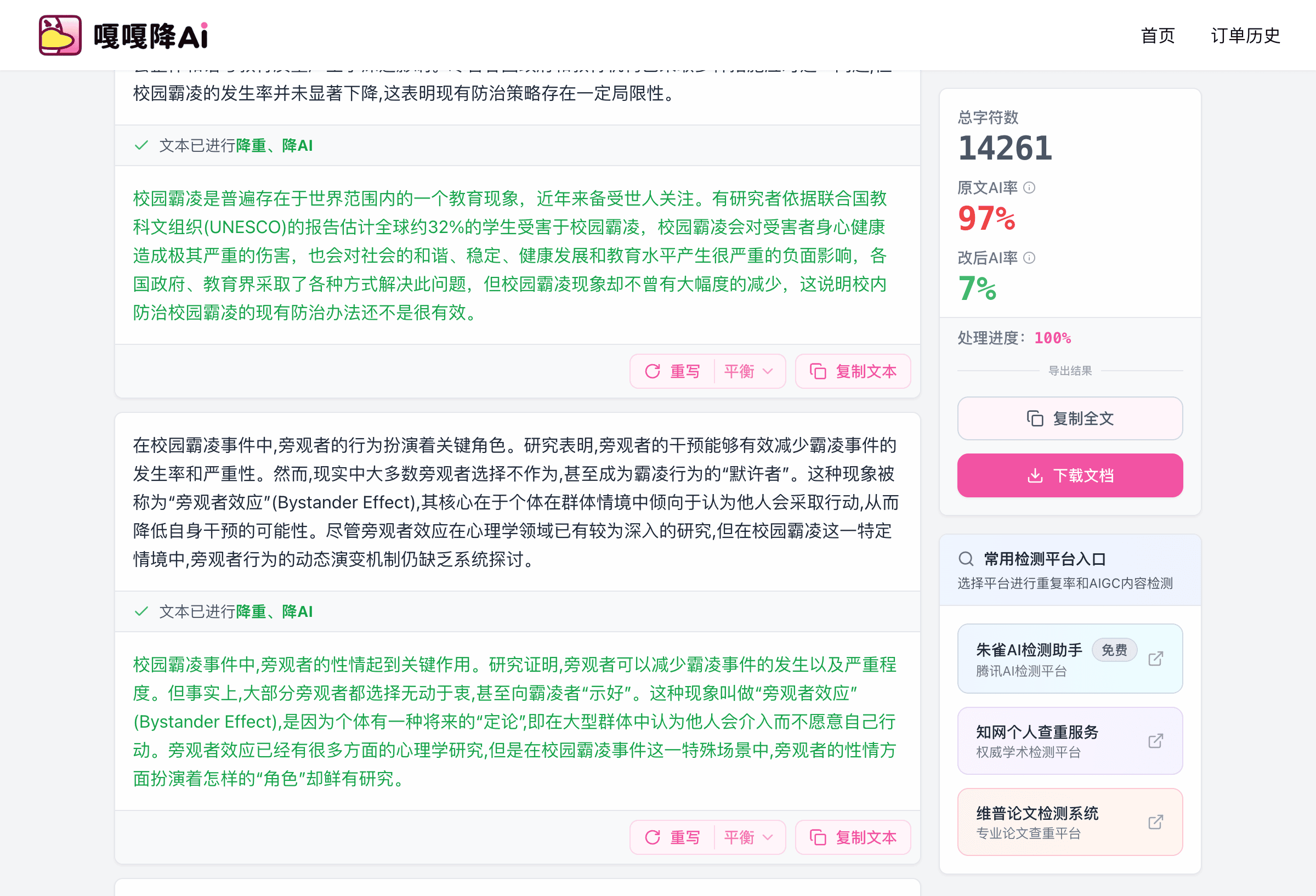

贵一些的工具用的是语义重构技术。比如嘎嘎降AI的双引擎驱动,它结合了语义同位素分析和风格迁移网络,不光改词,还改句式结构和表达逻辑。比话降AI(www.bihuapass.com)用的是自研Pallas引擎,原理类似但针对知网做了专门优化。

简单说:便宜的改表面,贵的改结构。

因素二:平台兼容性

有些工具只能对付一两个检测平台,有些能覆盖全平台。嘎嘎降AI支持9大平台(知网、维普、万方、Turnitin等),比话降AI主要针对知网。覆盖平台越多,技术投入越大,价格自然越高。

如果你只需要过知网,其实不一定要买全平台覆盖的。但如果你不确定导师会用哪个系统查,买个全平台的更保险。

因素三:售后保障

这个差距很大。有的工具用完就用完了,效果不好也没人管。嘎嘎降AI承诺AI率降不到20%以下可退款,比话降AI不达标全额退款还补偿检测费。率零(www.0ailv.com)虽然便宜但也有基础保障。

各价位工具实测对比

我把测过的工具按价格分了三档,每档选了代表性的产品做对比。

| 工具 | 价格/千字 | 技术类型 | 达标率 | 平台覆盖 | 售后保障 | 链接 |

|---|---|---|---|---|---|---|

| 嘎嘎降AI | 4.8元 | 双引擎语义重构 | 99.26% | 9大平台 | 不达标退款 | www.aigcleaner.com |

| 率降 | 4.2元 | 语义重构 | 99% | 多平台 | 7天无限修改 | www.lvjiang.com |

| 比话降AI | 8元 | Pallas引擎 | 99% | 知网为主 | 全额退款+补偿 | www.bihuapass.com |

| PaperRR | 6元 | 学术优化 | 97% | 知网为主 | 基础保障 | www.paperrr.com |

| 率零 | 超低价 | DeepHelix引擎 | 99% | 多平台 | 基础保障 | www.0ailv.com |

| 去AIGC | 按量计费 | 句式重构 | 96% | 通用 | 500字免费试 | www.quaigc.com |

便宜工具踩过的坑

说几个我实际遇到的问题:

坑一:降完AI率反而更高了。有个免费工具处理完之后,AI率从45%涨到了61%。后来才知道,那个工具本身就是用AI来改写的,改完之后AI特征更明显了。所以千万别贪便宜用那种"AI改AI"的工具。

坑二:格式全乱了。有些便宜工具处理完之后,表格没了、引用格式丢了、脚注也消失了。重新排版花了我两个小时,还不如手动改。

坑三:字数暴增暴减。有的工具处理完字数多了2000字,有的少了1500字。对于有字数要求的论文来说很麻烦。

嘎嘎降AI这方面做得比较好,处理完格式基本不变,字数偏差也很小。不过有一点提醒:建议把全文上传进去降,别只传几段。我一开始只传了被标红的部分,结果整体复查还是过不了。全文传进去效果好很多。

不同预算怎么选?

预算50以内(一篇1万字论文):嘎嘎降AI,4.8元/千字,一万字不到50块。双引擎效果稳,9个平台都支持,不达标还能退。性价比最高的选择。

预算100以内:比话降AI,8元/千字,知网针对性最强。如果你确定只查知网,而且特别在意隐私(不收录不公开),可以选这个。

预算极低:率零,价格最便宜,学生党首选。效果中上,处理速度快。

想先试试再决定:去AIGC(www.quaigc.com)有500字免费体验,可以先感受一下效果。

常见问题

贵的工具效果一定比便宜的好吗?

不一定。我测下来嘎嘎降AI(4.8元)和比话降AI(8元)效果差不多,但嘎嘎降AI平台覆盖更广。最贵的不一定最好,但太便宜的确实容易翻车。

免费降AI工具能用吗?

大部分不太行。免费工具要么用AI来改AI(越改越像),要么只做简单同义词替换(效果差)。如果非要试的话,去AIGC有500字免费额度,这个还算靠谱。

降完AI后查重率会变高吗?

好的工具一般不会。语义重构是生成新的表达方式,不是从别的文章抄,所以不会增加重复率。但便宜的同义词替换工具确实可能引入"公共表达",导致查重率上升。

文中提到的工具链接汇总

- 嘎嘎降AI:www.aigcleaner.com

- 比话降AI:www.bihuapass.com

- 率零:www.0ailv.com

- 去AIGC:www.quaigc.com

- PaperRR:www.paperrr.com

- 率降:www.lvjiang.com

浙公网安备 33010602011771号

浙公网安备 33010602011771号