AI-统计学习(15)-Adaboost(2)-训练误差界

Adaboost由于其分类效果好,算法简单,还有其可靠的理论基础,深受大家欢迎。

本文以统计学习三要素来说说这个模型,并对训练误差界进行说明。希望对大家理解这些公式有帮助。

- Adaboost 模型说明

2.训练误差界

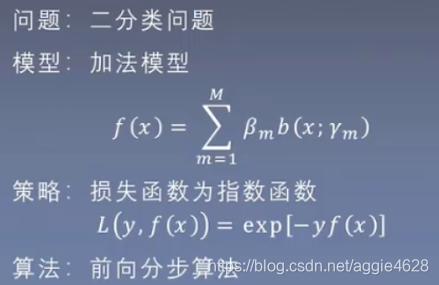

1.Adaboost 模型说明

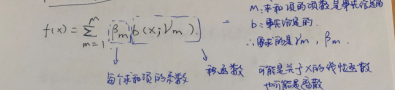

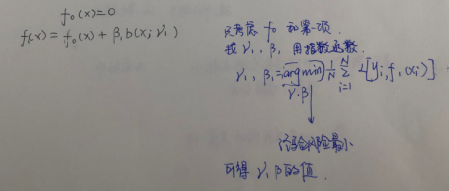

模型:加法模型 (求和)(求和项系数+积函数)

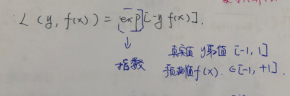

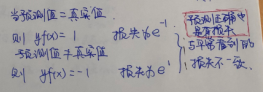

策略:损失函数为指数函数(预测值正确也是有损失的)

算法:前向分布算法(序列、经验风险最小)

2.训练误差界

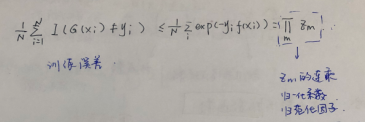

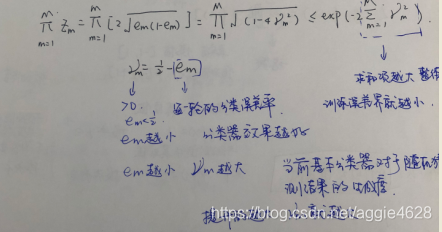

总结:1.训练误差求和

2.每轮的分类误差率<0.5

3误差率越小,效果越好,权重越小

4.随轮数增多,训练误差会变小

5.随轮数增多,训练误差降低的速度变快

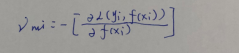

6.平方误差->残差->负梯度

算平方误差需要知道残差,当残差不好算的时候用负梯度。负梯度公式如下。

浙公网安备 33010602011771号

浙公网安备 33010602011771号