Dense U-net for super-resolution with shuffle pooling layer

改进点:

2.pooling strategy: shuffle pooling

-

a mix loss function: MSE ,SSIM,MGE(Mean Gradient Error)

介绍:

SRCNN,FSRCNN, ESPCN, VDSR, SRGAN, EDSR, DRCN, DBPN, UnetSR,

用于超分辨率的U-net(UnetSR)[13]修改了基本的U-net体系结构以适应SISR领域,并提出了混合梯度损失函数以增强重建图像的清晰度。尽管考虑了图像模糊的问题,但UnetSR在网络传输中仍然存在许多缺陷。

提出问题:

网络结构有问题:首先,相同深度的卷积层之间的跳过连接只是单向的,,

第二,当down-scale为k时,传统的pooling方法在每个down-sampling block中导致超过 (2k -1) / 2k 的信息丢失。

第三,以前的方法集中在峰值信噪比(PSNR)的评估方法上,这导致了PSNR的高性能,但很大程度上忽略了梯度误差

通常,以前的方法缺乏处理信息传输处理的无损机制。

贡献:

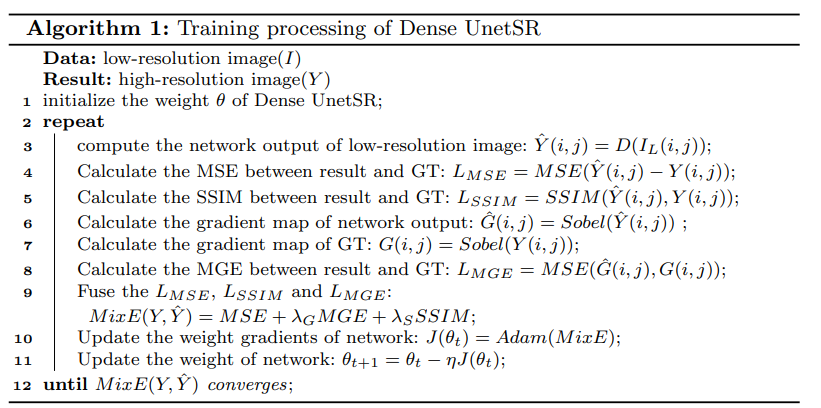

1)密集的U-net通过将所有特征层从不同深度传输到每个上采样层来增强跳过连接部分。由于上采样块结合了所有缩小块深度的所有下采样特征图,因此它减少了信息传输损失。

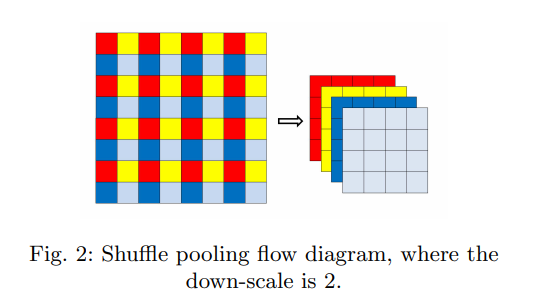

2)为密集的U-net设计了一种称为“随机池”的新颖池方法,该方法可以有效避免传统池处理中的信息丢失。如图3所示,混洗合并模块包括2个步骤:1)按指定间隔对输入特征图进行采样; 2)将采样值重塑为向下采样的特征图。

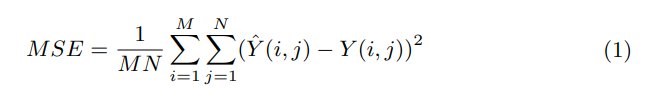

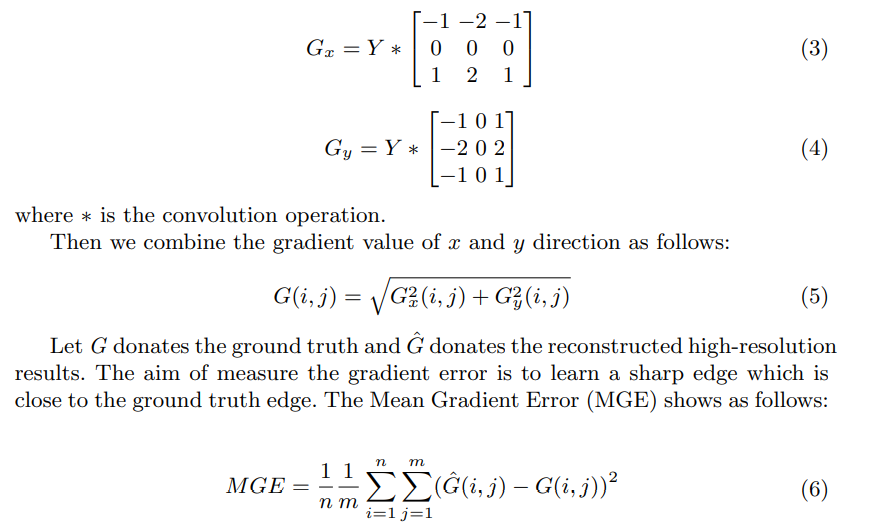

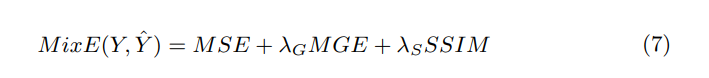

3)混合损失函数结合了均方误差(MSE)[15],结构相似性指数(SSIM)[16]和平均梯度误差(MGE)[13],基本上解决了感知损失和高频信息损失。除了MSE损失外,MixE损失还考虑了有助于更好地恢复亮度,对比度和结构的SSIM损失,以及有助于更好地恢复图像清晰度的MGE损失。

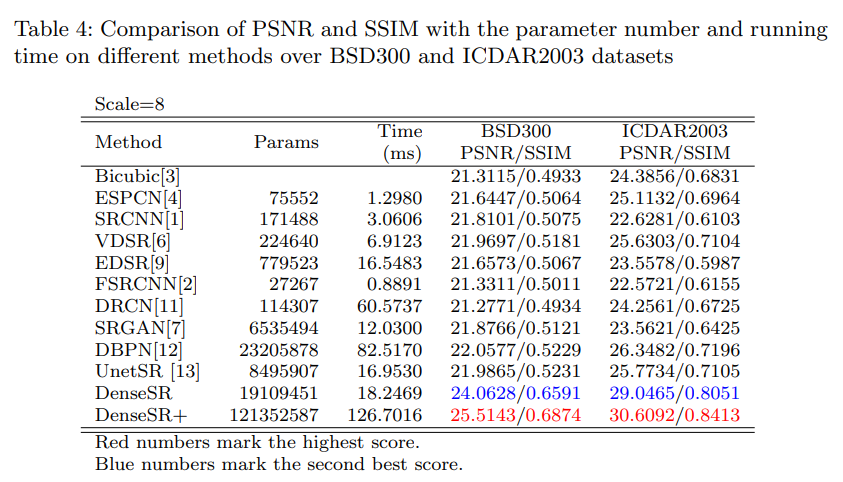

4)尽管Dense UnetSR是一种大参数数量的深度学习方法,但它可以实现最新的性能,尤其是在文本任务中。

方法:

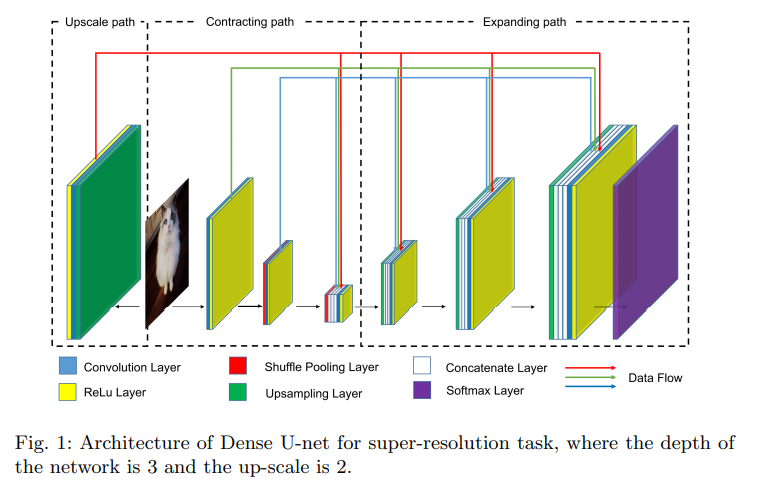

Contracting path:

网络左侧的 contracting path 用于 特征提取:包含一连串连续的部分(3X3卷积核-->ReLU---> 2X2 max-pooling with stride 2 for down-sampling)为了改进下采样方法,在Dense UnetSR中采用了混洗池方法来代替最大池方法。(shuffle pooling)

Expanding path:

特征图的上采样,2X2的卷积核将特征图数量减半---->一个3x3卷积核---->ReLU

Upscale path:

包含一个up-sampling layer 和一个convolutional layer,意在使contracting path and expanding path的深度保持相同,通过双三次插值对输入图像进行上采样,并在expanding path中构建与相同深度上采样层相对应的对称特征提取层。

Dense skip connection:

密集数据跳过连接用于将特征图从所有收缩块的深度传输到每个扩展块。由于上采样块结合了所有收缩块深度的所有下采样特征图,而不是单向下采样路径中的特征图,因此,理论上,密集跳过连接建立了多路径数据传输并减少了信息传输损失。

Shuffle pooling:

1)按指定间隔对输入特征图进行采样

2)将采样值重塑为向下采样的特征图

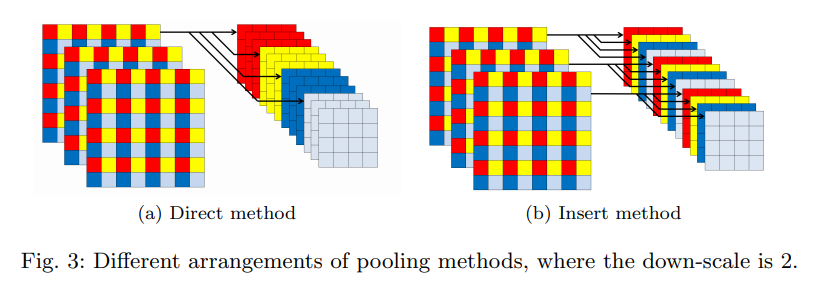

根据池层的不同布置,混洗池具有两种不同的策略,即指示性和插入式混洗池,如图3所示。

与保持四分之一采样的最大池和平均池不同,提议的混洗池将所有信息保留在上一层的特征图中。同时,混洗池带来四倍的通道数和四倍的参数量

Mix loss function:

Problem analysis:

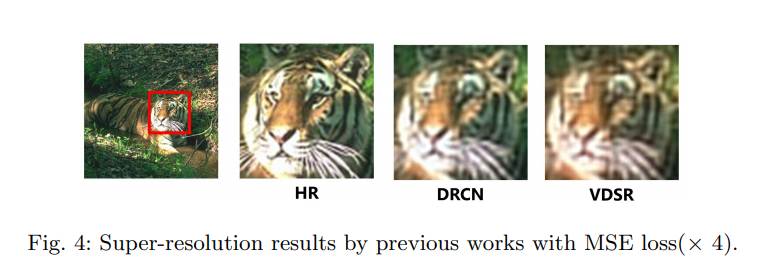

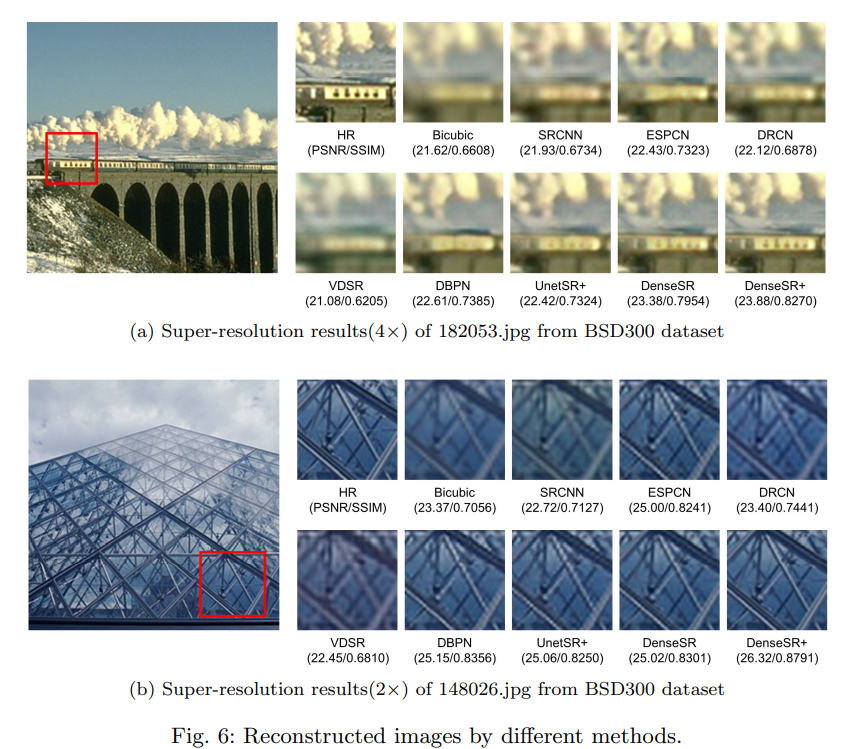

首先,先前仅由MSE损失训练的SISR研究并未解决边缘模糊的问题,如图4所示,DRCN和VDSR重建了结果。为了保持重建边缘的清晰度,有必要将图像梯度作为SISR约束之一。

其次,MSE仅关注每个像素与地面真实情况之间的误差,而忽略了像素的相邻结构。SSIM为我们提供了一种测量重建图像与地面真实情况之间结构相似性的新方法,该方法可以作为邻近结构约束应用于SISR任务,以提高结构相似性。

MSE loss:

MSE反映每个像素当前图像和源图像之间的差异

SSIM loss:

MGE loss:

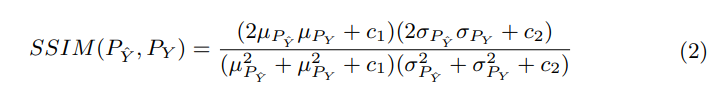

为了解决梯度误差测量问题,我们将经典的梯度引入称为Sobel算子的SISR损失函数中[17]。地面真实图像Y在x和y方向上的梯度图G如下所示:

Mix loss function:

先前对SISR的研究倾向于将重点放在网络体系结构上,而不是损失函数上。因此,损失函数的修改形式可用于该实验。为了说明混合损失功能的优越性,将进行更为系统的推断,以试图确定网络性能如何与MixE交互,而MixE被认为与融合方法有关。

Experiment

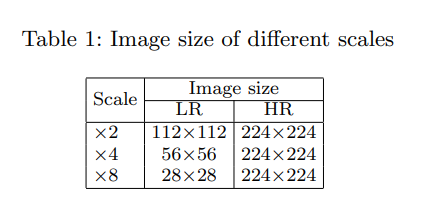

Dataset: ICDAR2003,,consists of 258 training images and 249 testing images,,,s varies from 422×102 to 640×480,,resize them into 224×224 with bicubic interpolation,,standard benchmark datasets: SET14 [19], BSD300 [20].

Evaluation method:

PSNR, SSIM

Implement details:

SET14 [19], BSD300 [20] and ICDAR2003 [18] down-scaled by bicubic interpolation on Table 1.,, Meanwhile, all images are converted into RGB colour space.

training parameter set,: batch_size : 1,

Adam, with β1 = 0.9, β2 = 0.999, ε= 10−8

learning rate is set to 10e−3 initially and decreases to half every 50 epochs.

PyTorch,,RTX 2080 GPU

Network analysis:

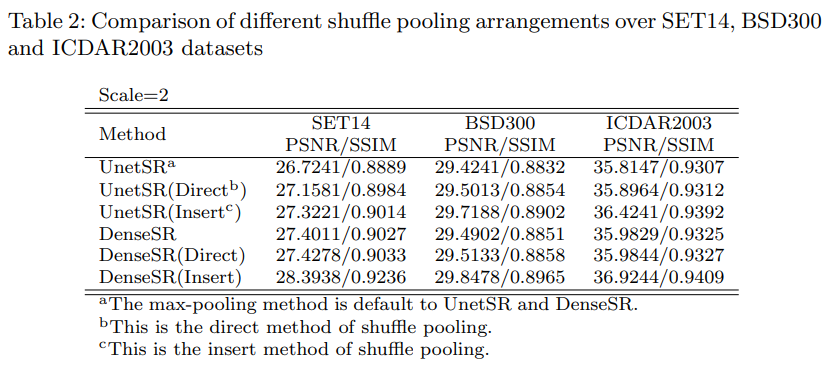

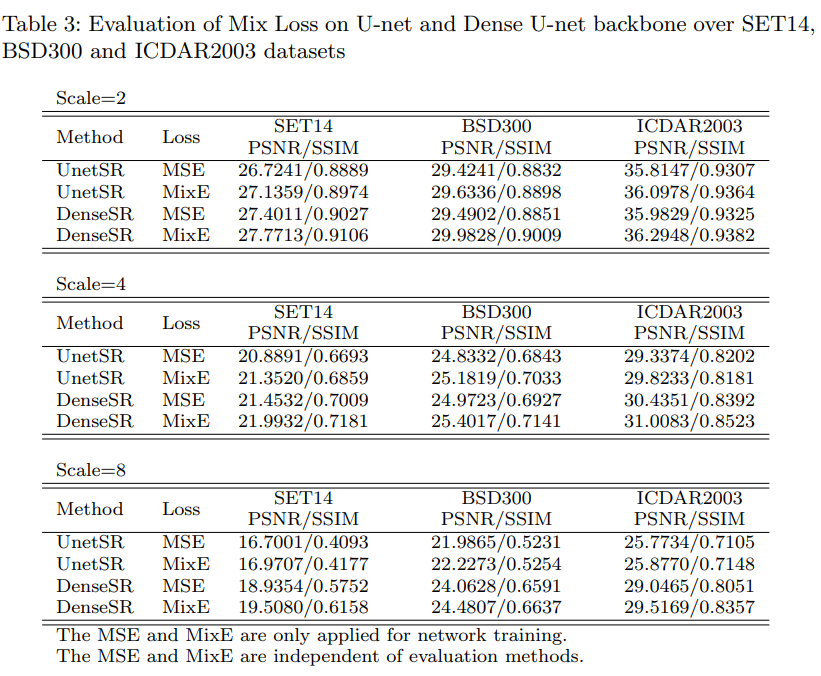

U-net and Dense U-net backbone with 5-layer depth,,,. Data from the Table. 2 shows that the backbone of Dense U-net performs much better than the U-net on all three datasets. Becuase the insert method of shuffle pooling is better than the direct method from the Table. 2, the insert method is applied into all the following shuffle pooling method.

Mix loss function:

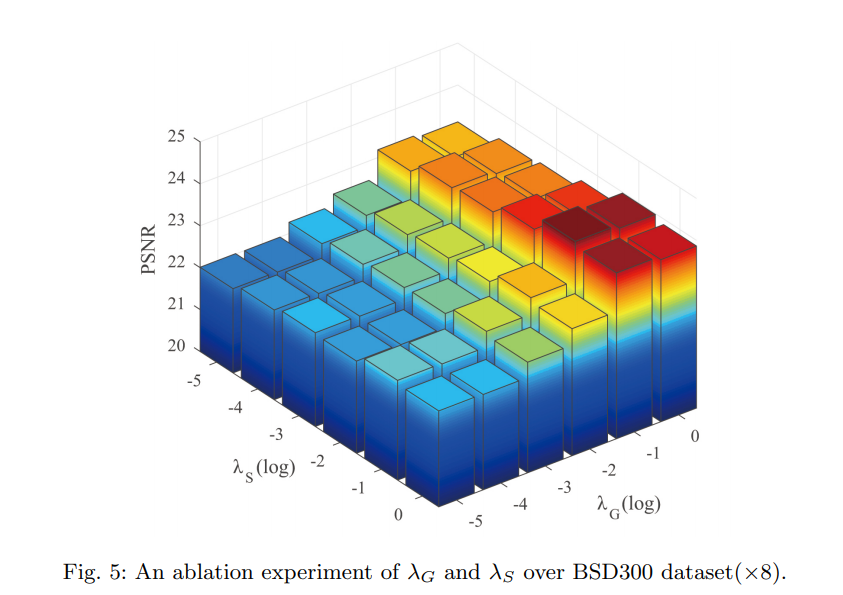

为了确定最佳的权重值,在图5中提出了在BSD300数据集上进行8级标度的消融实验的结果。

MGE has a greater effect on PSNR than SSIM,,一个可靠的解释是它们具有严重的同质性,因为SSIM和MSE都在RGB域中,而MGE在梯度域中并提供了跨域信息。

n. Under the guidance of the ablation experiment result, λG is set to 0.1 and λS is set to 0.1 in all subsequent experiments.

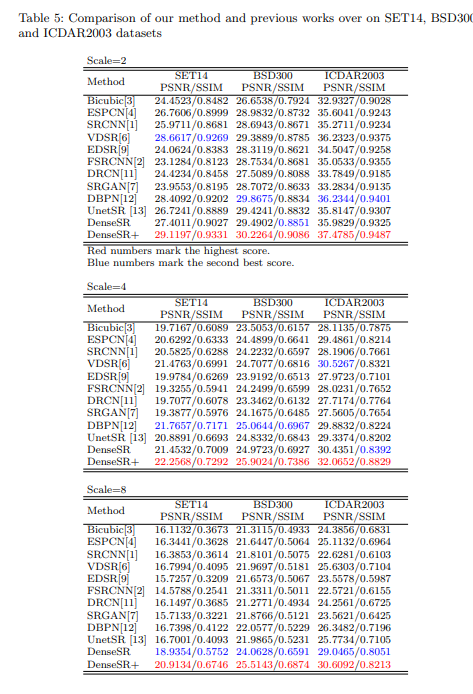

Comparison with the state-of-the-arts:

参考文献:

【1】SRCNN ()

【2】FSRCNN

【3】De Boor, C.: Bicubic spline interpolation.

【4】ESPCN

【5】Deep residual learning for image recognition

【6】VDSR

【7】SRGAN

【8】Generative adversarial nets

【9】Enhanced deep residual networks for single image super-resolution.

【10】Ntire 2017 challenge on single image super-resolution: Dataset and study

【11】Deeply-recursive convolutional network for image super-resolution. In: Proceedings of the IEEE conference on computer vision and pattern recognition

【12】Deep back-projection networks for superresolution.

【13】Single image super resolution based on a modified u-net with mixed gradient loss.

【14】U-net: Convolutional networks for biomedical image segmentation

【15】Scope of validity of psnr in image/video quality assessment.

【16】Image quality metrics: Psnr vs. ssim

【17】Design of an image edge detection filter using the sobel operator.

Icdar 2013 robust reading competition

Low-complexity singleimage super-resolution based on nonnegative neighbor embedding

A database of human segmented natural images and its application to evaluating segmentation algorithms and measuring ecological statistics

A method for stochastic optimization.

浙公网安备 33010602011771号

浙公网安备 33010602011771号