MacBook Air M3本地私有化部署DeepSeek R1

硬件环境:

-

MacBook Air M3 / 16G

M3拥有8核CPU(4性能核+4能效核),性能对比M1性能提升35%,10核心GPU,对比M1最高提升了65%,对比M2提升了20%,最高24GB统一内存。

1.安装 Ollama

访问 Ollama 官网,根据提示下载并安装 Ollama 客户端。安装完成后,在终端内运行 ollama -v 命令将输出版本号。

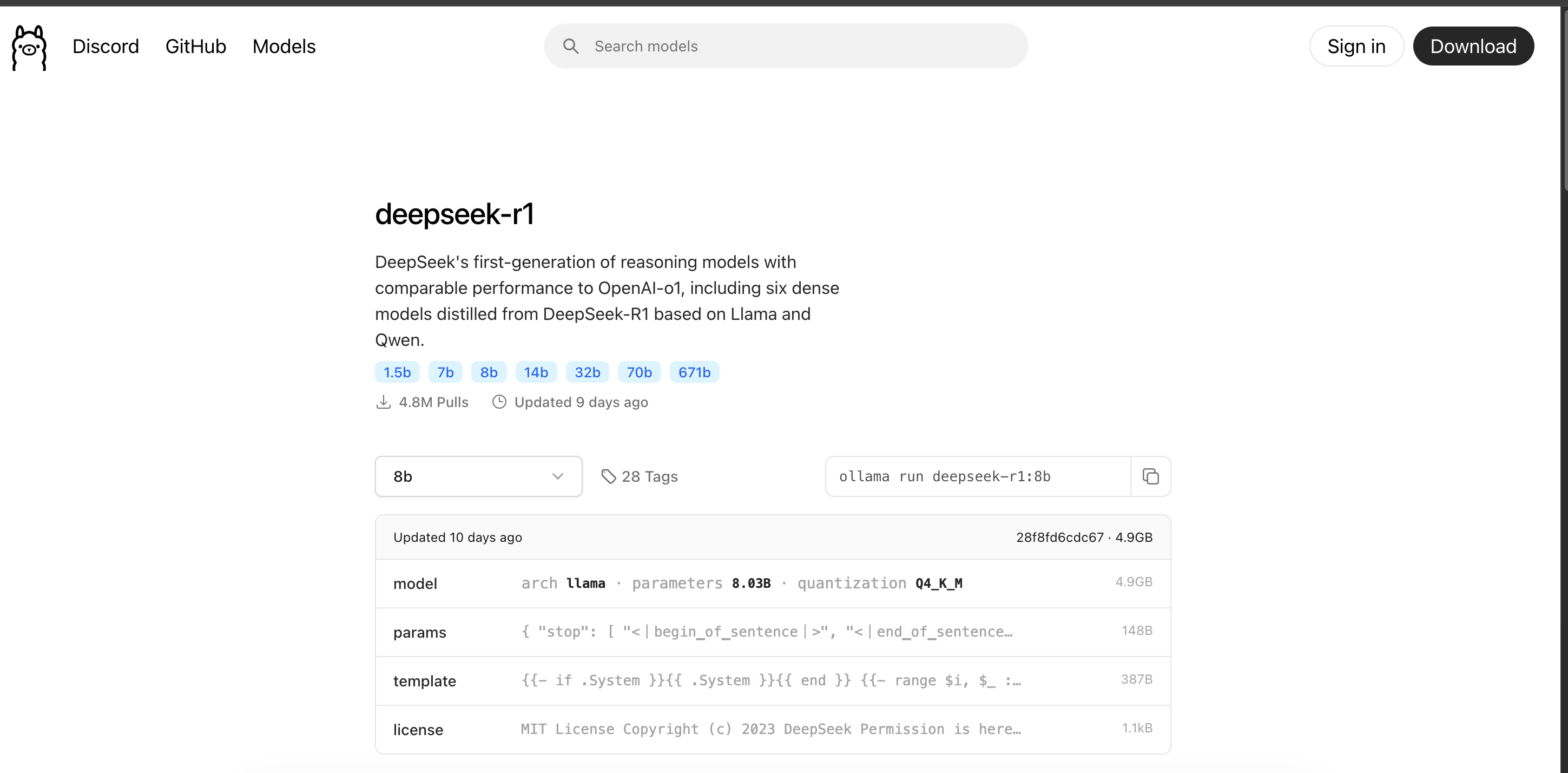

根据实际的环境配置,选择合适的 DeepSeek模型进行部署。mac 16G推荐安装 8B 尺寸模型。

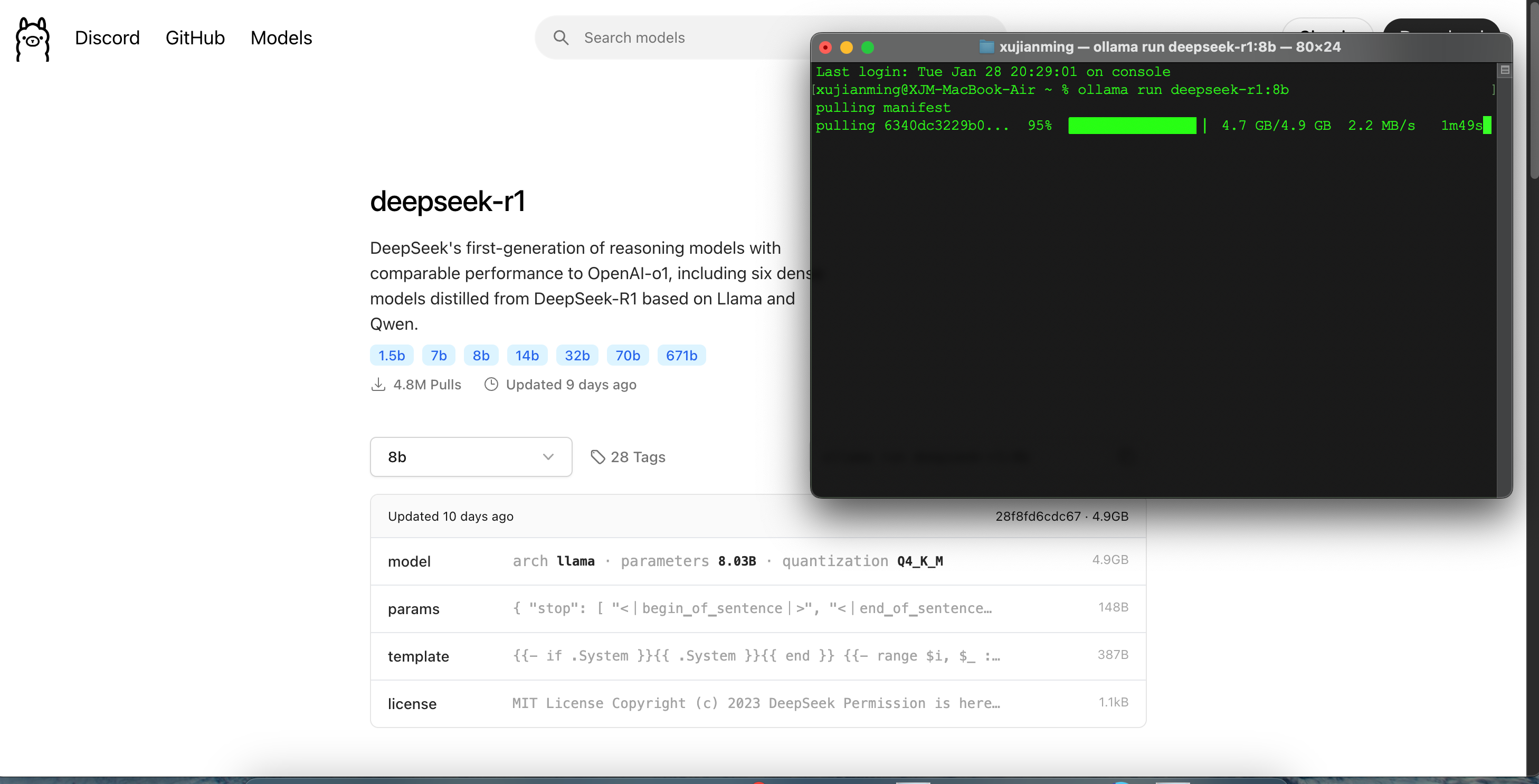

打开terminal终端运行:ollama run deepseek-r1:8b

使用AnythingLLM 可以搭建本地知识库,RAG本地知识投喂。

浙公网安备 33010602011771号

浙公网安备 33010602011771号