为什么AI改AI越改越高?知网AIGC检测算法的3个核心原理

为什么AI改AI越改越高?知网AIGC检测算法的3个核心原理

最近在论文交流群里看到一个特别扎心的帖子:一个研究生用ChatGPT写了初稿,知网检测AI率62%,然后他又用另一个AI工具改写了一遍,结果AI率变成了71%。他不信邪,又换了个AI工具改了一遍,这次直接飙到了78%。

三次"降AI"操作,AI率反而涨了16个百分点。

这不是个例。我观察了将近半年,发现至少有40%的同学在降AI这件事上走了弯路,核心原因就一个:不理解知网AIGC检测到底在检测什么。

今天我就把知网检测算法的底层逻辑给你拆明白,搞懂这三个原理,你就知道为什么"AI改AI"这条路走不通了。

原理一:知网检测的不是"具体词句",而是"语言模式"

很多人有个误解,觉得AIGC检测就是拿你的论文去跟AI生成的内容做比对,像查重那样找相似句子。

完全不是这么回事。

知网的AIGC检测用的是深度学习分类模型,它学习的是AI生成文本的"语言模式",而不是具体的词句。

打个比方,你听一个人说话,即使他每次说的内容不一样,你也能从语气、用词习惯、句式结构判断出这是同一个人。AIGC检测的原理跟这个类似。

AI生成的文本有几个特别明显的"指纹":

困惑度偏低。 简单说就是AI写的东西太"通顺"了。人写东西会有思维跳跃、会用不太常见的搭配、偶尔还会有口语化的表达。但AI生成的文本,每个词的出现都"太合理"了,整体困惑度很低。

句式规整度偏高。 AI特别喜欢用并列句、排比句、"首先...其次...最后..."这种结构。人写东西虽然也会用,但不会每段都这么整齐。

词汇多样性呈现特定分布。 AI在用词上有一个特点:它会用很多"正确但平庸"的词。比如形容一个研究"具有重要意义"、"值得深入探讨",这些表达没毛病,但就是太"标准答案"了。

所以你用AI来改AI生成的内容,改出来的东西在语言模式上跟原来是一样的。换了词、换了句式,但那种"AI味"还在,甚至因为多过了一轮AI处理,模式特征反而更明显了。

原理二:多轮AI改写会产生"特征叠加效应"

这是很多人不知道的一个关键点。

知网的检测模型在训练时,不光用了一次生成的AI文本,也用了经过多轮AI改写的文本作为训练数据。换句话说,"AI改过的AI文本"本身就是模型重点学习的识别对象。

为什么多轮改写反而更容易被检测出来?因为每一轮AI改写都会让文本变得更"规范"、更"平滑"。

你可以这么理解:原始的AI文本可能AI率是60%,里面还残留了一些你自己写的句子特征。但你用AI改写一遍后,那些残留的人类特征也被AI"洗"掉了,文本变得更加纯粹的"AI风格"。

这就像你用滤镜美颜照片,一次美颜可能还能看出本人特征,多美颜几次,所有人的照片看起来都一样了。检测模型要识别的恰恰就是这种"被处理过的均匀感"。

我整理了一组实测数据,你感受一下:

| 处理阶段 | AI率 | 变化趋势 |

|---|---|---|

| AI原始生成 | 58%-65% | 基准值 |

| 第1次AI改写 | 62%-72% | 上升5-10% |

| 第2次AI改写 | 68%-78% | 继续上升 |

| 第3次AI改写 | 75%-85% | 持续恶化 |

| 专业降AI工具处理 | 5%-15% | 大幅下降 |

看到没有,AI改写不但没用,还会让情况越来越糟糕。而专业的降AI工具之所以有效,是因为它们用的根本不是简单的AI改写思路。这个我后面会详细讲。

原理三:知网检测的"滑动窗口"机制

知网在做AIGC检测时,不是把你整篇论文一起丢进去算一个分数的。它用的是滑动窗口的方式,把文本切成一个个小段,每段分别检测,然后加权汇总。

这个机制意味着什么呢?意味着你的论文里只要有大段连续的AI文本,那一整个窗口的检测分数都会很高,拉高整体AI率。

举个例子,如果你的论文有5000字,其中2000字是AI写的,3000字是你自己写的。如果那2000字集中在某一章,检测时那一章的窗口AI率可能高达90%以上,最终整体AI率可能在40%-50%。

但如果你把少量AI辅助的内容分散在各章节,每个窗口里AI文本占比都不高,整体AI率可能只有15%-20%。

同样的AI文本占比,不同的分布方式,检测结果差异巨大。

这也解释了为什么有的同学说"我只用了一点AI写的内容,怎么AI率还这么高"。很可能是你把AI内容集中放在了某一部分。

那正确的降AI思路是什么?

理解了上面三个原理,正确的降AI思路就清晰了:

第一,不能用通用AI工具来改写,因为改出来的还是AI模式。

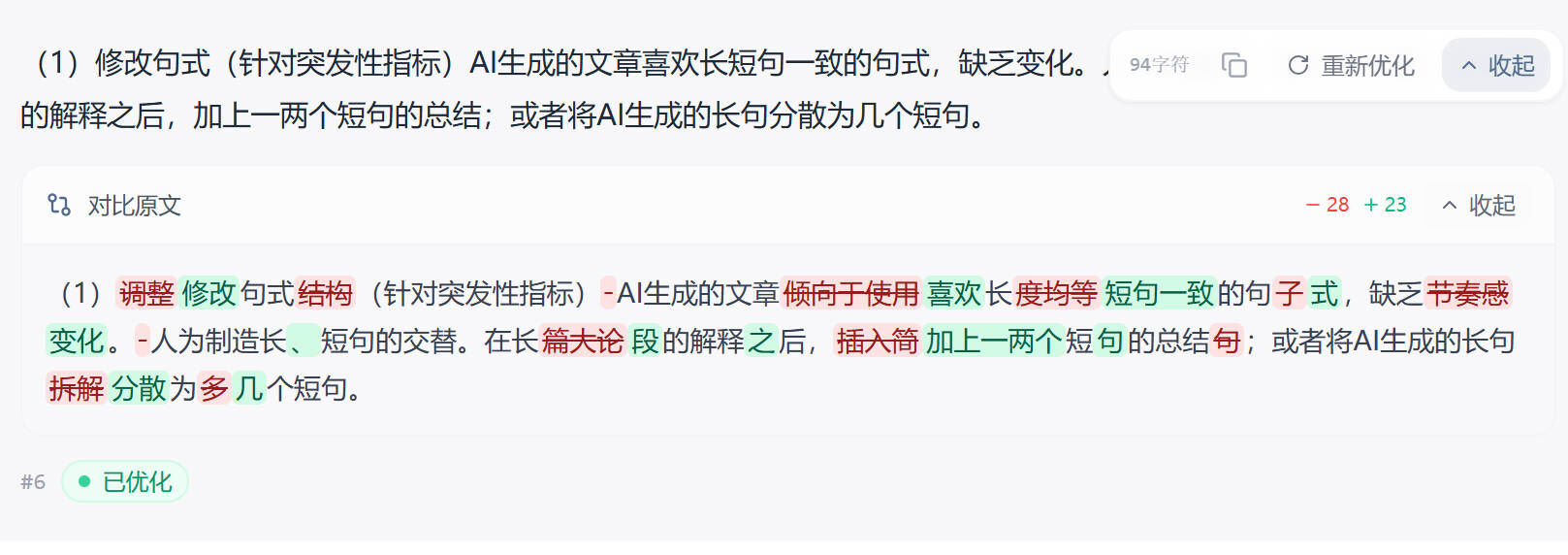

第二,需要从语言模式层面做改变,让文本的困惑度、句式结构、词汇分布都更接近人类写作。

第三,最好能针对检测平台做针对性优化。

目前市面上真正在这个方向做的专业工具不多,我实测过几个效果比较好的:

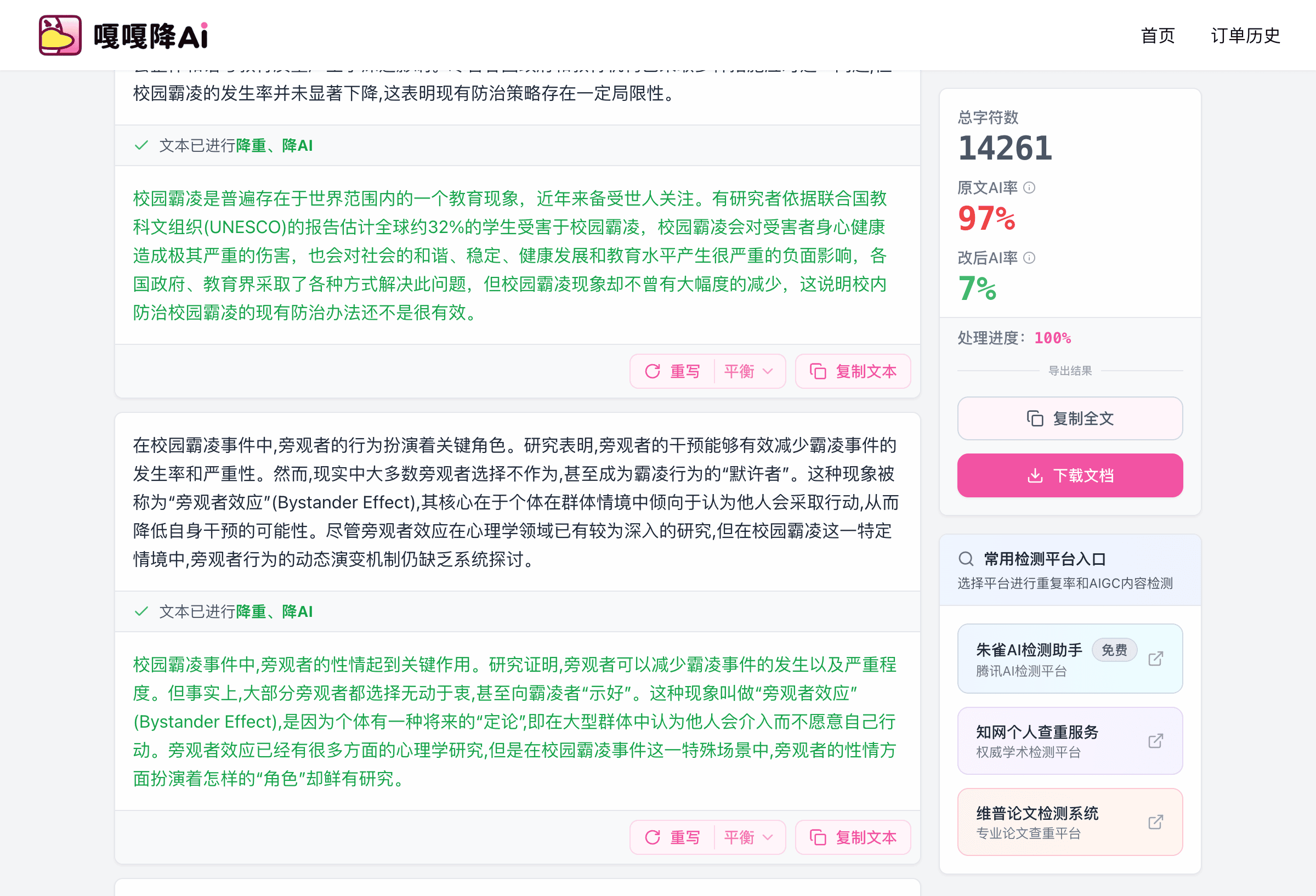

嘎嘎降AI(aigcleaner.com)用的是双引擎驱动,能针对知网、维普、万方等9大检测平台做定向优化。我测过一篇AI率97%的文章,处理后降到了7%。它的核心逻辑不是简单换词,而是在语义层面重构文本的语言模式,让困惑度和句式分布回归到人类写作的范围。

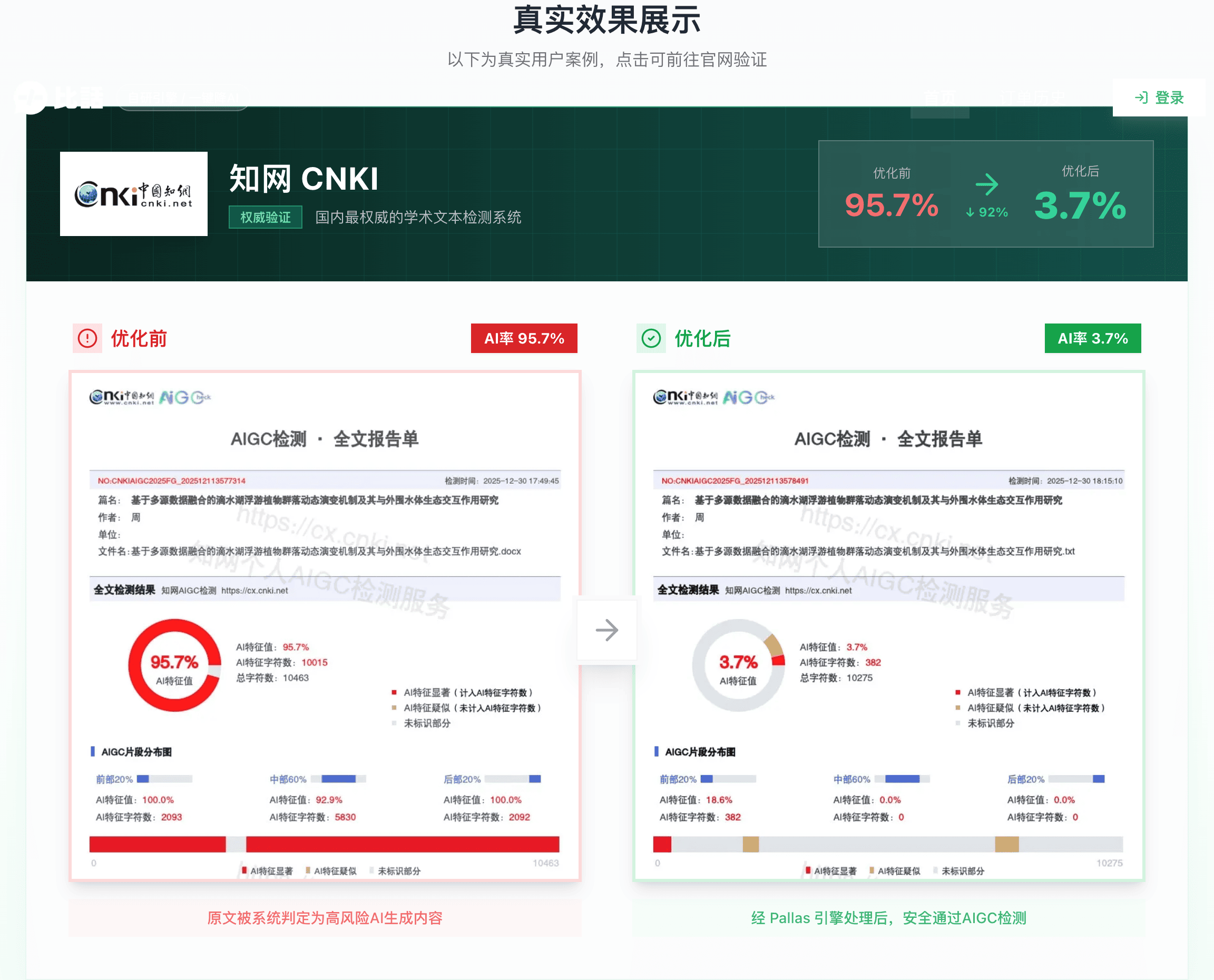

比话降AI(bihuapass.com)专注知网平台,用的Pallas NeuroClean 2.0引擎,对知网检测算法做了深度适配。8元/千字价格稍贵,但如果你主要过知网,它的针对性更强,达标率能到99%,不达标全额退款。

率零(0ailv.com)走的是深度语义重构路线,用DeepHelix引擎,号称能把AI率降到5%以下。我测过一篇知网95.7%的文章,处理后3.7%,确实猛。而且3.2元/千字,价格是最低的。

实测对比:AI改写 vs 专业降AI工具

为了让大家更直观地感受差别,我拿同一篇5000字的论文做了对比测试:

| 处理方式 | 处理前AI率 | 处理后AI率 | 语义保留度 | 耗时 |

|---|---|---|---|---|

| ChatGPT改写 | 62% | 71% | 约70% | 5分钟 |

| Claude改写 | 62% | 68% | 约75% | 3分钟 |

| 嘎嘎降AI | 62% | 6.2% | 约90% | 8分钟 |

| 比话降AI | 62% | 4.8% | 约88% | 10分钟 |

| 率零 | 62% | 3.1% | 约85% | 2分钟 |

| 手动逐句改写 | 62% | 12% | 约95% | 6小时 |

差距一目了然。AI改写不降反升,手动改虽然有效但太耗时间。专业工具在效果和效率上的优势非常明显。

FAQ

Q:用AI写了一部分内容,剩下的是自己写的,需要全文处理吗?

建议全文处理。因为检测是滑动窗口机制,你自己写的部分如果紧挨着AI内容,也可能被"带偏"判断。全文处理后整体一致性更好,检测结果更稳定。

Q:知网检测结果和维普、万方的会不一样吗?

会的。每个平台的检测模型和算法都不一样,同一篇论文在不同平台检测出来的AI率可能差十几个百分点。所以一定要搞清楚你学校用的是哪个平台,再做针对性处理。嘎嘎降AI支持9大平台选择,这点比较方便。

Q:降AI处理后还需要自己再修改吗?

建议至少通读一遍。虽然专业工具的语义保留度已经很高了,但你作为作者应该确保内容表达符合你的意思,顺便也可以加入一些个人化的表达,这样更保险。

总结

AI改AI越改越高,根本原因是通用AI工具改写出来的文本仍然带有AI语言模式特征,甚至经过多轮处理后特征更明显。知网的AIGC检测算法检测的不是具体词句,而是语言模式,这就决定了简单的AI改写不可能有效。

想真正把AI率降下来,要么花大量时间手动改写,要么用专业的降AI工具从语义层面重构文本。

推荐工具汇总:

- 嘎嘎降AI:aigcleaner.com - 4.8元/千字,9大平台适配

- 比话降AI:bihuapass.com - 8元/千字,知网专精

- 率零:0ailv.com - 3.2元/千字,深度语义重构

浙公网安备 33010602011771号

浙公网安备 33010602011771号