AIGC检测能查出哪些AI工具写的论文?各平台识别能力解析

AIGC检测能查出哪些AI工具写的论文?各平台识别能力解析

一个让很多同学困惑的问题

"我用的是DeepSeek写的论文,知网能查出来吗?"

"我用文心一言改写了一下ChatGPT的内容,检测平台还能识别吗?"

"我用了好几个AI工具拼凑的论文,检测系统分得清吗?"

这些问题我在各个论文交流群里见过无数次。大家的核心焦虑其实就一个:AIGC检测到底有多厉害?它能查出什么?

今天这篇文章就来彻底讲清楚这个问题。我会从AIGC检测的工作原理讲起,然后分析各主流检测平台的识别能力,最后告诉你应该怎么应对。

AIGC检测的基本原理

要理解AIGC检测能查出什么,首先要知道它是怎么工作的。

AIGC检测系统主要从以下几个维度来判断一段文字是否由AI生成:

1. 语言模式分析

AI写的文字有一些共同的特征:用词分布非常均匀、句式结构相对规整、极少出现口语化或者不规范的表达。检测系统会分析文本的语言模式,看它是否符合AI生成的统计特征。

打个比方,人类写的论文可能会在某一段突然用一个很口语化的连接词,或者某个句子特别长而下一个句子特别短——这种"不规则性"恰恰是人类写作的特征。AI写的内容则很少出现这种情况,它的句子长度、用词习惯、句式变化都非常"标准"。

2. 困惑度(Perplexity)检测

这是技术层面的一个核心指标。简单来说,困惑度衡量的是一段文字的"可预测性"。AI生成的内容通常困惑度较低——因为AI总是选择最可能的下一个词。人类写的内容困惑度较高——因为人类会做出更多"意外"的词语选择。

检测系统会计算文本的困惑度分数,困惑度太低就会被标记为"疑似AI生成"。

3. 突发性(Burstiness)检测

人类写作有一个特点:句子长短不一、复杂度参差不齐。一段话里可能有长达50个字的复杂句,紧接着就是一个10个字的短句。而AI写的内容在句子复杂度上往往非常均匀。

检测系统会分析这种"突发性"——如果整篇文章的句子复杂度变化很小,AI的嫌疑就很大。

4. 语义连贯性分析

有些检测系统还会分析文本的语义连贯性。AI写的长文往往会出现"表面连贯但深层断裂"的问题——每段话单独看都说得通,但段与段之间的逻辑推进比较机械,缺乏人类写作中那种自然的思维跳跃。

各主流AI工具能被查出来吗?

现在来回答大家最关心的问题:各种AI工具写的内容,检测平台能查出来吗?

ChatGPT

结论:基本能被查出来。

ChatGPT是目前AIGC检测系统研究最透彻的目标。从GPT-3.5到GPT-4再到最新版本,各检测平台都有大量的训练数据针对ChatGPT的输出特征。我测试过纯ChatGPT生成的中文学术文本,知网AIGC检测率通常在75%到95%之间。

DeepSeek

结论:同样能被查出来,但检测率可能略有波动。

DeepSeek是2024年底以来非常火的AI工具,很多同学觉得"用国产AI写论文,国内的检测系统可能查不出来"。这个想法完全错误。AIGC检测系统不是识别"你用了哪个AI",而是识别"这段文字是否具有AI生成的特征"。不管是ChatGPT还是DeepSeek,生成的内容都有相似的AI特征。

我用DeepSeek写的几篇测试论文,知网AIGC检测率在80%到92%之间,和ChatGPT差不多。

文心一言

结论:能被查出来。

百度的文心一言生成的中文内容同样具有明显的AI特征。虽然它在某些方面可能比ChatGPT更"中文化",但检测系统关注的是统计层面的特征,不会因为"更像中文"就漏判。实测检测率在70%到90%之间。

通义千问/豆包/Kimi等

结论:都能被查出来。

不管是阿里的通义千问、字节的豆包还是月之暗面的Kimi,它们生成的内容在AIGC检测面前基本没有本质区别。所有大语言模型生成的文本都共享一些底层的统计特征,这些特征正是检测系统识别的目标。

多个AI工具混用

有同学问:"我用ChatGPT写一段、DeepSeek写一段、文心一言写一段,拼起来能骗过检测吗?"

结论:不能。

检测系统是逐段分析的,它不关心你整篇论文是用一个工具写的还是十个工具写的。每一段内容只要具有AI生成的特征,就会被标记。混用工具不会改变单段文字的AI特征。

各检测平台的识别能力对比

目前国内主流的AIGC检测平台主要有以下几个,它们的识别能力各有特点:

知网AIGC检测

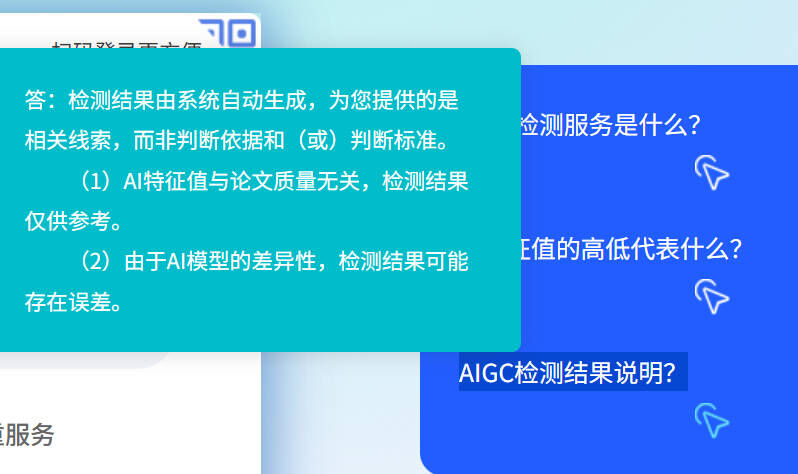

识别能力: 非常强。作为国内学术检测的龙头平台,知网在AIGC检测上投入了大量资源。它的训练数据规模大、更新频率高,对各种AI工具生成的中文学术文本都有很好的识别能力。

特点: 大部分985/211高校采用,检测标准相对严格。

维普AIGC检测

识别能力: 较强。维普的AIGC检测功能上线较早,在中文学术文本的识别上有一定的积累。

特点: 部分高校使用,检测结果与知网可能有差异。

万方AIGC检测

识别能力: 较强。万方近两年在AIGC检测上追赶很快,识别能力已经接近知网。

特点: 使用高校数量不少,性价比较高。

GPTZero

识别能力: 在英文检测上非常强,中文检测能力一般。

特点: 主要面向英文学术论文,如果你的学校用英文写论文,这个平台需要重点关注。

Turnitin

识别能力: 英文检测非常强,中文检测能力正在提升。

特点: 国际高校和部分国内中外合作办学项目使用较多。

那么问题来了:怎么应对?

既然AIGC检测系统这么强,用什么AI工具都能被查出来,那我们应该怎么办?

首先,接受现实。 不要幻想找到一个"检测系统查不到的AI",因为这种东西不存在。所有大语言模型在统计特征上都有共通的AI痕迹。

其次,使用专业的降AI工具进行处理。 降AI工具的核心作用是改变文本的统计特征,让检测系统无法识别出AI痕迹。这和"用哪个AI写的"无关——不管你用什么AI写的初稿,降AI工具都能处理。

目前效果比较好的降AI工具有:

- 嘎嘎降AI(gagajiangai.com): 支持知网、维普、万方等9大平台,能针对不同平台的检测算法做针对性处理。4.8元/千字,有1000字免费试用。

- 比话降AI(bihuapass.com): 知网AIGC检测专精,对知网的针对性优化做得很深入。8元/千字,500字免费。

- 率零(0ailv.com): 性价比最高,3.2元/千字,1000字免费。

最后,结合手动修改。 在工具处理的基础上,自己再做一些个性化的调整——加入个人观点、调整行文风格、补充真实案例——这样不仅能进一步降低检测率,还能让论文更有你自己的特色。

一个重要的认知更新

最后我想帮大家纠正一个常见的误区:很多人觉得AIGC检测是在跟AI"斗智斗勇",好像只要找到检测系统的"漏洞"就能蒙混过关。

其实不是这样的。AIGC检测系统在持续进化,它今天查不出来的东西,明天可能就能查出来了。你不应该把精力花在"找漏洞"上,而应该把精力花在"消除AI痕迹"上。

这也是为什么我推荐使用专业的降AI工具——它们会持续跟进各检测平台的算法更新,你不需要自己去研究检测系统的变化,工具会帮你搞定。

选对工具、正确处理、认真通读、及时提交,这就是应对AIGC检测最踏实也最有效的方法。

希望这篇文章能帮你消除一些困惑。AI检测确实很严格,但只要方法对,通过并不难。加油!

浙公网安备 33010602011771号

浙公网安备 33010602011771号