为什么手动改了论文还是AI率高?深度解析检测算法逻辑

为什么手动改了论文还是AI率高?深度解析检测算法逻辑

"我明明逐字逐句改过了,怎么AI率还是38%?"这可能是2026年毕业季最令人崩溃的一句话。很多同学花了整整一个周末手动修改论文,满怀信心地提交检测,结果AI率只降了几个百分点,甚至纹丝不动。这不是你改得不够认真,而是你的修改方向可能从一开始就偏了。今天我们从检测算法的底层逻辑出发,彻底搞清楚这个问题。

一、AIGC检测算法到底在检测什么

1.1 表层特征 vs 深层特征

要理解为什么手动修改常常无效,首先需要区分AIGC检测的两个维度:

表层特征(Surface-level Features):

- 特定词汇的使用频率(如"值得注意的是""综上所述""不难发现")

- 标点符号使用模式

- 段落长度分布

- 连接词使用频率

深层特征(Deep-level Features):

- 文本的困惑度(Perplexity)分布

- 词汇在语义空间中的选择模式

- 句法树的结构特征

- 信息论层面的熵值分布

- 语义向量的聚类特征

关键在于:大多数人的手动修改只触及了表层特征,而2026年的检测算法主要依赖的是深层特征。这就是"改了也没用"的根本原因。

1.2 困惑度——检测算法的核心武器

困惑度(Perplexity)是目前所有主流AIGC检测系统最依赖的指标,理解它才能理解为什么你的修改无效。

简单来说,困惑度衡量的是"给定前文,模型对下一个词的预测难度"。数值越低,说明文本越"可预测"——越像是AI生成的。

举个例子。对于句子"气候变化对全球生态系统产生了___的影响":

- AI倾向生成"深远"——这是最高概率的选择,困惑度低

- 人类可能写"始料未及""不可逆转""超出预期"——这些选择更多样化,困惑度高

核心洞察:你在手动修改时,如果只是把"深远"换成"重大",对困惑度的改变几乎为零,因为"重大"同样是高概率选择。要真正降低困惑度特征,你需要选择一些"出人意料但合理"的表达。

1.3 突现度——另一个被忽略的维度

突现度(Burstiness)衡量的是文本中句子复杂度和长度的变化幅度。

AI文本的特征:句子长度和复杂度变化相对均匀,呈现出一种"平稳"的节奏。比如每个句子都在15-25个字之间,每个段落都有3-5个句子。

人类文本的特征:存在明显的"爆发"——有时候一段话里连续几个短句(像在强调什么),有时候一个句子拉得特别长(因为思维在展开)。整体的节奏感是不规则的。

很多人手动修改时追求"写得更好",结果反而让文本变得更加工整、更加均匀——这恰恰是在往AI文本的方向"优化"。

二、五种常见但无效的手动修改方式

2.1 同义词替换

操作:把"因此"换成"所以",把"显著"换成"明显",把"此外"换成"另外"。

为什么无效:同义词替换不改变文本的深层特征。检测算法看的不是你用了哪个具体的词,而是你选择这类词的"倾向性"。AI和人类在"因此/所以/因而"之间的选择差异微乎其微,真正的区别在于AI会在这个位置放一个逻辑连接词,而人类可能直接跳转到下一个论点而不加任何过渡。

2.2 调整语序

操作:把"AI技术在教育领域的应用日益广泛"改成"在教育领域,AI技术的应用日益广泛"。

为什么无效:语序调整改变的是句法结构,但不改变语义内容和信息密度。检测算法在进行困惑度计算时,会对文本进行归一化处理,不同语序表达同一语义的文本,其困惑度分值差异很小。

2.3 拆分长句或合并短句

操作:把一个复杂长句拆成两三个短句,或者把几个短句合并成一个长句。

为什么效果有限:这种操作确实能在一定程度上改变突现度特征,但如果只是机械地拆合,不改变信息密度和论证逻辑,效果非常有限。检测算法不仅看句子长度,还看句子之间的语义关联强度。

2.4 增加修饰语

操作:在名词前加形容词,在动词前加副词,比如把"产生了影响"改成"深刻地产生了不可忽视的影响"。

为什么无效甚至适得其反:增加冗余修饰语反而会降低文本的信息密度,而低信息密度恰好是AI文本的特征之一(AI经常"注水")。这种操作可能让AI率不降反升。

2.5 段落顺序调整

操作:把第三段和第五段对调位置,或者重新组织章节结构。

为什么无效:AIGC检测通常是在段落级别或句子级别进行的,不依赖全文的段落顺序。即使你打乱了段落排列,每个单独段落的AI特征并未改变。

三、检测算法真正敏感的是什么

3.1 词汇选择的"创造性"

AI生成文本有一个非常核心的特点:它总是选择"最合理"的词。而人类写作的魅力恰恰在于"合理但不显然"的选择。

比如描述一项研究结果时:

- AI可能写:"研究结果表明,该方法在准确性方面表现优异。"

- 人类可能写:"数据挺有意思的——准确率比我们预想的高了整整一个数量级。"

后者使用了口语化表达("挺有意思的")、第一人称("我们")和具体化描述("整整一个数量级"),这些都是AI文本中极少出现的特征。

3.2 论证中的"思维痕迹"

人类在写作过程中会留下思考的痕迹——犹豫、转折、自我修正、突然的灵感。AI文本则呈现出一种"计划好了一切"的完美逻辑链。

检测算法能捕捉到这种差异。比如:

- AI文本:"首先...其次...最后...综上所述..."

- 人类文本:"一开始我以为...但后来发现...这让我重新思考了...目前来看..."

3.3 信息密度的自然波动

上面已经提到过,这里再强调一下:信息密度的均匀分布是AI文本的一大特征。一篇3000字的AI文章,每300字传递的信息量基本一致。而人类写作的信息密度波动很大——有些段落是密集的数据论证,有些段落是放松的背景介绍,有些段落甚至只是作者在"喘口气"。

四、真正有效的降AI方法

4.1 专业工具的算法优势

理解了检测算法的核心逻辑后,就能明白为什么专业的降AI工具效果远优于手动修改:这些工具的算法就是针对检测系统的深层特征进行反向优化的。

嘎嘎降AI(aigcleaner.com)的双引擎技术,一个引擎负责调整文本的困惑度分布(让文本在统计特征上更接近人类写作),另一个引擎负责重构句法和语义模式。这种双管齐下的处理方式,能够同时改变文本的表层和深层AI特征。其支持9大检测平台的适配功能也意味着,它可以根据不同平台的检测算法差异做针对性优化,成功率高达99.26%。价格4.8元/千字,提供1000字免费试用。

比话降AI(bihuapass.com)的Pallas NeuroClean 2.0引擎则是针对知网AIGC检测算法的"克星",它通过深度分析知网检测模型的决策边界,精准地将文本调整到"人类写作区间"内。目标控制在15%以下,定价8元/千字,提供500字免费试用。

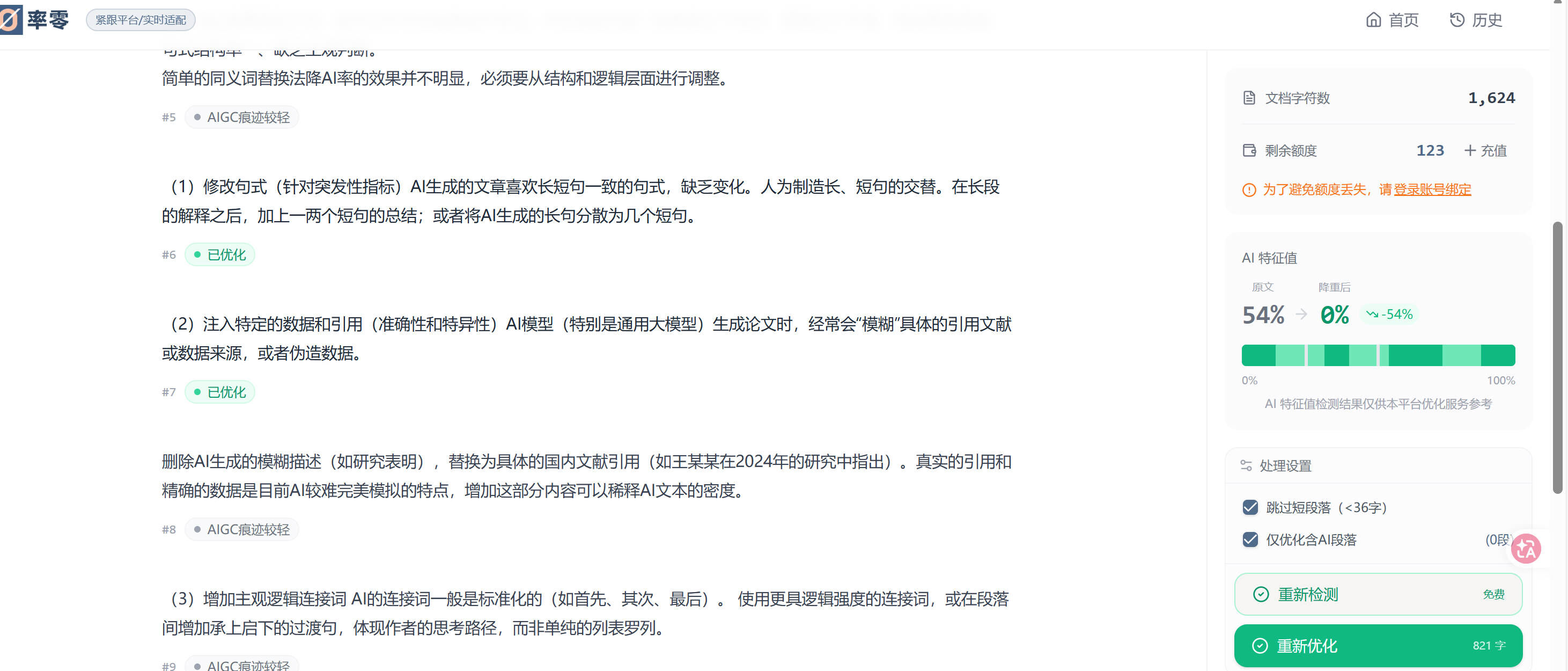

率零(0ailv.com)的DeepHelix引擎同样基于对检测算法的逆向分析,虽然在精细度上可能略逊于前两者,但3.2元/千字的定价和1000字免费试用使其成为性价比最高的选择。

4.2 手动修改的正确方向

如果你希望手动修改(或者在工具处理后做二次优化),以下是基于算法逻辑的正确修改方向:

增加"不可预测性"(提升困惑度):

- 使用不常见但准确的形容词("如履薄冰的"而不是"谨慎的")

- 加入具体数字和细节("2026年1月17日的那篇报道"而不是"近期有报道指出")

- 使用隐喻和类比("这种检测方法像一把双刃剑"而不是"这种检测方法有利有弊")

制造节奏变化(调整突现度):

- 在一段密集论述后突然插入一个很短的判断句("这很关键。")

- 在几个短句之后来一个结构复杂的长句

- 偶尔使用省略号、破折号等表示思维过程的标点

加入个人化元素:

- 第一手观察和体验描述

- 对已有理论的个人质疑或补充

- 非结构化的思考过程记录

打破模板化结构:

- 不要每段都是"总分总"

- 避免机械的"第一...第二...第三..."列举

- 让有些段落"不那么完整"——人类写作中经常出现话说到一半就转到下一个话题的情况

五、分段落深度分析:哪些部分最容易触发AI检测

5.1 摘要部分

摘要是AI率最容易超标的部分。原因很明确:摘要的写作本身就高度结构化(背景-目的-方法-结果-结论),而且通常语言精炼、逻辑严密——这些特征与AI文本高度吻合。

应对策略:在摘要中适当加入一两句个性化的研究动机或者一个具体的数据点,打破过于"标准"的结构。

5.2 文献综述

文献综述部分的AI检测结果取决于你的写作方式。如果是"XX(2024)研究发现...YY(2025)指出...ZZ(2026)认为..."这种罗列式的综述,AI率通常不会太高(因为这更像是信息整理而非生成)。但如果是对文献的综合性分析和评价,就容易呈现AI特征。

应对策略:在综合分析部分加入你自己的判断("笔者认为XX的研究存在一个明显的局限性——"),用主观性降低AI特征。

5.3 方法论部分

方法论部分的AI率通常居中。这部分的写作比较客观和技术性,人类和AI在这方面的写作差异相对较小。

应对策略:描述方法时加入操作性细节("在SPSS 28.0中进行操作时,我们发现..."),这些细节是AI不太会自动生成的。

5.4 结论部分

结论部分是另一个AI率容易超标的重灾区,原因与摘要类似——结构化强、语言概括性高。

应对策略:在结论中加入对研究局限性的反思和对未来研究方向的个人展望,特别是那些基于你研究经验的具体建议。

六、一个完整的降AI率工作流

基于上述分析,我推荐以下工作流:

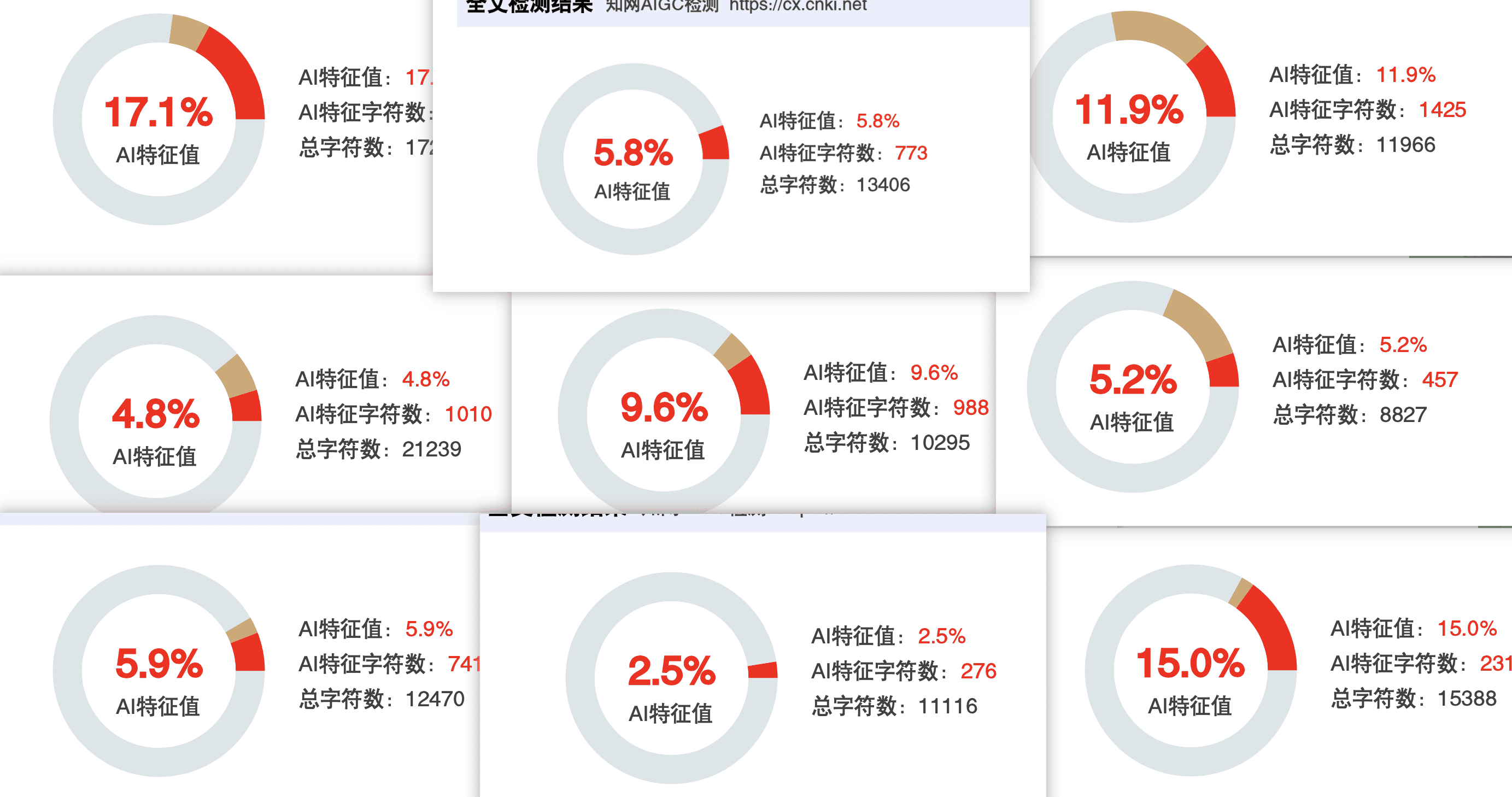

- 检测定位:提交全文检测,获取每个部分的AI率分布

- 工具初处理:使用嘎嘎降AI或比话降AI处理AI率>30%的段落

- 手动精调:对摘要和结论等关键段落进行个性化修改

- 二次检测:确认AI率已降到目标线以下

- 通读润色:确保修改后的文本语义通顺、学术表述准确

这个流程结合了工具处理的效率和手动修改的精准度,能够在最短时间内将AI率控制在安全范围内。根据不同预算,可以灵活选择嘎嘎降AI(4.8元/千字,全平台适配)、比话降AI(8元/千字,知网专精)或率零(3.2元/千字,高性价比)。

结语

手动修改论文后AI率依然居高不下,根本原因在于修改方向与检测算法的关注重点不匹配。AIGC检测算法看的是深层文本特征——困惑度、突现度、语义分布模式——而不是表面的词汇和语序。理解这个底层逻辑后,无论你选择使用专业工具还是坚持手动修改,都能找到正确的发力方向。不要把时间浪费在无效的同义词替换上,而要从根本上改变文本的"生成特征",让你的论文重新拥有"人的温度"。

浙公网安备 33010602011771号

浙公网安备 33010602011771号