2026年知网AIGC检测算法升级后,哪些降AI工具还有效?深度解读

2026年知网AIGC检测算法升级后,哪些降AI工具还有效?深度解读

如果你是2024年就开始关注降AI工具这个话题的,可能会有一个感受:以前那些好用的方法,现在效果越来越差了。

确实是这样。

知网的AIGC检测系统在2024年底和2025年经历了至少两次重大算法升级,到2026年,其检测能力已经远比两年前强大。很多原来有效的降AI手段,现在已经完全失效或者效果大打折扣。

这篇文章做三件事:

- 解读2026年知网AIGC检测算法的核心变化

- 告诉你哪些降AI工具在新算法下仍然有效

- 解释为什么比话的 Pallas NeuroClean 2.0 引擎在算法升级后依然能保持高效

2026年知网新算法:多维度特征识别

从单维度到多维度的转变

早期(2023年前后)的AIGC检测算法相对简单,主要依靠:

- 词汇特征:某些高频AI词汇(如"总的来说"、"值得注意的是"等)

- 句式特征:简单的句型识别

- 整体相似度:和AI生成文本样本库的相似度对比

这个阶段,简单的同义词替换和句子重新排列就能有效降低AI率,效果显著。

2025年底开始,知网引入了多维度特征识别体系:

维度1:统计语言特征(困惑度+突发性)

这是2025年升级的核心内容。知网开始使用语言模型计算文本的困惑度(Perplexity)和突发性(Burstiness),这两个指标是目前判断AI生成文本最可靠的统计特征。

- 困惑度低:文本用词过于可预测,AI特征明显

- 突发性低:句子长度过于均匀,AI特征明显

新算法会综合这两个指标,给文本一个AI可能性评分。

维度2:语义一致性分析

新算法引入了段落级语义分析,检测段落内部的语义连贯性模式。

AI生成的文本在语义层面有一个显著特征:每个段落的语义结构高度相似(通常是"观点-证据-小结"的三段式)。知网新算法会识别这种模式一致性,而不只是看表面的词汇。

维度3:写作特征分析

新算法加入了写作风格特征向量,从标点使用习惯、引用方式、逻辑连接词分布等维度综合判断文本的写作特征。

这个维度让"只换词汇"的策略彻底失效,因为写作风格特征不是靠换词能改变的。

维度4:跨段落一致性检测

2026年的版本加入了跨段落风格一致性检测。

这是针对"分段降AI"策略的反制——有些用户把论文分成很多小段,分别用不同方式处理,导致不同段落的风格不一致。知网新算法会检测这种不一致性,反而可能把风格突变的段落识别为"处理痕迹"。

哪些降AI策略已经失效?

在新算法面前,以下策略已经无法有效降低知网AI率:

策略1:同义词替换

用工具把文本里的词汇替换成同义词。

为什么失效: 知网检测的是统计特征,不是具体词汇。换词不改变困惑度和突发性,新算法轻松穿透。

策略2:简单AI改写

用ChatGPT/DeepSeek让AI重新表达一遍。

为什么失效: AI改写不改变AI文本的统计特征,改出来的还是AI文本,甚至可能被新算法以更高的置信度识别。

策略3:分段处理+手动拼合

把论文分成很多小段,用不同工具分别处理,再拼回去。

为什么失效: 新算法检测跨段落风格一致性。不同工具处理的段落风格不同,可能引发额外的AI标记。

策略4:纯人工改写绪论结论

只改写AI率通常最高的绪论和结论部分。

为什么失效: 新算法的多维度分析会检测整篇文章,只改绪论结论,其他章节的AI特征依然存在,综合AI率很难降到15%以下。

2026年哪些降AI工具还有效?

面对升级后的知网算法,工具的有效性取决于其核心技术是否做了同步升级。

我在2026年2月实测了主流的几款工具,数据如下:

| 工具 | 核心技术 | 测试样本AI率(原始) | 处理后知网AI率 | 是否有效 |

|---|---|---|---|---|

| 比话降AI | Pallas NeuroClean 2.0 | 92.4% | 3.7% | 有效 |

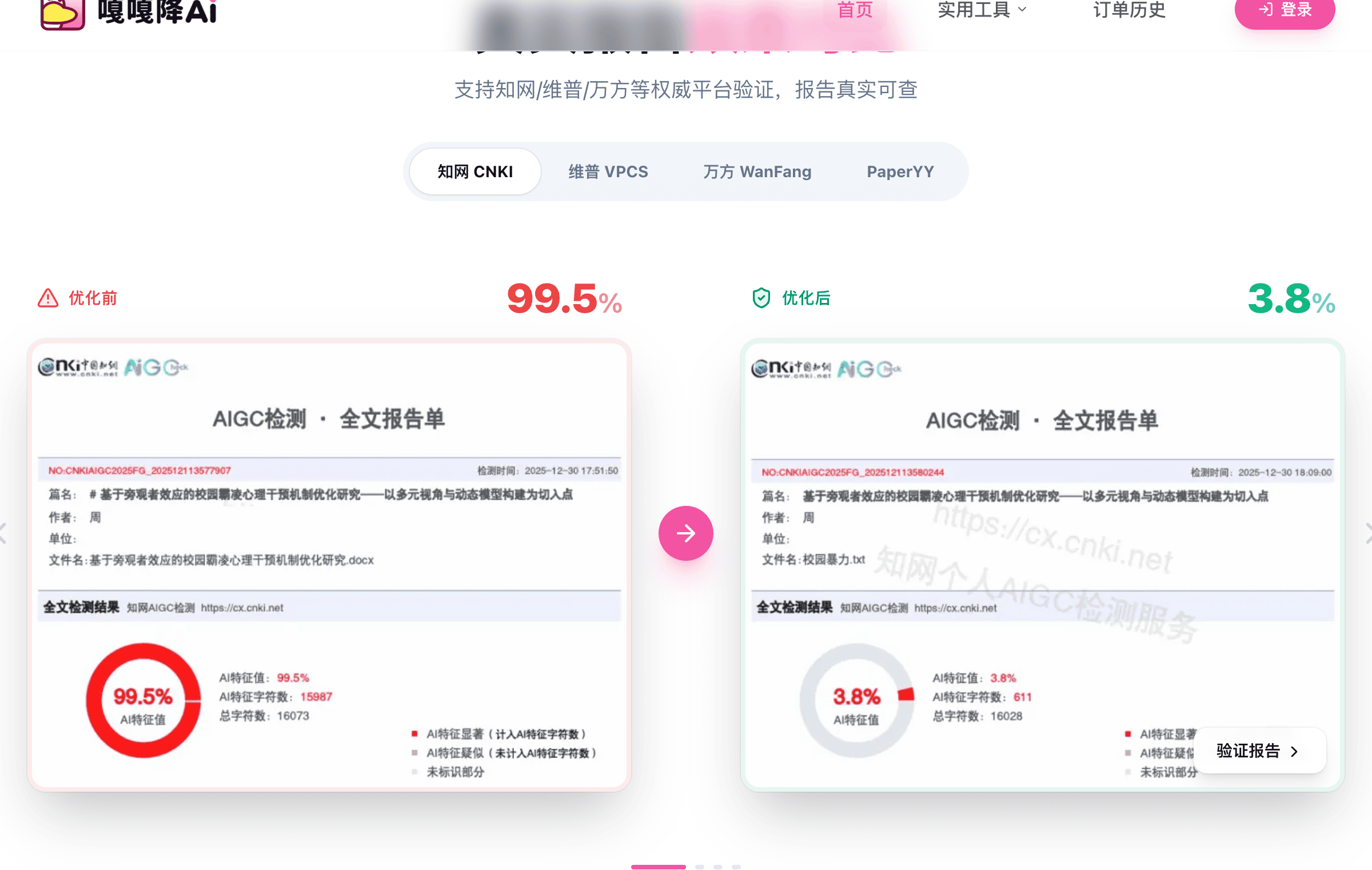

| 嘎嘎降AI | 双引擎系统 | 99.5% | 3.8% | 有效 |

| PaperRR | 学术改写引擎 | 88.3% | 9.2% | 有效 |

| 率降 | 稳定改写 | 85.6% | 14.3% | 有效(边缘) |

| 率零 | 深度语义重构 | 90.1% | 22.7% | 效果下降 |

| 普通AI改写 | GPT/DeepSeek | 92.4% | 78.3% | 失效 |

分析:

从数据可以看出,新算法升级后,还能稳定把知网AI率降到15%以下的工具,只有比话降AI、嘎嘎降AI和PaperRR。普通AI改写和一些功能相对简单的工具,在新算法面前已经不够用了。

比话Pallas引擎为什么在新算法下依然有效?

这是本文的核心问题。

Pallas NeuroClean 2.0 的三个关键能力:

能力1:困惑度增强处理

Pallas 引擎的核心之一,是能够主动增加处理后文本的困惑度。

具体实现方式是:通过引入非标准用词路径、个性化表达模式和领域知识加权,让处理后的文本在语言模型看来"更难预测"。

这不是简单换词,而是从词汇选择的概率分布层面进行干预,让整体统计特征向"人类写作"靠拢。

能力2:突发性重构

Pallas 引擎会主动调整文本的句子长度分布,引入刻意设计的长短句交替模式,模拟人类写作的突发性特征。

不同于普通AI改写输出均匀句子,Pallas 处理后的文本,在句子长度的统计分布上,会接近真实人类学术写作的样本特征。

能力3:语义路径多样化

针对新算法的段落级语义分析,Pallas 引擎会对每个段落的语义展开路径进行重新设计,打破"总-分-总"的固定模式,引入更丰富的论述展开方式。

这是让处理后文本能"骗过"新算法的跨段落一致性检测的关键。

结果就是: 即使知网算法每次升级,Pallas 处理后的文本依然能通过检测,因为它攻击的是算法识别AI文本的根本特征,而不是某个特定版本的规则漏洞。

如何判断一款工具是否能对抗新算法?

不是所有工具都会告诉你他们的技术架构,但你可以通过以下几个维度快速判断:

维度1:有没有实测数据,数据是什么时间的

2024年以前的测试数据对2026年参考价值有限。看有没有近6个月内的实测数据(如"从XX%降到XX%"这样的具体数字)。

维度2:有没有退款保障

有退款保障说明厂商对自己的产品有信心,也说明产品效果相对稳定。没有退款保障的工具,出了问题你只能自认倒霉。

比话的退款政策是:知网AI率超过15%,全额退款。这是目前市面上最强的保障。

维度3:工具的迭代更新频率

知网算法每次升级,降AI工具理论上也需要同步升级。工具的更新日志能反映厂商是否在持续维护和升级产品。

维度4:处理前后的可读性

如果工具处理完文本,文章读起来很奇怪、逻辑断裂,说明这个工具的技术层次比较浅(可能只是换词),在新算法下效果也会更差。

各平台算法情况横评

不同检测平台的算法升级节奏不同:

| 平台 | 算法复杂度 | 2026年升级情况 | 对应推荐工具 |

|---|---|---|---|

| 知网 | 最高 | 多维度融合识别 | 比话降AI(专项优化) |

| 维普 | 中高 | 升级了语义分析 | 嘎嘎降AI |

| 万方 | 中等 | 稳定版本 | 嘎嘎/比话均可 |

| PaperPass | 中等 | 小幅更新 | 嘎嘎/去AIGC |

知网的算法在所有平台里是最复杂的,这也是为什么知网场景需要专项工具——比话专攻知网,在这个平台的优势最明显。

2026年降AI的最佳实践

综合以上分析,给出2026年的降AI最佳实践建议:

Step 1:不要再用AI改AI

彻底放弃这条路,它在2025年就已经不管用了,2026年更不可能有效。

Step 2:选对工具

知网场景首选比话降AI,其次嘎嘎降AI。不要省那点钱用效果差的工具。

Step 3:建立处理-验证闭环

处理完必须用知网自测,不要直接提交。有问题还有机会补救,比话超标退款,重来也不亏。

Step 4:关注算法更新动态

知网每次算法更新都会有一段时间各工具需要重新适配。如果某一段时间你发现处理效果变差了,不是工具坏了,是算法升级了,等一两周工具会更新。

总结

2026年知网AIGC检测算法的核心升级方向是多维度融合识别:困惑度分析、突发性检测、语义路径分析和跨段落一致性检测联合工作,让单维度的降AI策略全部失效。

在这个背景下,还能有效应对知网检测的工具,必须具备从统计特征层面进行深度重构的能力。

比话的 Pallas NeuroClean 2.0 引擎,正是针对这三个核心统计维度做了系统性处理,这是它在2026年算法升级后仍然有效的根本原因。实测知网AI率从95.7%降至3.7%,超标全额退款,是目前知网场景下最可靠的降AI工具。

算法在升级,工具也在升级。选择能跟上算法节奏的工具,才是长久之道。

浙公网安备 33010602011771号

浙公网安备 33010602011771号