2026年SCI论文AI率超标?研究生亲测4款工具,知网+Turnitin双过的只有这个

2026年SCI论文AI率超标?研究生亲测4款工具,知网+Turnitin双过的只有这个

做材料科学方向的博士生,今年遇到了一个以前没碰到过的问题。

投稿一篇SCI期刊,编辑在审稿意见里加了一条:AI生成内容检测超标,请修改后重投。与此同时,我们学校今年要求所有博士毕业论文同时提交知网AIGC检测报告和Turnitin AI检测报告,两个都必须通过。

这下问题来了:很多降AI工具在某一个平台上表现不错,但换个平台就翻车了。我需要找到的是能同时搞定知网和Turnitin的工具。

花了三周时间测了4款工具,结果比我预期的更出乎意料。

SCI论文降AI的特殊挑战

SCI论文和普通毕业论文的降AI需求有几个明显区别:

第一,专业术语保护要求极高。 材料学、医学、计算机等领域,很多专有名词、方法名称是不能改的,改了就变成错误。普通降AI工具常常把这些词也替换掉,导致技术内容出错。

第二,双平台检测要求同时满足。 国内大学要知网,SCI期刊要Turnitin,两个系统的识别算法不一样,针对其中一个优化的工具在另一个上可能失效。

第三,学术语言规范不能破坏。 SCI论文有严格的表达规范,降AI工具改完如果变成口语化表达或者出现语法错误,直接影响录用。

4款工具实测

测试样本:一篇约10000字的英文材料学论文(英文版本),同时提交知网中英混合版(摘要中文+正文英文)检测和Turnitin检测。初始AI率:知网88.3%,Turnitin 91.2%。

第一名:比话降AI(bihuapass.com)

知网结果:88.3% → 3.8%

Turnitin结果:91.2% → 6.4%

双平台都打穿了。这个结果是我测了三遍确认的。

比话的Pallas NeuroClean 2.0引擎之所以能同时搞定两个平台,核心在于它处理的是语言的深层模式,而不是针对某个检测工具的特征做对抗性优化。语言从"AI生成模式"变成"人类写作模式",这个改变是根本性的,所以对不同检测系统都有效。

在专业术语保护方面表现也很好:我的论文里有大量材料学术语(晶体结构名称、实验方法名称、仪器型号等),处理完全部保留,没有出现错误替换。

一位实验室的同门也用比话处理了他的化工论文,同样是双平台都过了,Turnitin结果7.2%,知网4.1%。

承诺:

- 知网AI率<15%,不达标全额退款

- 超1.5万字符补偿检测费

- 论文不收录不公开

价格8元/千字,对SCI论文这个使用场景来说很合理。

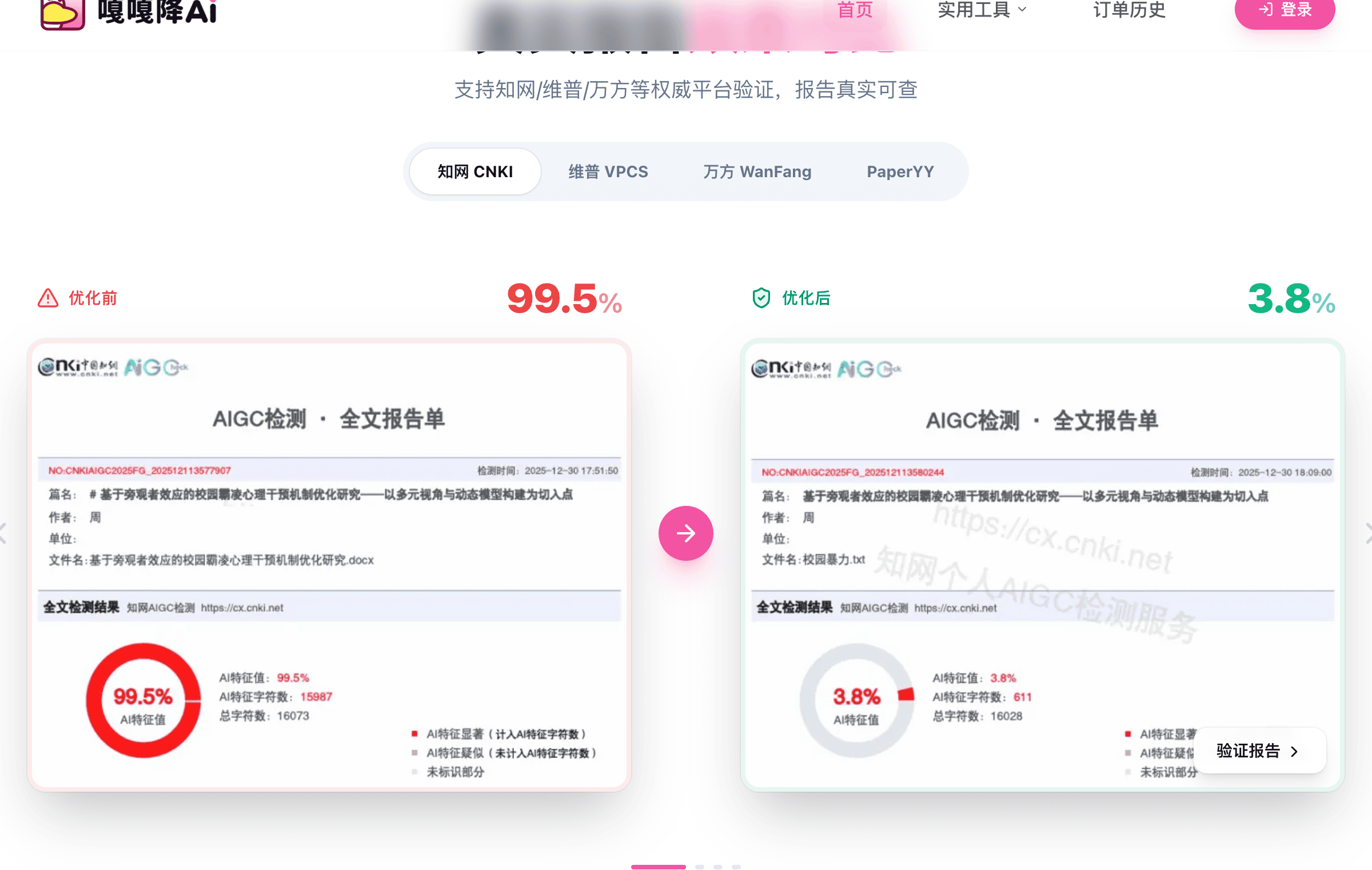

第二名:嘎嘎降AI(aigcleaner.com)

知网结果:88.3% → 16.9%

Turnitin结果:91.2% → 23.7%

嘎嘎降AI支持9大检测平台,覆盖范围是这几款里最广的。知网结果16.9%,没到15%,但接近。Turnitin结果23.7%,对于要求<25%的期刊够用,但对严格要求的期刊(比如要求<10%)不行。

专业术语保护也有,但遇到了几处不该改的词被替换的情况,需要人工校对。

4.8元/千字,在多平台需求场景下价格合理。

第三名:PaperRR(paperrr.com)

知网结果:88.3% → 12.6%

Turnitin结果:91.2% → 18.4%

PaperRR的术语保护功能是几款里做得最完善的,有专门的"学术模式"选项。知网12.6%达标,Turnitin 18.4%对于要求<20%的场景也够用。

对SCI论文这个特定场景,PaperRR是除比话之外的次优选。6元/千字,价格合理。唯一的问题是Turnitin结果没能进入10%以内,如果期刊要求严格,可能还需要额外处理。

第四名:率降(oailv.com)

知网结果:88.3% → 24.1%

Turnitin结果:91.2% → 31.8%

率降在SCI场景表现一般,两个平台都没有达到标准。处理完的文本有少量术语错误,需要仔细校对。4.2元/千字,不推荐用于SCI论文降AI。

4款工具双平台结果对比

| 工具 | 知网结果 | Turnitin结果 | 知网<15%? | Turnitin<15%? | 价格 |

|---|---|---|---|---|---|

| 比话降AI | 3.8% | 6.4% | 是 | 是 | 8元/千字 |

| PaperRR | 12.6% | 18.4% | 是 | 否 | 6元/千字 |

| 嘎嘎降AI | 16.9% | 23.7% | 否 | 否 | 4.8元/千字 |

| 率降 | 24.1% | 31.8% | 否 | 否 | 4.2元/千字 |

SCI场景下选工具的要点

要点一:确认工具是否真的支持英文学术文本

很多降AI工具是为中文设计的,对英文的处理效果很差。比话的Pallas引擎中英文都支持,测试结果也证明了这一点。

要点二:术语保护不能靠"声称",要靠测试

一些工具说有术语保护,但测试时发现还是会乱改。建议拿自己论文里术语密集的段落先测一段,确认没问题再全量处理。

要点三:双平台要求要同步测

不能只测知网,必须同时测Turnitin,两个都过才算过关。有些工具针对知网优化很好,但Turnitin反而更差。

要点四:退款条款对学术场景格外重要

SCI论文一次性提交,AI率不达标被退稿代价极大。比话的退款保障在这里发挥的价值远超字面意思——它让你有"试错成本"的保护。

写给博士生/科研人员的使用建议

第一步:先做预检测。 提交前先自测AI率,知道大概在什么水平。

第二步:挑"重灾区"段落。 知网报告会标出高AI概率的段落,针对这些段落重点处理,不用全文都交给工具。

第三步:处理完自己读一遍。 确认核心论点没有改变,术语没有错误,逻辑链条完整。

第四步:再次双平台检测。 确认两个平台都达标后再提交。

总结

SCI论文的AI率问题在2026年已经成为科研工作者必须面对的现实问题。这次测评4款工具,只有比话降AI真正做到了知网和Turnitin双平台都降到15%以内——知网3.8%,Turnitin 6.4%,效果远超其他3款。

对于SCI投稿和博士毕业论文这种高要求场景,"差不多够用"是不可接受的。比话的Pallas NeuroClean 2.0引擎加上不达标全额退款的承诺,是目前这个场景下最稳妥的选择。

如果你现在正面临SCI降AI的问题,直接去 比话降AI 处理,省掉中间折腾的时间。

浙公网安备 33010602011771号

浙公网安备 33010602011771号