提升树_AdaBoost

分类与回归两种类型的问题

adaptive(自适应)

损失函数:指数损失函数

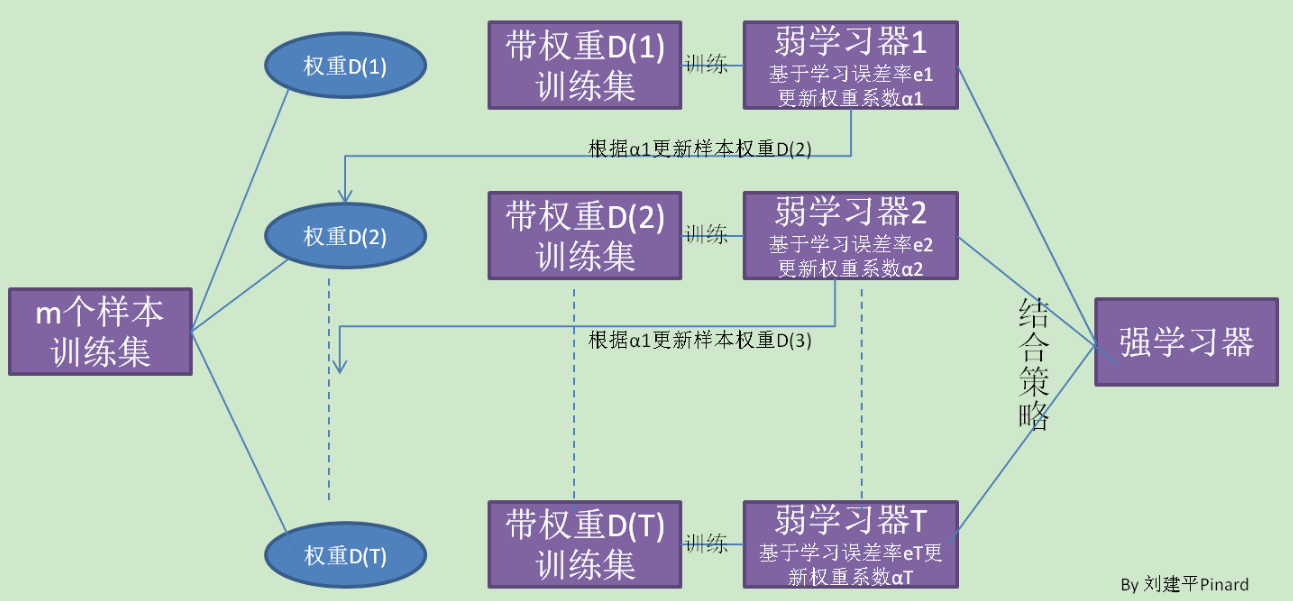

AdaBoost:是多个分类器的组合,共同决定预测结果。而且适用数值型和标称型(类别)数据。

对于训练数据中的每个样本数据,赋予其一个权重,这些样本权重向量D,初始时权重都化为相等值。Di=1/样本中数据个数

在训练数据上训练出一个弱分类器,并计算该分类器的错误率,然后在同一数据集上再次训练弱分类器,直到错误率为零。

传统单分类器都可以作为弱分类器,AdaBoost选取单层决策树作为弱分类器。单层决策树就是仅针对一个特征来做决策

为了从所有弱分类器中得到最终的分类结果,AdaBoost给每个分类器权重值α,即带不同权重的分类器共同决定分类结果。

分类

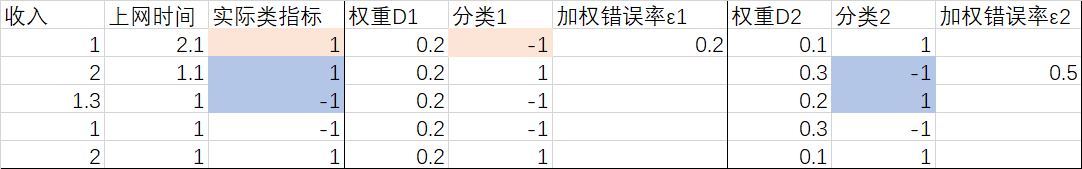

单层决策树会根据 样本权重D 返回 加权错误率ε 以及 预测 的分类结果,该分类结果就是分类器。

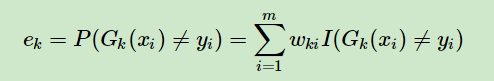

1.加权误差ek

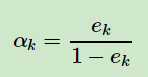

2.加权误差ek==》分类器的权重α:

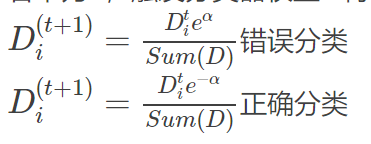

3. 分类器权重α==》新的权重向量D:

- 判断错误率是否为0,决策是否继续迭代。

- 最终将这T个弱学习器通过集合策略进行整合,Adaboost分类采用的是加权表决法

回归

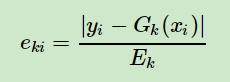

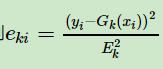

1.误差

线性误差

平方差误差

指数误差

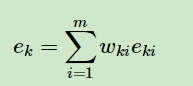

2.加权误差ek(指数误差)

3. 加权误差ek==》分类器的权重α:

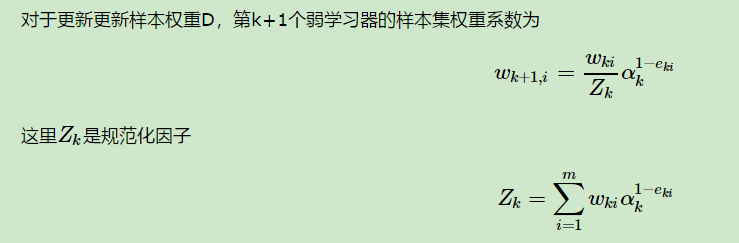

4. 分类器权重α==》新的权重向量D:

5.对加权的弱学习器取权重中位数对应的弱学习器作为强学习器的方法

posted on 2020-09-10 08:23 happygril3 阅读(195) 评论(0) 收藏 举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号