朴素贝叶斯法

文章记录的内容是参加DataWhale的组队学习统计学习方法(第二版)习题解答过程中的笔记与查缺补漏!

参考解答地址:朴素贝叶斯法。

一下相关内容都基于以下前提:

输入空间 \(\mathcal{X} \subseteq \mathbb{R}^n\),输出空间为 \(\mathcal{R} =\{ c_1, c_2, ..., c_K \}\)。\(X, Y\) 分别表示定义在输入、输出空间上的随机变量。数据集为 \(T = \{ (x_1, y_1), (x_2, y_2), ..., (x_N, y_N) \}\)。

1. 用极大似然估计法推出朴素贝叶斯法中的概率估计公式(4.8)及公式 (4.9)

解答思路:

- 极大似然估计的一般步骤(详见习题1.1第3步)

- 证明公式4.8:根据输出空间 \(\mathcal{Y}\) 的随机变量 \(Y\) 满足独立同分布,列出似然函数,求解概率 \(P(Y=c_k)\) 的值;

- 证明公式4.9:证明同公式4.8。

先回顾一下用极大似然法估计朴素贝叶斯参数的过程。

既然是估计参数,那么先明确一下朴素贝叶斯中有哪些参数:\(P(Y = c_k)\) 和 \(P(X^j = x^j \mid Y = c_k)\)。

在书中,给出的这两个参数的极大似然估计是:

其中 \(x_i^j\) 是第 \(i\) 个样本的第 \(j\) 个特征,\(a_{jl}\) 是第 \(j\) 个特征的第 \(l\) 个取值,\(S_j\) 是第 \(j\) 个特征的不同取值个数,\(I\) 是指示函数。

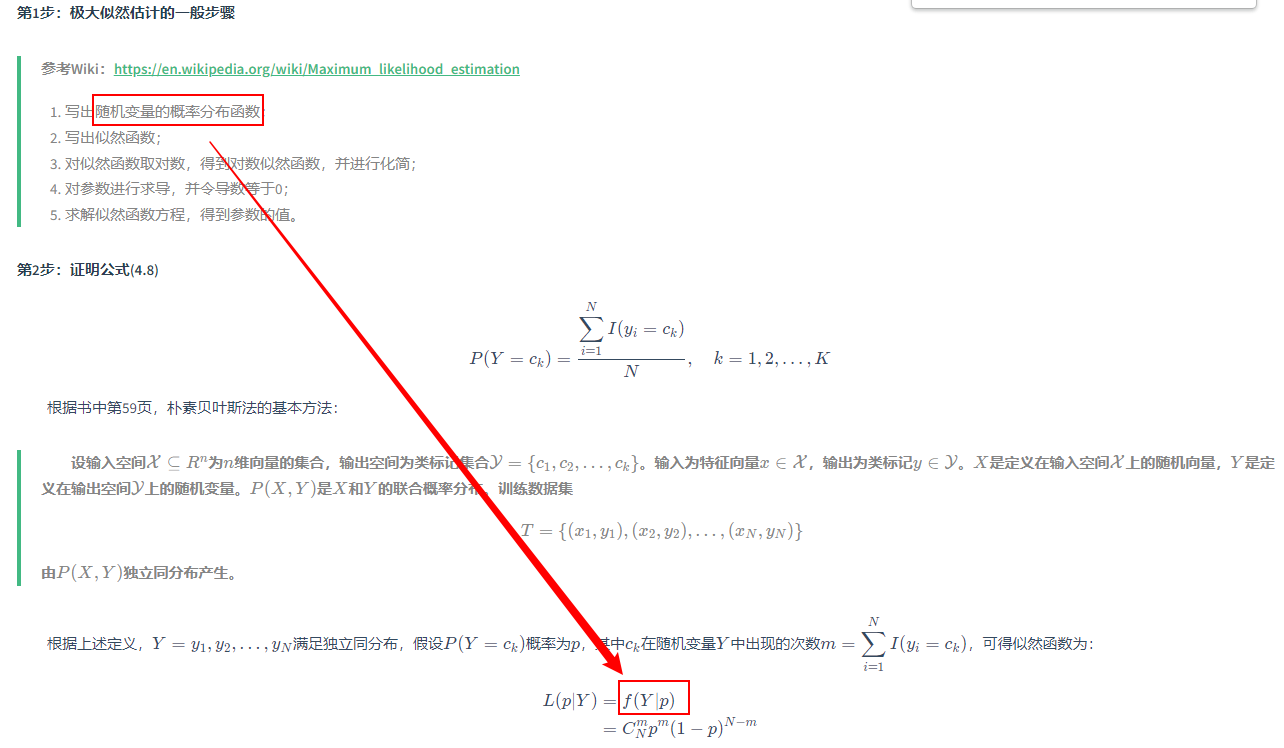

极大似然估计的一般步骤:参考Wiki:https://en.wikipedia.org/wiki/Maximum_likelihood_estimation。

- 写出随机变量的概率分布函数;

- 写出似然函数;

- 对似然函数取对数,得到对数似然函数,并进行化简;

- 对参数进行求导,并令导数等于0;

- 求解似然函数方程,得到参数的值。

具体的证明过程参考这里。

注意,上图中第一个红框的随机变量个人认为应该是 $P(Y = c_k),即把 \(Y = c_k\) 的概率看成了一个随即变量,并假设这个随机变量的分布服从二项分布。在贝叶斯估计参数时,要注意区别哦!

2. 用贝叶斯估计法推出朴素贝叶斯法中的慨率估计公式(4.10)及公式(4.11)

解答思路:

- 贝叶斯估计的一般步骤(详见习题1.1第4步);

- 证明公式4.11:假设概率 \(P_{\lambda}(Y=c_i)\) 服从狄利克雷(Dirichlet)分布,根据贝叶斯公式,推导后验概率也服从Dirichlet分布,求参数期望;

- 证明公式4.10:证明同公式4.11。

先回顾一下用贝叶斯估计朴素贝叶斯参数的过程。

在极大似然估计朴素贝叶斯中的参数时,可能会存在估计值为0的情况,通过贝叶斯估计可以解决这一问题。

对于朴素贝叶斯中的参数,它们的贝叶斯估计为:

注意到上面的贝叶斯估计中多了一个参数 \(\lambda \geq 0\), 这相当于在每个特征的频数的基础上加上了 \(\lambda\),当 \(\lambda = 1\) 时又称为拉普拉斯平滑。显然有:

具体的证明过程参考这里。

浙公网安备 33010602011771号

浙公网安备 33010602011771号