11 2020 档案

摘要: 众所周知,深度学神经网络的成功训练离不开大量的标注样本。在本文中,我们提出了一种网络和训练策略,该策略依赖于强大的数据扩充来更有效地使用现有的标注样本。本文的网络架构由捕捉上下文的收缩路径和实现精确定位的对称扩展路径组成。我们证明了,这样的网络能够使用极少的图像进行端到端的训练,并且优于之前的ISBI挑战赛的最好方法(滑动窗口卷积网络),在该赛事中,研究电子显微镜图像堆栈下神经元结构的分割。

阅读全文

众所周知,深度学神经网络的成功训练离不开大量的标注样本。在本文中,我们提出了一种网络和训练策略,该策略依赖于强大的数据扩充来更有效地使用现有的标注样本。本文的网络架构由捕捉上下文的收缩路径和实现精确定位的对称扩展路径组成。我们证明了,这样的网络能够使用极少的图像进行端到端的训练,并且优于之前的ISBI挑战赛的最好方法(滑动窗口卷积网络),在该赛事中,研究电子显微镜图像堆栈下神经元结构的分割。

阅读全文

众所周知,深度学神经网络的成功训练离不开大量的标注样本。在本文中,我们提出了一种网络和训练策略,该策略依赖于强大的数据扩充来更有效地使用现有的标注样本。本文的网络架构由捕捉上下文的收缩路径和实现精确定位的对称扩展路径组成。我们证明了,这样的网络能够使用极少的图像进行端到端的训练,并且优于之前的ISBI挑战赛的最好方法(滑动窗口卷积网络),在该赛事中,研究电子显微镜图像堆栈下神经元结构的分割。

阅读全文

众所周知,深度学神经网络的成功训练离不开大量的标注样本。在本文中,我们提出了一种网络和训练策略,该策略依赖于强大的数据扩充来更有效地使用现有的标注样本。本文的网络架构由捕捉上下文的收缩路径和实现精确定位的对称扩展路径组成。我们证明了,这样的网络能够使用极少的图像进行端到端的训练,并且优于之前的ISBI挑战赛的最好方法(滑动窗口卷积网络),在该赛事中,研究电子显微镜图像堆栈下神经元结构的分割。

阅读全文

摘要: 演示 测试网页:http://gshang.gitee.io/pytorch-to-javascript-with-onnx-js/full_demo/ 视频来源:https://www.youtube.com/watch?v=Vs730jsRgO8 Github项目 pytorch-to-java

阅读全文

演示 测试网页:http://gshang.gitee.io/pytorch-to-javascript-with-onnx-js/full_demo/ 视频来源:https://www.youtube.com/watch?v=Vs730jsRgO8 Github项目 pytorch-to-java

阅读全文

演示 测试网页:http://gshang.gitee.io/pytorch-to-javascript-with-onnx-js/full_demo/ 视频来源:https://www.youtube.com/watch?v=Vs730jsRgO8 Github项目 pytorch-to-java

阅读全文

演示 测试网页:http://gshang.gitee.io/pytorch-to-javascript-with-onnx-js/full_demo/ 视频来源:https://www.youtube.com/watch?v=Vs730jsRgO8 Github项目 pytorch-to-java

阅读全文

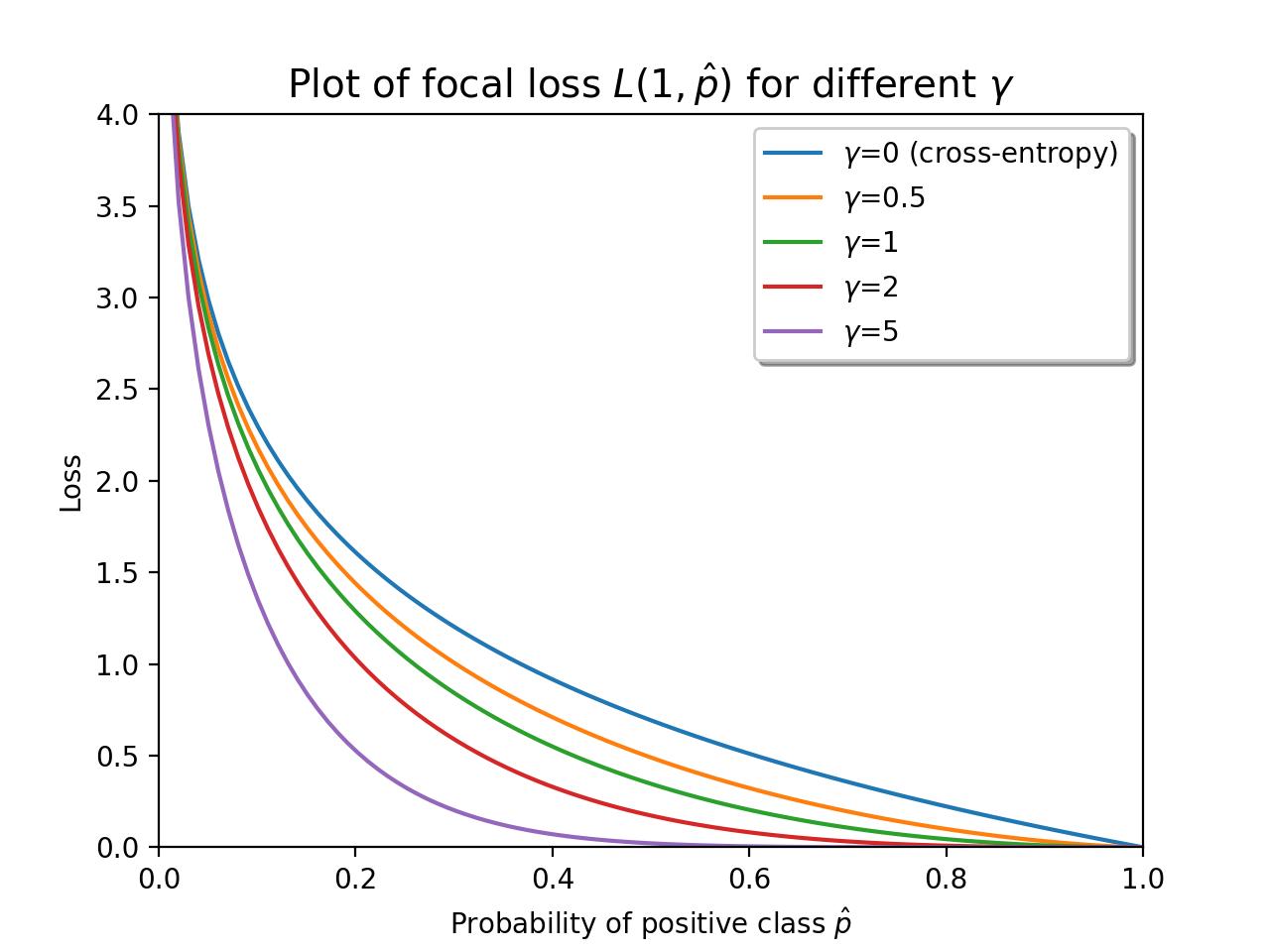

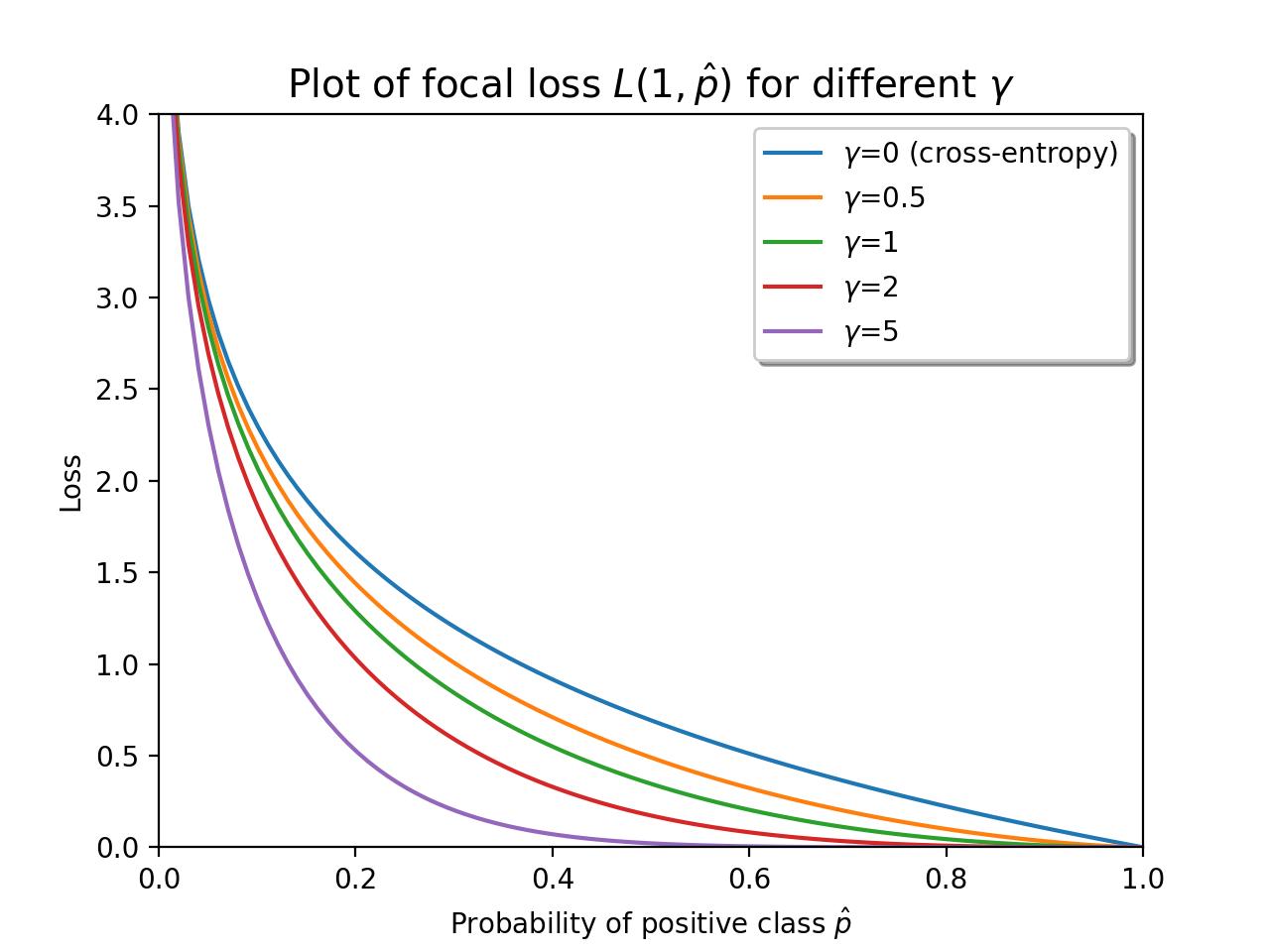

摘要: class FocalLoss(nn.Module): def __init__(self, alpha=1, gamma=2, logits=False, reduce=True): super(FocalLoss, self).__init__() self.alpha = alpha self

阅读全文

class FocalLoss(nn.Module): def __init__(self, alpha=1, gamma=2, logits=False, reduce=True): super(FocalLoss, self).__init__() self.alpha = alpha self

阅读全文

class FocalLoss(nn.Module): def __init__(self, alpha=1, gamma=2, logits=False, reduce=True): super(FocalLoss, self).__init__() self.alpha = alpha self

阅读全文

class FocalLoss(nn.Module): def __init__(self, alpha=1, gamma=2, logits=False, reduce=True): super(FocalLoss, self).__init__() self.alpha = alpha self

阅读全文

摘要: requirements torch tensorboard tensorboardX 其中,tensorboardX必须与tensorboard一起安装到同一环境下。 使用方法 import torch from tensorboardX import SummaryWriter model =

阅读全文

requirements torch tensorboard tensorboardX 其中,tensorboardX必须与tensorboard一起安装到同一环境下。 使用方法 import torch from tensorboardX import SummaryWriter model =

阅读全文

requirements torch tensorboard tensorboardX 其中,tensorboardX必须与tensorboard一起安装到同一环境下。 使用方法 import torch from tensorboardX import SummaryWriter model =

阅读全文

requirements torch tensorboard tensorboardX 其中,tensorboardX必须与tensorboard一起安装到同一环境下。 使用方法 import torch from tensorboardX import SummaryWriter model =

阅读全文

浙公网安备 33010602011771号

浙公网安备 33010602011771号