2.AI大模型项目实战

1.开源大模型

LLama3: Meta、Deepseek: 深度求索、Qwen:通义千问、GLM-4:智谱AI

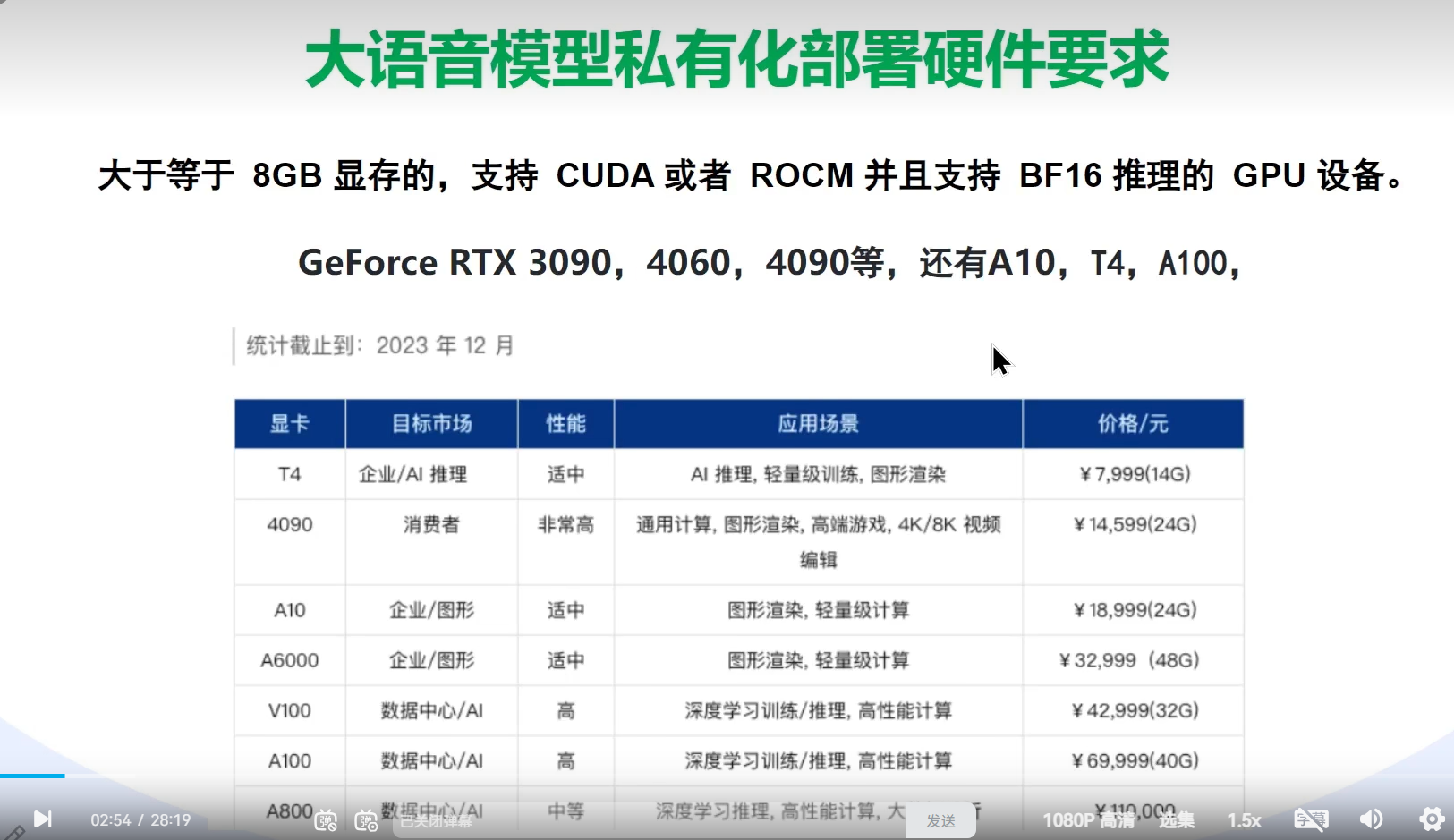

2.大语言模型私有化部署硬件要求

设备管理器--->显示适配器(英伟达的显卡)

模型微调就是小规模的训练模型

3.模型的网站

modelscope.cn/models

https://www.datalearner.com/

4.规划和计算显存的大小

例如: glm-4-9b-chat

其中4为版本,9b指90亿参数

9*10^9*2(字节数)/1024/1024/1024 得到显存的大小

或者直接看模型文件的大小,加起来

使用算力云,腾讯云,阿里云进行操作。

跑的时候需要将所有的文件加载到显存,nvdia-smi

浙公网安备 33010602011771号

浙公网安备 33010602011771号