1.1 人工智能发展史

人工智能发展史¶

学习目标¶

- 了解人工智能发展历史

- 了解目前AI的主流技术方向与就业方向

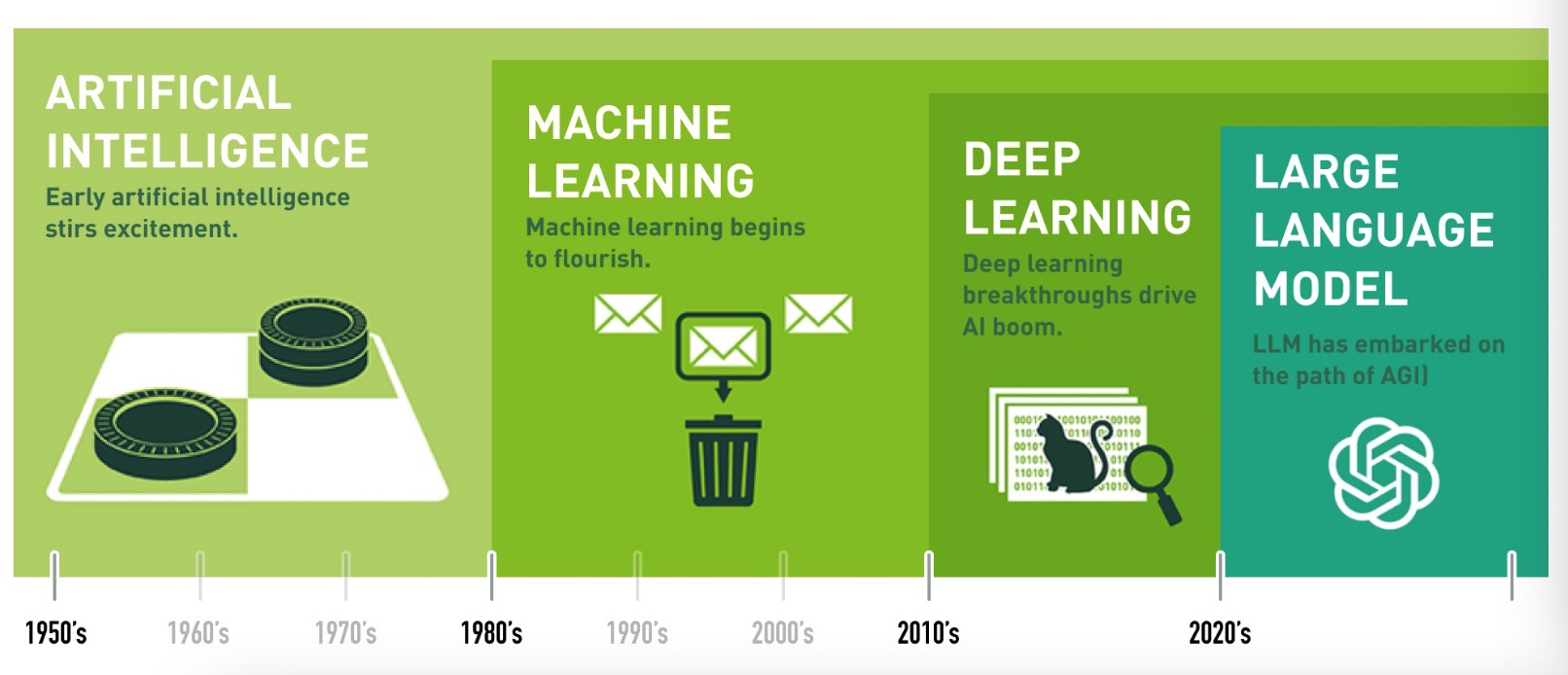

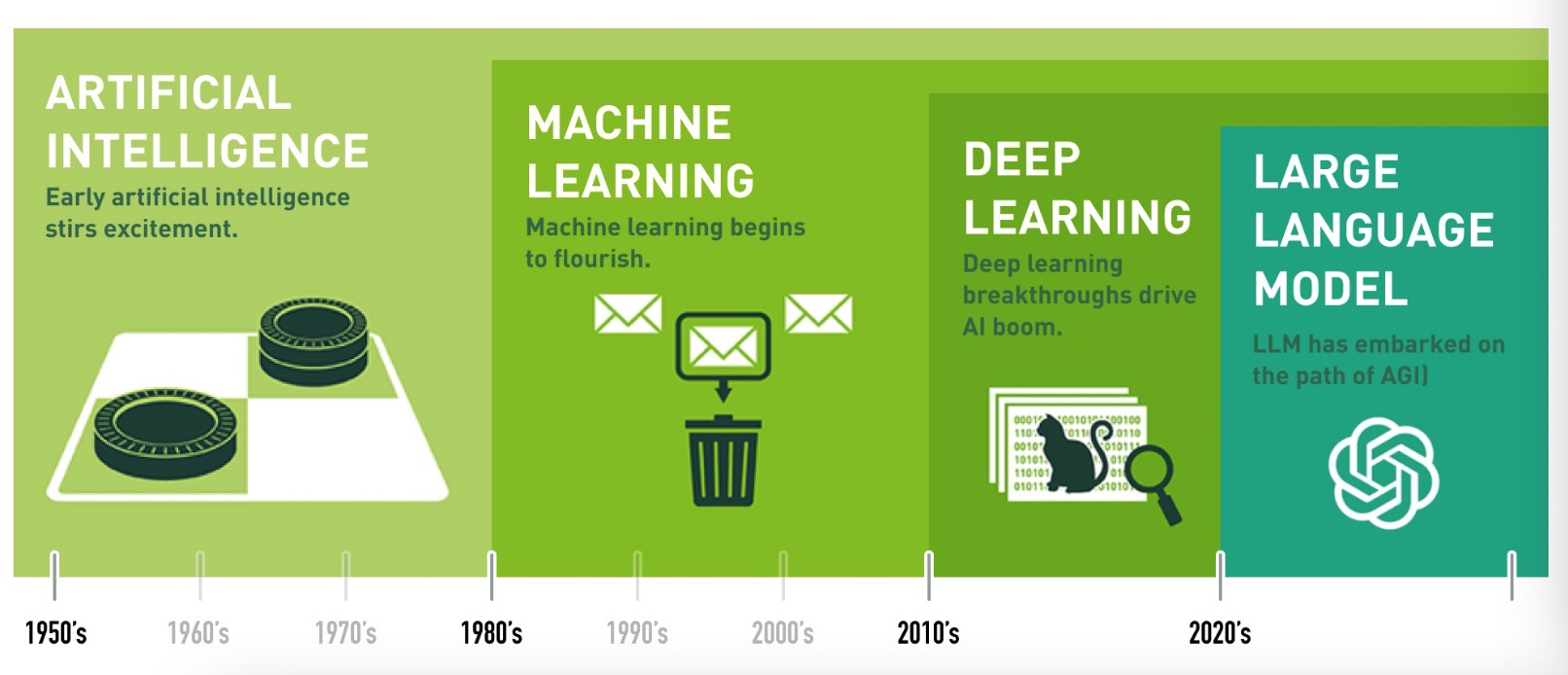

- 人工智能 (Artificial Intelligence, 简称AI) 这个概念是在1956年提出的. 这一年, 约翰·麦卡锡 (John McCarthy) 和其他几位科学家在美国达特茅斯学院 (Dartmouth College) 组织了一场研讨会, 首次提出了"人工智能"一词, 标志着人工智能作为一门学科的正式诞生.

- 人工智能这个概念从诞生到今天也只有不到70年的时间, 是一门很年轻的科学.

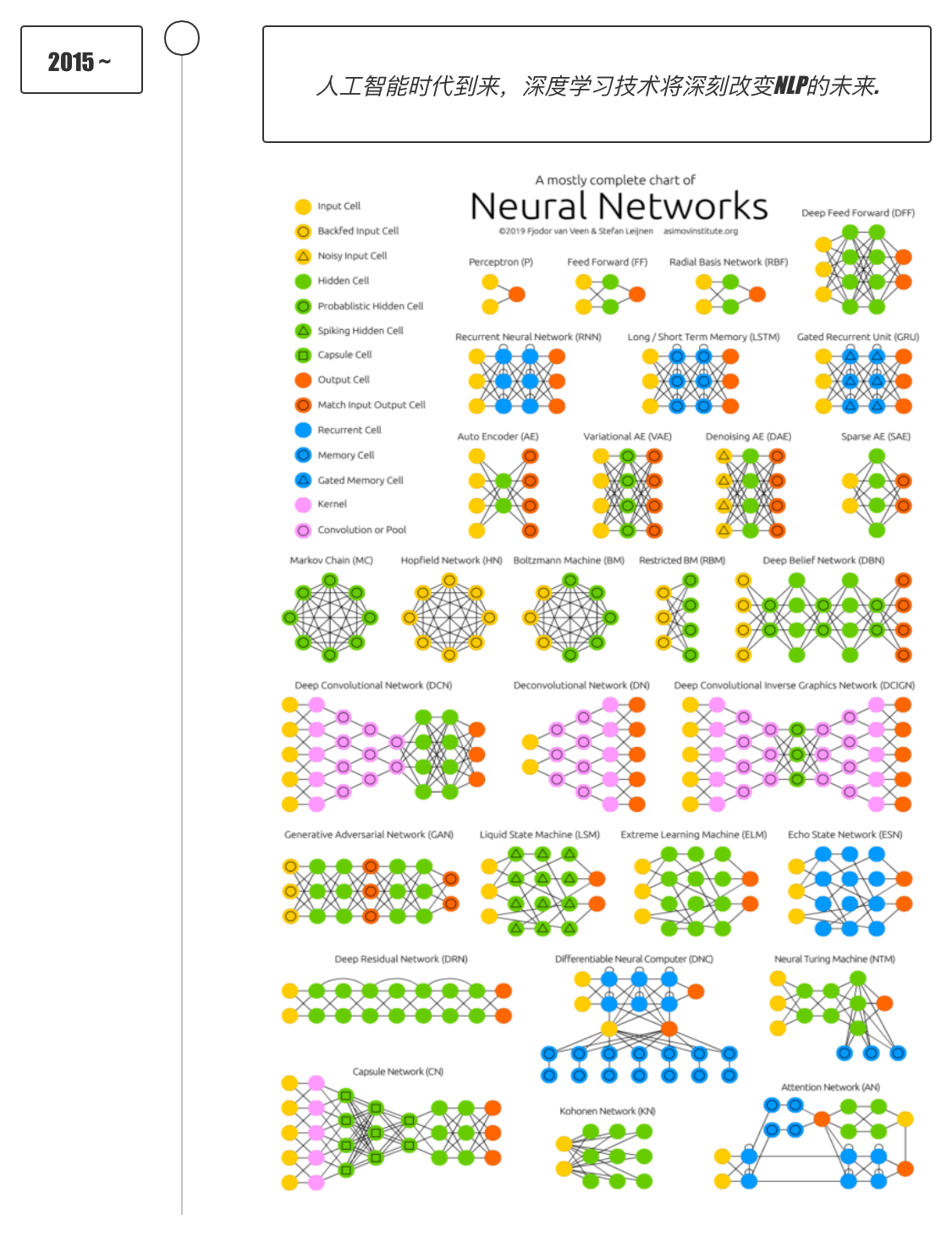

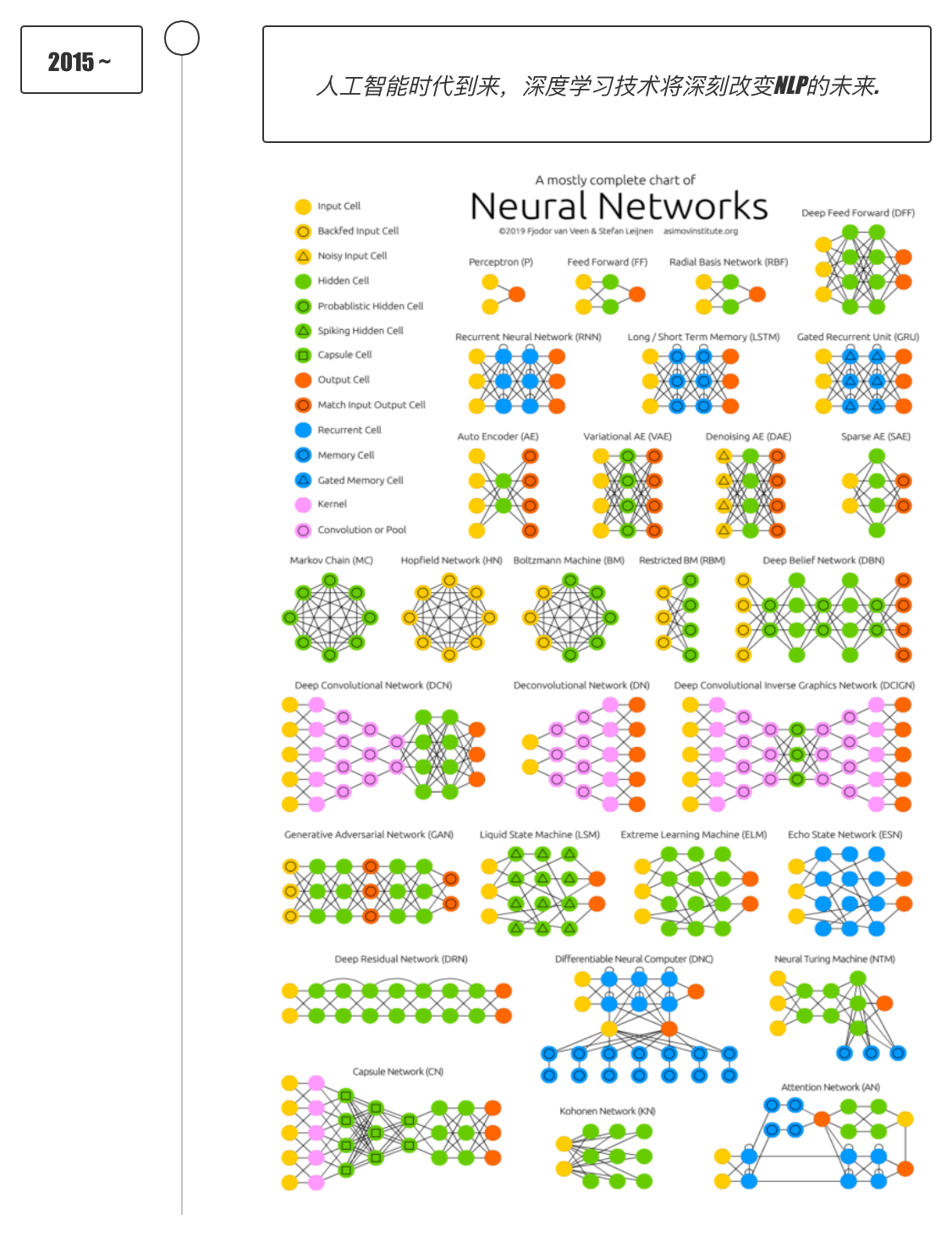

- 深度学习所需要的神经网络技术起源于20世纪50年代, 叫做感知机. 当时也通常使用单层感知机, 尽管结构简单, 但是能够解决复杂的问题. 后来感知机被证明存在严重的问题, 因为只能学习线性可分函数, 连简单的异或 (XOR) 等线性不可分问题都无能为力.

- 1969年Marvin Minsky写了一本叫做《Perceptrons》的书, 他提出了著名的两个观点:

- 1: 单层感知机没用, 我们需要多层感知机来解决复杂问题.

- 2: 没有有效的训练算法.

- 20世纪80年代末期, 用于人工神经网络的反向传播算法 (Back Propagation算法, BP算法) 的发明, 给机器学习带来了希望, 掀起了基于统计模型的机器学习热潮, 这个热潮一直持续到今天. 人们发现, 利用BP算法可以让一个人工神经网络模型从大量训练样本中学习统计规律, 从而对未知事件做预测. 这种基于统计的机器学习方法比起过去基于人工规则的系统, 在很多方面显出优越性.

- 这个时候的人工神经网络, 虽也被称作多层感知机 (Multi-layer Perceptron), 但实际是种只含有一层隐层节点的浅层模型.

- 2012年, 在著名的ImageNet图像识别大赛中, 杰弗里·辛顿领导的小组采用深度学习模型AlexNet一举夺冠, AlexNet采用ReLU激活函数, 从根本上解决了梯度消失问题, 并采用GPU极大的提高了模型的运算速度.

- 同年, 由斯坦福大学著名的吴恩达教授和世界顶尖计算机专家Jeff Dean共同主导的深度神经网络, DNN技术在图像识别领域取得了惊人的成绩, 在ImageNet评测中成功的把错误率从26%降低到了15%. 深度学习算法在世界大赛的脱颖而出, 也再一次吸引了学术界和工业界对于深度学习领域的关注.

- 2016年, 随着谷歌公司基于深度学习开发的AlphaGo以4:1的比分战胜了国际顶尖围棋高手李世石, 深度学习的热度一时无两. 后来, AlphaGo又接连和众多世界级围棋高手过招, 均取得了完胜. 这也证明了在围棋界, 基于深度学习技术的机器人已经彻底超越了人类.

- 2017年, 基于强化学习算法的AlphaGo升级版AlphaGo Zero横空出世. 其采用"从零开始", "无师自通"的学习模式, 以100:0的比分轻而易举打败了之前的AlphaGo. 除了围棋, 它还精通国际象棋等其它棋类游戏, 可以说是真正的棋类天才.

- 2017年, 谷歌推出了划时代的作品Transformer, 对整个人工智能的发展影响深远. 此外在这一年, 深度学习的相关算法在医疗、金融、艺术、无人驾驶等多个领域均取得了显著的成果. 所以, 也有专家把2017年看作是深度学习甚至是人工智能发展最为突飞猛进的一年.

- 2018年, 谷歌推出了BERT, 开启了预训练模型和迁移学习的时代.

- 2019年, GPT2, T5, AlBERT, RoBERTa, XLNet, 一系列预训练模型的推出大大提升了AI的应用效果.

- 2020年, 深度学习扩展到更多的应用场景, 比如积水识别, 路面塌陷等, 而且疫情期间, 在智能外呼系统, 人群测温系统, 口罩人脸识别等都有深度学习的应用.

- 2021年, 巨量模型大量涌现, 参数规模从几百亿迅速增长到上万亿.

- 2022年11月30日, ChatGPT横空出世, 开启了AI大模型的时代.

- 2023年, 是全世界大模型的战国时代.

- 2024年, 2月份Sora横空出世, 5月GPT-4o, DeepSeek-v2, 快手可灵, 都是最前沿的成果.

人工智能关键词¶

- 人工智能 (Artificial Intelligence)

- 机器学习 (Machine Learning) - 深度学习 (Deep Learning)

- 大语言模型 (Large Language Model)

AI技术方向 & 就业方向¶

- AI主流技术方向:

- ASR: 语音

- CV: 视觉

- NLP: 语言

- MM: 多模态

- RS: 搜广推

- RL: 强化学习

- AI主流就业方向:

- AI算法工程师

- AI大模型工程师

- AI研发工程师

- AI应用开发工程师

- AI产品经理

- AI训练师

- AI数据标注师

2.1 人工智能的奇点ChatGPT

人工智能的奇点ChatGPT¶

学习目标¶

ChatGPT时刻¶

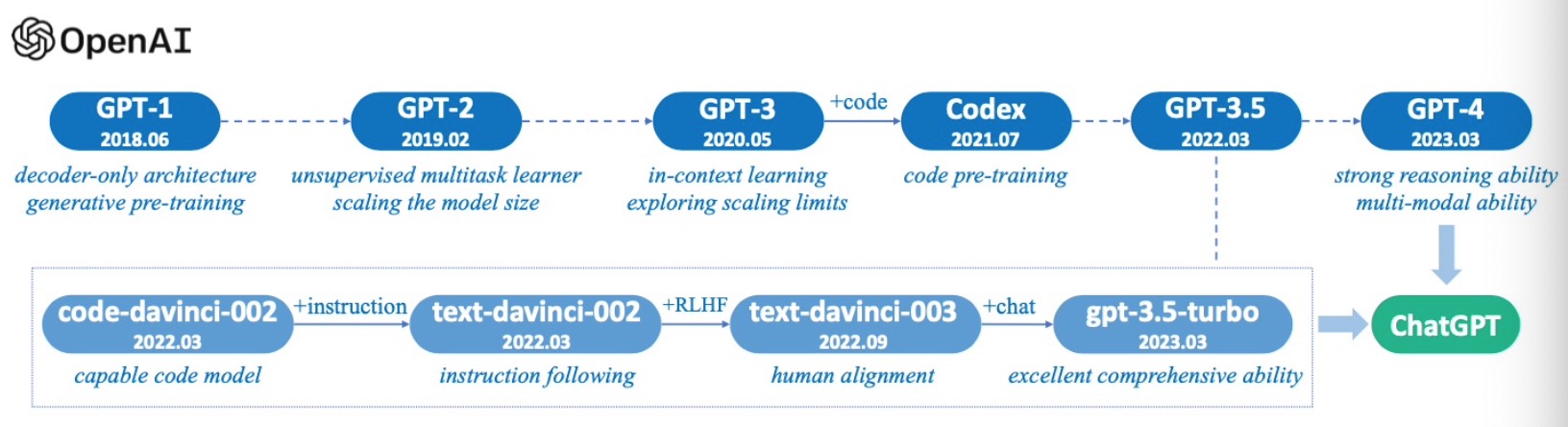

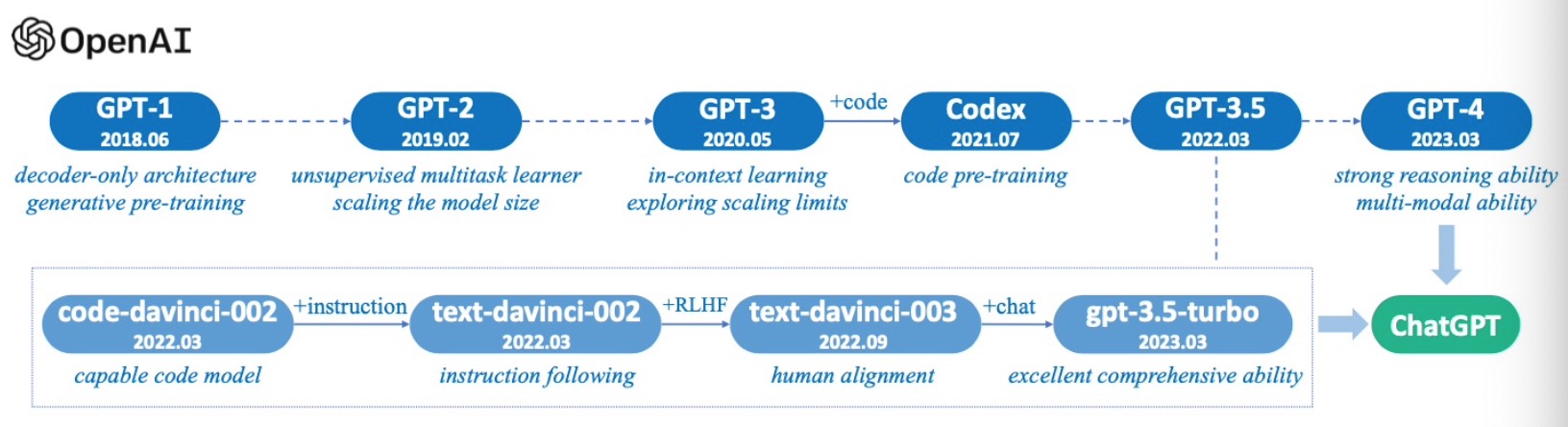

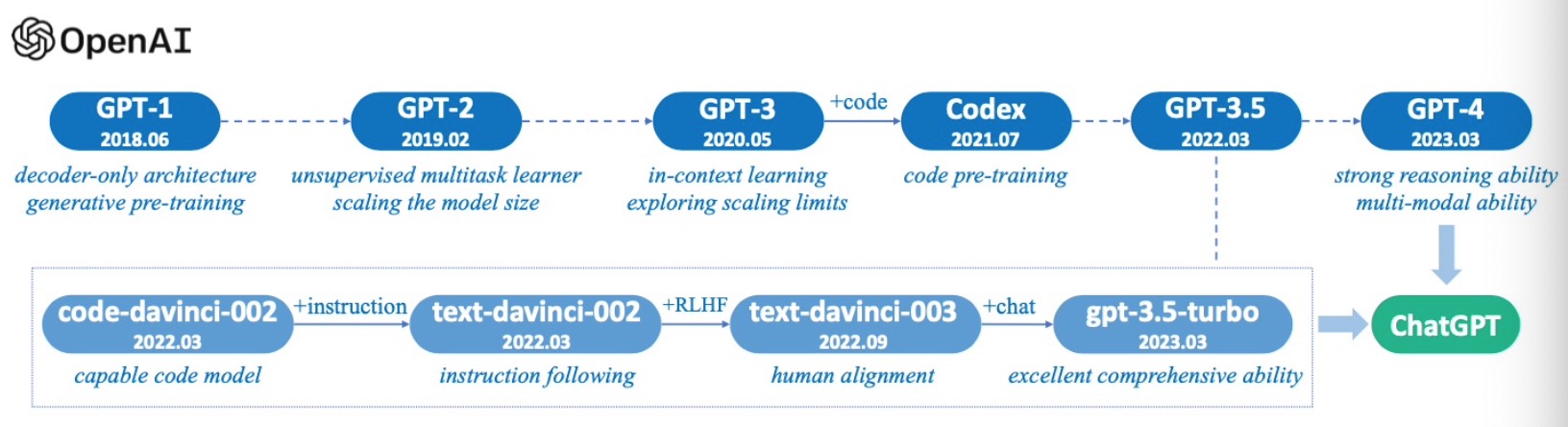

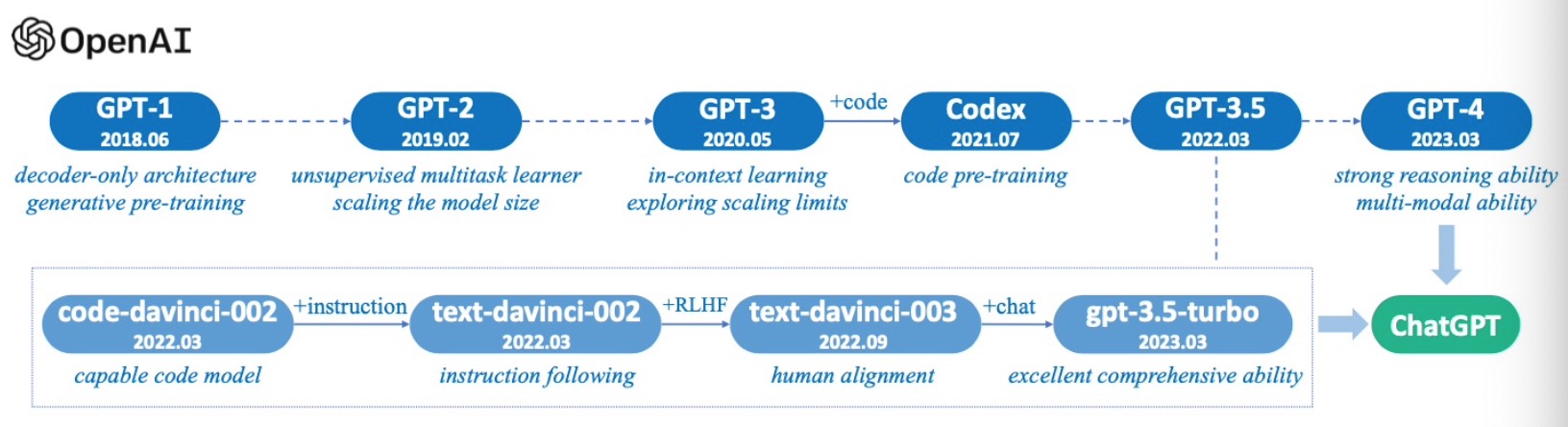

- 2017年6月Transformer横空出世!!!

- 2018年6月GPT, 参数量1.1亿, 核心点是基于Transformer Decoder的masked multi-head self-attention

- 2019年2月GPT2, 参数量15亿, 核心点是融合了prompt learning, 省去了微调.

- 2020年5月GPT3, 参数量1750亿, 核心点是通过ICL(In-Context Learning)开启了prompt新范式.

- 2021年7月Codex, 基于GPT3进行了大量的代码训练而产生的模型Codex, 使其具备了代码编写和代码推理能力.

- 2021年10月OpenAI内部发展出了GPT3.5, 但未对外公开.

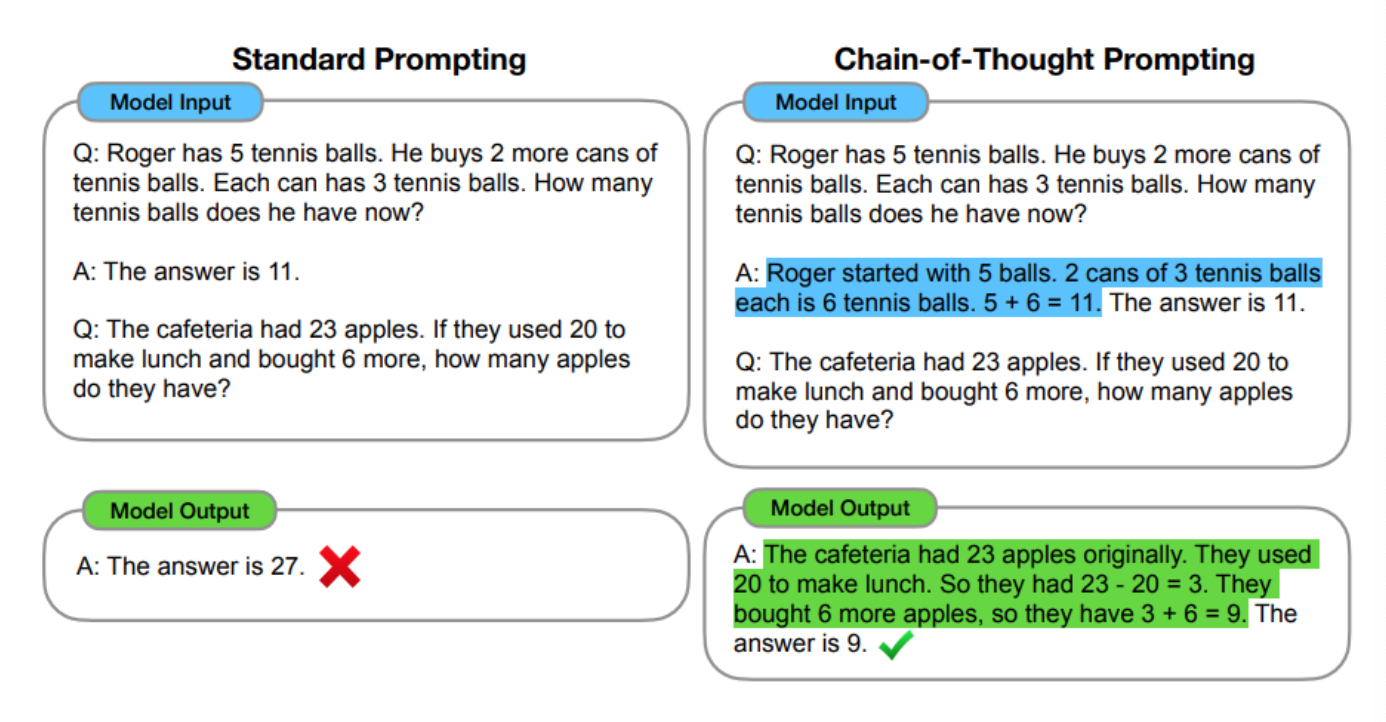

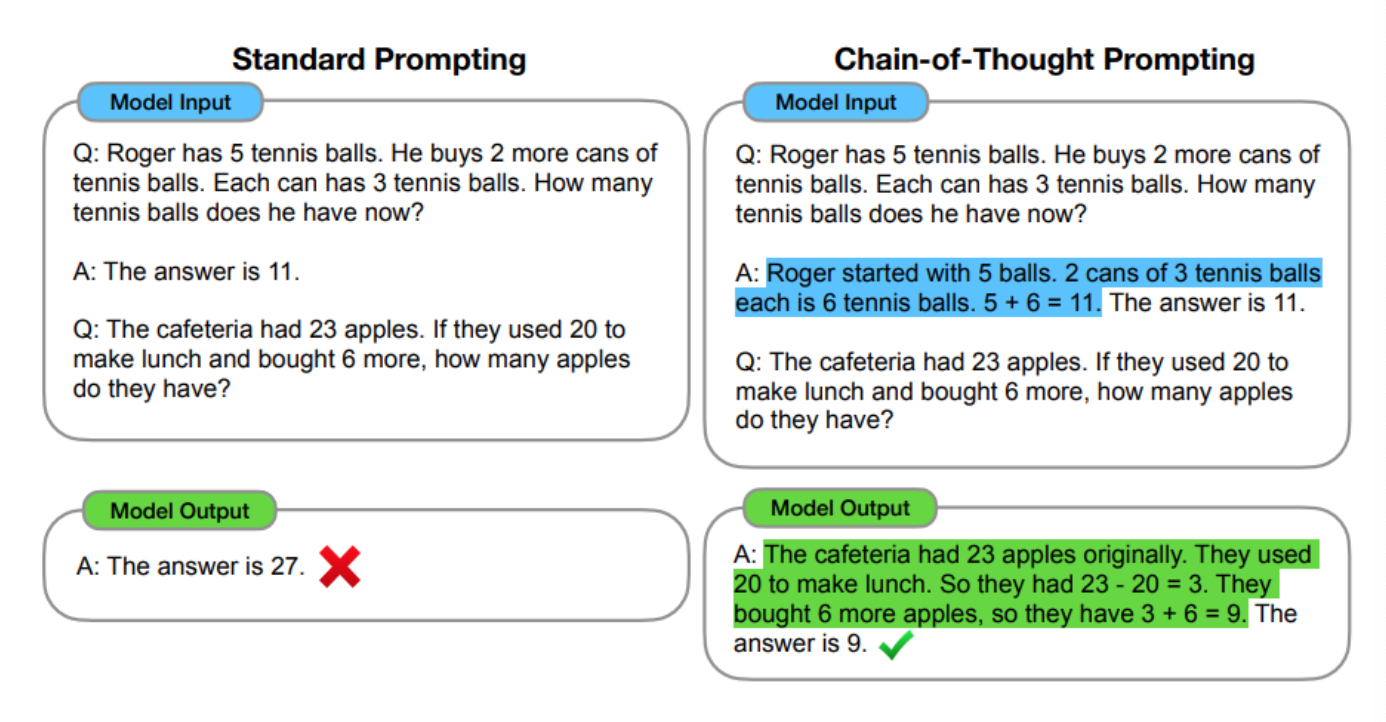

- 2022年1月Google提出思维链技术CoT (Chain of Thought)

- 2022年11月30日, OpenAI正式发布chatGPT, 核心点是基于GPT3.5, 融合了Codex + 强化学习的技术.

- 2023年3月, OpenAI正式发布GPT4, 增加了多模态能力.

- 2024年2月, OpenAI正式发布Sora, 首次完成60s稳定, 流畅, 一致性的视频生成模型.

- https://www.bilibili.com/video/BV17u4m1P7yM/?spm_id_from=333.788&vd_source=df7ff49c7ff2ca7e998b84c4369f1a59

- 2024年5月, OpenAI正式发布GPT-4o, 流浪地球2的电影场景第一次进入现实.

- https://www.bilibili.com/video/BV1pt421M7CG/?vd_source=df7ff49c7ff2ca7e998b84c4369f1a59

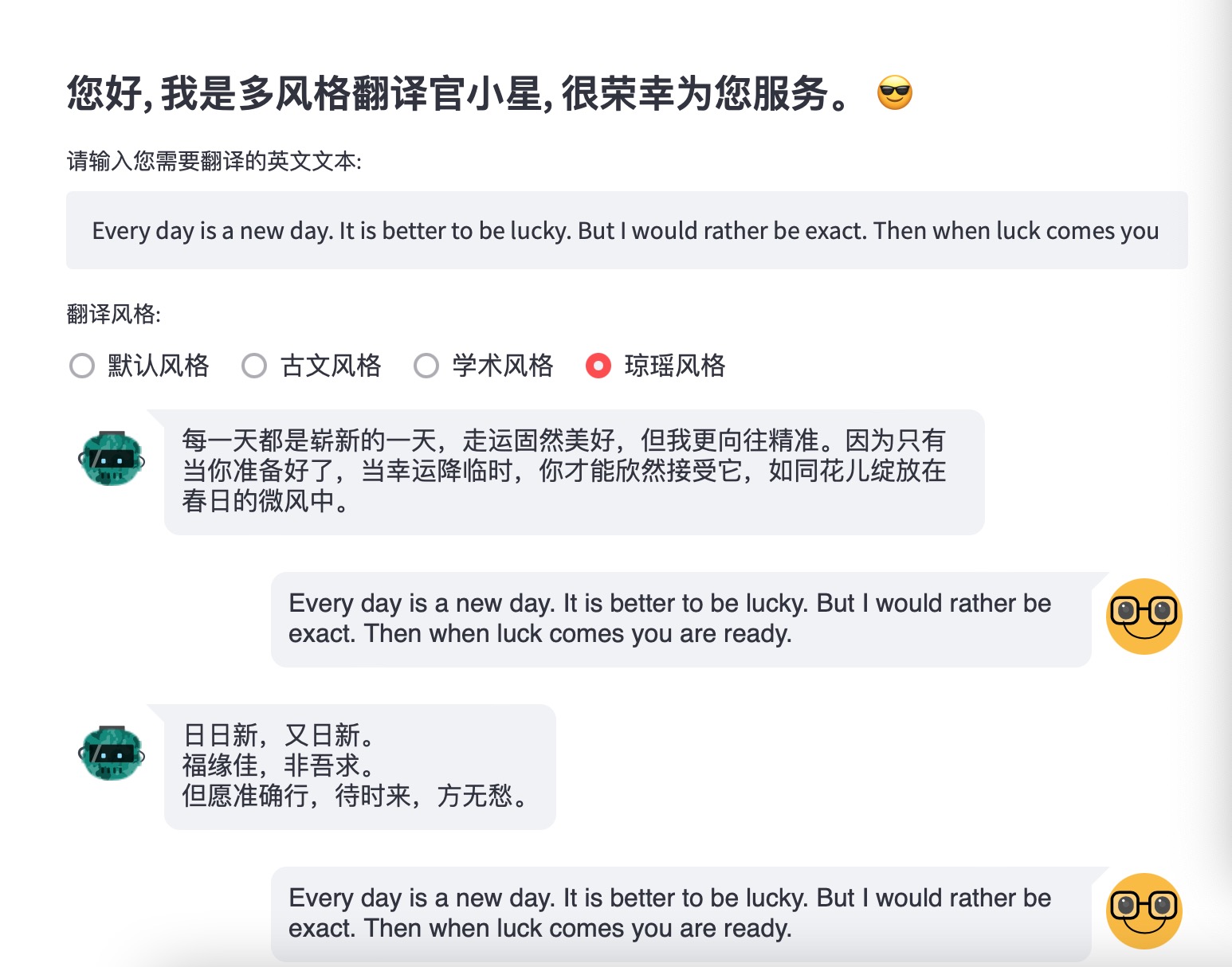

3.1 AI前端界面

AI前端界面¶

学习目标¶

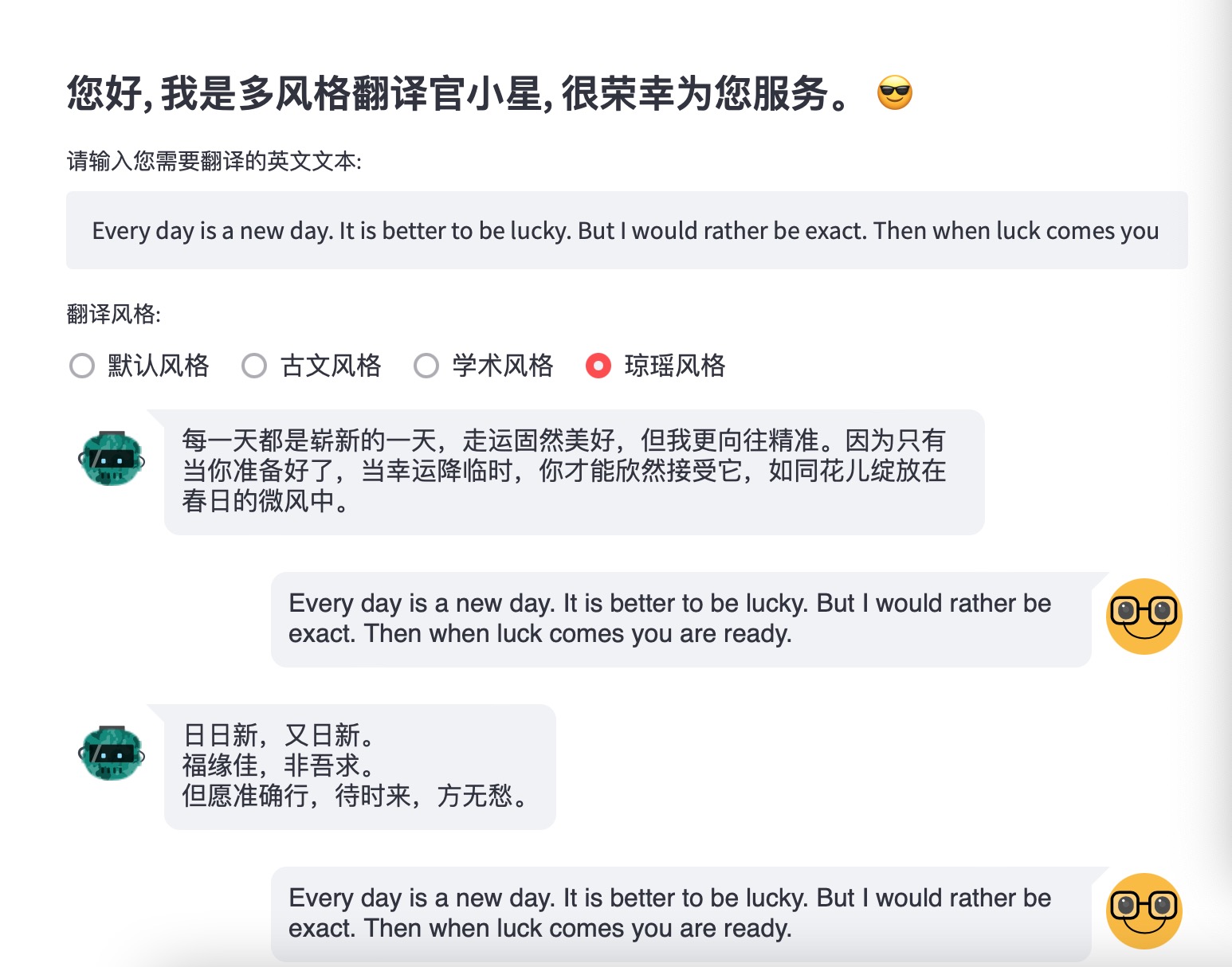

- 了解一个具备AI能力的简单前端界面.

- 理解未来的前端, 后端工程师要具备AI开发的能力.

- 这里是AI课程, 不是前端课程, 只作为一个引子, 展示给同学们一个具备AI能力的前端界面.

# 老人与海经典原文 But a man is not made for defeat. A man can be destroyed but not defeated.- 输入一段圣经中的原文:

You are the salt of the earth,you are the light of the world,will shine before humanity.- streamlit run ./main_translate.py

4.1 大模型时代的风起云涌

大模型时代的风起云涌¶

学习目标¶

- 了解当前主流语言大模型的进展.

- 了解当前主流多模态大模型的进展.

- 了解当前主流AI搜索大模型的进展.

语言大模型¶

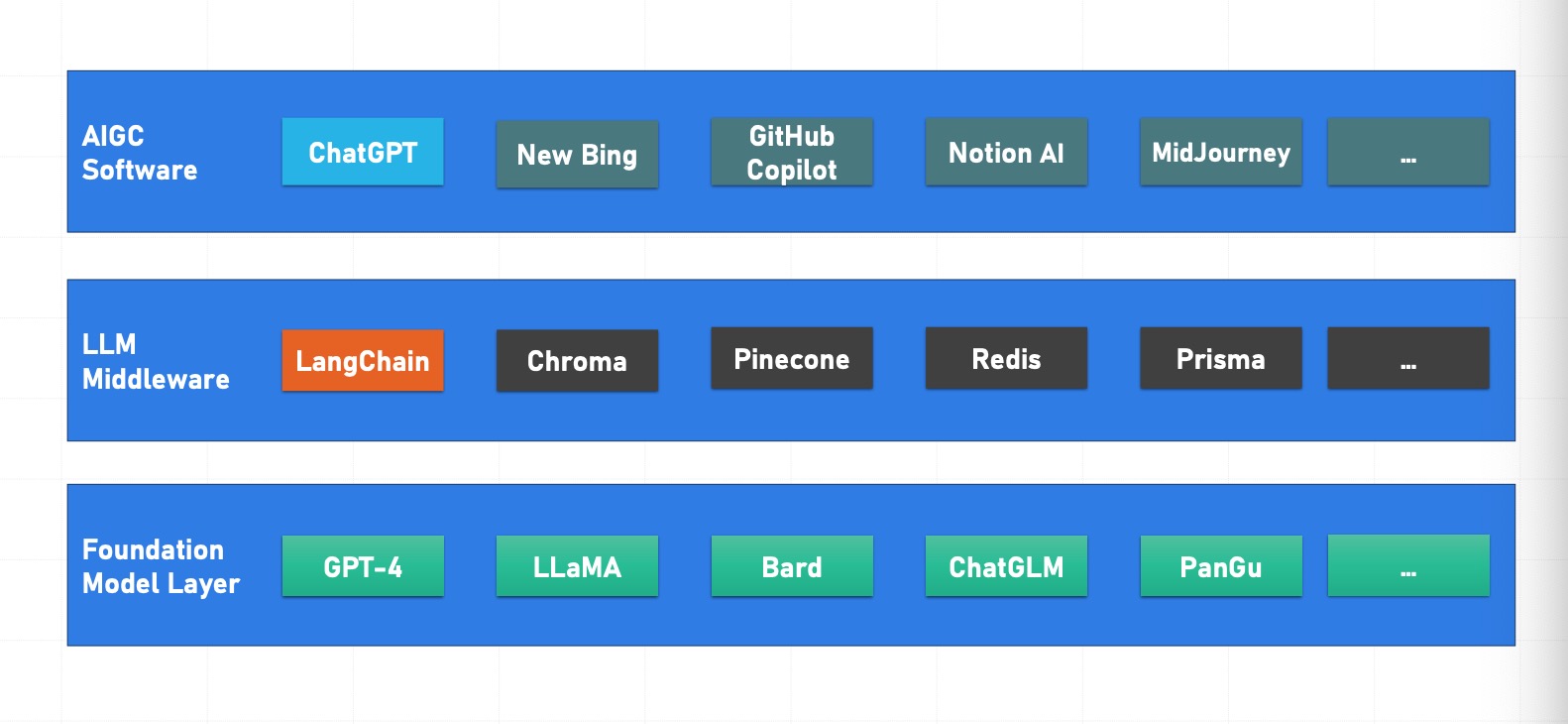

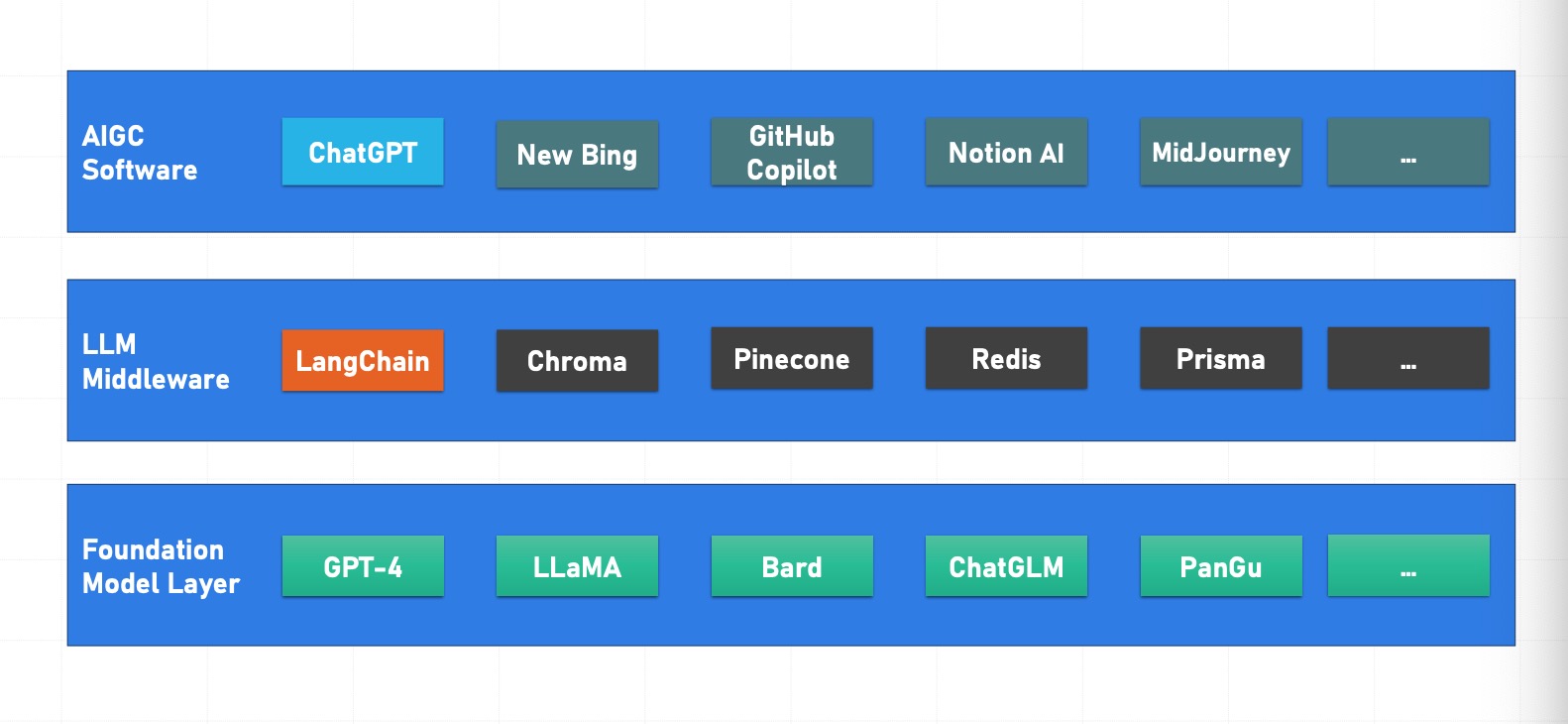

- ⭕️基础大模型底层 --->>> LLM中间层 --->>> AIGC软件层

百度: 文心大模型¶

阿里巴巴: 千问大模型¶

腾讯: 混元大模型¶

字节跳动: 云雀大模型¶

科大讯飞: 星火大模型¶

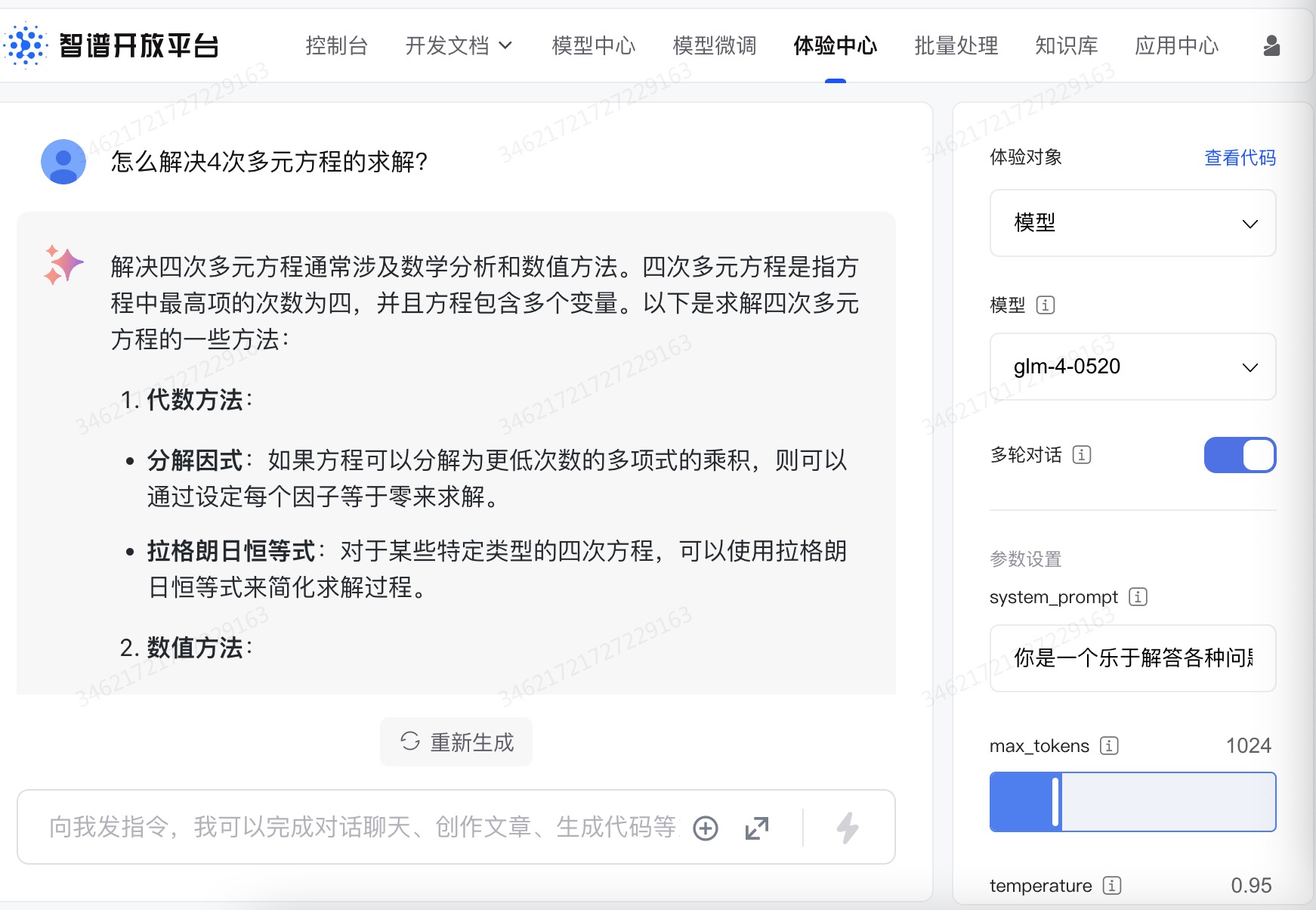

智谱清言: ChatGLM大模型¶

Minimax: ABAB大模型¶

阶跃星辰: Step大模型¶

深度求索: DeepSeek大模型¶

月之暗面: Kimi大模型¶

多模态大模型¶

GPT4¶

快手: 可灵¶

字节跳动: 即梦¶

美图: Whee¶

AI搜索¶

秘塔¶

小节总结¶

- 宏观上了解了当前学术圈和产业圈的AI大模型最新进展.

5.1 AI生存法则

技术人员的AI生存法则¶

学习目标¶

- 了解AI时代的新变化.

- 理解AI时代的变革原因.

- 理解AI时代的模式和开发框架.

AI时代生存法则¶

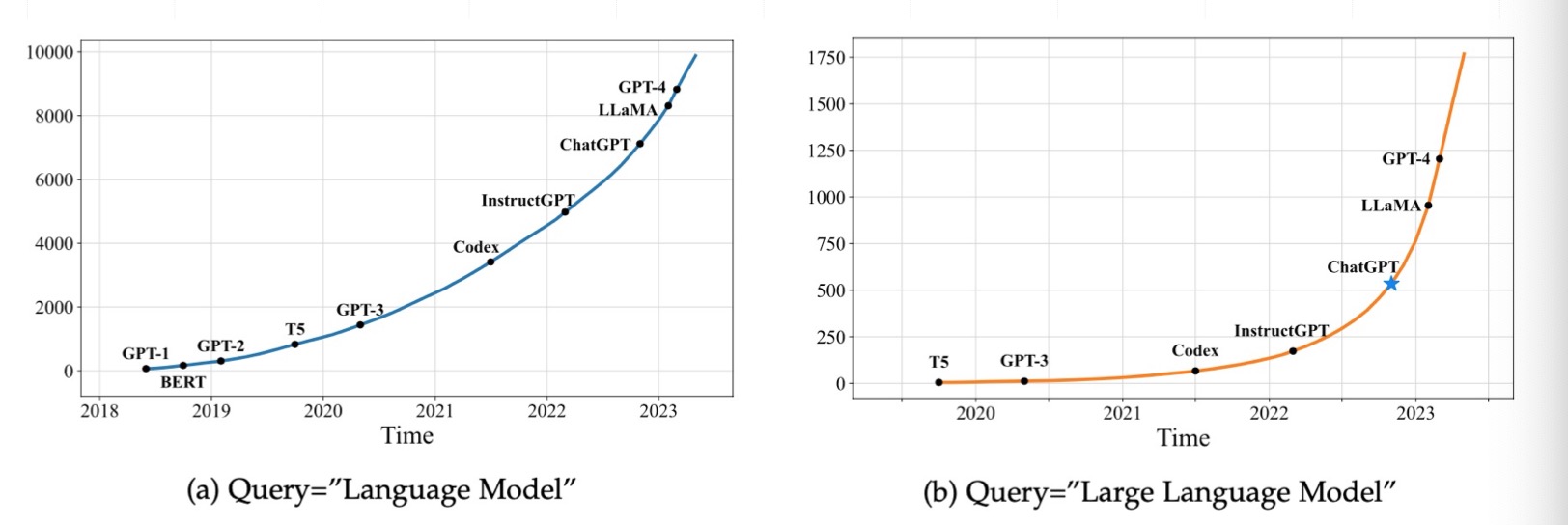

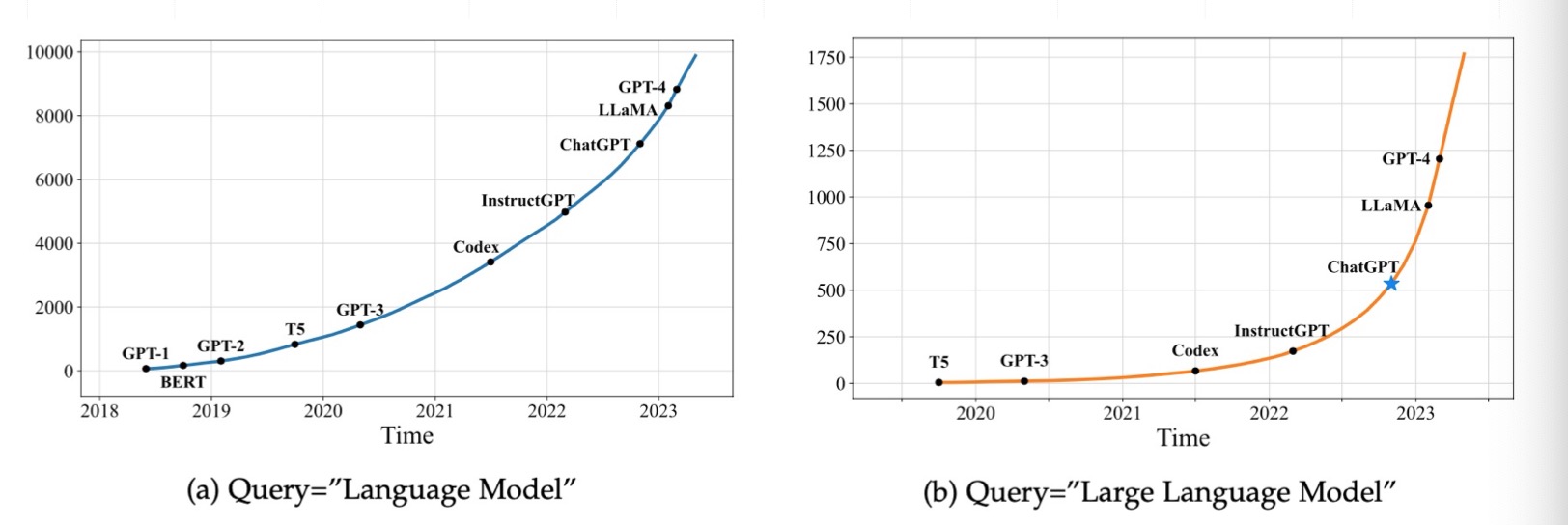

- 搜索关键字的变化!

- 随着时代的发展, 技术模式也在不断迁移.

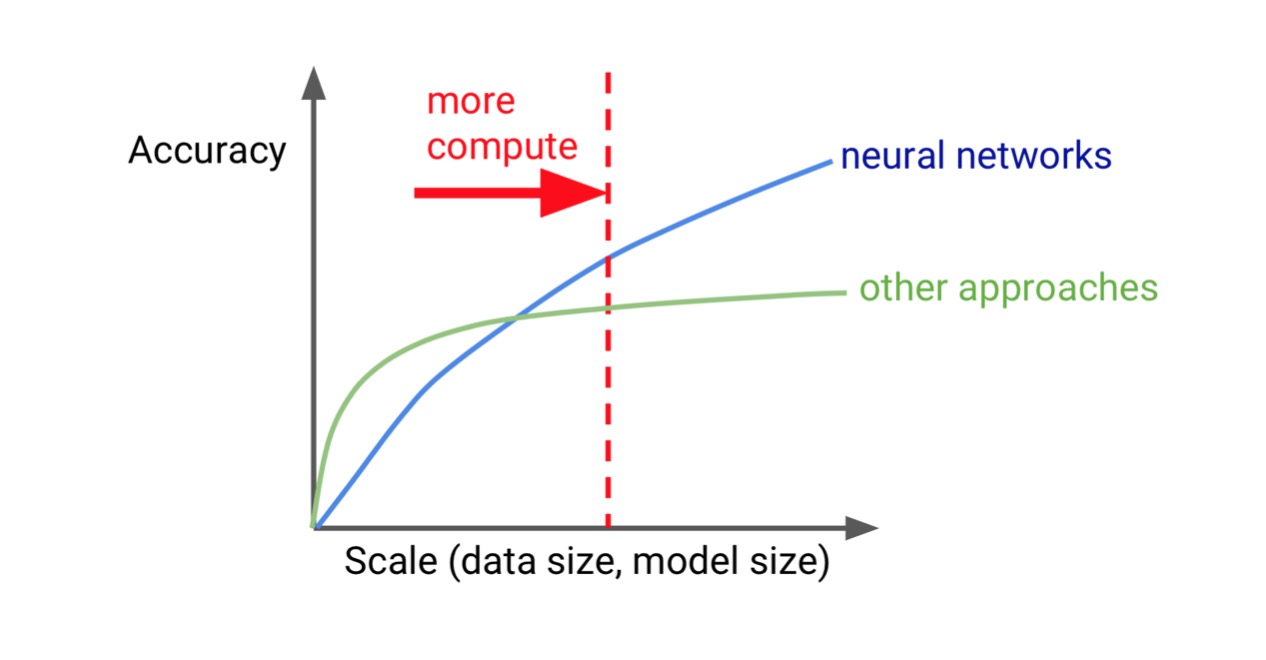

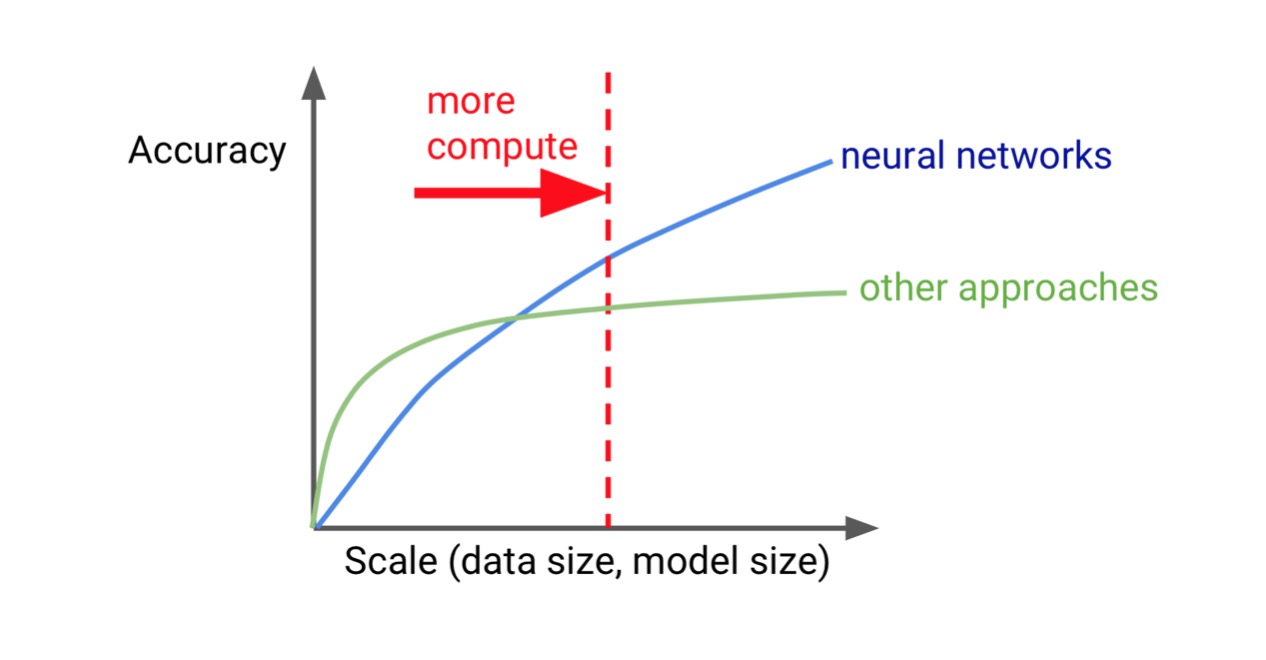

- 算力增长和AI效能:

- AI大模型时代的开发模式

- AI大模型时代的技术栈

如何做一个职业程序员?¶

- 提醒📢: ⭕️整个课程期间基本上每周都会提交一次作业.

- 助教邮箱📮: wanghao5276@163.com

- 小朱老师邮箱📮: 348811083@qq.com

- 提交作业的截止时间, 在布置作业的时候会通知, 具体时间也会写在每次课堂讲义最下面.

- 每次作业评分A, B, C, D, 对同学们最后期末打分很重要, 加油🆙

- 问题1: 单词Strawberry中有几个字母r ?

- 问题2: 2025年春节:1月28日(农历除夕,周二)至2月4日(农历正月初七, 周二)放假调休, 共8天。1月26日(周日),2月8日(周六)上班。请你计算真的假期, 请注意, 双休日本来就是属于打工牛马的假期,请一步步思考。

- 作业1: 回去查查什么叫感知机? (传统机器学习的领域, 深度学习中最最基础的一个小概念)

- 问题3: Hinton大神认识吗?

- 2019年图灵奖

- 2024年诺贝尔物理奖

- 全世界第一个同时拿图灵奖 + 诺贝尔奖的大神!!!

- 🍊1989年的反向传播算法!!!

- 2012年AlexNet勇拿竞赛冠军🏆, 才把这个算法发扬光大!!!

- 大牛: 很多显而易见的事情, 是当所有人都知道它显而易见了, 它才显而易见.

- 问题4: 到底啥是多模态? (不再犹豫)

- 语音

- 语言

- 图片

- 视频

- 上面两个以上的模态放在一起就是多模态.

- 问题5: 当前学术圈 + 工业界, AI的最前沿的几个方向?

- 问题6: 关于大模型时代的算力需求?

- 国内最大的算力池: 字节跳动的火山引擎 --- 保守估计10万块.

- 3090, 4090: 5000元 ~ 10000元

- T4, V100: 2 ~ 3万人民币

- A100, A800: 10万人民币

- 2023年训练GPT-4模型, 大概用了5万块A100. (花了50亿)

- 2023年春天, 2月份, 美团联合创始人. (出资5000万, 6月份悄悄的跑了)

- H100, H800: 25万人民币

- 未来GPT-5模型需要10万块H100. (250亿)

- B200: 60万人民币

- 问题7: 关于开发 + 学习环境?

- 强烈建议在Linux环境下.

- ⭕️利用工具: anaconda 创建同学们自己的虚拟环境 (作业)

- 创建虚拟环境命令: conda create -n deeplearning python=3.10

- 激活环境: conda activate deeplearning

- 安装包: pip install torch, pip install transformers

- 问题8: 大模型领域哪些需求大? 偏饱和?

- 整个大模型都属于蓝海.......

- 1: NLP, 搜广推 ✅

- 2: 语音, 多模态 ❎

- 3: CV, 强化学习 ❌

posted @

2025-10-26 14:26

凫弥

阅读(

90)

评论()

收藏

举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号