【ubuntu24.04】基于ollama、deepseek、dify搭建本地知识库

一、官网

https://dify.ai/

二、环境准备

1、安装docker(由于已经安装过了,跳过)

2、安装ollama

命令行执行命令

curl -fsSL https://ollama.com/install.sh | sh

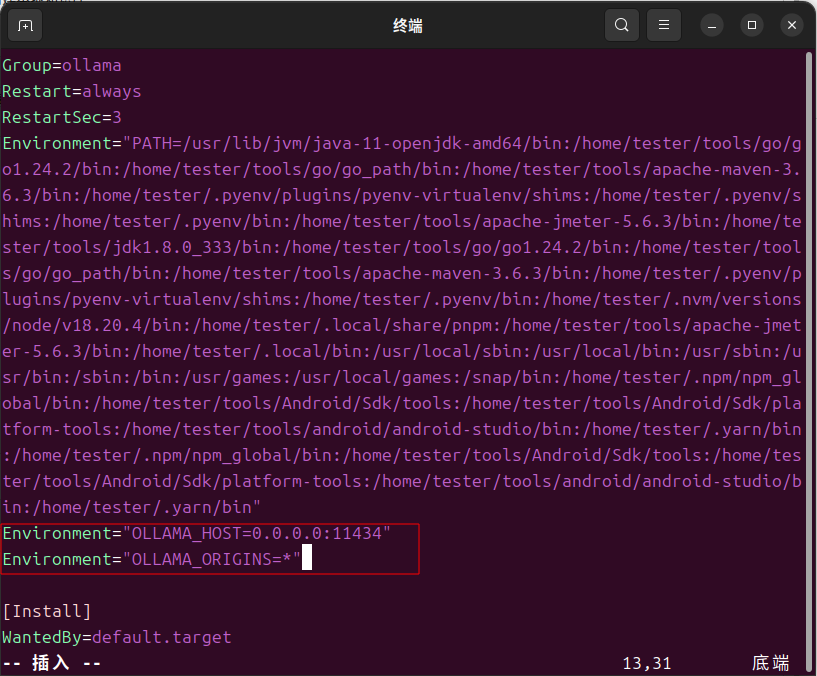

配置ollama.service

sudo vim /etc/systemd/system/ollama.service

增加两行

重启服务

sudo systemctl daemon-reload sudo systemctl restart ollama.service

3、安装dify

下载dify

git clone https://github.com/langgenius/dify.git

使用docker-compose启动(没有docker-compose,需要通过pip安装/或者二进制安装)

cd dify cd docker cp .env.example .env docker compose up -d

全部安装完成时候,访问如下地址初始化

三、配置

1、ollama拉取deepseek-r1:1.5b模型(模型根据自己需要即可)

拉取模型

ollama pull deepseek-r1:1.5b

运行模型

ollama run deepseek-r1:1.5b

$ ollama run deepseek-r1:1.5b >>> 你好 <think> </think> 你好!很高兴见到你,有什么我可以帮忙的吗?无论是学习、工作还是生活中的问题, 都可以告诉我哦!😊 >>> Send a message (/? for help)

CTRL+D可以退出

模型的位置查找

/usr/share/ollama/.ollama/models

2、配置dify

1)需要配置管理的账号密码

2)添加ollama本地模型

点击 Dify 平台右上角头像 ➜ 设置 ➜ 模型供应商 ➜ Ollama ➜ 添加模型。

- 模型类型:

LLM - 模型名称:deepseek-r1:1.5b

- 基础URL:

http://host.docker.internal:11434

模型名称需要和ollama拉取的模型一致

3)创建知识库

4)创建工作空间

四、测试

然后就可以通过聊天开始对话了

参考链接:

https://juejin.cn/post/7484050220456706057

浙公网安备 33010602011771号

浙公网安备 33010602011771号