浅谈人工智能自我繁衍

浅谈人工智能自我繁衍

摘要:随着科技的发展,对人工智能的研究越来越深入,人工智能技术的研究推动了社会的进步,但是一些现象的出现也引发了我们的思考。人工智能会自我繁衍吗,如果可以,人类还能控制得住吗,如果控制不住,会产生什么后果,我们怎么避免这一后果。本文将从这些问题出发,浅谈人工智能自我繁衍。

关键词:人工智能 繁衍 后果 现状 展望

一、人工智能是什么

人工智能会自我繁衍吗?讨论这个问题,我们首先要清楚人工智能是什么。

说到人工智能,我们首先想到的也许是应用人工智能技术生产出来的人工智能机器人。人工智能机器人是一个机器系统,它在感知、思维和效应方面模拟人的思维和行为。它的外形不一定是像人的,但是它可以模拟人的思维。它是人工智能技术的综合试验场,可以非常全面地考察人工智能各个领域的技术层次,也能研究这些领域相互之间的关系。人工智能机器人的主要应用领域是制造业的自动化工厂还有医疗、物流等服务业领域。例如外形最像人类的机器人——人工智能机器人索菲亚,她有着人类女性的外观,有很多自然的表情,可以理解人类的语言和动作并做出互动。随着时间的推移,它也会变得越来越聪明,它的目标是像我们人类这样,拥有自主的意识、创造性和其他能力。除了它,还有扫地机器人等等,这些都是有实体的机器人。

图1 人工智能索菲亚

图2 扫地机器人

这些有实体的人工智能机器人确实被包含在人工智能领域内,这是毋庸置疑的。但人工智能可不仅仅只是指的这些,它还包括许多其他的研究。人工智能是一门技术科学,它研究用于模拟和扩展人的智能的理论、方法、技术及应用系统,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器。人工智能领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等。像人脸识别程序、无人驾驶技术等,这些都属于人工智能。

除了上文提到的有实体的机器人,还有许多没有实体的人工智能。比如我们熟知的AlphaGo,它是一款围棋人工智能程序,它主要运用了"深度学习"的技术,这种机器人没有实体,而是一款人工智能程序。当然还有我们的手机助手,当你用语言提出要求时,他们会识别言语中的含义,协助你办一些事情或是找一些有用的信息。还有视频游戏里的AI、在线客服等等,这些都是没有实体的机器人。所以,“人工智能能否自我繁衍” 这个问题里的“人工智能”不局限于有着机械外壳或是形状像人一样的机器人,它的范围很广泛。

二、人工智能自我繁衍的研究现状和一些可能的后果

通过这些我们知道的人工智能,我们可以很清楚、很确定的知道,人工智能可以自我学习,自己提升自己,也就是说,存在一种这样的程序,使得人工智能自己不断地完善,学习新的知识。但是它能不能创造新的人工智能呢?

显然,让机械制造的机器人实现像人类一样,以“生孩子”的方式自我繁衍是不太可能的,毕竟金属并不像细胞一样可以不断的做分裂或是分化等动作,人工智能也不像人类构造一样丰富、复杂。

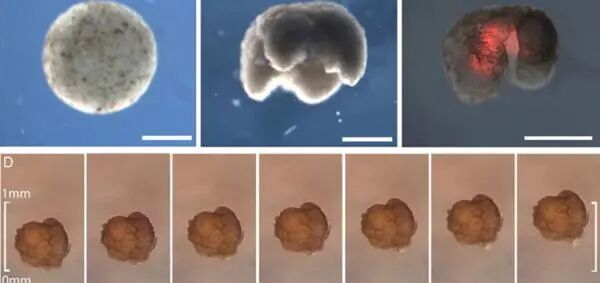

说到材质,实际上,世界上已经研究出了可自我繁衍的活体机器人—— Xenobots 3.0。智能Xenobots是一个细胞团,它是由数千个胚胎细胞组成的,它是全球首个活体机器人,是由超级计算机的进化算法设计的,材质是由从非洲爪蟾早期胚胎中取出数千个皮肤细胞和心脏细胞制造出来的,大约可以存活一周。但通过科学家大量的实验,发现它在进化中出现了问题,它不能像很多生命一样自我复制。为了解决这个问题,找到允许细胞群进行多轮复制的有效形状,来自美国的佛蒙特大学和塔弗茨大学团队使用一种人工智能进化算法,从随机状态的细胞群开始,让系统自行进化具有自我复制能力的细胞群,然后筛选出持续复制最久的细胞群构型。它不仅可以自主移动,被损坏后还能自己愈合,直径不到1毫米。也许在未来,科学家们还能通过不断地对Xenobots研究,进一步发现更接近细胞的人造生物,并且能更加深入地了解细胞的构造和行为。但这离活体类人机器人的制造还差得很远,因为还要考虑人体细胞组合等等,人类的构造可能比我们现在了解到的以及我们想象中的复杂得多。

图3 活体机器人—— Xenobots

在程序方面来看,人工智能甚至已经具备了自我繁殖的功能,在计算机语言中有一条指令叫Spawn,Spawn命令能从一个正在运行的程序中有效地创造子程序。程序就像人类的大脑,这就意味着人工智能的思维是可以不断繁殖扩展的,但这距离实现人工智能有思想的像人一样的繁衍还很远。

虽然在现在看来,制造出活体类人机器人还很遥远,但不代表这是不可能的。有很多电影和动漫都对此有大胆地畅想。我认为,未来的技术很有可能会研究出一种材质,可以像细胞一样生长,也会创造出一种程序,实现人工智能程序创造新的程序。人工智能也会通过一种程序实现像人一样有自己学习、思考的能力,也会像人一样有自己的意识。这样它就可以不断的存在,不断的繁衍。

抛开外在材料不谈,只看程序,没有实体的人工智能产生了自主意识会对人类产生威胁吗?很多这类的科幻电影其实已经考虑过这个问题了,像《终结者》中,地球被机器人统治,幸存的人类聚集起来抵抗它们的残暴统治;《黑客帝国》中,一位网络黑客发现我们所处的现实世界实是由一个名为"矩阵"的人工智能系统控制的等等,某种程度上来说,这些影视剧的情节可以作为人工智能产生自主意识的结果的启示和预判。

图4 《终结者》海报图

但是就目前来看,人类与机器之间是合作的关系,并不存在竞争的关系,当然,存在一些职位被替代,部分人面临失业等问题,但这只是对个人而言,对整体人类来说是有利的。技术的发展让机器帮我们解决了很多问题,比如太空航行、医疗技术和服务、战争武器的威慑力等等。

假如人类研究出来的人工智能能自己创造人工智能,那人类是否还能控制人工智能。现在来看这个问题的答案是不确定的,但我认为,只要我们技术足够成熟、有节制地开发而不是只关心个人利益,那人工智能就永远在人类的控制之下。就算是人工智能能自己创造人工智能,也是在人类的授意下,也是为人类所用的,也是对人类有利的。

我们再来讨论一下无法控制的情况。如果可以自我繁衍的、有自主意识的人造生命体被创造出来,那它们将会给我们带来多大的风险呢?目前的人工智能是有智慧的,是构造复杂的,但它下一步动作通常可以被大致预测,而有意识的生命体是不可预测的,它会有超强的智力、记忆力,它可以不知疲倦地、不断地工作,并有着超强的战争能力,这些有可能导致人工智能出现失控和不可预知的后果。对于人类来说,永生是一个难题,也可以说是不可能的,因此我们做的很多选择都会被这个约束条件所限制,而人工智能是不会死亡,如果这样,它们必定不会是无私的,会分享的,会感知的,它们甚至不具备繁殖的愿望,它们的繁殖或许只是因为这样有利于种群的存亡,有利于世界的发展,它们只会进行无休止的占有,只关心自我存在,它们甚至会消灭人类,让自己作为世界的主体,因为这样会节约资源。当它不再需要人类帮他们进化完善的时候,我们就会被消灭,人工智能就会成为世界的霸主。

三、对如何控制人工智能行为的研究与展望

人工智能技术的研究和应用虽然推动了社会的发展,但也引发了一些我们对未来人工智能可能出现的问题的思考。人工智能进入我们的社会生活,虽然会促使劳动生产率的提升,但是人工智能有着远超传统社会人类工作的能力,如果它不断地繁衍,将会破坏社会的平衡,甚至会危害人类社会未来的发展。

为避免像《西部世界》中描述的那样,人工智能觉醒并反抗人类,我们必须规范对人工智能的研究。

图5 《西部世界》图

阿西莫夫在他的机器人科幻作品中定义了机器人的三大定律。第一条也是最重要第一条,机器人不可以做出对人类有危害的事,或者目睹人类个体将遭受危险而无动于衷。第二条,机器人必须服从人类给予它的命令,但是当这条命令与第一条冲突时,优先保证第一条。第三条,机器人在不违反第一、第二条的情况下要尽可能保护自己,让自己得以生存。也就是说人类必须在所有事物之前,并要合乎法律与道德。三大定律对避免人工智能朝不可控方向发展具有很大的借鉴意义。王璐认为,人工智能的设计应该重视科技理性与价值理性,必须坚持科技服务人类的根本价值取向,突出以人为本,强调公平正义,遵守伦理发展。

因为算法是人工智能技术的核心,有学者从算法层面讨论了怎样避免人工智能引发的风险。闫坤如认为,伦理学家与技术哲学家应当参与其中,人工智能设计必须遵循“合乎伦理设计”的规则。设计人工智能,必须在设计之初把人类道德与规范写到算法中,使人工智能系统的决策、行为具有可靠性与安全性。

除此之外还要规范责任惩罚机制。在人工智能的创作过程中,分工往往不是独立的,而是环环相扣的,确定人工智能的行为是由哪一阶段导致的是很困难的。因此,确认责任并事后问责是很困难的。我们在这方面还有很大的提升空间。

但有一点是最重要的,也是确定的。我们必须坚持“以人为本”“以德为先”“以法为界”的理性治理规则。人工智能风险研究的成果将会为进一步研究发展提供支撑、奠定基础。

目前对人工智能风险的研究仍存有不足,这体现在很多方面。比如研究分工不均,现在的研究成果大都体现在人工智能道德算法、人工智能设计伦理和人工智能应用,而人工智能道德哲学领域研究成果是相对来说比较薄弱的。另外,研究还不够深入。人工智能的研究存在技术的不确定性,研发过程中控制到什么程度才能确保不会引发风险以及如何针对人工智能决策危害人类这一现象进行控制和防范,这些问题需要我们继续深入研究。

四、总结

有人对人工智能的研究持悲观态度。我认为这其实是没有必要的,我们应该理性看待人工智能与人类发展的关系。因为人工智能是随人类意识创造产生的,人工智能每前进一步都是建立在人创新的基础上的。目前为止,人类仍然掌握着研发和应用人工智能各项技术的决定权和选择权。我们完全可以通过我们的智慧解决人工智能风险问题。因此,我们对人工智能的研究应该始终保持理性和清醒的态度,做到客观不悲观、预想不幻想。

参考文献

[1]苗存龙,王瑞林.人工智能应用的伦理风险研究综述[J].重庆理工大学学报(社会科学),2022,36(04):198-206.

[2]张佳欣.首个可自我繁殖活体机器人问世[N].科技日报,2021-12-01(004)

[3]朱洁颖.机器人能成为人吗?[J].科学大众(科学教育),2018,(04):189-190.

[4]韩雨,葛悦涛.2020年人工智能领域科技发展综述[J].飞航导弹,2021,(04):1-6+53.

[5]张茂杰,樊瑞科.人工智能技术背景下意识形态研究现状综述[J].福建省社会主义学院学报,2021,(01):72-80.

[6]张斌,鲁路加,王法中.国内人工智能标准化现状综述[J].信息技术与信息化,2020,(08):209-211.

浙公网安备 33010602011771号

浙公网安备 33010602011771号