hadoop简介

什么是HADOOP

(1)HADOOP是apache旗下的一套开源软件平台

(2)HADOOP提供的功能:利用服务器集群,根据用户的自定义业务逻辑,对海量数据进行分布式处理

- HADOOP的核心组件有

HDFS(分布式文件系统)

MAPREDUCE(分布式运算编程框架)

YARN(运算资源调度系统)

1.2 HADOOP产生背景

-

HADOOP最早起源于Nutch,Nutch的设计目标是构建一个大型的全网搜索引擎,包括网页抓取、索引、查询等功能,但随着抓取网页数量的增加,**遇到了严重的可扩展性问题——**如何解决数十亿网页的存储和索引问题。

-

2003年、2004年谷歌发表的两篇论文为该问题提供了可行的解决方案。

——分布式文件系统(GFS),可用于处理海量网页的存储

——分布式计算框架MAPREDUCE,可用于处理海量网页的索引计算问题。

- Nutch的开发人员完成了相应的开源实现HDFS和MAPREDUCE,并从Nutch中剥离成为独立项目HADOOP,到2008年1月,HADOOP成为Apache顶级项目,迎来了它的快速发展期。

1.3 HADOOP在大数据、云计算中的位置和关系

-

云计算是分布式计算、并行计算、网络计算、多核计算、网络存储、虚拟化、负载均衡等传统计算机技术和互联网技术融合发展的产物。借助IaaS(基础设施即服务)、PaaS(平台即服务)、SaaS(软件即服务)等业务模式,把强大的计算能力提供给终端用户。

-

现阶段,云计算的两大底层支撑技术为“虚拟化”和“大数据技术”

-

而HADOOP则是云计算的PaaS层的解决方案之一,并不等同于PaaS,更不等同于云计算本身。

1.4 HADOOP应用案例介绍

1、HADOOP应用于数据服务基础平台建设

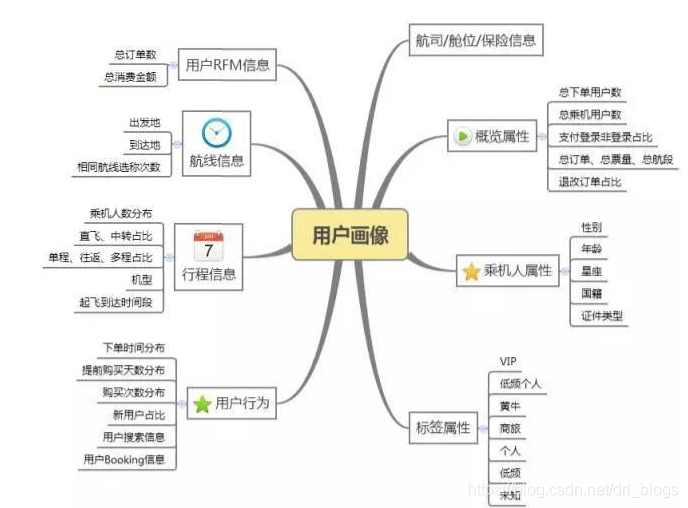

2.HADOOP用于用户画像

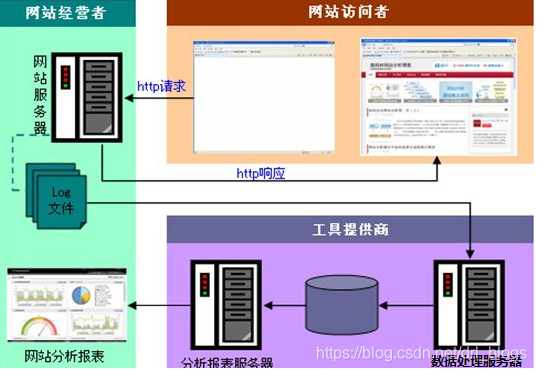

3、HADOOP用于网站点击流日志数据挖掘

分析:哪个页面点击的人比较多,哪个页面跳出的人多

![在这里插入图片描述]()

1.5 HADOOP的就业情况

-

HADOOP就业整体情况

-

大数据产业已纳入国家十三五规划

-

各大城市都在进行智慧城市项目建设,而智慧城市的根基就是大数据综合平台

-

互联网时代数据的种类,增长都呈现爆发式增长,各行业对数据的价值日益重视

-

相对于传统JAVAEE技术领域来说,大数据领域的人才相对稀缺

-

随着现代社会的发展,数据处理和数据挖掘的重要性只会增不会减,因此,大数据技术是一个尚在蓬勃发展且具有长远前景的领域

-

HADOOP就业职位要求

大数据是个复合专业,包括应用开发、软件平台、算法、数据挖掘等,因此,大数据技术领域的就业选择是多样的,但就HADOOP而言,通常都需要具备以下技能或知识:

-

HADOOP分布式集群的平台搭建

-

HADOOP分布式文件系统HDFS的原理理解及使用

-

HADOOP分布式运算框架MAPREDUCE的原理理解及编程

-

Hive数据仓库工具的熟练应用

-

Flume、sqoop、oozie等辅助工具的熟练使用

-

Shell/python等脚本语言的开发能力

-

HADOOP相关职位的薪资水平

大数据技术或具体到HADOOP的就业需求目前主要集中在北上广深一线城市,薪资待遇普遍高于传统JAVAEE开发人员,以北京为例:

![在这里插入图片描述]()

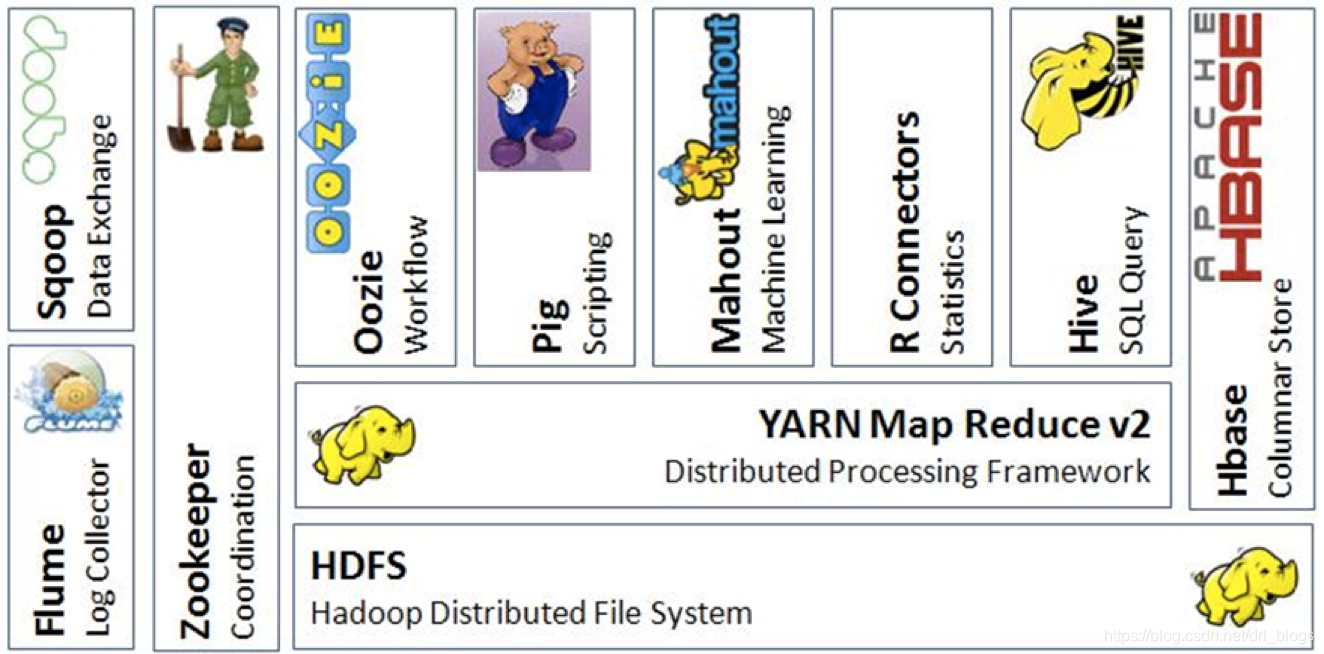

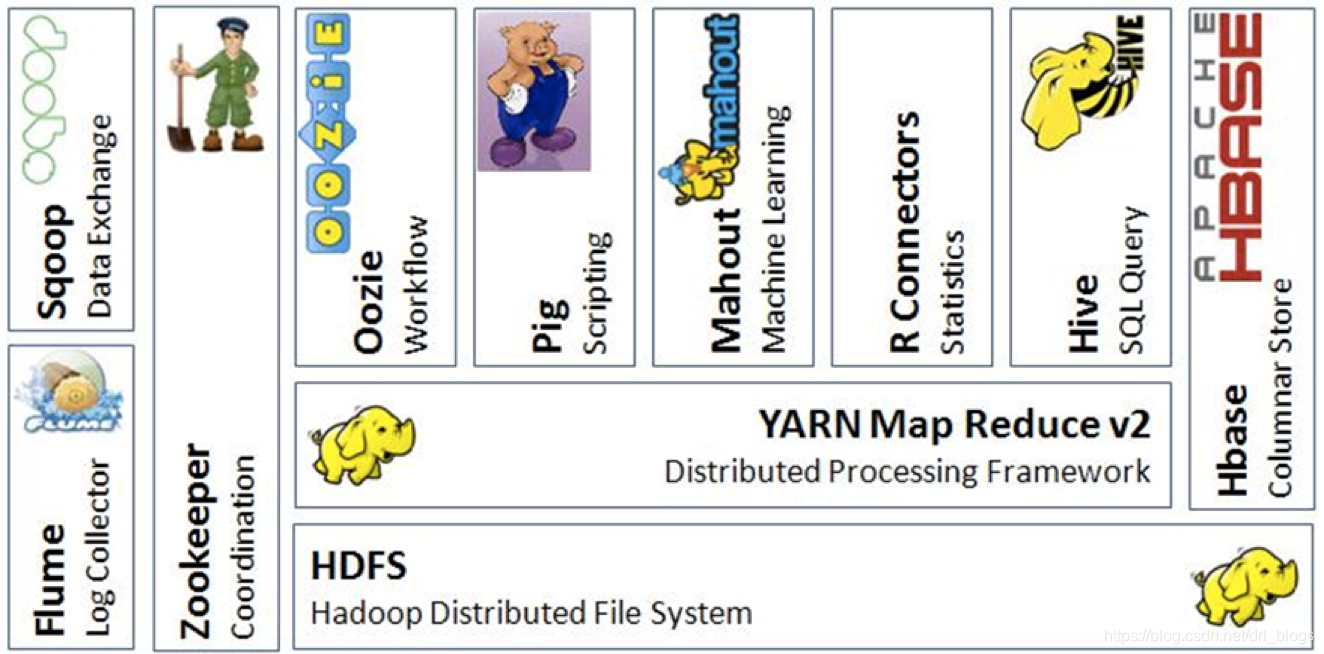

1.6 HADOOP生态圈以及各组成部分的简介

各组件简介

重点组件:

HDFS:分布式文件系统

MAPREDUCE:分布式运算程序开发框架

HIVE:基于大数据技术(文件系统+运算框架)的SQL数据仓库工具

HBASE:基于HADOOP的分布式海量数据库

ZOOKEEPER:分布式协调服务基础组件

Mahout:基于mapreduce/spark/flink等分布式运算框架的机器学习算法库

Oozie:工作流调度框架(Azakaba)

Sqoop:数据导入导出工具

Flume:日志数据采集框架

数据分析流程介绍

初步理解hadoop数据如何处理流程

一个应用广泛的数据分析系统:“web日志数据挖掘”

2.1 案例需求描述

“Web点击流日志”包含着网站运营很重要的信息,通过日志分析,我们可以知道网站的访问量,哪个网页访问人数最多,哪个网页最有价值,广告转化率、访客的来源信息,访客的终端信息等。

2.2 数据来源

本案例的数据主要由用户的点击行为记录

获取方式:在页面预埋一段js程序,为页面上想要监听的标签绑定事件,只要用户点击或移动到标签,即可触发ajax请求到后台servlet程序,用log4j记录下事件信息,从而在web服务器(nginx、tomcat等)上形成不断增长的日志文件。

2.3 数据流程解析

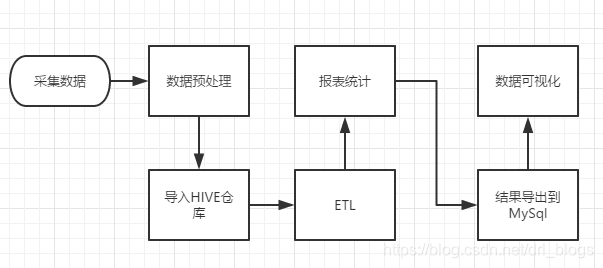

本案例跟典型的BI系统极其类似,整体流程如下:

但是,由于本案例的前提是处理海量数据,因而,流程中各环节所使用的技术则跟传统BI完全不同,后续课程都会一一讲解:

-

数据采集:定制开发采集程序,或使用开源框架FLUME

-

数据预处理:定制开发mapreduce程序运行于hadoop集群

-

数据仓库技术:基于hadoop之上的Hive

-

数据导出:基于hadoop的sqoop数据导入导出工具

-

数据可视化:定制开发web程序或使用kettle等产品

-

整个过程的流程调度:hadoop生态圈中的oozie工具或其他类似开源产品

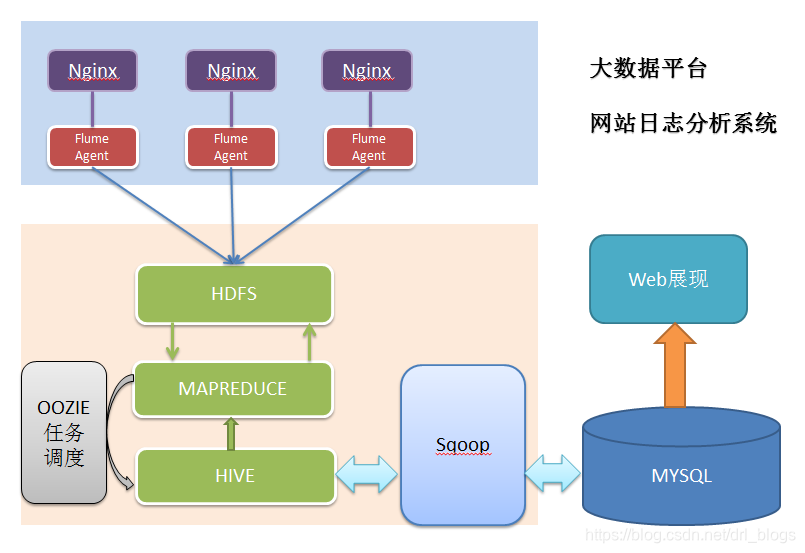

2.4 项目技术架构图

![在这里插入图片描述]()

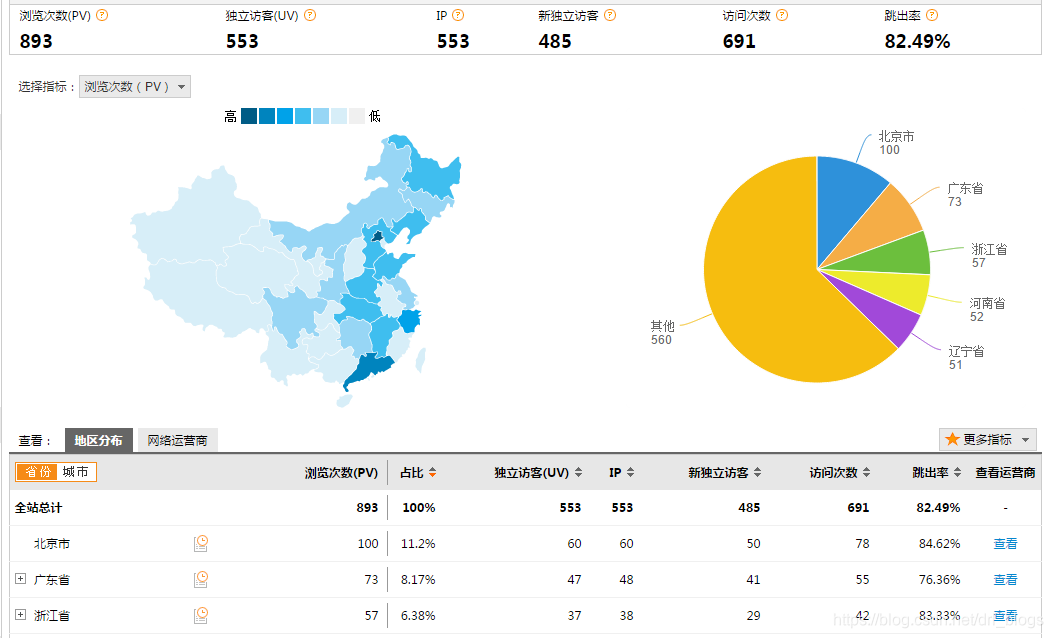

2.5 项目最终效果

经过完整的数据处理流程后,会周期性输出各类统计指标的报表,在生产实践中,最终需要将这些报表数据以可视化的形式展现出来,本案例采用web程序来实现数据可视化

效果如下所示:

浙公网安备 33010602011771号

浙公网安备 33010602011771号