LDA(Linear Discriminant Analysis)

一、引入

回想我们做回归时,如果特征太多,那么会产生不相关特征引入、过度拟合等问题。前面说了PCA降维,但PCA没有将类别标签考虑进去,属于无监督的。

比如一个文档中含有“learn”和“study”的问题,使用PCA后,也许可以将这两个特征合并为一个,降了维度。但假设我们的类标签 y 是判断这篇文章的topic是不是有关学习方面的,那么这两个特征对 y 几乎没有什么影响,完全可以去除。

再比如,假设我们对一张100*100像素的图片做人脸识别,每个像素是一个特征,那么会有10000个特征,而对应的类别标签 y 仅仅是0/1值,1代表是人脸。这么多特征不仅训练复杂,而且不必要特征对结果会带来不可预知的影响,但我们想得到降维后的一些最佳特征(与y关系最密切的),怎么办呢?

二、线性判别分析

1)(二类情况)

回顾我们之前的logistic回归方法,给定N个d维特征的训练样本例x(i){x1(i),x2(i),...,xd(i)}( i: 1-->N),每个x(i)对应一个类标签y(i)。其中有N1个样本属于ω1,另外N2个样本属于ω2。我们就是要学习出参数θ,使得 y(i) = g(θ)Tx(i)(g是sigmoid函数)。

现在想将d维特征降到只有一维,而又要保证类别能够“清晰”地反映在低维数据上,也就是这一维就能决定每个样例的类别。

我们将这个最佳的向量称为w(d维),那么样例x(d维)到w上的投影为:y = wTx。这里得到的y值不是0/1值,而是x投影到直线上的点到原点的距离。

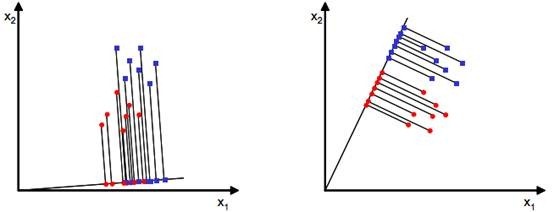

当x是二维的,我们就是要找一条直线(方向为w)来做投影,然后寻找最能使样本点分离的直线,如下图:

从直观上来看,右图比较好,可以很好地将不同类别的样本点分离。

如何寻找最佳的w?

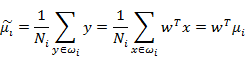

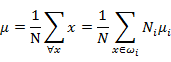

首先,计算每类样例的均值(中心点):μi = (1/Ni) Σx∈ωix

由于x到w投影后的样本点均值为:

所以,投影后的均值也就是样本中心点的投影。

什么是最佳直线(w)呢?

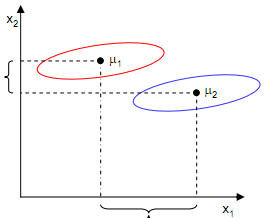

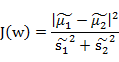

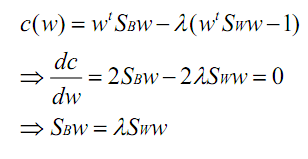

![]() ,J(w)越大越好。但是只考虑 J(w)也不行,如下图:

,J(w)越大越好。但是只考虑 J(w)也不行,如下图:

样本点均匀分布在椭圆里,投影到横轴x1上时能获得更大的中心点间距J(w),但是由于有重叠,x1不能分离样本点。投影到x2上,虽然 J(w)较小,但是能够分离样本点。因此我们还需要考虑样本点之间的方差,方差越大,样本点越难以分离。

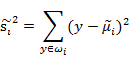

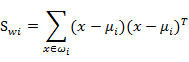

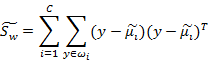

我们使用另一个度量值,称作散列值(scatter),对投影后的类求散列值,如下:

从公式中可以看出,只是少了除以样本数量的方差值,散列值的几何意义是样本点的密集程度,值越大,越分散,反之,越集中。

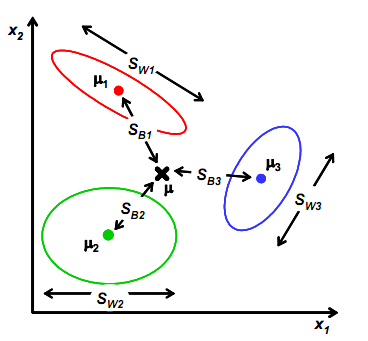

我们当然希望不同类别的样本点越分开越好,同类的越聚集越好,也就是均值差越大越好,散列值越小越好。我们使用J(w)和S来表示最终的度量公式:

接下来只需寻找J(w)最大的w即可。

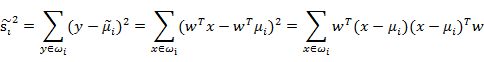

先把散列值公式展开:

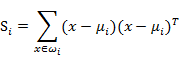

定义上式中间部分为Si :

(这不就是少了除以样例数的协方差矩阵吗?在此称为散列矩阵(scatter matrices))

(这不就是少了除以样例数的协方差矩阵吗?在此称为散列矩阵(scatter matrices))

Sw = S1 + S2 (Sw称为 Within-class scatter matrix)

得:

![]()

![]()

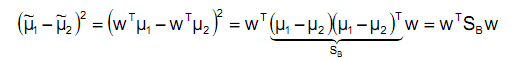

然后我们展开分子:

SB称为Between-class scatter,是两个向量的外积,虽然是个矩阵,但秩为1。

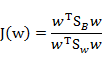

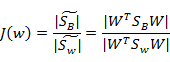

那么J(w)最终可表示为:

在求导之前,需要对分母进行归一化,因为不做归一的话,w扩大任何倍都成立,我们就无法确定w。因此令||wTSww||=1,那么加入拉格朗日乘子后,求导:

![]()

![]()

![]()

由于对 w 扩大缩小任何倍不影响结果,因此可约去两边的未知常数λ和λw,得到 ![]() 。

。

至此,我们只需要求出原始样本的均值和方差就可以求出最佳的方向w,上面二维样本的投影结果如下图:

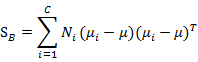

2)(多类情况)

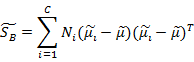

前面只是针对两类的情况,假设类别变成多个,那么要怎么改变,才能保证投影后类别能够分离呢?

而且,之前是讨论如何将 d 维降到一维,现在类别多了,一维可能已经不能满足要求。假设我们有 C 个类别,需要 k 维向量(基向量)来做投影。

将这 k 维向量表示为 W = [w1|w2|...|wk],样本点在这 k 维向量投影后结果表示为[y1,y2,...,yk],有以下公式成立:

![]()

![]()

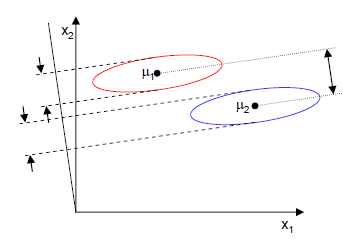

当样本是二维时,我们从几何意义上考虑:

其中μi 和Sw与上节的意义一样,Sw1是类别1里的样本点相对于该类中心点μ1 的散列程度。SB1变成类别1中心点相对于样本中心点μ 的协方差矩阵,即类1相对于μ 的散列程度。

,

,

SB需要变,原来度量的是两个均值点的散列情况,现在度量的是每类均值点相对于样本中心的散列情况。类似于将μi 看作样本点,μ 是均值的协方差矩阵,如果某类里面的样本点较多,那么其权重稍大,权重用Ni/N表示,但由于J(w)对倍数不敏感,因此用Ni。

,其中

,其中  ,μ是所有样本的均值。

,μ是所有样本的均值。

上面讨论的都是在投影前的公式变化,但真正的J(w)的分子分母都是在投影后计算的。下面我们看样本点投影后的公式改变:

第i 类样本点在某基向量上投影后的均值计算公式:

下面两个是在某基向量上投影后的Sw 和 SB:

综合各个投影向量(w)上的![]() 和

和![]() ,更新这两个参数,得到:

,更新这两个参数,得到:

![]() ,

, ![]()

W是基向量矩阵,![]() 是投影后的各个类内部的散列矩阵之和,

是投影后的各个类内部的散列矩阵之和,![]() 是投影后各个类中心相对于全样本中心投影的散列矩阵之和。

是投影后各个类中心相对于全样本中心投影的散列矩阵之和。

上面两类情况,对于J(w),分子是两类中心距,分母是每个类自己的散列度。现投影方向是多维了(好几条直线),分子不是求两两样本中心距之和(这个对描述类别间的分散度没有用),而是求每类中心相对于全样本中心的散列度之和。最后的J(w)形式是:

整个问题又回归为求J(w)最大值了,我们固定分母为1,然后求导,得出最后结果:

![]() ,与上节得出的结论一样,

,与上节得出的结论一样, ![]()

最后还归结到了求矩阵的特征值上来。首先求出 ![]() 的特征值,然后取前k个特征向量组成W矩阵即可。

的特征值,然后取前k个特征向量组成W矩阵即可。

注意:由于SB中的(µi - µ)秩为1,因此SB的秩至多为C(矩阵的秩小于等于各个相加矩阵的秩的和)。由于知道了前C-1个µi 后,最后一个µc 可以有前面的µi 来线性表示,因此SB的秩至多为C-1.那么k最大为C-1,即特征向量最多有C-1个。特征值大的对应的特征向量分割性能最好。

由于 ![]() 不一定是对称阵,因此得到的k个特征向量不一定正交,这也是与PCA不同的地方。

不一定是对称阵,因此得到的k个特征向量不一定正交,这也是与PCA不同的地方。

转自:http://www.cnblogs.com/jerrylead/archive/2011/04/21/2024384.html

浙公网安备 33010602011771号

浙公网安备 33010602011771号