知识引导上下文优化(KgCoOp):一种解决灾难性遗忘的 Prompt Tuning 机制

视觉-语言模型(VLMs)如 CLIP 彻底改变了零样本图像识别的处理方式。这类模型在包含 4 亿个图像-文本对的大规模数据集上进行训练,捕获了海量通用知识,具备了识别未被明确训练过对象的能力。

当尝试通过 Prompt Tuning 过程将这些全能型模型适配到特定下游任务时通常会遇到瓶颈。这是因为模型在特定任务上变成了专家,却不可避免地牺牲了原有的基础智能;这种现象在业内被称为 Base-to-New 泛化困境。

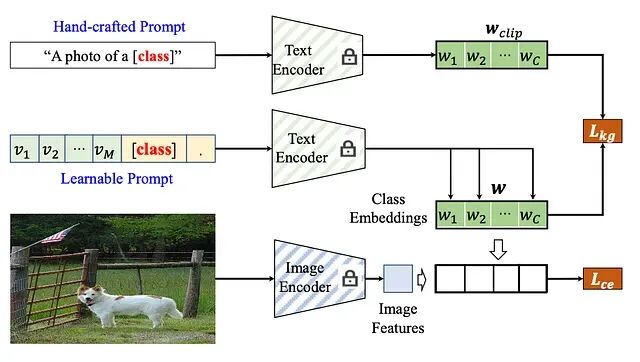

论文《Visual-Language Prompt Tuning with Knowledge-guided Context Optimization》(KgCoOp)深入研究了这一问题,提出了一种简单有效的约束机制。

现代机器学习系统经常被部署在不断有新类别出现的环境中。如果一个模型只能在已知类别上保持高准确率,面对新类别时却表现糟糕,其在实际工程应用中的可靠性就会大打折扣。提高对未见类别的泛化能力,是构建泛化的视觉-语言系统的必由之路。

Knowledge-guided Context Optimization(KgCoOp)框架概述,展示了如何使用知识引导损失对可学习 Prompt 进行正则化以保持泛化能力。

https://avoid.overfit.cn/post/b69868a130b04d6e949a26a60dcdca79

浙公网安备 33010602011771号

浙公网安备 33010602011771号