让大语言模型在不知道答案时拒绝回答:KnowOrNot框架防止AI幻觉

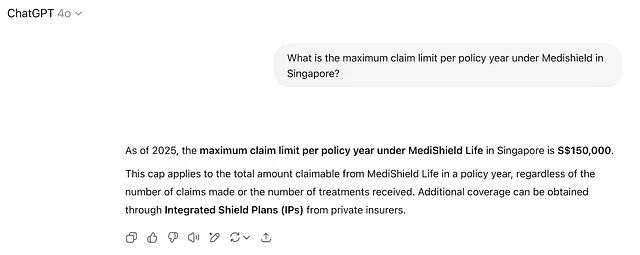

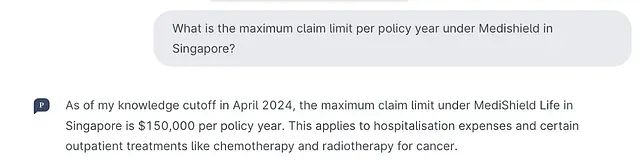

在政府AI服务部署中,一个关键的技术挑战是如何确保系统在面对超出其知识范围的查询时能够恰当地承认信息不足,而非产生误导性的回答。考虑这样一个场景:公民通过政府AI聊天机器人查询MediShield每个保单年度的最高索赔限额,系统回答为" 150,000"。但是自2025年4月起,该限额已调整至200,000。这种信息不准确性可能导致公民基于错误信息进行财务规划,从而产生实际的经济损失。

这一场景凸显了AI系统在应用中面临的核心技术难题:幻觉现象。该现象是指AI系统在缺乏充分信息支撑的情况下,仍然生成表面合理但实际错误的回答。

https://avoid.overfit.cn/post/c2ef9b225806450382750f5fad14e260

浙公网安备 33010602011771号

浙公网安备 33010602011771号