一文看懂 WebTransport、SRT、WebRTC、RTSP、RTMP、HTTP-FLV、WS-FLV、GB28181协议生态的时代分工与工程落地

引言:协议从不是“接口定义”,而是整个系统的时间与行为准则

在日常开发中,许多人将“协议”理解为一套数据结构或接口格式;但在真正的实时音视频系统中,协议远不止于此。

从 SmartMediaKit 这样跨平台、跨设备、跨网络的系统级 SDK 的角度看——

协议 = 传输模型 + 媒体语义 + 缓冲策略 + 控制机制 + 时间线(TimeLine)约束 + 状态机行为

也就是说,一个协议不仅决定“数据怎么传”,更决定:

-

时间如何组织(时基 / DTS / PTS)

-

播放器如何解读流(封装语义)

-

网络如何处理丢包/重传(可靠性语义)

-

控制指令如何协作(信令层语义)

-

缓冲何时推进、帧序何时丢弃(播放语义)

不同协议的这些“系统语义”差异极大,导致对应的工程架构、时间线模型、传输策略与调度逻辑也完全不同。

因此,本文并非简单对比“功能”或“场景”,而是基于 官方规范(spec) 的语义层级出发,结合大牛直播SDK在 Android / iOS / Windows / Linux / Unity 的完整工程实践,对八大常见协议进行体系化、工程化的深度分析。

第一章:从规范(spec)视角重新划分协议生态 —— 它们到底“属于哪一类”?

当我们从开发者角度看协议时,往往关注 API 和数据格式;但从 规范(spec)和系统语义(System Semantics) 的角度重新审视,会发现这些协议其实分属于完全不同的层级,其“职责边界”差异巨大——这决定了它们在工程体系中的定位、能力与限制。

从 IETF / W3C / 行业标准(公安国标、流媒体行业规范)三个体系来看,实时音视频相关协议大致分为 四大类:

① 传输层协议(Transport Layer)——只负责“怎么传”,不负责“内容是什么”

典型特征:

-

不定义音视频格式

-

不包含媒体时间线语义(PTS/DTS)

-

不包含流媒体行为语义(关键帧、序列头、丢包策略)

-

只提供 “bytes over network” 的可靠/不可靠传输

代表协议:

-

WebTransport(QUIC over HTTP/3)

-

SRT(Secure Reliable Transport)

关键价值:

为音视频提供“可控且可编排”的传输通道,可自定义媒体格式。

② 媒体承载层协议(Media Framing)——负责媒体的“封装 / 时间线 / 打包规则”

典型特征:

-

定义音视频 ES(Elementary Stream)在网络中的封装方式

-

定义 PTS/DTS/SeqHeader、包头语义

-

定义是否分片、是否可 seek、是否流式

代表协议:

-

RTP / RTCP(IETF RFC 3550)

-

FLV Tag Format

-

MPEG-PS(GB28181 的媒体层)

这些协议决定:

-

H.264 如何被分片

-

AAC 如何被封装

-

时间戳如何推进

-

是否可用于直播、点播或本地文件

③ 应用层流媒体协议(Streaming Protocol)——负责“如何播放、如何推流”

典型特征:

-

定义媒体时序逻辑(TimeLine)

-

定义流式播放语义(Start/Stop/Seek)

-

定义直播行为(序列头、关键帧、Tag、Mux/DeMux)

-

对媒体格式有强约束(如 RTMP/FLV 必须是 H.264/AAC)

代表协议:

-

RTMP(Adobe)

-

HTTP-FLV

-

WS-FLV

这些协议不仅传输媒体,还定义媒体如何被解释,因此属于“上层播放协议”。

④ 行业控制协议(Industry Control Protocol)——负责“业务语义和指令协同”

这类协议不仅传输媒体,还包含整套“行业语义”:

-

注册、心跳

-

目录查询

-

云台 PTZ 控制

-

回看

-

报警

-

AI 事件

-

播放权限 / 设备管理

典型代表:

-

GB28181(SIP + RTP/PS + 行业扩展)

与一般的媒体协议不同,它是一套“视频监控平台规范”,涉及信令、媒体、设备管理的全系统能力。

协议分层结构总览

下面是一个更系统化的对应关系表,清晰体现“协议 → 层级 → 规范来源”的关系:

| 协议 | 协议类型(所属层级) | 官方规范(spec)来源 | 是否定义媒体格式 | 是否包含控制语义 |

|---|---|---|---|---|

| WebTransport | 传输层 | IETF QUIC WG + W3C WT WG | ❌ | ❌ |

| SRT | 传输层 | Haivision SRT Protocol Spec | ❌ | ❌ |

| WebRTC | 全栈实时交互框架 | IETF(ICE/DTLS/SRTP/RTP)+ W3C WebRTC | 部分(Opus/VP8/VP9/H264) | ✔(P2P信令+ICE) |

| RTSP | 控制层流媒体协议 | IETF RFC 2326 / 7826 | 由 RTP 承载决定 | ✔(SETUP/PLAY/PTZ) |

| RTMP | 应用层流媒体协议 | Adobe RTMP Spec | ✔(H.264/AAC) | ✔(publish/play) |

| HTTP-FLV | 应用层直播封装协议 | Adobe FLV + HTTP/1.1 | ✔ | ❌ |

| WS-FLV | Web流媒体协议 | RFC 6455 WebSocket + FLV Spec | ✔ | ❌ |

| GB28181 | 行业控制协议体系 | MIIT 国标(SIP+RTP/PS) | ✔(MPEG-PS) | ✔(目录/PTZ/回放) |

为什么这样划分很重要?

因为不同层级协议意味着不同工程能力:

| 层级 | 工程意义 |

|---|---|

| 传输层 | 决定延迟、丢包、抖动、可靠性 |

| 媒体承载 | 决定码流如何解析、如何同步、如何解码 |

| 流媒体协议 | 决定播放器行为、首帧时间、延迟模型 |

| 行业控制协议 | 决定是否“能对接平台/能控设备” |

如果协议理解错层级,会造成:

-

缓冲策略设计错误

-

播放器架构无法复用

-

时间线错乱(DTS/PTS)

-

自适应策略失效

-

服务端/客户端逻辑混乱

-

无法跨平台一致(Android/iOS/Windows/Unity)

大牛直播SDK将协议按层级拆分为模块,才实现:

-

跨协议统一时间线(TimeBase)

-

跨协议统一解码器/渲染器

-

跨协议统一录制(MP4/FLV)

-

跨协议统一边缘计算(AI pipeline)

第二章:WebTransport(WT)—— 基于 QUIC 的下一代 Web 实时传输基座

WebTransport 是近年来快速成长、被视为 Web 实时传输未来方向的技术体系。它不是单一协议,而是由 W3C + IETF 两大标准组织联合推动的“新一代 Web 实时传输基础设施”。严格意义上,WebTransport 并不负责音视频本身,而是为 Web 提供一个 低延迟、可控、多路复用、具备安全模型的传输层能力。

2.1 WT 的规范基础(spec-level)

WebTransport 的底层基石是 QUIC(HTTP/3),而它本身是建立在 QUIC 之上的传输能力扩展。核心规范来源包括:

✓ RFC 9000:QUIC — 新一代传输协议的根基

QUIC 由 Google 发起,由 IETF QUIC 工作组制定,带来传输层的革命性增强:

-

基于 UDP 的传输模型(避免 TCP 队头阻塞)

-

TLS 1.3 内置加密(握手即加密,不可关闭)

-

多路复用 Stream(连接内多个逻辑通道互不影响)

-

0-RTT / 1-RTT 握手(极低握手延迟)

-

连接迁移(Connection Migration)(网络切换不掉线)

这些特性决定了 WebTransport 在“实时性”和“网络适应性”上远胜 WebSocket。

✓ WebTransport over HTTP/3(W3C Editor’s Draft)

WT 的语义定义来自 W3C 草案,提供比 WebSocket 更强的通道类型:

1)可靠传输 Stream(WebTransport Streams)

适用于:

-

配置数据

-

控制指令

-

元数据通道

2)不可靠传输 Datagram(WebTransport Datagrams)

适用于典型实时应用:

-

视频帧数据

-

传感器数据

-

AI 推理结果

-

实时游戏数据

WT 特别指出:

Datagram 可能不可靠、不保证顺序,是为“实时性优先”的场景设计的。

3)强安全模型(同源策略)

-

完全基于 HTTP/3 / QUIC 安全体系

-

必须遵循浏览器的同源策略(不像 WebRTC 可跨域)

-

天然具备 TLS 1.3

✓ 最关键的一点:WebTransport 不定义媒体格式

WT 只定义“如何传输”,不定义“传输什么”。

因此开发者必须自行封装媒体数据。例如:

-

RTP over WebTransport

-

原始 H.264/H.265 NALU

-

AAC/Opus ES

-

自定义二进制协议(如大牛直播SDK内部协议)

-

FLV over WT(理论上可行)

换言之:

WT 是传输基座,不是流媒体协议。媒体语义完全由 SDK 设计决定。

这也是像 大牛直播SDK(SmartMediaKit) 这种系统级 SDK 的价值,它需要负责:

-

媒体打包

-

时间戳对齐

-

码流分片

-

重建播放时序

-

统一解码管线

-

控制/数据多路通道协调

2.2 WebTransport 的典型适用场景

✔ 1)Web 场景的低延迟直播 / 准实时播控

例如:

-

AI 视频平台

-

Web 侧实时监控

-

教育/互动课堂

-

实时仪表盘

相比 WebSocket,它具备:

-

更低延迟

-

不会因一个通道阻塞而影响整体

-

真正意义上的“实时数据流”能力

✔ 2)Browser ↔ Edge AI 数据通路

WT 的 Datagram 特别适合作为 AI 推理结果的回传通道:

-

视频流(Datagram)

-

AI BBox/JSON(Stream)

-

控制指令(Stream)

浏览器与边缘节点之间,可通过 WT 实现 毫秒级视觉交互。

✔ 3)替代 WebSocket 的高性能双向通道

WebSocket 的缺点:

-

基于 TCP → 队头阻塞

-

单通道(没有多路 Stream)

-

二进制效率有限

-

无“实时数据报”通道

WT 正是为此而生。

✔ 4)替代部分 WebRTC 用于一对多 Web 分发

WebRTC 的缺点:

-

强制加密、强制多媒体栈(不适用于任意格式)

-

复杂(ICE/STUN/TURN/SRTP/RTCP)

-

端到端难扩展为一对多

WT 则提供:

-

可控

-

可扩展

-

更像“Web 版的 SRT”

2.3 WebTransport 的当前限制(标准化进度和工程现实)

尽管 WT 很强,但它仍处在早期阶段,存在以下限制:

✘ 浏览器支持仍不完整

-

Chrome:主力支持

-

Safari:部分实验性

-

Edge:依托 Chromium,但非全支持

-

Firefox:仍在长期开发中

这限制了 WT 的大规模商用落地。

✘ 不具备“媒体能力”

WT 本身不提供:

-

编码

-

解码

-

静态码流约束

-

FEC

-

拥塞管理(依赖 QUIC 的基础逻辑)

-

JitterBuffer

它只是“管道”,媒体能力必须在 SDK 内实现。

✘ 不包含 RTSP / WebRTC 那样的控制语义

WT 没有:

-

SETUP / PLAY / PAUSE

-

Track/SSRC 逻辑

-

RTP/RTCP 反馈

-

ICE/STUN/TURN 穿透

-

媒体协商(Offer/Answer)

需要 SDK 自己构建完整的媒体与控制框架。

✘ QUIC 本身并非为极端低延迟场景设计

WT 的延迟表现受限于:

-

QUIC 的拥塞控制策略

-

服务器实现细节

-

HTTP/3 的 framing 模型

在极端低延迟(如 50–100ms)场景中依然难以与 WebRTC 竞争。

小结:WebTransport 的本质地位

如果用一句话总结 WT:

它不是流媒体协议,而是给 Web 构建“下一代实时传输管道”的基础设施。

媒体语义由上层决定,这正是系统级 SDK 的价值所在。

第三章:SRT —— 以 ARQ 为核心的工业级低延迟可靠传输协议

SRT(Secure Reliable Transport)是由 Haivision 开源并推动标准化的实时传输协议,旨在在 高丢包、不稳定网络、公网跨地域链路 中提供较低延迟、可靠传输能力。它不是“流媒体协议”,而是传输层上的媒体透明管道,与 QUIC / WebTransport 一样,在系统架构中属于传输基础设施。

3.1 SRT 的规范基础(SRT Protocol Specification v1.5+)

根据官方 SRT Protocol Specification(1.4—1.5 及后续草案),SRT 的设计核心由以下三大关键模块组成:

① UDP 基础传输(Best-Effort Transport over UDP)

SRT 基于 UDP,不受 TCP 队头阻塞影响,传输速率与延迟主要由:

-

RTT

-

NAK 触发的重传机制

-

发送窗口与接收窗口大小

-

带宽与抖动

共同决定。

UDP 是其基础,使其具备:

-

低延迟

-

可控丢包恢复

-

跨公网穿透的灵活性

② ARQ 重传机制(NAK-based Automatic Repeat reQuest)

SRT 的核心是 NAK-based ARQ:

-

接收端检测丢包

-

发送 NAK(Negative ACK)

-

发送端根据接收端反馈重传对应包

-

SRT 根据 RTT 估计和窗口控制,动态调整重传策略

与 TCP 不同:

-

不按顺序强制等待丢失包(无队头阻塞)

-

丢包恢复在“可控延迟窗口”内进行

-

在延迟预算允许范围内尽量恢复画面质量

这正是 SRT 成为“低延迟可靠传输”的核心原因。

③ 可调节延迟缓存(Configurable Latency Buffer)

SRT 接收端有一个 “Latency Buffer” 用于:

-

抵抗抖动

-

等待重传包

-

维持播放时间线

这个延迟是可调的(通常范围 50–800ms),工程上最低可配置到几十毫秒,但丢包环境越恶劣,需要的缓冲越大。

这就是为什么:

-

SRT 能做到 比 TCP 更稳

-

也能做到 比 WebRTC 更可控

-

延迟比 RTMP 更低,但不可能比纯 UDP/RTP 更低(因为有重传)

SRT 规范中其他工程关键能力

根据最新 SRT Spec(包含草案):

✓ 支持任意码流(TS/PS/ES/FLV/私有流)透明传输

SRT 不理解流内部的媒体结构,它只传 bytes。

✓ AES-128/192/256 加密

传输层安全可选,但推荐默认开启。

✓ Rendezvous Mode(点对点 NAT 穿透)

无需固定 server-client 角色,可双向打洞。

✓ Packet Filtering

可根据 Session ID / 包头字段做过滤。

✓ Live Mode / File Mode

-

Live Mode :严格实时模式(适合直播)

-

File Mode:保证完整性(适合文件重传)

✓ Bonding / MultiPath(草案)

未来 SRT 将支持链路聚合、冗余发送(类似 RIST)。

这些能力决定了 SRT 在“弱网络、高丢包”环境中的工程价值远高于传统 RTP/RTMP。

3.2 SRT 最典型的应用场景

SRT 的定位是“工业级长链路实时传输”,最适合以下业务:

✔ 广电节目级视频回传(Studio ↔ OB Truck)

-

UHD / HDR 视频

-

必须稳定、无明显 artifacts

-

公网/卫星链路

✔ 公网跨省/跨境的实时传输

(如企业直播信号 → 云平台)

高丢包场景中 SRT 的 ARQ 能保持质量且延迟可控。

✔ 电信/运营商机房中跨地区链路

链路复杂、抖动大,但要求大带宽。

✔ 高丢包环境(5%–20%)下的视频传输

WebRTC 的 FEC 在高丢包下成本巨大,而 SRT 的重传机制更具性价比。

✔ 大规模的“高可靠私有链路”

如:

-

大型演唱会视频链路

-

云导播

-

云制作

-

公安/应急指挥中心视频调度

3.3 SRT 的局限性(从工程体系角度看)

SRT 很强,但也有明确的边界,这些边界决定了它不能替代 RTMP/WebRTC/RTSP。

✘ 1)不适合 Web —— 浏览器没有支持能力

浏览器环境下:

-

无 QUIC API

-

无 Raw UDP

-

无自定义 socket API

-

WebAssembly 也无法直接访问 UDP

因此:

SRT 无法直接用于 H5

只能通过 MediaServer ↔ SRT ↔ Server ↔ Web 的链式转协议解决。

✘ 2)SRT 是纯传输协议,不定义媒体结构

它不规定:

-

时间戳语义(PTS/DTS)

-

封装格式(RTP/FLV/TS...)

-

关键帧行为

-

媒体协商

全部需要 SDK 层自己解决。

对系统 SDK(如大牛直播SDK)来说,需要处理:

-

封装格式

-

时间线同步

-

解码队列

-

缓冲策略

-

码流恢复

因此 SRT 的集成难度比 RTMP/FLV 要高得多。

✘ 3)控制层弱(几乎没有业务语义)

SRT 没有:

-

PTZ

-

目录

-

AI 事件

-

点播/回放语义

-

SETUP/PLAY/Pause

-

媒体 track 结构

-

信令协商机制

因此它不能替代:

-

RTSP(摄像头行业)

-

GB28181(公安行业)

-

WebRTC(交互行业)

小结:SRT 的本质定位

如果用一句话总结 SRT:

SRT 是一个为恶劣网络环境设计的、面向专业实时视频的 ARQ 可靠传输协议。

它不是播放协议,也不是媒体协议,而是媒体链路中的工业级传输地基。

第四章:WebRTC —— 由 IETF + W3C 共同定义的全栈级实时交互标准体系

WebRTC(Web Real-Time Communication)是目前 Web 实时交互领域最完整、最复杂、也是最难被替代的技术体系。不同于 RTMP、FLV、SRT 这些仅覆盖部分能力的协议,WebRTC 是一个 “协议族 + 安全体系 + 编码规范 + 浏览器 API + 媒体处理体系” 共同组成的完整实时音视频框架。

它并不是一个“协议”,而是一套跨传输层、媒体层、安全层、应用层的全栈标准。

4.1 WebRTC = 一个庞大的规范族(Standards Family),而非单一协议

WebRTC 的能力由 IETF(网络传输与安全)和 W3C(浏览器 API)两个组织同时定义,其规范体系包括四个主要领域:

① 传输与连接(IETF)

WebRTC 的网络穿透与传输能力来源于一系列底层标准:

| 能力 | 规范 | 作用 |

|---|---|---|

| ICE | RFC 5245 | 网络路径选择 & 打洞策略 |

| STUN | RFC 5389 | 获取公网地址(NAT Traversal) |

| TURN | RFC 5766 | 中继能力,无法直接打洞时使用 |

| RTP/RTCP | RFC 3550 / 3551 | 含时间戳、序列号、抖动控制、统计反馈 |

这些规范共同实现:

-

NAT 穿透

-

地址协商

-

多路径网络选择

-

流控与统计反馈

是 WebRTC 能够在复杂网络中保持低延迟的关键。

② 安全体系(IETF)

WebRTC 强制要求“端到端加密”,这由以下标准保障:

| 能力 | 规范 | 说明 |

|---|---|---|

| DTLS-SRTP | RFC 5763 | 用 DTLS 握手建立 SRTP 密钥 |

| SRTP | RFC 3711 | 媒体数据加密(AES CM) |

这意味着:

-

WebRTC 不允许明文传输媒体

-

连接建立时必须完成密钥交换

-

加密不可被关闭(浏览器级强制)

这一点与 RTMP/RTSP/FLV 完全不同。

③ 媒体规范(IETF / W3C)

WebRTC 对音视频格式有强制要求:

音频

-

Opus(强制支持)

-

G.711、ISAC(部分场景)

视频

-

VP8(强制支持)

-

H.264(Mandatory to Implement,对浏览器厂商)

-

VP9(可选)

-

AV1(逐步支持)

附加媒体能力

-

RTP Payload Format(H.264/VP8/Opus 的 RTP 封装规则)

-

RTCP 反馈(NACK、PLI、FIR、REMB)

-

FEC、RED(纠错)

WebRTC 的媒体层是完整、专业且复杂的,有自己的:

-

音频处理链路(AEC/AGC/NS)

-

视频编码器

-

带宽估计(Google Congestion Control)

-

JitterBuffer

-

时间戳管理(RTP Clock → Media Clock)

④ 浏览器 API(W3C)

WebRTC 在 Web 环境使用的是:

-

WebRTC 1.0 Candidate Recommendation

-

RTCPeerConnection -

MediaStreamTrack -

getUserMedia -

Insertable Streams / SFrame

这部分使得 WebRTC 成为浏览器原生可用的实时交互体系。

综上:WebRTC 是一个全栈实时系统,而不是一个协议

它同时包括:

-

网络穿透

-

加密

-

编解码

-

RTP/RTCP 媒体传输

-

自动媒体链路

-

浏览器 API

-

Jitter Buffer

-

自动流控与码率调节

因此在工程体系中,WebRTC 的集成成本远高于 RTMP/SRT/FLV,但带来的实时性体验无可替代。

4.2 WebRTC 的核心语义(工程师必须理解的关键点)

以下是 WebRTC 能在实时交互领域保持统治力的根本原因:

① 超低延迟(<200ms)

通过:

-

UDP 传输

-

JitterBuffer

-

Congestion Control

-

SRTP 加密优化

-

关键帧请求(PLI/FIR)

-

RTP 分片优化

WebRTC 是目前可大规模落地的最低延迟交互协议。

② 自适应码率(ABR)

由 Google BWE(Bandwidth Estimation)完成:

-

根据丢包/RTT/抖动动态调节码率

-

自动选择分辨率与帧率

-

能在 200kbps ~ 数 Mbps 自动切换

这是传统 RTMP/SRT/RTSP 都不具备的系统能力。

③ 先进音频处理链(AEC3)

包括:

-

回声消除(AEC3)

-

自动增益(AGC)

-

降噪(NS)

-

能量检测(VAD)

是双工交互体验成功的关键。

④ 全内置 Jitter Buffer

用于处理:

-

网络抖动

-

包的乱序

-

延迟对齐

-

与解码器的同步

这是实现“自然连续体验”的关键模块。

⑤ 强制加密(SRTP)

所有媒体必须加密,这满足:

-

企业安全

-

车载/物联网安全场景

-

Web 平台安全

⑥ 编码器格式受限

WebRTC 只能使用浏览器强制支持的编码:

-

VP8

-

H.264

-

Opus

无法直接传输 H.265/H.266/AVS3,这使其不适合“可控码流”场景。

4.3 WebRTC 最适用的业务场景

WebRTC 的定位非常清晰,它不是直播协议,而是“实时双工交互协议体系”。

✔ 1)双向自然通话

即“边说边听”的核心场景:

-

实时客服

-

视频通话

-

家庭通话设备

-

对讲系统

✔ 2)IM、会议、协作

包括:

-

多方音视频会议

-

共享屏幕

-

文件实时同步

-

Web 坐席系统

WebRTC 的自动带宽适配能力使其在会议场景中优势明显。

✔ 3)车载语音交互 / 智能座舱

-

语音助手

-

车机端自然对话

-

无线接入交互链路

-

智能导航对话

WebRTC 内置回声消除 + 自动增益非常适合车内环境。

✔ 4)机器人 / 无人机的低延迟双工控制

-

实时视频 + 控制

-

“边走边说”场景

-

双向音频

-

控制闭环要求高

WebRTC 在深度交互方面的低延迟优势非常明显。

总结一句话:

WebRTC 是一个为“实时双工交互”设计的全栈协议体系,提供从网络穿透到媒体处理的全流程能力。

它不是万能协议,但在“人机交互”、“通讯”、“协作”领域不可替代。

第五章:RTSP —— 摄像头与 AI 时代的事实标准协议体系

RTSP(Real-Time Streaming Protocol)自 1998 年诞生以来,一直是全球摄像头、工业视频、机器人视觉、无人机与 AI 系统连接的“事实标准”。

它的本质并不是媒体协议,而是 流媒体控制协议(Control Protocol),媒体真正的传输由 RTP/RTCP 完成。

换句话说:

RTSP ≈ 控制层(播放、寻址、会话)

RTP/RTCP ≈ 媒体层(时序、数据包、反馈)

这种“控制 + 媒体分离”的结构,使 RTSP 在设备侧长期稳站 C 位。

5.1 RTSP 规范体系:由 RFC 2326 → RFC 7826 的进化

RTSP 的规范完整由 IETF 管辖,标准体系包括两个核心里程碑:

① RFC 2326(1998)—— RTSP 1.0 起源标准

这是全球摄像头、NVR、DVR、安防设备采用的版本,也是目前使用最广、最兼容的事实标准(绝大多数设备仍停留在 1.0)。

它定义了所有基础能力:

-

SETUP:建立媒体通道(RTP/RTCP over UDP/TCP)

-

PLAY:开始发送 RTP

-

PAUSE:暂停媒体流

-

TEARDOWN:释放会话资源

-

OPTIONS / DESCRIBE:能力查询与 SDP 交换

-

Range:播放范围(用于回看)

-

Scale:倍速播放

以及跨协议关键支柱:

-

RTP Timebase(基于 RFC 3550)

-

RTCP Receiver Report(丢包、抖动、延迟反馈)

② RFC 7826(2016)—— RTSP 2.0 的现代化升级

RTSP 2.0 对整个协议进行了系统性增强:

-

连接模型改进

-

明确状态机定义

-

多路 RTP 流支持更清晰

-

错误码丰富

-

时间格式规范化

-

SDP 扩展增强

但由于兼容性与行业生态惯性,目前 大部分摄像头仍停留在 RTSP 1.0,RTSP 2.0 只在少量云平台与高端设备上使用。

5.2 RTP 规范族:RTSP 的媒体核心基础

RTSP 本身不携带媒体,它只是“指挥官”,真正负责音视频数据传输的是 RTP 与 RTCP。

RTP 相关的媒体规范非常庞大,其中与摄像头最相关的是:

① RTP 基础协议

-

RFC 3550:RTP(实时传输协议)

-

90kHz 时钟(视频)

-

Sequence Number

-

Timestamp

-

丢包检测

-

乱序处理

-

JitterBuffer 理论基础

-

-

RFC 3551:RTP Profile for Audio/Video Conferences

② 视频 Payload 规范

-

H.264 RTP Payload(RFC 6184)

-

NALU 分片(FU-A/FU-B)

-

STAP-A 聚合

-

SPS/PPS 传输规则

-

-

H.265 RTP Payload(RFC 7798)

-

VPS/SPS/PPS

-

分层编码结构

-

这些规范定义了“视频包在网络中如何分片与组装”。

③ 音频 Payload 规范

-

AAC RTP Payload(RFC 3640)

-

G.711 / G.726(各自的 RTP Payload 定义)

RTP Payload 规范族使得 RTSP 可以承载各种不同的媒体编码格式。

RTSP 为什么在摄像头与 AI 行业 25 年未被淘汰?

RTSP 的持久生命力来自其特性与生态优势:

① 标准化、开放、被所有设备支持

从:

-

安防摄像头

-

工业相机

-

机器人

-

智能硬件

-

无人机

-

Edge AI 摄像头

几乎所有“设备侧的生产环境视频源”统一采用 RTSP。

这是行业惯性 + 压倒性生态优势共同决定的。

② 低延迟传输

-

RTP 直接基于 UDP

-

无队头阻塞

-

无额外流控

-

由 SDK 自行决定 JitterBuffer 长度

延迟可以远低于 RTMP/HTTP-FLV。

Android平台RTMP直播播放器延迟测试

③ 媒体灵活性极高

RTSP 可以传输:

-

H.264

-

H.265

-

MJPEG

-

AAC

-

G.711

-

甚至 raw 视频格式

不像 WebRTC 只能传 VP8/VP9/H.264,灵活性远高于浏览器体系。

④ 强控制语义(PTZ、回放、倍速)

RTSP 的控制层能力是 WebRTC/SRT/FLV 无法比拟的:

-

云台控制(PTZ)

-

录像目录/查询

-

回放 Range

-

Scale 倍速

-

设备能力查询(OPTIONS/DESCRIBE)

这些特性使 RTSP 成为设备行业不可替代的标准。

⑤ AI 时代的最佳数据源协议

AI 视觉的核心需求是:

-

稳定

-

可控时序

-

支持 H.265

-

网络可弱化

-

边缘设备统一标准

RTSP 正是整合 AI Edge 体系的最适合协议。

一句话总结:

RTSP = 控制层(RTSP) + 媒体层(RTP/RTCP)

它是过去 25 年摄像头行业的事实标准,也是未来 AI 视觉时代最稳定的底层视频协议。

第六章:RTMP —— Chunk Stream + AMF + 流控机制的工业级推流协议

尽管 RTMP 发布于 2009 年(Adobe RTMP Spec),并被 Flash 时代推向巅峰,但它至今仍是全球推流端的“事实标准”,在大牛直播SDK内部也依然作为推流的重要协议之一。

RTMP 的核心价值来自三个体系:

-

Chunk Stream(分块流机制)

-

AMF Command(基于 AMF0/AMF3 的指令体系)

-

控制流(Control Messages + Window Acknowledgement + Bandwidth)

这些机制共同构成了一个 低延迟、可控、易扩展 的推流协议体系。

6.1 Chunk Stream —— RTMP 的传输基础

RTMP 使用“块化传输”,每个媒体包会被分割成多个 Chunk 发送。

Chunk Stream 的优势包括:

✓ 解决大帧传输时的卡顿问题

(尤其是 H.264/H.265 的大型 IDR 帧)

✓ 实现流控与快速恢复

大块拆小块 → 服务器更易处理 → 延迟更稳定。

Chunk Header 结构包括:

-

时间戳(Timestamp / Extended Timestamp)

-

流 ID(Stream ID)

-

消息类型(Video/AAC/Command)

-

消息长度

-

Chunk Size(可动态调整)

RTMP 通过 Chunk Size 控制带宽利用率,典型值:

-

默认 128 bytes

-

推流优化通常调整到 4096–8192 bytes

6.2 AMF Command —— 强大的控制与会话语义

RTMP 的控制层全靠 AMF(Action Message Format):

-

AMF0(Flash 时代主力)

-

AMF3(Flex/AIR 时代扩展)

关键命令包括:

-

connect(建立连接)

-

createStream

-

publish

-

play

-

pause

-

seek

RTMP 是少数同时具有:

推流控制 + 业务反馈 + 会话语义

的协议,这一点 WebRTC/SRT 都无法替代。

6.3 控制消息流(Control Messages)

RTMP 内置一套控制通道,用于维持流状态:

| 控制消息 | 作用 |

|---|---|

| Type 1 | Set Chunk Size |

| Type 2 | Abort Message |

| Type 3 | Acknowledgement |

| Type 5 | Window Acknowledgement Size |

| Type 6 | Set Peer Bandwidth |

这些机制构成 RTMP“低延迟 + 稳定输出”的工程基础。

6.4 RTMP 的延迟模型:低延迟推流的核心

RTMP 延迟通常:300–800ms

主要由:

-

Chunk Size

-

GOP 结构

-

服务器缓存

-

网络抖动

-

播放端 buffer

共同决定。

在优化后(如大牛直播SDK的低延迟模式),可做到 200–300ms。

6.5 RTMP 的局限性

-

基于 TCP → 队头阻塞

-

不适合大规模分发(CDN 不再推荐)

-

不支持原生 H.265

-

无浏览器端支持

但在推流侧,RTMP 依然无可替代,尤其是:

稳定推流、设备推流、跨平台推流 → RTMP 一直是最成熟选择。

Android平台RTMP直播播放器延迟测试

第七章:FLV —— 直播行业最长期稳定的媒体封装与时间线语义

FLV(Flash Video)尽管诞生于 Flash 时代,但因其“流式媒体特性 + 极简结构 + 容易并发”成为直播/CDN 生态最万能的封装。

HTTP-FLV/WS-FLV 的核心价值都来自 FLV 的结构优势。

7.1 FLV 的结构:Tag-based Media Container

FLV 的核心是 Tag 流式封装结构:

-

FLV Header(9 bytes)

-

FLV Tag(Audio/Video/Script)

-

PreviousTagSize

每个 Tag 自带:

-

Timestamp(时间戳)

-

StreamID

-

Payload(H.264 NALU / AAC Raw)

这意味着:

FLV 可以天然实现“无文件头直播”,从任意位置开始即可播放。

这正是 FLV 比 MP4 更适合直播的根本原因。

7.2 视频 Tag(H.264/H.265)

视频 Tag 内包含:

-

FrameType(关键帧/非关键帧)

-

CodecID(7 = H.264,12 = H.265)

-

AVCDecoderConfigurationRecord(序列头 SPS/PPS)

-

NALU 数据

FLV 强制每次发送关键帧需带上 SPS/PPS,使其非常适合直播快速首帧。

7.3 音频 Tag(AAC/MP3)

AAC Tag 内包含:

-

SoundFormat(10 = AAC)

-

AACPacketType(0 = SequenceHeader,1 = Raw)

-

AudioSpecificConfig(采样率/声道信息)

这使得 player 在播放 AAC 时可以零配置起播。

7.4 时间戳模型(Timestamp / TimestampExtended)

FLV 的时间戳为 毫秒级 ms:

-

0–16777215(24-bit)

-

超过后由 TimestampExtended 扩展

FLV 播放器依赖该时间戳进行:

-

音视频同步

-

缓冲推进

-

低延迟播放

相比 MP4 的严格时间线,FLV 允许更灵活的实时播放策略。

7.5 FLV 为什么是直播行业的长期核心?

✓ 无文件结构依赖,可从任意位置开始播放

HLS/MP4 需要完整 moov,而 FLV 是实时 Tag 流。

✓ 极度稳定

几乎无状态机,极少 Parser 错误。

✓ H.264/AAC 原生封装

兼容性强。

✓ HTTP/WS 轻松承载

CDN 完全支持。

✓ 低延迟

1s 内延迟非常容易做到。

FLV 是直播行业的基础设施。

第八章:GB28181 —— SIP + PS + 平台能力的全栈行业标准

GB28181 是公安部与工信部联合发布的全国公共安全视频监控联网标准,被广泛应用于:

-

城市天网

-

雪亮工程

-

公安/政法

-

工业能源

-

城市治理

-

车载终端

-

AI 视觉平台

它不是一个协议,而是一个 信令 + 媒体 + 控制 + 设备管理 + 平台对接 的完整行业标准体系。

8.1 GB28181 的三大核心技术结构

① SIP(RFC 3261)作为信令层

用于:

-

注册(REGISTER)

-

心跳(KeepAlive)

-

目录订阅(SUBSCRIBE/NOTIFY)

-

点播(INVITE)

-

录像查询(MESSAGE)

-

云台控制(PTZ Command)

GB28181 的 SIP 信令是严格规范化且适合大规模平台管理的。

② PS(MPEG-2 Program Stream)作为媒体层

PS 流具有:

-

结构稳定

-

误码恢复能力强

-

节点可在中间解复用与再封装

媒体层可封装:

-

H.264

-

H.265

-

AAC

-

G.711

PS + RTP → 适合弱网络传输。

③ 平台级业务能力

GB28181 定义了一整套行业语义:

-

目录管理(设备树)

-

实时视频点播

-

语音广播

-

云台控制(PTZ)

-

录像查询与回放

-

AI 报警事件(新版 28181-2016+)

-

设备上下线管理

-

多级级联(平台 ←→ 平台)

这些能力是 SRT/RTSP/WebRTC/FLV 完全没有的。

8.2 GB28181 的工程优势

✓ 海量设备生态(国标摄像头)

百万级设备统一支持。

✓ 强控制能力(业务语义丰富)

平台级操作能力远强于 RTSP。

✓ 适合政企行业平台

与公安网、政务云高度兼容。

✓ 可统一 AI 事件上报

28181-2016/2022 新增大量扩展字段。

8.3 GB28181 的局限性

-

复杂(信令 + 媒体 + 设备树)

-

播放延迟高于 RTSP(因 PS 流结构)

-

穿透能力比 WebRTC 弱

-

实现成本高(尤其是设备端)

但它是行业强需求标准,因此不可替代。

总结:RTMP、FLV、GB28181 在系统中的定位差异

| 协议 | 类型 | 核心价值 | 最典型场景 |

|---|---|---|---|

| RTMP | 推流协议 | 强控制、低延迟、稳定推流 | 直播推流端 |

| FLV/HTTP-FLV/WS-FLV | 直播封装 | CDN 友好、实时性好、结构简单 | 大规模直播分发 |

| GB28181 | 行业标准 | 信令 + 媒体 + 控制 + 设备管理 | 公安/政企监控平台 |

第九章:协议不是竞争,而是“协作生态”——系统级音视频的本质

从工程角度看,RTSP、RTMP、GB28181、HTTP-FLV、WS-FLV、SRT、WebRTC、WebTransport 这 8 类协议并不是彼此取代关系,而是 在系统架构中承担不同的语义与职责。

真正复杂的不是“支持多少协议”,而是理解:

每种协议解决的问题不同,所处的系统层级不同,依赖的媒体语义也不同。

因此在一个完整的实时音视频系统中,它们是协作,而不是竞争。

9.1 协议在系统中的分工:各自负责不同语义

在一个完整的音视频系统中,协议大致对应四类能力,每一类都有自己的“不可替代性”。

① 传输层语义(Transport Semantics)

负责“怎么传”:

-

延迟模型

-

丢包/重传策略

-

抖动、带宽、拥塞控制

-

是否会队头阻塞

-

是否支持不可靠通道

例如:SRT、WebTransport、WebRTC(底层部分)

② 媒体层语义(Media Semantics)

负责“媒体是什么”:

-

封装(FLV、PS、RTP)

-

是否流式

-

是否自带时间戳

-

是否支持 H.265 / AAC

-

是否能从任意 Tag 起播

例如:FLV、RTP Payload、PS

③ 控制层语义(Control & Signaling Semantics)

负责“播放逻辑和设备能力”:

-

播放、暂停、回放

-

目录查询

-

云台(PTZ)

-

设备心跳

-

组播/多路传输

-

业务控制(报警、事件)

例如:RTSP、GB28181、RTMP(AMF 命令)

④ 应用层场景语义(Application Semantics)

负责“在哪些场景使用”:

-

直播分发(HTTP-FLV)

-

Web 播放(WS-FLV)

-

移动端推流(RTMP)

-

AI 边缘摄像头(RTSP/GB28181)

-

双向通话/会议(WebRTC)

-

公安行业设备接入(GB28181)

不同场景有不同需求,不可能被同一个协议覆盖。

9.2 协议并非替代关系,而是系统协作关系

在真正的系统级 SDK(如大牛直播SDK SmartMediaKit)中,不同协议不是“二选一”,而是通过各自角色共同组成一个完整的链路:

-

RTSP:设备侧摄像头与 AI 视觉的主协议

-

RTMP:移动端推流最稳定、最成熟的协议

-

GB28181:政企与行业设备的标准接入入口

-

HTTP-FLV / WS-FLV:自建轻量级直播服务的最佳组合

它们之间不是互斥,而是构成了:

采集 → 传输 → 控制 → 分发 → 播放 → AI 的一条完整音视频链路。

例如:

-

RTSP 摄像头画面 → HTTP-FLV/WS-FLV 服务 → Web 播放

-

Android 端 RTMP 推流 → 云端转码 → 多终端播放

-

设备端 GB28181 接入 → 平台点播 → FLV 分发

-

边缘设备摄像头(RTSP)→ AI → 推送到 FLV 轻量服务

每种协议承担不同职责,系统只有通过“多协议协作”才能真正稳定运行。

9.3 大牛直播SDK的协议生态定位:不是叠加,而是组合链路

大牛直播SDK并不追求“支持所有协议”,而是聚焦于最关键的链路:

-

RTSP(设备端/AI)

-

RTMP(推流端)

-

GB28181(行业设备端)

-

HTTP-FLV / WS-FLV(轻量级服务 + Web 播放)

这套组合恰好覆盖:

-

摄像头

-

终端推流

-

行业接入

-

轻服务分发

-

Web 播放

-

本地录制

-

AI 前处理

形成完整链路:

RTSP / GB28181 / RTMP

→ 内部统一时间基

→ 解码 / AI / 渲染 / 录像

→ HTTP-FLV / WS-FLV 服务

→ Web / App 实时播放

因此,协议不是“谁取代谁”的问题,而是:

在系统中,每种协议承担各自的职责,最终共同构成完整的数据链路。

选择正确的协议组合,而不是幻想“一统天下”的协议。

第十章:8 大协议跨维度对比(系统级矩阵)——聚焦大牛直播SDK当前已覆盖能力

虽然行业协议众多,但大牛直播SDK(SmartMediaKit)目前专注并深度打磨以下能力链路:

-

RTSP 播放器(多平台)

-

RTMP 推流 / 播放(Android/iOS/Windows)

-

GB28181 设备接入(Android)

-

HTTP-FLV 轻量级服务(播放端 + Server)

-

WebSocket-FLV 轻量级服务(低延迟 Web 播放)

因此在系统对比矩阵中,我们重点标注 SDK 已覆盖的协议,并对其系统价值做聚焦分析。

10.1 协议系统矩阵(针对大牛直播SDK当前能力)

| 协议 | 传输模型 | 控制语义 | 媒体格式 | 延迟模型 | 典型应用 | 大牛SDK支持情况 |

|---|---|---|---|---|---|---|

| RTSP | TCP + UDP(RTP/RTCP) | ✔(基于 RTSP 的 SETUP/PLAY) | RTP Payload(H.264/H.265/AAC) | 低 | 摄像头、AI 设备 | 深度支持(Android/iOS/Win) |

| RTMP | TCP | ✔(AMF 命令) | H.264/AAC | 低 | 推流侧、跨平台推流 | 深度支持(推流/播放) |

| GB28181 | TCP+UDP(SIP+RTP/PS) | ✔(强,目录/PTZ/心跳) | PS(H.264/H.265) | 中 | 政企行业、设备接入 | 深度支持(Android 设备端) |

| HTTP-FLV | TCP(HTTP/1.1) | ❌ | FLV(H.264/H.265 + AAC) | 中低 | 直播分发、轻量服务 | 轻量级服务/播放器均支持 |

| WebSocket-FLV | TCP(WebSocket) | ❌ | FLV(直播 Tag 流式) | 中低 | Web 实时播放 | 轻量级服务/播放器均支持 |

| SRT | UDP+ARQ | ❌ | 任意流 | 低 | 公网回传 | (未实现) |

| WebRTC | UDP(DTLS/SRTP/ICE) | ✔ | VP8/VP9/H.264 | 极低 | 人机交互 | (未实现) |

| WebTransport | QUIC | ❌ | 自定义 | 低 | Web 低延迟 | (未实现) |

10.2 大牛直播SDK当前协议生态的“系统定位”

大牛SDK目前构建的是 “端侧推流 + 摄像头拉流 + 行业接入 + 轻量级直播服务” 四大主线:

① RTSP:摄像头 / AI 设备侧的最大价值模块

-

主流 IPC/NVR 全兼容

-

适合 AI 识别与边缘计算

-

低延迟 100–200ms

-

全平台一致性表现优异

安卓轻量级RTSP服务采集摄像头,PC端到安卓拉取RTSP流

② RTMP 推流:移动端推流的核心能力

-

Android/iOS 推流最成熟的方案

-

一致性好、稳定性强

-

CDN 全量兼容

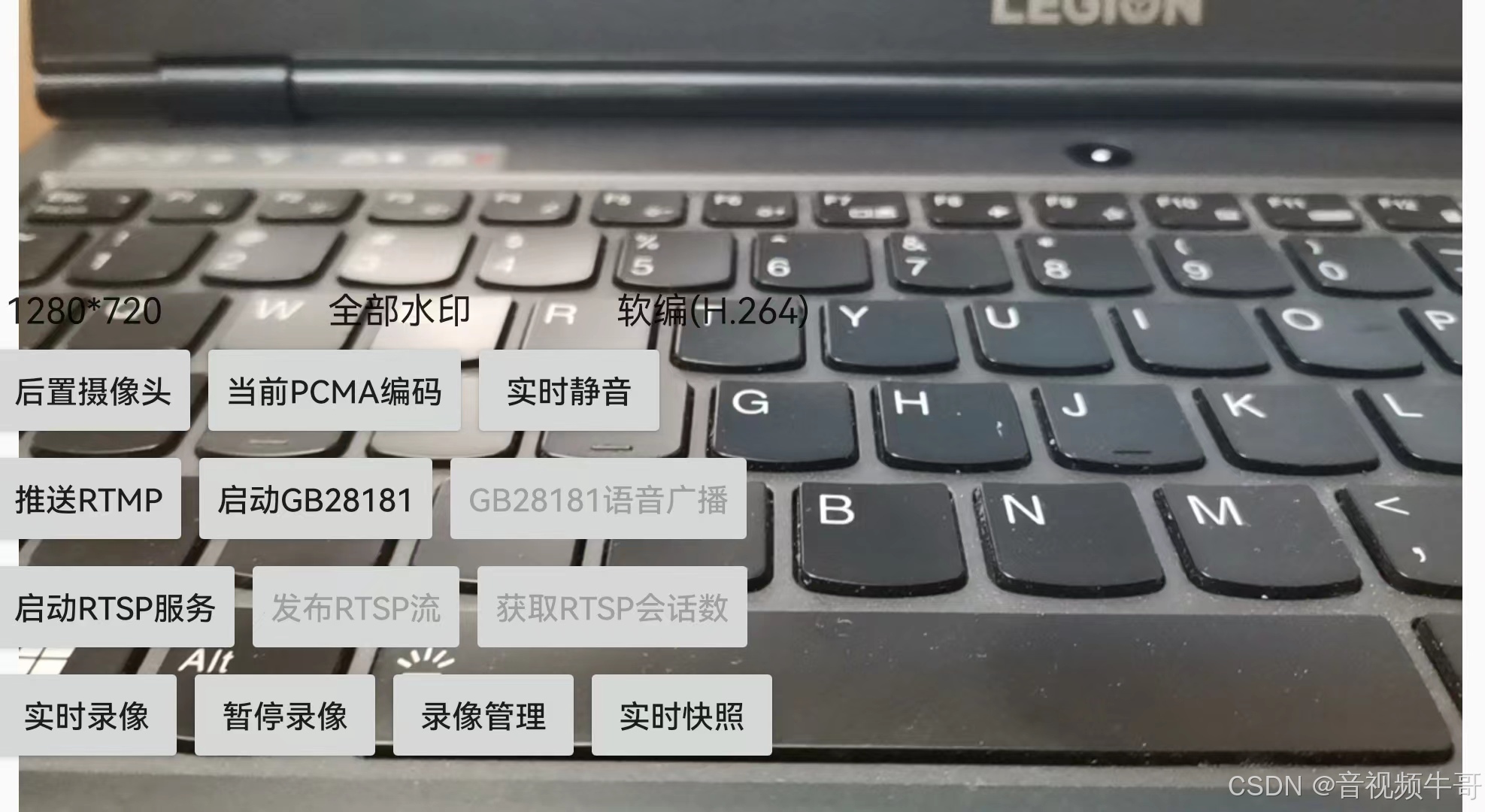

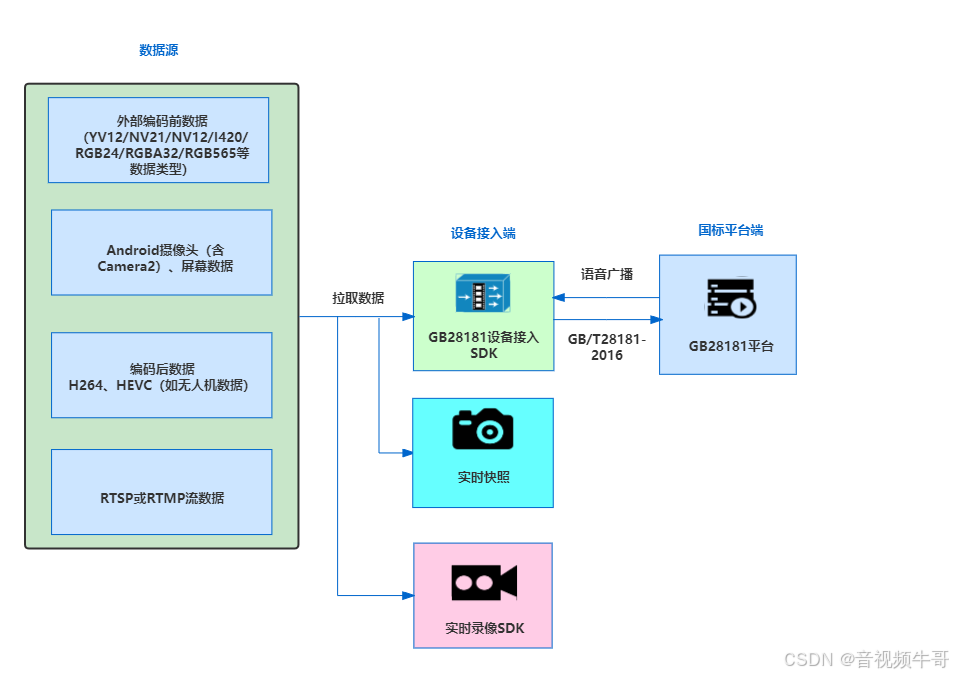

③ GB28181:行业设备接入的关键突破口

-

Android 设备可直接接入政企安防系统

-

实现目录、心跳、注册、点播

-

适合无人机/车载/便携设备

④ HTTP-FLV / WS-FLV 轻量级服务:自建流媒体服务的最快路径

-

无需 Nginx-RTMP、SRS、FFmpeg

-

可在本地/边缘快速构建直播服务

-

支持低延迟 Web 播放

这是大牛直播SDK目前最具差异化的部分:

真正的“轻服务 + 自带播放器 + 不依赖第三方服务器”。

第十一章:大牛直播SDK对协议的系统抽象与工程能力

由于 SDK 目前专注上述协议,因此本章的内容将严格围绕 RTSP / RTMP / GB28181 / HTTP-FLV / WS-FLV 的系统实践展开。

11.1 统一时间基(Timebase)——实现跨协议播放/录制一致性的核心

虽然 SDK 不做 WebRTC/SRT,但在当前能力范围内已经处理了 四套截然不同的时间戳体系:

| 协议 | 时间戳体系 | 大牛SDK处理方式 |

|---|---|---|

| RTSP(RTP) | 90kHz(视频)/48kHz(音频) | RTP → InternalTimeBase |

| RTMP | ms | RTMP TS → InternalTimeBase |

| FLV(HTTP-FLV/WS-FLV) | ms | FLV TS → InternalTimeBase |

| GB28181(PS) | 换算自 PTS/DTS | PES Timestamp → InternalTimeBase |

SDK 内部全部转为统一时间线,保证:

-

跨协议平滑切换

-

录制 MP4/FLV 的时间戳一致

-

AI 模块帧时间线稳定

-

Android/iOS/Windows/Unity 完全一致

11.2 大牛SDK内部的协议传输抽象:

不同协议 → 不同丢包模型 → 不同播放器策略,SDK 内全部抽象为统一结构:

Transport Layer // TCP / UDP(RTP)

↓

Media Parser // RTSP Parser / FLV Parser / PS Parser / RTMP Parser

↓

Timebase // 统一时间线

↓

Frame Queue // 视频/音频同步

↓

Decoder // H.264/H.265/AAC

↓

Renderer / Recorder / AI

该结构的价值是:

✔ 任意协议都能复用解码器

✔ 任意协议都能复用渲染器

✔ 任意协议都能录制成 FLV/MP4

✔ 任意协议都能喂给 AI 引擎

这是类似 OBS/SRS/FFmpeg 所没有的“全部在 SDK 中整合”的优势。

11.3 大牛SDK当前录制能力(MP4/FLV)完全统一

FLV 录制:

-

适用于 RTMP/HTTP-FLV/WS-FLV 推流

-

支持 H.264/H.265 + AAC/PCMA

MP4 录制:

-

适用于 RTSP / GB28181 / RTMP

-

支持严格的 PTS/DTS 构建

-

支持 H.264/H.265 + AAC

跨协议统一录制带来的优势:

✔ RTSP → FLV

✔ RTMP → MP4

✔ GB28181 → MP4

✔ HTTP-FLV → 保存原始码流

全部无缝兼容。

第十二章:结语 —— 面向 2025–2030,SDK的协议演进判断

基于大牛直播SDK当前已经深度打磨的协议栈(RTSP、RTMP、GB28181、HTTP-FLV、WS-FLV),结合未来 5–10 年的行业趋势,可以清晰看到:协议不会统一,而是依然会在不同场景中长期共存。

对 SDK 而言,最重要的不是盲目拥抱新协议,而是在各个场景的最优协议上持续深耕,构建稳定、可控、可落地的系统能力。

趋势 1:RTSP 将在 AI 摄像头领域继续保持绝对主导地位

RTSP 在设备行业拥有无可替代的优势:

-

标准化程度高

-

行业生态巨大(IPC/NVR/机器人/无人机)

-

完整支持 H.265/H.264

-

基于 RTP/RTCP 的时间线天然适合 AI 算法前处理

因此,大牛直播SDK的 RTSP 播放器将长期作为核心模块,并持续在低延迟、弱网适配、AI 对齐能力上提升。

趋势 2:RTMP 依旧是最具稳定性的移动推流方案

尽管行业出现新协议,但 RTMP 在推流侧仍然具有:

-

非常成熟的移动端生态

-

最强的跨平台一致性

-

完全兼容所有主流 CDN

-

简单易调优、稳定可靠

未来 10 年的移动推流中,RTMP 都将是“最佳实践之一”。

大牛直播SDK将继续保持推流端的高稳定性与高兼容性。

趋势 3:GB28181 的设备端需求会快速上升

随着 AI 摄像头与移动终端普及,GB28181 的作用正在从“公安领域”扩展至:

-

城市治理

-

工业巡检

-

低空经济(无人机)

-

车载终端

-

私有云/政企视频平台

-

边缘节点的统一管理

Android 设备端“原生 GB28181 接入”将成为行业刚需。

大牛直播SDK的 GB28181 模块将是未来增长最快的方向之一。

趋势 4:HTTP-FLV / WS-FLV 继续成为轻量级服务的黄金组合

WebRTC 虽强,但对 Web 与服务端的成本极高。

相比之下,HTTP-FLV/WS-FLV 的优势明显:

-

延迟易控(0.8–2s),大牛直播SDK可以做到100-200ms

-

调试简单

-

不依赖 TURN/STUN

-

超轻资源占用

-

非常适合边缘设备本地直接服务 Web 播放

因此:

大牛直播SDK 的轻量级 HTTP-FLV / WS-FLV 服务将成为“本地自建流媒体”的首选方案。

尤其在:

-

机器人

-

无人机

-

AI 边缘节点

-

工控摄像头

-

私有化部署

这些场景中将持续增长。

趋势 5:轻量级自建服务将成为边缘计算时代的主流方式

大牛直播SDK目前自带:

-

HTTP-FLV Server

-

WebSocket-FLV Server

-

RTSP/GB28181 拉流模块

-

本地播放器

-

本地录制(MP4/FLV)

这意味着设备或边缘节点可以直接构建一个“小而完整”的实时流媒体系统,无需:

-

SRS

-

FFmpeg

-

Nginx-RTMP

-

大型媒体服务器

在未来 5–10 年的边缘计算场景(无人机、机器人、AGV、车载终端、私有网络)中,这种“纯 SDK 架构 → 轻服务”的模式将成为主流。

📎 CSDN官方博客:音视频牛哥-CSDN博客

浙公网安备 33010602011771号

浙公网安备 33010602011771号