基于深度学习的面部口罩检测系统演示与介绍(YOLOv12/v11/v8/v5模型+Pyqt5界面+训练代码+数据集)

视频演示

1. 前言

在公共卫生安全与疫情防控常态化背景下,面部口罩佩戴检测作为阻断呼吸道传染病传播的关键技术手段,其准确性与实时性直接影响防控效能。传统口罩检测方法多依赖人工巡查或简单传感器监测,前者存在效率低、覆盖范围有限、易受主观判断影响等问题,后者则难以精准识别面部特征与口罩佩戴状态,尤其在复杂场景(如多人聚集、光照变化、部分遮挡)下易出现漏检或误判。随着深度学习技术的发展,基于目标检测的YOLO系列算法因其高效的实时检测能力与较高的精度,为口罩佩戴检测提供了可行的技术路径。然而,现有基于YOLO的口罩检测系统仍存在应用局限:部分系统操作依赖代码交互,非专业用户难以快速部署;功能模块分散,检测、模型管理、用户权限控制等环节缺乏一体化设计;参数调节(如置信度、交并比)的交互界面不直观,难以适配不同场景需求;此外,模型训练与推理流程分离,用户难以基于自有数据优化模型性能,限制了系统的实用性与扩展性。

针对上述问题,本研究设计并实现了一套基于YOLO算法的面部口罩检测系统,旨在构建集检测、管理、训练于一体的轻量化解决方案。该系统集成YOLO5、YOLO8、YOLO11、YOLO12多版本模型,支持图片、视频、文件夹批量及摄像头实时流等多源输入检测;通过可视化交互界面实现置信度、交并比参数的动态调节,提供检测目标的类别统计、数量分析及详细信息(置信度、坐标位置)追溯功能;同时集成用户登录注册、个人中心管理及脚本化批量检测模块,并内置模型训练功能,支持用户基于自定义数据集(含6019张训练集与582张验证集)微调模型,形成“检测-管理-训练”闭环。系统通过模块化设计与友好的交互逻辑,降低了YOLO算法落地的技术门槛,提升了口罩佩戴检测在实际场景(如公共场所监控、社区管理等)中的适用性与可扩展性。

本文将从系统架构、功能实现、实验验证等方面展开阐述,重点分析多模型切换机制、实时检测优化策略及用户交互设计,为同类视觉检测系统的开发提供参考,助力口罩佩戴检测技术从理论研究向实际应用的转化。

2. 项目演示

2.1 用户登录界面

登录界面布局简洁清晰,左侧展示系统主题,用户需输入用户名、密码及验证码完成身份验证后登录系统。

2.2 新用户注册

注册时可自定义用户名与密码,支持上传个人头像;如未上传,系统将自动使用默认头像完成账号创建。

2.3 主界面布局

主界面采用三栏结构,左侧为功能操作区,中间用于展示检测画面,右侧呈现目标详细信息,布局合理,交互流畅。

2.4 个人信息管理

用户可在此模块中修改密码或更换头像,个人信息支持随时更新与保存。

2.5 多模态检测展示

系统支持图片、视频及摄像头实时画面的目标检测。识别结果将在画面中标注显示,并在下方列表中逐项列出。点击具体目标可查看其类别、置信度及位置坐标等详细信息。

2.6 多模型切换

系统内置多种已训练模型,用户可根据实际需求灵活切换,以适应不同检测场景或对比识别效果。

3.模型训练核心代码

本脚本是YOLO模型批量训练工具,可自动修正数据集路径为绝对路径,从pretrained文件夹加载预训练模型,按设定参数(100轮/640尺寸/批次8)一键批量训练YOLOv5nu/v8n/v11n/v12n模型。

4. 技术栈

-

语言:Python 3.10

-

前端界面:PyQt5

-

数据库:SQLite(存储用户信息)

-

模型:YOLOv5、YOLOv8、YOLOv11、YOLOv12

5. YOLO模型对比与识别效果解析

5.1 YOLOv5/YOLOv8/YOLOv11/YOLOv12模型对比

基于Ultralytics官方COCO数据集训练结果:

|

模型 |

尺寸(像素) |

mAPval 50-95 |

速度(CPU ONNX/毫秒) |

参数(M) |

FLOPs(B) |

|---|---|---|---|---|---|

|

YOLO12n |

640 |

40.6 |

- |

2.6 |

6.5 |

|

YOLO11n |

640 |

39.5 |

56.1 ± 0.8 |

2.6 |

6.5 |

|

YOLOv8n |

640 |

37.3 |

80.4 |

3.2 |

8.7 |

|

YOLOv5nu |

640 |

34.3 |

73.6 |

2.6 |

7.7 |

关键结论:

-

精度最高:YOLO12n(mAP 40.6%),显著领先其他模型(较YOLOv5nu高约6.3个百分点);

-

速度最优:YOLO11n(CPU推理56.1ms),比YOLOv8n快42%,适合实时轻量部署;

-

效率均衡:YOLO12n/YOLO11n/YOLOv8n/YOLOv5nu参数量均为2.6M,FLOPs较低(YOLO12n/11n仅6.5B);YOLOv8n参数量(3.2M)与计算量(8.7B)最高,但精度优势不明显。

综合推荐:

-

追求高精度:优先选YOLO12n(精度与效率兼顾);

-

需高速低耗:选YOLO11n(速度最快且精度接近YOLO12n);

-

YOLOv5nu/YOLOv8n因性能劣势,无特殊需求时不建议首选。

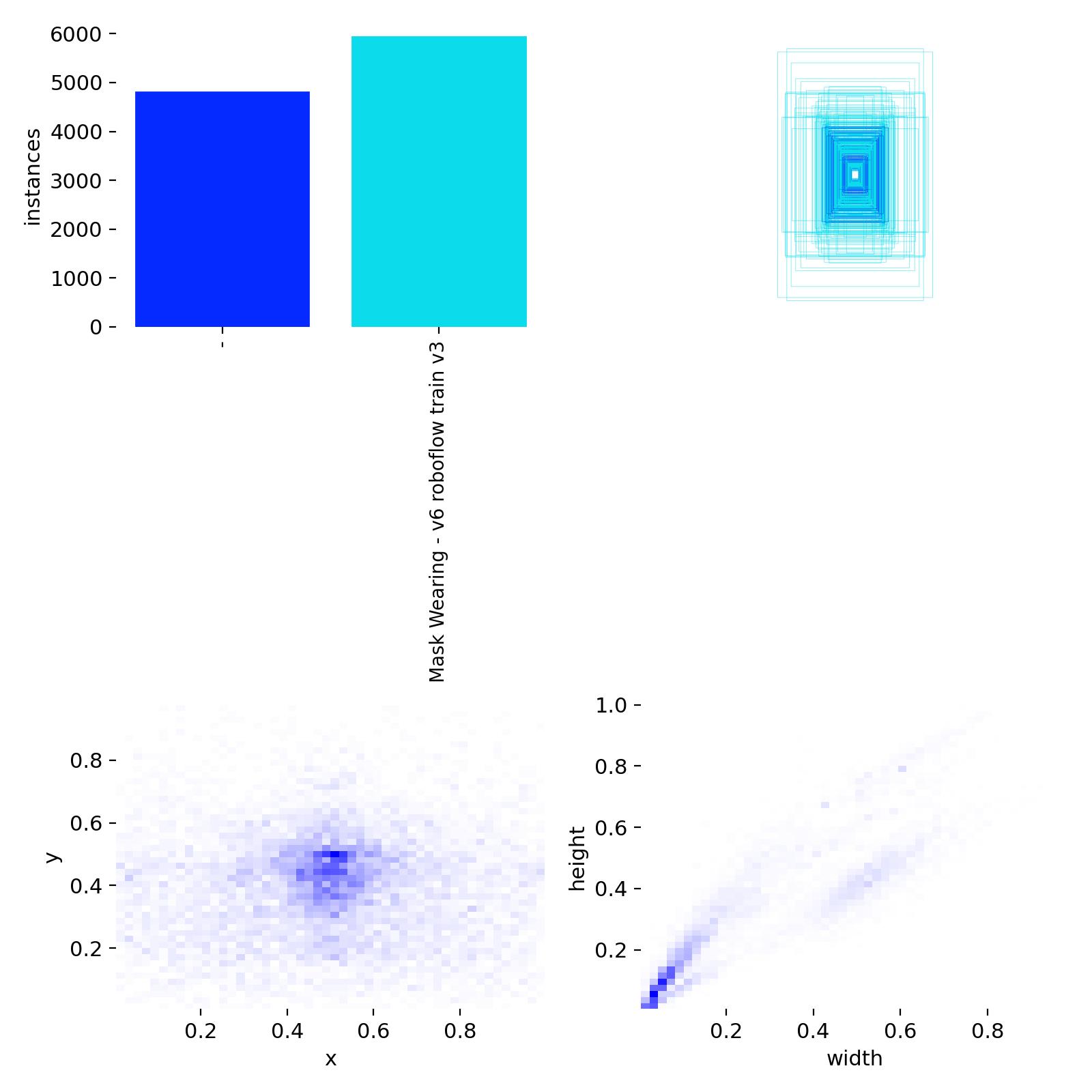

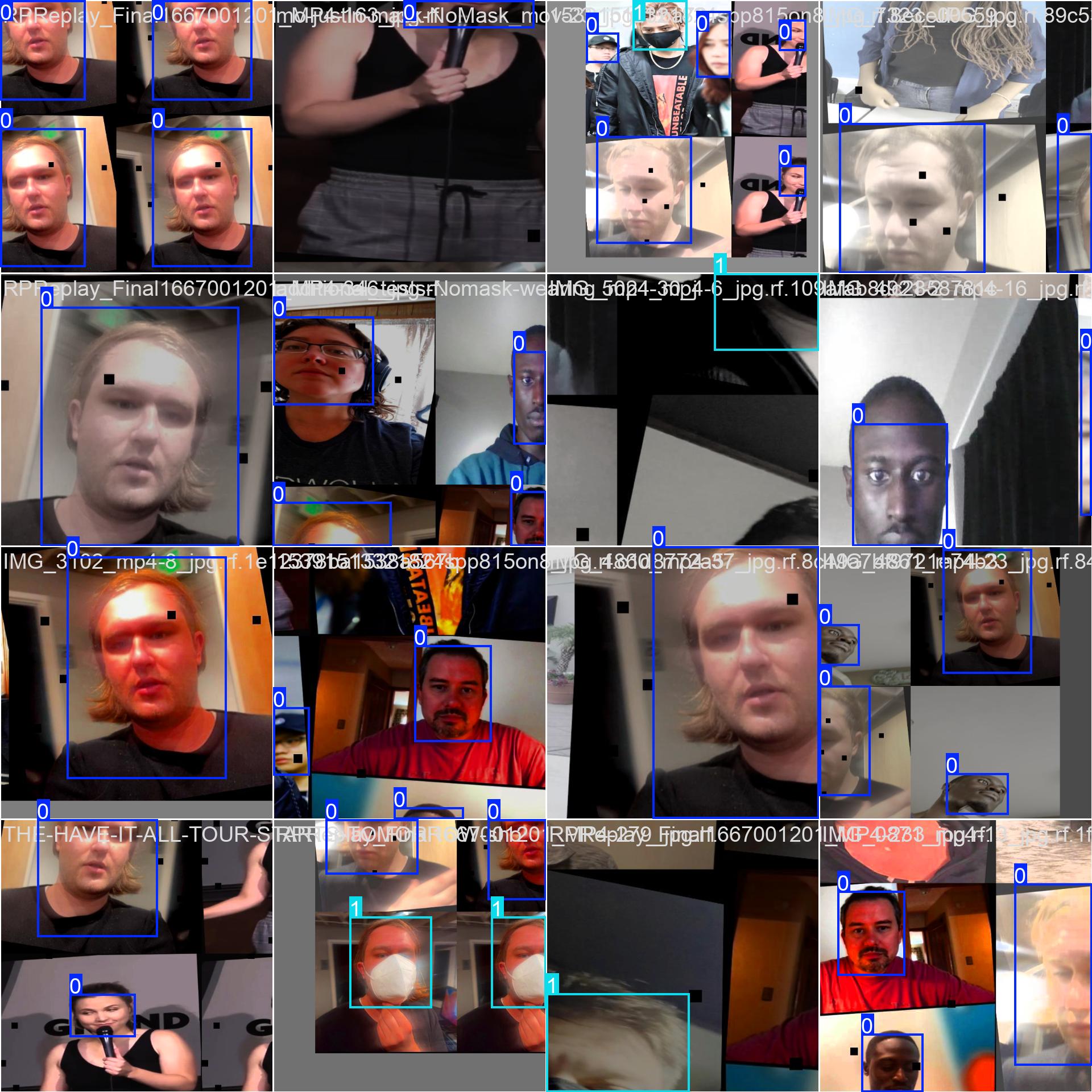

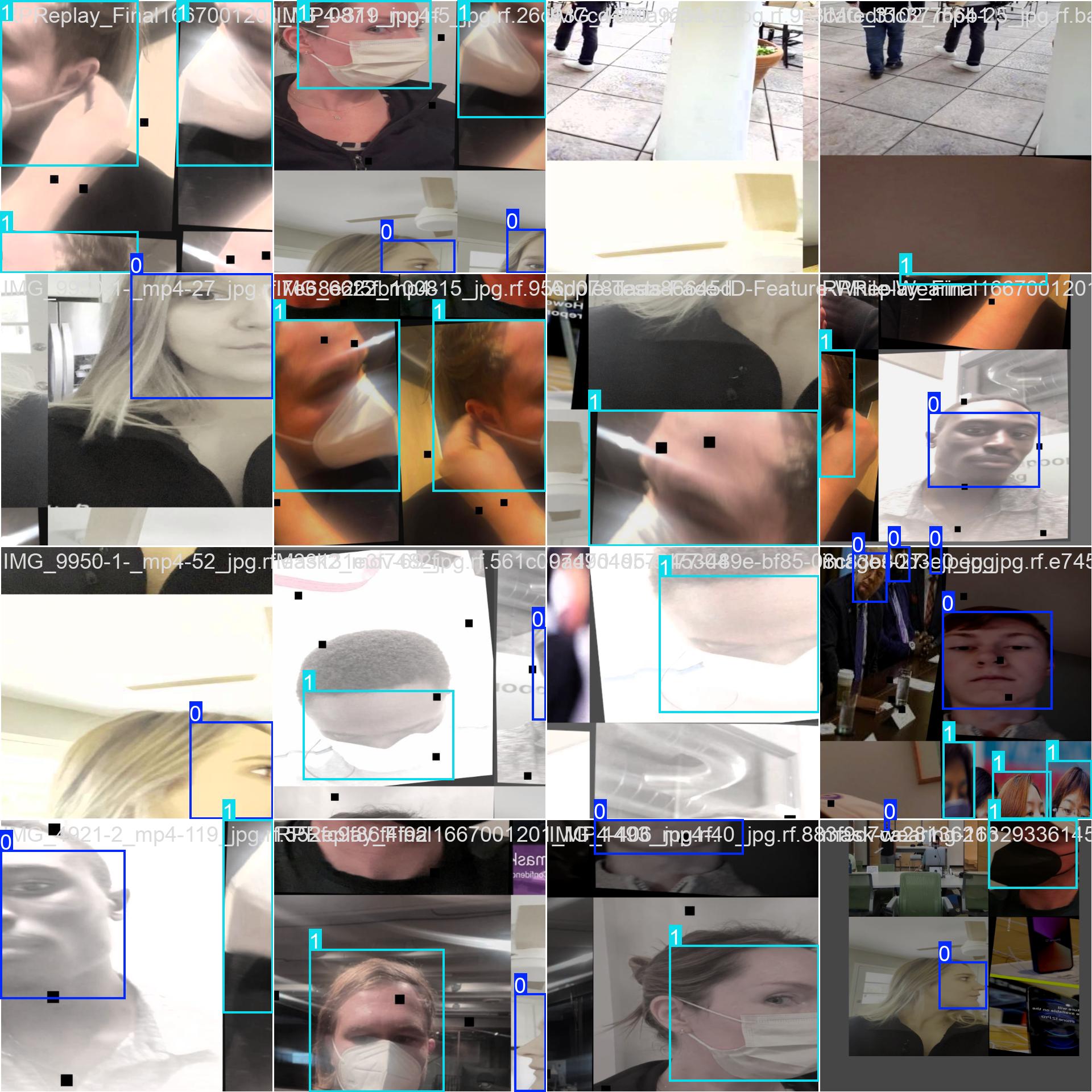

5.2 数据集分析

数据集中训练集和验证集一共大概6500多张,数据集目标类别两类:戴口罩,没带口罩。数据集配置代码如下:

上面的图片就是部分样本集训练中经过数据增强后的效果标注。

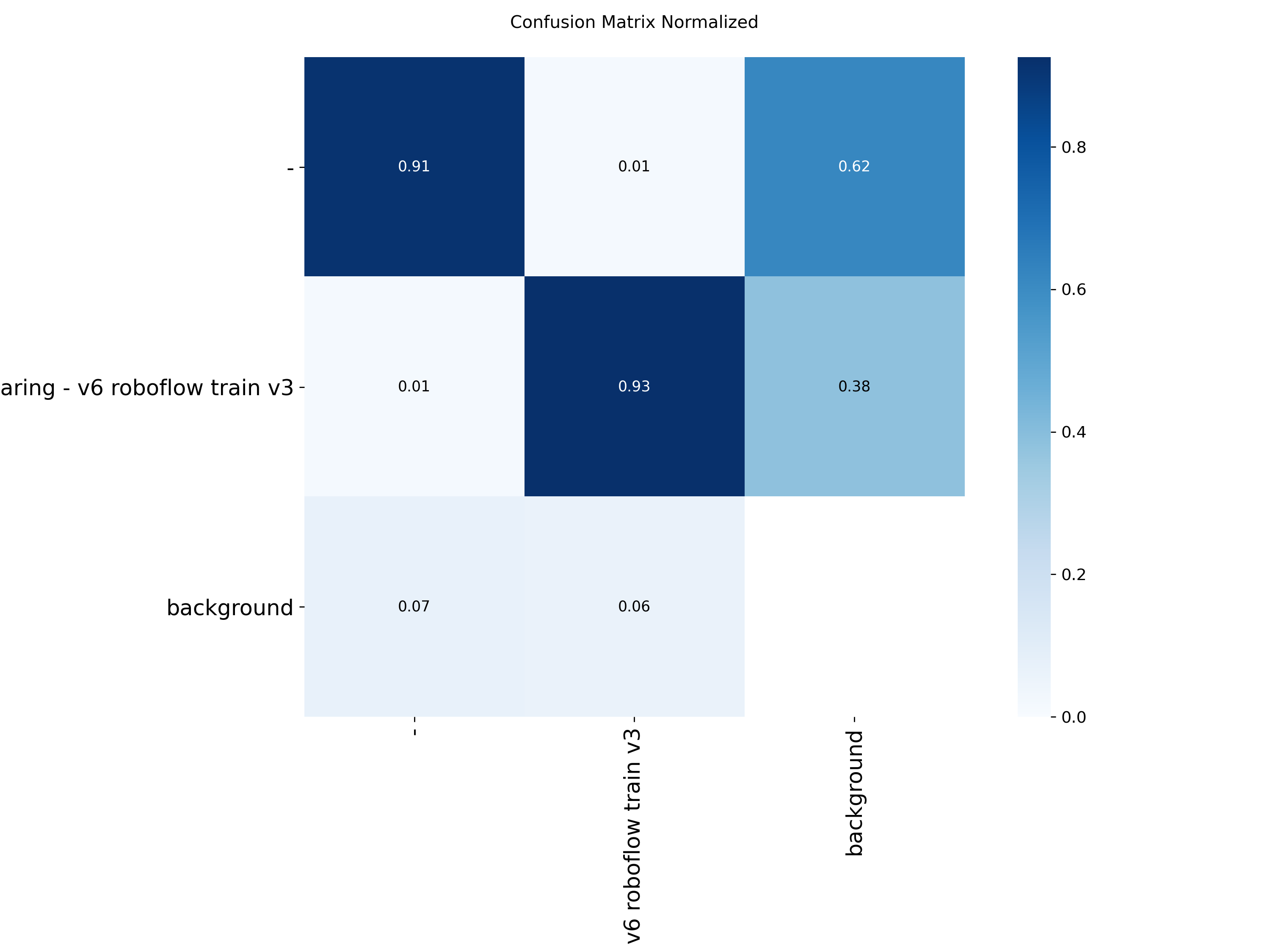

5.3 训练结果

混淆矩阵显示中识别精准度是 -(没戴口罩):91%,Mask Wearing - v6 roboflow train v3(戴口罩):93%,识别精准度非常高。

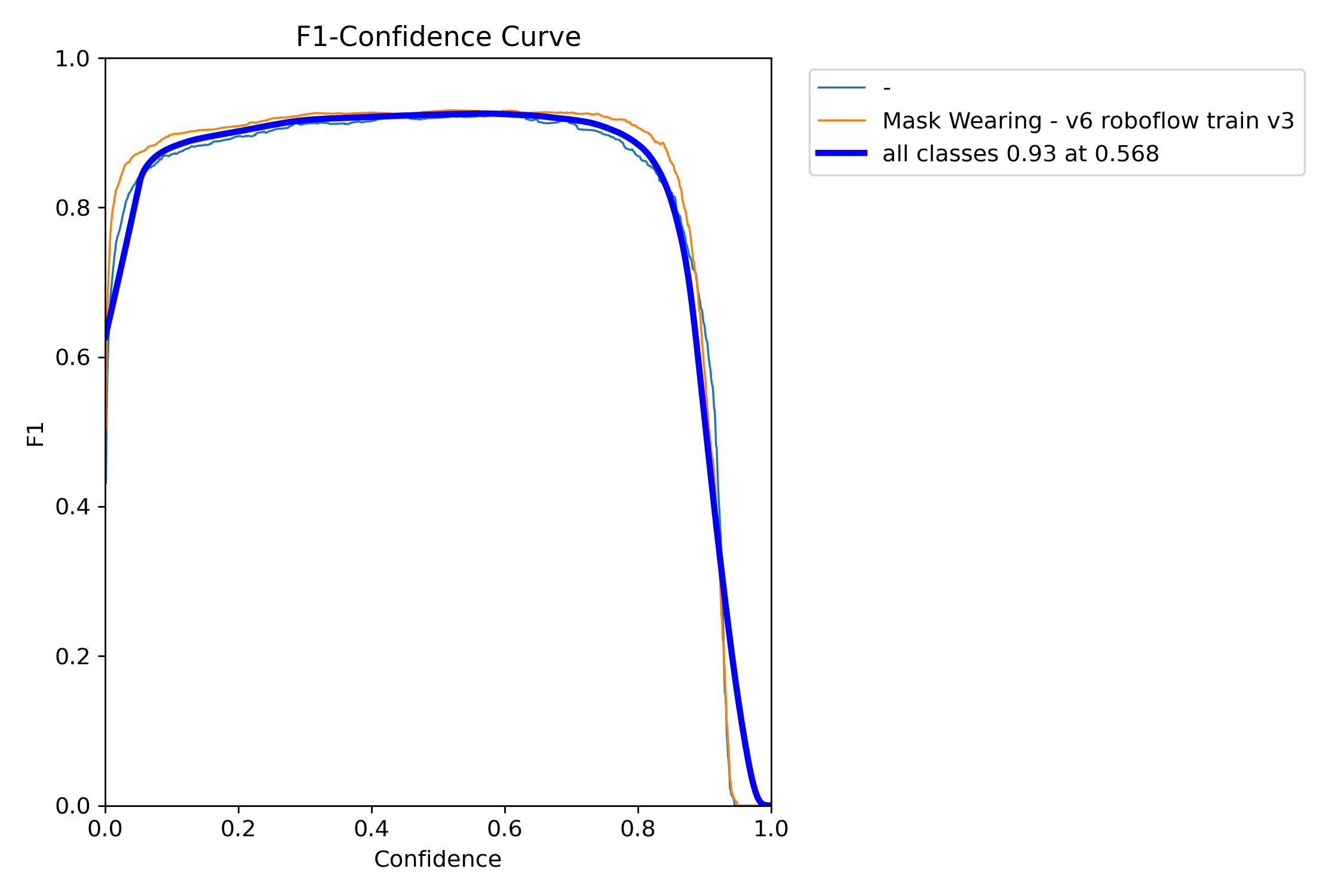

F1指数(F1 Score)是统计学和机器学习中用于评估分类模型性能的核心指标,综合了模型的精确率(Precision)和召回率(Recall),通过调和平均数平衡两者的表现。

当置信度为0.568时,所有类别的综合F1值达到了0.93(蓝色曲线)。

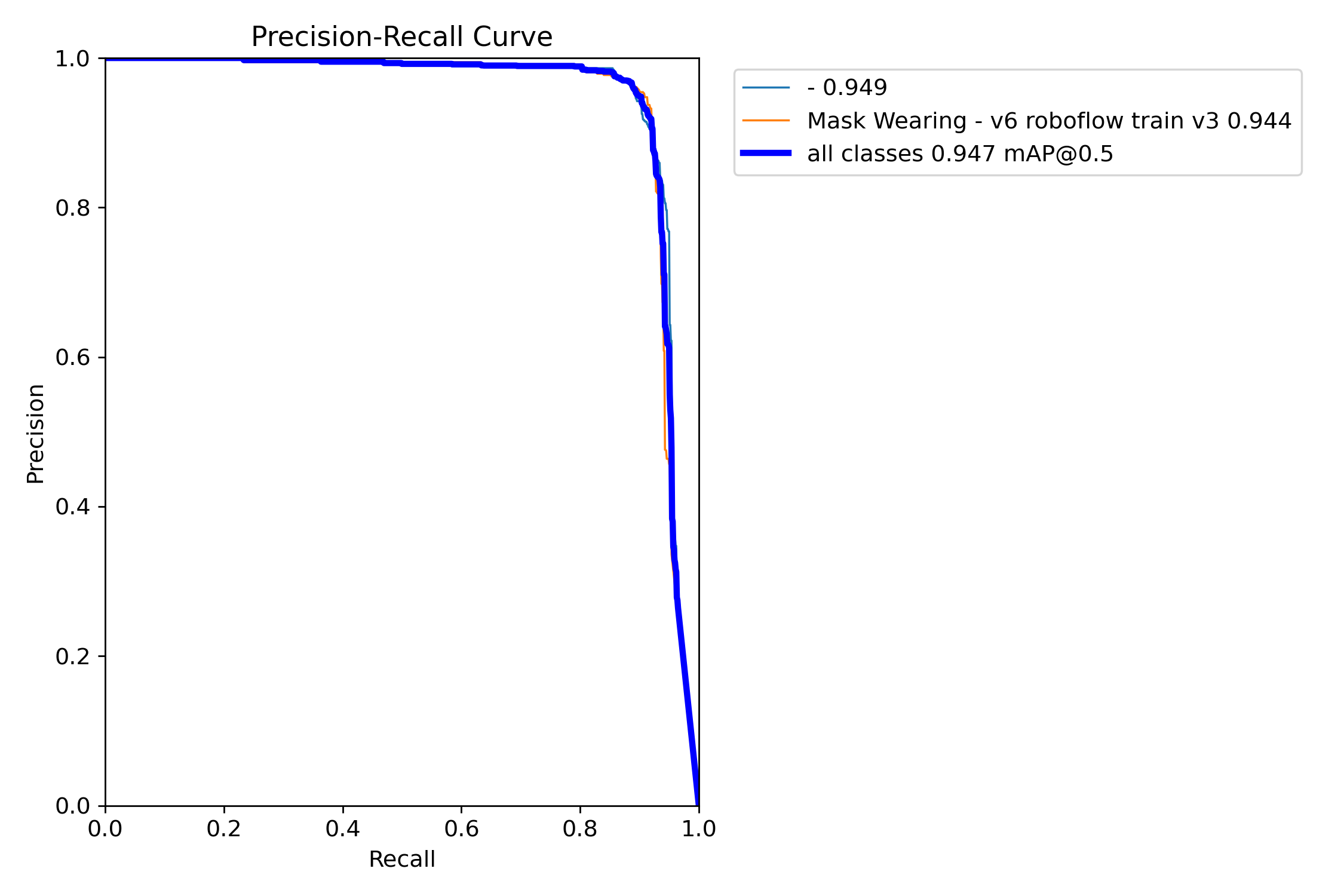

mAP@0.5:是目标检测任务中常用的评估指标,表示在交并比(IoU)阈值为0.5时计算的平均精度均值(mAP)。其核心含义是:只有当预测框与真实框的重叠面积(IoU)≥50%时,才认为检测结果正确。

图中可以看到综合mAP@0.5达到了0.947(94.7%),准确率非常高。

6. 源码获取方式

源码获取方式:https://www.bilibili.com/video/BV1owCpBaEvs

本文介绍了一套基于YOLO算法的面部口罩检测系统,该系统针对传统检测方法效率低、精度不足等问题,整合了YOLOv5/v8/v11/v12多版本模型,支持图片、视频及实时摄像头检测。系统采用模块化设计,包含用户管理、参数调节、模型训练等功能,通过可视化界面降低使用门槛。实验数据显示,YOLO12n模型mAP达40.6%,识别准确率超90%,在6500+张训练集上取得良好效果。该系统实现了"检测-管理-训练"闭环,为疫情防控提供了高效的技术支持。

本文介绍了一套基于YOLO算法的面部口罩检测系统,该系统针对传统检测方法效率低、精度不足等问题,整合了YOLOv5/v8/v11/v12多版本模型,支持图片、视频及实时摄像头检测。系统采用模块化设计,包含用户管理、参数调节、模型训练等功能,通过可视化界面降低使用门槛。实验数据显示,YOLO12n模型mAP达40.6%,识别准确率超90%,在6500+张训练集上取得良好效果。该系统实现了"检测-管理-训练"闭环,为疫情防控提供了高效的技术支持。

浙公网安备 33010602011771号

浙公网安备 33010602011771号