import tensorflow as tf

#设置参数w的随机初始值为5,设定为可训练(即vaiable形式?)

w = tf.Variable(tf.constant(5, dtype=tf.float32))

#学习率

lr=0.2

#循环次数

epoch=40

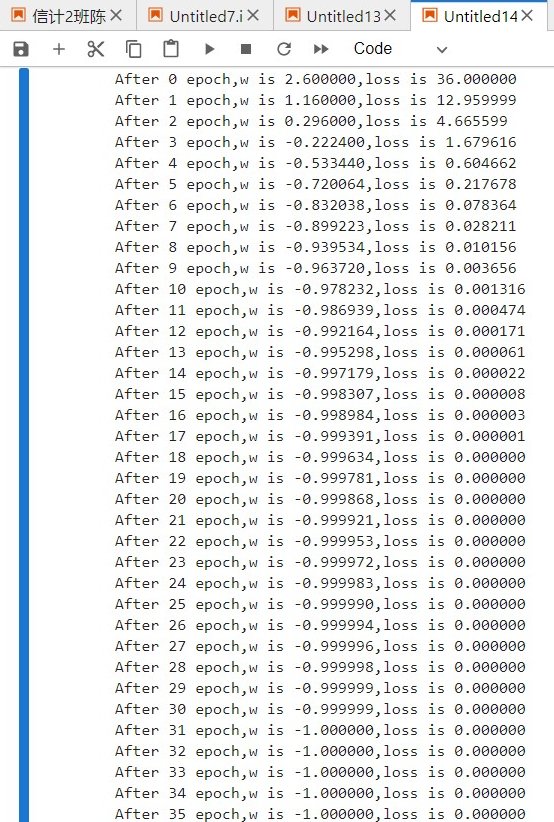

for epoch in range(epoch):

with tf.GradientTape() as tape:#with结构到grad框起到了梯度计算的过程

loss=tf.square(w+1) #损失函数定义为w+1的平方

grads=tape.gradient(loss,w)#gradinet函数告知对谁求导

w.assign_sub(lr*grads) #assign_sub做自减,即w-=

print("After %s epoch,w is %f,loss is %f" % (epoch, w.numpy(), loss))

![]()

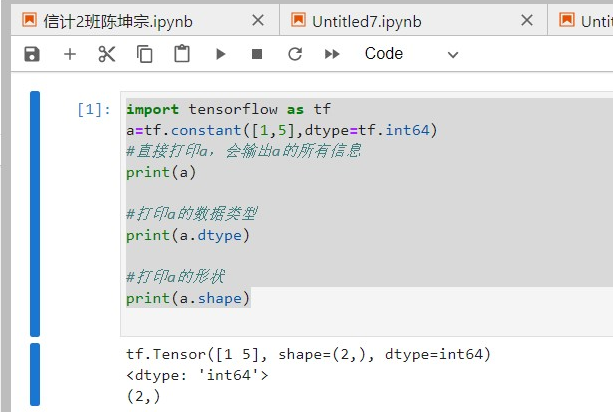

import tensorflow as tf

a=tf.constant([1,5],dtype=tf.int64)

#直接打印a,会输出a的所有信息

print(a)

#打印a的数据类型

print(a.dtype)

#打印a的形状

print(a.shape)

![]()

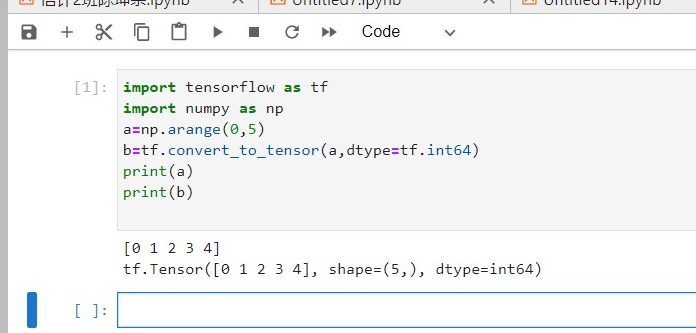

import tensorflow as tf

import numpy as np

a=np.arange(0,5)

b=tf.convert_to_tensor(a,dtype=tf.int64)

print(a)

print(b)

![]()

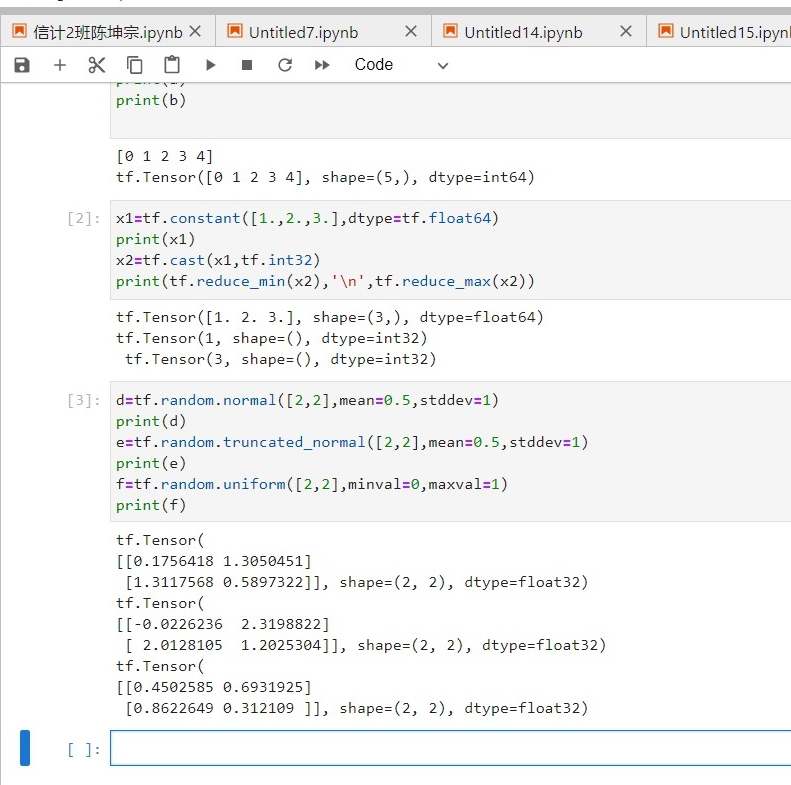

d=tf.random.normal([2,2],mean=0.5,stddev=1)

print(d)

e=tf.random.truncated_normal([2,2],mean=0.5,stddev=1)

print(e)

f=tf.random.uniform([2,2],minval=0,maxval=1)

print(f)

x1=tf.constant([1.,2.,3.],dtype=tf.float64)

print(x1)

x2=tf.cast(x1,tf.int32)

print(tf.reduce_min(x2),'\n',tf.reduce_max(x2))

![]()

浙公网安备 33010602011771号

浙公网安备 33010602011771号