【知识】正则化 Regularization

范数

L0范数,向量中非零元素的个数:

L1范数,为绝对值之和:

L2范数,就是通常意义上的模:

无穷范数,就是取向量的最大值:

以上都是常用的向量范数,除此之外还有矩阵范数,目前没怎么接触过就不记录了。

总的来说,范数的本质是距离,存在的意义是为了实现比较。比如,在一维实数集合中,我们随便取两个点4和9,我们知道9比4大,但是到了二维实数空间中,取两个点(1,1)和(0,3),这个时候我们就没办法比较它们之间的大小,因为它们不是可以比较的实数,于是我们引入范数这个概念,把我们的(1,1)和(0,3)通过范数分别映射到实数\(\sqrt{2}\) 和 3 ,这样我们就比较这两个点了。所以你可以看到,范数它其实是一个函数,它把不能比较的向量转换成可以比较的实数。

Regularization 规则化,正则化是什么

个人认为正则化这个翻译不是很好,高大上而不接地气,让人难以理解,本来Regularization并不是一个高深的概念。如果翻译成规则化,则更容易让人理解一些。

首先,从使用正则化的目的角度:正则化是为了防止过拟合。

特征变量过多会导致过拟合,为了防止过拟合会选择一些比较重要的特征变量,而删掉很多次要的特征变量。但是,如果我们实际上却希望利用到这些特征信息,所以可以添加正则化项来约束这些特征变量,使得这些特征变量的权重很小,接近于0,这样既能保留这些特征变量,又不至于使得这些特征变量的影响过大。

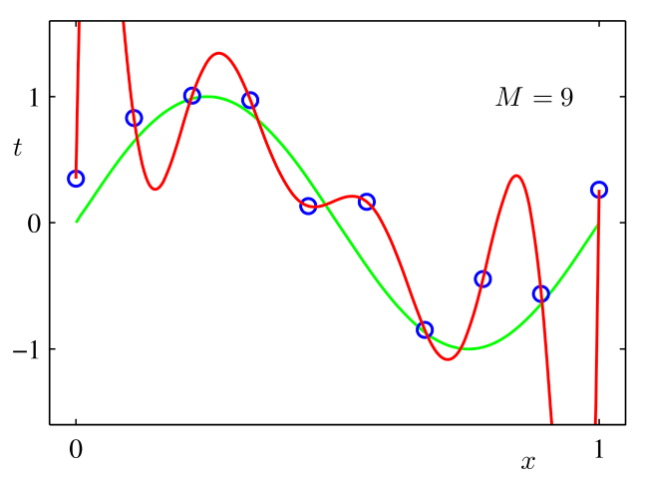

如上图,红色这条“想象力”过于丰富上下横跳的曲线就是过拟合情形。结合上图和正则化的英文 Regularizaiton-Regular-Regularize,直译应该是:规则化(加个“化”字变动词,自豪一下中文还是强)。什么是规则?你妈喊你6点前回家吃饭,这就是规则,一个限制。同理,在这里,规则化就是说给需要训练的目标函数加上一些规则(限制),让他们不要自我膨胀。

常见的正则化

L0正则化

稀疏的参数可以防止过拟合,因此用L0范数(非零参数的个数)来做正则化项是可以防止过拟合的。

从直观上看,利用非零参数的个数,可以很好的来选择特征,实现特征稀疏的效果,具体操作时选择参数非零的特征即可。但因为L0正则化很难求解,是个NP难问题,因此一般采用L1正则化。L1正则化是L0正则化的最优凸近似,比L0容易求解,并且也可以实现稀疏的效果。

正则化和稀疏

你可能会问,为什么可以实现稀疏的效果?

任何的规则化算子,如果他在Wi=0的地方不可微,并且可以分解为一个“求和”的形式,那么这个规则化算子就可以实现稀疏。

对于L1和L2规则化的代价函数,我们可以写成以下形式:

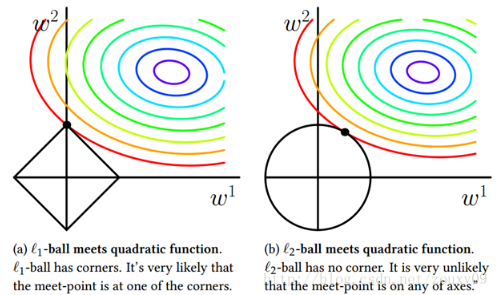

也就是说,我们将模型空间限制在w的一个L1-ball 中。为了便于可视化,我们考虑两维的情况,在(w1, w2)平面上可以画出目标函数的等高线,而约束条件则成为平面上半径为C的一个 norm ball 。等高线与 norm ball 首次相交的地方就是最优解。

可以看到,L1-ball 与L2-ball 的不同就在于L1在和每个坐标轴相交的地方都有“角”出现,而目标函数的测地线除非位置摆得非常好,大部分时候都会在角的地方相交。注意到在角的位置就会产生稀疏性,例如图中的相交点就有w1=0,而更高维的时候(想象一下三维的L1-ball 是什么样的?)除了角点以外,还有很多边的轮廓也是既有很大的概率成为第一次相交的地方,又会产生稀疏性。

相比之下,L2-ball 就没有这样的性质,因为没有角,所以第一次相交的地方出现在具有稀疏性的位置的概率就变得非常小了。这就从直观上来解释了为什么L1-regularization 能产生稀疏性,而L2-regularization 不行的原因了。

所以L1范数和L0范数可以令参数稀疏。而L2范数则是将一些不重要的参数的值尽量的小。

L1正则化

L1正则化在实际中往往替代L0正则化,来防止过拟合。在江湖中也人称Lasso。

L1范数是指向量中各个元素绝对值之和,也有个美称叫“稀疏规则算子”(Lasso regularization)。

L1正则化的目标函数如下:

对应的梯度:

其中sign(w)就是取w各个元素的符号。

对于数学方法证明L1正则化为什么会产生稀疏参数,可以参考L1范数是什么?它为什么可以实现稀疏?

L2正则化

L2范数在回归里面,它的回归叫“岭回归”(Ridge Regression),也叫它“权值衰减weight decay”。

模型对应的目标函数:

对应的梯度:

那么更新梯度时:

可以看出L2正则化倾向于在更新参数时先将原参数缩小后再进行更新。

参考文献

https://blog.csdn.net/yangpan011/article/details/79461846

https://blog.csdn.net/pipisorry/article/details/52108040

https://blog.csdn.net/mona_yang/article/details/80937802

浙公网安备 33010602011771号

浙公网安备 33010602011771号