FedSGD 与FedAvg小记

减少通信次数:多做计算,少做通信

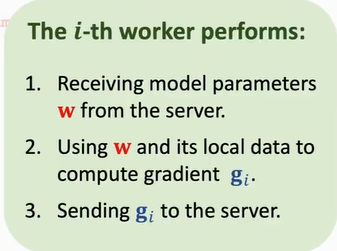

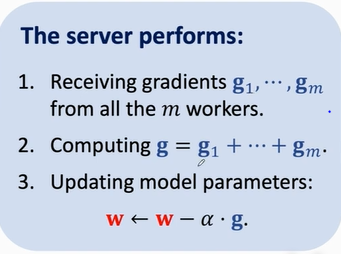

FedSGD:

worker节点:

server节点:

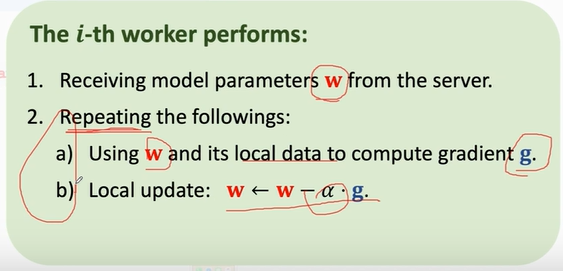

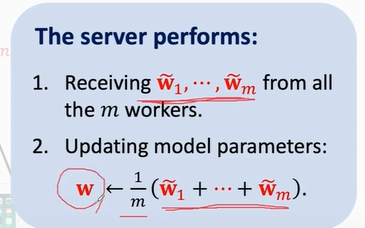

FedAvg方法:

worker节点:

在节点本地进行多次梯度下降更新参数

server节点:

该方法通过增加了节点本地结算量,减少了通信量。

FedSGD:每次采用client的所有数据集进行训练,本地训练次数为1,然后进行aggregation。

C:the fraction of clients that perform computation on each round

每次参与联邦聚合的clients数量占client总数的比例。C=1 代表所有成员参与聚合

B:the local minibatch size used for the client updates.

client的本地的训练的batchsize,B=无穷大代表batchsize是整个本地数据集

E:then number of training passes each client makes over its local dataset on each round

两次联邦训练之间的本地训练的次数

---》C=E=1 ,B=∞时,FedAvg等价于FedSGD

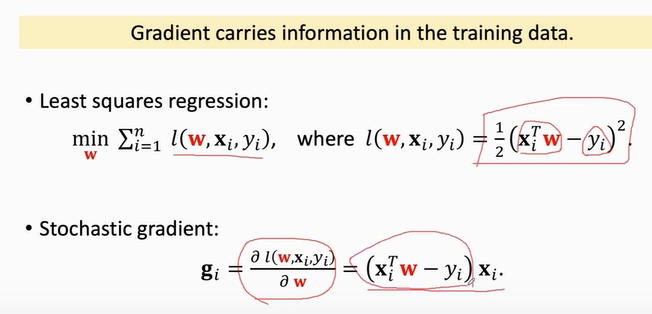

梯度泄露隐私:

梯度实际上是通过函数把用户数据做了函数变换

浙公网安备 33010602011771号

浙公网安备 33010602011771号