微服务架构的基石:Eureka、Nacos、Consul三大注册中心深度对比与选型指南

在微服务架构的演进中,服务注册与发现扮演着至关重要的角色,它如同分布式系统的“神经中枢”,确保服务间能够高效、稳定地通信。随着云原生和容器化部署的普及,选择合适的注册中心成为构建弹性、可扩展系统的关键决策。本文将深入剖析Eureka、Nacos、Consul这三大主流方案的核心架构、一致性模型、性能表现以及与Spring Cloud和Kubernetes的整合实践,旨在为你提供一份清晰的技术选型地图。

1. 服务注册发现:微服务动态治理的核心

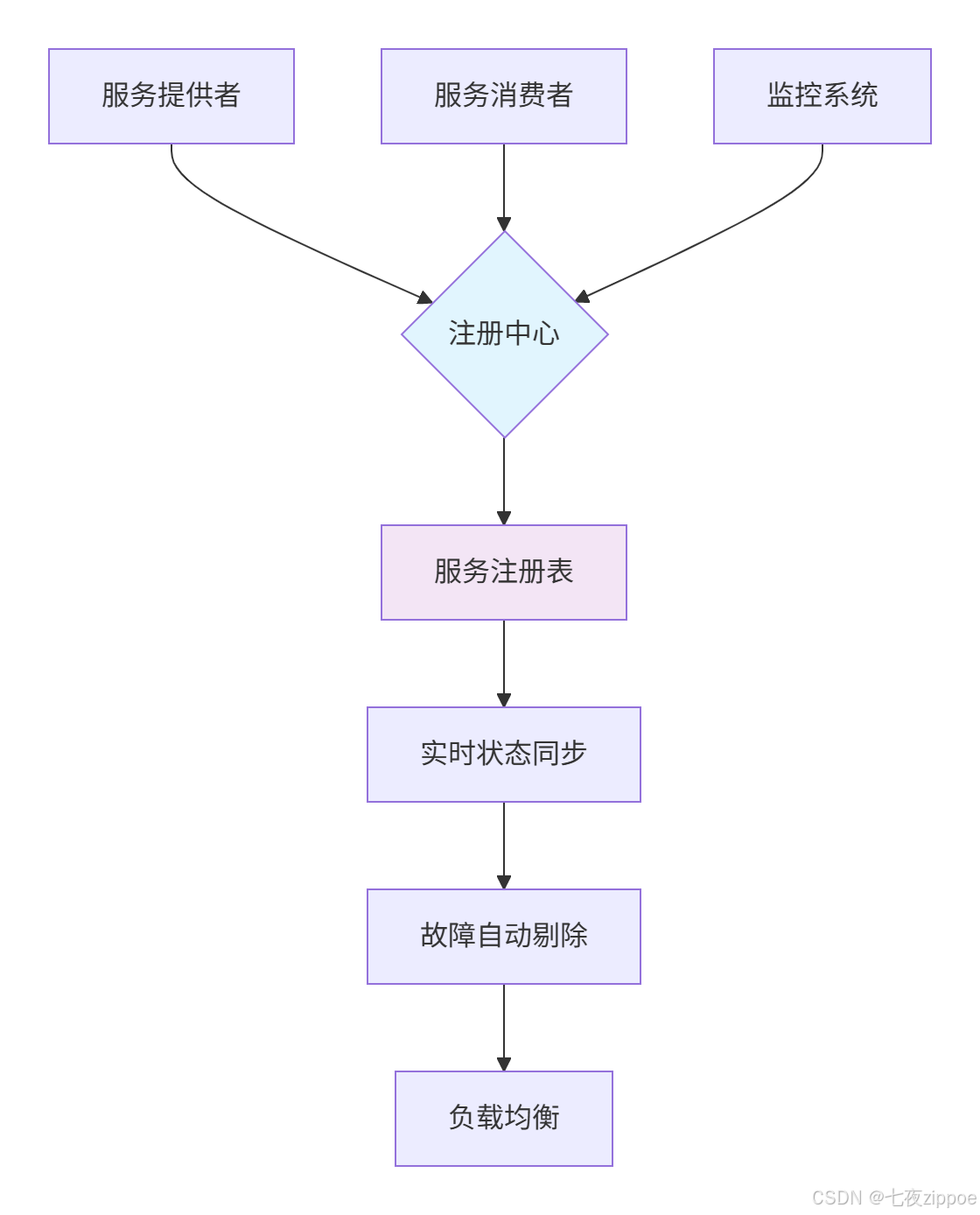

想象一下,在一个由数十甚至上百个微服务组成的系统中,服务实例会因弹性伸缩、故障转移或容器编排(如Kubernetes)而动态变化。传统的硬编码服务地址方式将彻底失效,这正是服务注册中心要解决的首要痛点。它通过三大核心机制构建起服务间的通信桥梁:服务注册、服务发现和健康检查。一个设计良好的注册中心,不仅能提升系统可用性,更是实现高效容器编排和自动化运维的基础。

作为有多年Java经验的开发者,我见证了微服务架构的演进历程。服务注册发现作为微服务的"通讯录系统",其选型直接决定整个架构的稳定性。今天我将深入解析三大主流方案的技术原理、实战应用和选型策略。

在没有注册中心的情况下,服务调用代码可能如下所示,这种静态配置方式在动态环境中是灾难性的:

// 硬编码的灾难示例

@Service

public class OrderService {

// 问题1:地址变更需要重新部署

@Value("${user.service.url:http://localhost:8080}")

private String userServiceUrl;

// 问题2:负载均衡需要手动实现

private List userServiceUrls = Arrays.asList(

"http://192.168.1.101:8080",

"http://192.168.1.102:8080",

"http://192.168.1.103:8080"

);

// 问题3:服务状态无法感知

public void createOrder() {

// 随机选择一台,无法感知服务是否健康

String targetUrl = getRandomServer(userServiceUrls);

// 如果目标服务器宕机,请求失败

restTemplate.postForObject(targetUrl + "/users/validate", ...);

}

} 注册中心的核心价值在于将服务提供者的网络位置动态地注册到一个中心目录,消费者则从该目录中查询并获取可用的服务实例列表。其核心工作流程如下图所示:

为了更直观地理解其核心功能,我们可以通过下表进行对比:

功能 | 无注册中心 | 有注册中心 | 价值提升 |

|---|---|---|---|

服务发现 | 手动配置/硬编码 | 自动发现 | 减少90%配置工作 |

负载均衡 | 客户端手动实现 | 内置自动负载 | 提高性能与可靠性 |

健康检查 | 无感知/手动检查 | 自动健康检查 | 故障快速发现 |

动态扩展 | 手动调整配置 | 自动注册发现 | 扩容缩容无缝 |

2. 架构深度解析:三大主流的实现哲学

Eureka、Nacos和Consul虽然目标一致,但其底层架构设计哲学却各有侧重,这直接影响了它们的特性与适用场景。理解其架构是做出正确技术选型的第一步。

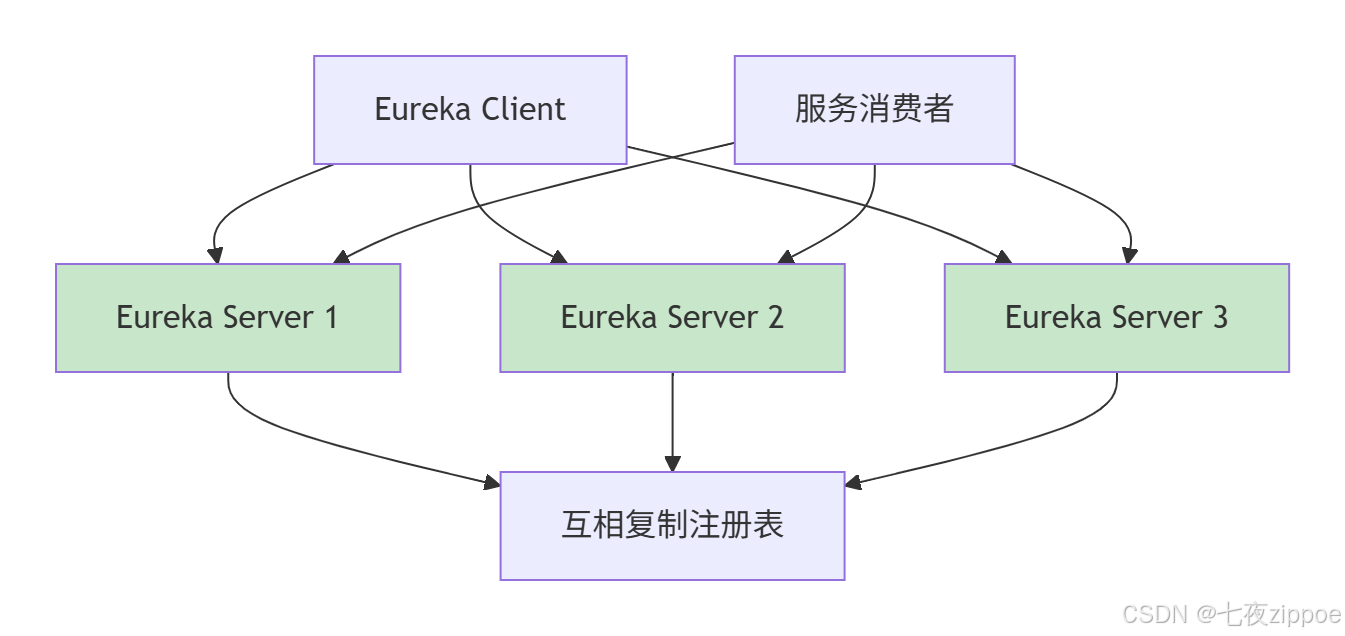

2.1 Eureka:为高可用性而生的AP架构典范

Eureka源自Netflix,是Spring Cloud生态早期的“标配”。它采用了经典的去中心化对等架构,每个Eureka Server都是平等的节点,通过相互复制注册表来保证数据冗余。其设计核心是优先保证可用性(AP),在网络分区发生时,它宁愿接受短暂的数据不一致,也要确保服务注册与发现功能基本可用。

其集群架构如下图所示,节点间通过异步通信同步数据:

Eureka通过几个关键机制实现其AP特性:最终一致性数据同步、客户端缓存服务列表,以及著名的“自我保护模式”(在网络异常时保护已注册的服务不被剔除)。其核心配置通常如下:

// Eureka客户端配置示例

@Configuration

public class EurekaClientConfig {

@Bean

public EurekaInstanceConfigBean eurekaInstanceConfig() {

EurekaInstanceConfigBean config = new EurekaInstanceConfigBean();

// 实例配置

config.setAppname("order-service");

config.setInstanceId("order-service-001");

config.setLeaseRenewalIntervalInSeconds(30); // 心跳间隔

config.setLeaseExpirationDurationInSeconds(90); // 过期时间

// 元数据

Map metadata = new HashMap<>();

metadata.put("version", "1.0.0");

metadata.put("region", "beijing");

config.setMetadataMap(metadata);

return config;

}

// 自我保护机制配置

@Bean

public EurekaServerConfigBean eurekaServerConfig() {

EurekaServerConfigBean config = new EurekaServerConfigBean();

config.setEnableSelfPreservation(true); // 开启自我保护

config.setRenewalPercentThreshold(0.85); // 85%心跳阈值

return config;

}

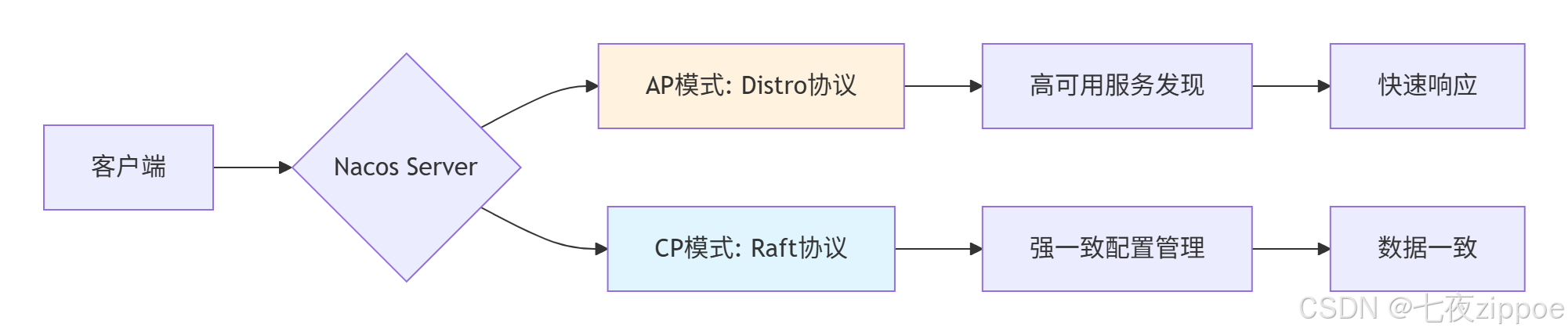

} 2.2 Nacos:在AP与CP之间自由切换的全能选手

Nacos(Naming and Configuration Service)来自阿里巴巴,其最大的创新在于支持AP和CP两种一致性模型的热切换。这使其能够灵活适应不同业务场景的需求:对于需要高可用的普通服务调用,使用AP模式;对于如数据库地址等要求强一致性的配置,则切换到CP模式。

这种双模式架构使其在云原生和容器化部署环境中极具优势,下图展示了其架构概览:

通过简单的配置即可完成模式切换,这体现了其设计的灵活性:

// Nacos模式切换配置

@Configuration

public class NacosConfig {

// AP模式:适用于服务发现,注重可用性

@Bean

public NacosDiscoveryProperties apModeConfig() {

NacosDiscoveryProperties properties = new NacosDiscoveryProperties();

properties.setServerAddr("192.168.1.100:8848");

properties.setNamespace("dev");

properties.setClusterName("AP_CLUSTER");

// AP模式配置

properties.setNamingLoadCacheAtStart(true); // 启动时加载缓存

return properties;

}

// CP模式:适用于配置管理,注重一致性

@Bean

public ConfigService cpModeConfig() throws NacosException {

Properties properties = new Properties();

properties.put(PropertyKeyConst.SERVER_ADDR, "192.168.1.100:8848");

properties.put(PropertyKeyConst.NAMESPACE, "config");

properties.put(PropertyKeyConst.CONFIG_LONG_POLL_TIMEOUT, "30000");

// 启用CP模式

properties.put(PropertyKeyConst.CP_MODE, "true");

return NacosFactory.createConfigService(properties);

}

}2.3 Consul:强一致性与服务网格的先行者

Consul由HashiCorp开发,其设计初衷就包含了强一致性(CP)和多数据中心支持。它基于Raft共识算法来保证集群中数据的一致性。除了服务发现,Consul还内置了健康检查、键值存储(KV Store),并且天然与Service Mesh(服务网格)集成,是其另一大亮点。

Consul的服务注册与发现示例如下,其API设计清晰且功能强大:

// Consul服务注册与发现

@Component

public class ConsulServiceRegistry {

@Autowired

private ConsulClient consulClient;

// 服务注册

public void registerService(String serviceName, String address, int port) {

NewService newService = new NewService();

newService.setId(serviceName + "-" + address + ":" + port);

newService.setName(serviceName);

newService.setAddress(address);

newService.setPort(port);

// 健康检查配置

NewService.Check check = new NewService.Check();

check.setHttp("http://" + address + ":" + port + "/health");

check.setInterval("10s");

check.setTimeout("5s");

newService.setCheck(check);

consulClient.agentServiceRegister(newService);

}

// 服务发现

public List discoverHealthyServices(String serviceName) {

Response> healthyServices =

consulClient.getHealthServices(serviceName, true, null);

return healthyServices.getValue().stream()

.map(ServiceHealth::getService)

.map(this::mapToServiceInstance)

.collect(Collectors.toList());

}

} 3. CAP理论在注册中心中的现实权衡

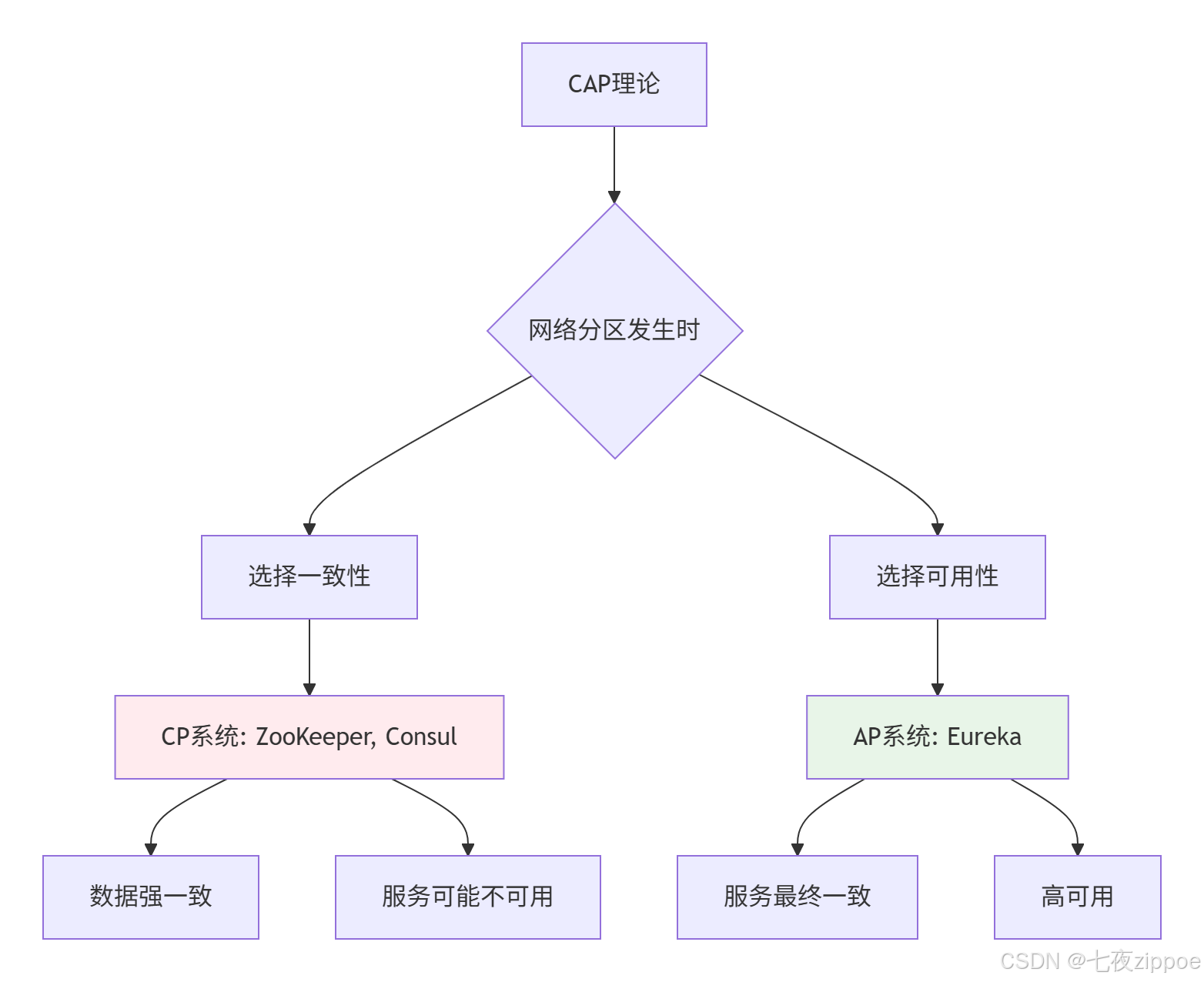

CAP定理指出,分布式系统无法同时完美满足一致性(C)、可用性(A)和分区容错性(P)。在注册中心这个特定场景下,这个理论有着非常现实的指导意义。网络分区(P)在分布式环境中是必然存在的,因此设计者必须在一致性(C)和可用性(A)之间做出取舍。

下图直观展示了CAP理论在注册中心设计中的权衡:

- Eureka的选择(AP):它牺牲强一致性,确保在网络波动时服务列表依然可读(可能包含过时或已下线的实例),依靠客户端负载均衡器和健康检查来弥补。其实现体现了AP原则:

// Eureka的最终一致性实现

@Service

public class EurekaAPMechanism {

// 1. 客户端缓存机制

public void clientCacheMechanism() {

// Eureka客户端默认30秒刷新本地缓存

// 即使注册中心短暂不可用,客户端仍能使用缓存的服务列表

}

// 2. 自我保护机制

public void selfPreservationMechanism() {

// 15分钟内85%的心跳失败,进入自我保护模式

// 不再剔除任何服务实例,保证基本可用性

}

// 3. 区域感知

public void zoneAwareness() {

// 优先访问同区域服务,降低跨区域网络分区影响

}

}- Nacos的灵活性(AP/CP):如前所述,Nacos允许用户根据场景选择模式,这是其最大的竞争优势。

# application.properties中配置Nacos模式

# AP模式(默认)- 服务发现场景

nacos.core.protocol.distro.data.sync.mode=Async

# CP模式 - 配置管理场景

nacos.core.protocol.distro.data.sync.mode=Raft- Consul的坚持(CP):Consul通过Raft协议保证写操作在多数节点达成一致后才返回成功,读取的也是最新数据。这保证了数据的强一致性,但在集群Leader选举或网络分区时,可能会短暂影响可用性。

// Consul的强一致性实现

public class ConsulCPMechanism {

// Raft协议实现

public void raftConsensus() {

// 所有写操作必须经过Leader节点

// 多数节点确认后才返回成功

// 保证数据的强一致性

}

// 选举期间的影响

public void leaderElectionImpact() {

// Leader选举期间(通常几秒到几十秒)

// 写操作不可用,但读操作仍可服务

}

}[AFFILIATE_SLOT_1]

4. 与Spring Cloud及K8s生态的整合实战

对于Java开发者而言,与Spring Cloud的整合便利性是重要的选型考量。三者都提供了良好的支持,但体验和侧重点有所不同。

4.1 Eureka:Spring Cloud的“原住民”

Eureka与Spring Cloud的整合最为成熟和简单。服务端配置简洁明了:

# application-eureka.yml

server:

port: 8761

eureka:

instance:

hostname: localhost

client:

register-with-eureka: false

fetch-registry: false

service-url:

defaultZone: http://localhost:8761/eureka/

server:

enable-self-preservation: true

renewal-percent-threshold: 0.85客户端只需添加依赖和注解即可完成集成:

// 订单服务 - 服务提供者

@SpringBootApplication

@EnableEurekaClient

public class OrderServiceApplication {

public static void main(String[] args) {

SpringApplication.run(OrderServiceApplication.class, args);

}

@Bean

@LoadBalanced // 开启负载均衡

public RestTemplate restTemplate() {

return new RestTemplate();

}

}

// 应用配置

spring:

application:

name: order-service

eureka:

client:

service-url:

defaultZone: http://localhost:8761/eureka/

instance:

instance-id: ${spring.application.name}:${random.value}

prefer-ip-address: true4.2 Nacos:Spring Cloud Alibaba的核心组件

作为Spring Cloud Alibaba套件的一部分,Nacos的整合同样顺畅,并且提供了强大的配置管理功能。首先引入依赖:

com.alibaba.cloud

spring-cloud-starter-alibaba-nacos-discovery

2022.0.0.0

com.alibaba.cloud

spring-cloud-starter-alibaba-nacos-config

2022.0.0.0

然后在配置文件中指定Nacos服务器地址即可:

# bootstrap.yml

spring:

application:

name: user-service

cloud:

nacos:

discovery:

server-addr: 192.168.1.100:8848

namespace: dev-environment

group: DEFAULT_GROUP

cluster-name: BEIJING

weight: 1.0

metadata:

version: 1.0.0

environment: production

config:

server-addr: 192.168.1.100:8848

file-extension: yaml

refresh-enabled: true4.3 Consul:功能丰富的选择

Consul需要先部署其服务端,通常以Docker容器方式运行,非常适合容器化部署环境:

# 使用Docker快速启动Consul集群

docker run -d --name=consul-server1 -p 8500:8500 \

-e CONSUL_BIND_INTERFACE=eth0 consul agent -server \

-bootstrap-expect=3 -ui -client=0.0.0.0

docker run -d --name=consul-server2 \

-e CONSUL_BIND_INTERFACE=eth0 consul agent -server \

-retry-join=172.17.0.2 -client=0.0.0.0

docker run -d --name=consul-server3 \

-e CONSUL_BIND_INTERFACE=eth0 consul agent -server \

-retry-join=172.17.0.2 -client=0.0.0.0Spring Cloud应用通过以下配置即可接入Consul:

# application-consul.yml

spring:

cloud:

consul:

host: localhost

port: 8500

discovery:

register: true

instance-id: ${spring.application.name}:${server.port}

service-name: ${spring.application.name}

tags:

- version=1.0.0

- environment=dev

health-check-path: /actuator/health

health-check-interval: 30s

config:

enabled: true

format: yaml在Kubernetes(K8s)原生环境中,三者的集成方式也在演进。Nacos和Consul都提供了K8s Operator或Helm Chart,便于在K8s集群中部署和管理。Eureka虽然本身不是为K8s设计,但也可以通过StatefulSet等方式部署。未来,注册中心与K8s Service、Istio等服务网格技术的原生集成是一个明确趋势。

5. 性能、选型与企业级实践

在理论架构之外,性能指标和运维复杂度是生产环境必须考量的因素。基于标准测试环境(如8核16GB节点,千兆网络)的对比数据具有重要参考价值。

以下是一份关键性能指标对比的示例表格,涵盖了注册耗时、发现耗时、集群压力等维度:

性能指标 | Eureka | Nacos(AP) | Nacos(CP) | Consul |

|---|---|---|---|---|

注册吞吐量(QPS) | 12,000 | 15,000 | 8,000 | 7,500 |

发现延迟(P95) | 45ms | 35ms | 65ms | 80ms |

CPU占用(3节点) | 28% | 32% | 45% | 52% |

内存占用(集群) | 2.1GB | 2.8GB | 3.2GB | 3.5GB |

网络分区恢复 | 15s | 12s | 25s | 30s |

性能测试的代码框架通常如下,用于模拟高并发场景:

// 注册性能测试

@SpringBootTest

@Slf4j

public class RegistryPerformanceTest {

@Autowired

private ServiceRegistry serviceRegistry;

@Test

public void testRegistrationPerformance() {

int serviceCount = 1000;

long startTime = System.currentTimeMillis();

// 批量注册性能测试

for (int i = 0; i < serviceCount; i++) {

Registration registration = createTestRegistration("test-service-" + i);

serviceRegistry.register(registration);

}

long duration = System.currentTimeMillis() - startTime;

double qps = serviceCount * 1000.0 / duration;

log.info("注册性能: {} QPS, 总耗时: {}ms", qps, duration);

}

@Test

public void testDiscoveryPerformance() {

DiscoveryClient discoveryClient = context.getBean(DiscoveryClient.class);

// 服务发现延迟测试

int iterations = 1000;

long totalLatency = 0;

for (int i = 0; i < iterations; i++) {

long start = System.nanoTime();

List instances = discoveryClient.getInstances("order-service");

long latency = System.nanoTime() - start;

totalLatency += latency;

}

double avgLatency = totalLatency / (iterations * 1_000_000.0);

log.info("平均发现延迟: {:.2f}ms", avgLatency);

}

} 在企业级实践中,高可用部署、监控和安全加固至关重要。例如,Nacos的生产环境配置需要关注持久化存储和集群调优:

# cluster.conf - Nacos集群配置

192.168.1.101:8848

192.168.1.102:8848

192.168.1.103:8848

# application.properties - 生产环境优化

# 数据持久化配置

spring.datasource.platform=mysql

db.num=1

db.url.0=jdbc:mysql://db-host:3306/nacos?characterEncoding=utf8

db.user=nacos

db.password=nacos-prod-password

# 集群性能优化

nacos.core.protocol.distro.data.sync.delayMs=1000

nacos.core.protocol.distro.data.sync.periodMs=3000

nacos.naming.clean.periodMs=30000Eureka的高可用集群则需要节点间相互注册:

# 三节点Eureka集群配置

# eureka-server1.yml

eureka:

client:

service-url:

defaultZone: http://server2:8762/eureka/,http://server3:8763/eureka/

instance:

hostname: server1

# eureka-server2.yml

eureka:

client:

service-url:

defaultZone: http://server1:8761/eureka/,http://server3:8763/eureka/

instance:

hostname: server2

# eureka-server3.yml

eureka:

client:

service-url:

defaultZone: http://server1:8761/eureka/,http://server2:8762/eureka/

instance:

hostname: server3当遇到服务注册失败等故障时,系统的排查流程和工具链就显得尤为重要:

@Component

@Slf4j

public class RegistryTroubleshooter {

public void diagnoseRegistrationIssue(Registration registration) {

// 1. 检查网络连通性

if (!checkNetworkConnectivity(registration.getHost(), registration.getPort())) {

log.error("网络不通: {}:{}", registration.getHost(), registration.getPort());

return;

}

// 2. 检查注册中心状态

if (!checkRegistryHealth()) {

log.error("注册中心不可用");

return;

}

// 3. 检查认证信息

if (!validateCredentials(registration)) {

log.error("认证失败");

return;

}

// 4. 检查元数据格式

if (!validateMetadata(registration.getMetadata())) {

log.error("元数据格式错误");

return;

}

}

// 自动恢复机制

@EventListener

public void handleRegistryFailure(RegistryFailedEvent event) {

log.warn("注册失败,尝试自动恢复: {}", event.getSource());

// 指数退避重试

executeWithRetry(() -> {

serviceRegistry.register(event.getRegistration());

}, 3, 1000); // 重试3次,初始间隔1秒

}

}[AFFILIATE_SLOT_2]

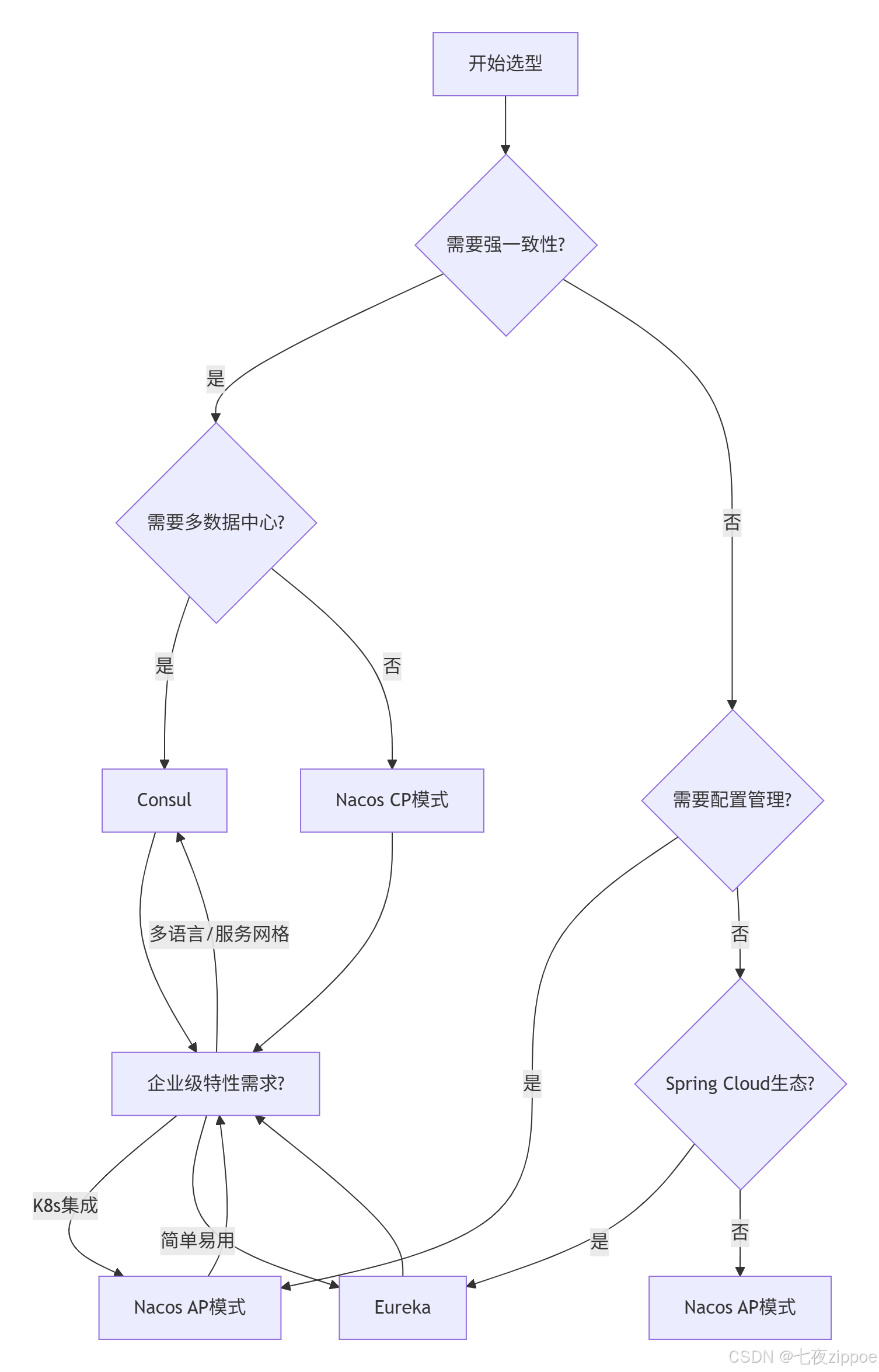

6. 终极选型指南:没有最好,只有最合适

技术选型不应盲目追求新颖或强大,而应紧密结合团队技术栈、业务场景和运维能力。我们可以借助一个决策树来梳理思路:

基于此,我们对常见场景给出建议:

- 电商/互联网应用:优先考虑Nacos(AP模式)。高可用性要求高于强一致性,且其配置中心功能能很好地支持促销活动的动态配置。

- 金融/交易系统:倾向于Consul。强一致性和多数据中心支持符合其业务严谨性和容灾需求。

- 物联网(IoT)平台:Nacos(CP模式)可能更合适。海量设备连接管理需要稳定的服务路由(一致性),同时需要管理大量的设备配置。

- 传统企业Spring Cloud项目:如果团队熟悉Spring Cloud Netflix生态,且系统对一致性要求不极端,Eureka依然是稳定可靠的选择,技术栈统一能降低维护成本。

展望未来,注册中心正朝着与服务网格(如Istio)深度融合和更深度地Kubernetes原生集成的方向发展。例如,通过CRD(自定义资源定义)在K8s内管理服务发现规则。

// Istio + Consul集成示例

apiVersion: networking.istio.io/v1alpha3

kind: ServiceEntry

metadata:

name: external-service

spec:

hosts:

- api.example.com

ports:

- number: 443

name: https

protocol: HTTPS

resolution: DNS

location: MESH_EXTERNAL# Nacos K8s Operator示例

apiVersion: nacos.io/v1alpha1

kind: NacosCluster

metadata:

name: nacos-cluster

spec:

size: 3

image: nacos/nacos-server:2.0.3

storage:

class: fast-ssd

size: 100Gi

config:

mode: ap

db:

url: jdbc:mysql://mysql.nacos:3306/nacos最后,请务必参考各项目的官方文档以获取最准确和最新的信息:Nacos、Consul和Eureka的官方文档是学习和解决问题的第一站。记住,任何技术选型都应从小规模试点开始,充分验证其在特定环境下的表现,因为没有银弹,只有最适合你当前场景的解决方案。

浙公网安备 33010602011771号

浙公网安备 33010602011771号