Windows 11 极速部署指南:CUDA版llama.cpp全局调用与GGUF模型本地聊天实战

想在本地拥有一台无需联网、响应迅速的大语言模型聊天助手吗?对于拥有NVIDIA显卡的Windows用户而言,llama.cpp结合CUDA加速是实现这一目标的高效途径。它免去了复杂的Python环境配置,通过预编译包和GGUF量化模型,让你能在几分钟内启动一个强大的本地AI。本文将手把手带你完成从环境准备、CUDA版llama.cpp配置,到实现系统全局调用、流畅运行GGUF模型的完整流程,即使是新手也能轻松驾驭。

一、部署前的核心准备:硬件、软件与资源

成功的部署始于充分的准备。与配置复杂的Python深度学习环境不同,llama.cpp的部署更接近于“开箱即用”,但前提是基础环境匹配。

- 硬件要求:核心是一块支持CUDA的NVIDIA独立显卡(算力7.5+),例如RTX 30/40系列或更高。显存大小直接决定你能运行的模型规模,8GB显存可流畅运行7B模型,而16GB以上则能尝试20B参数模型。

- 软件环境:确保Windows 11系统为64位,并安装最新的NVIDIA官方显卡驱动。CUDA工具包是必须的,需要与后续下载的llama.cpp预编译版本匹配(例如CUDA 13.1)。

- 资源下载:你需要准备两个核心文件:1) CUDA版llama.cpp预编译包,从官方发布页获取;2) GGUF格式的量化模型,从Hugging Face或TheBloke等仓库下载。选择模型时需权衡量化等级与显存占用。

二、整理与配置:为全局调用铺平道路

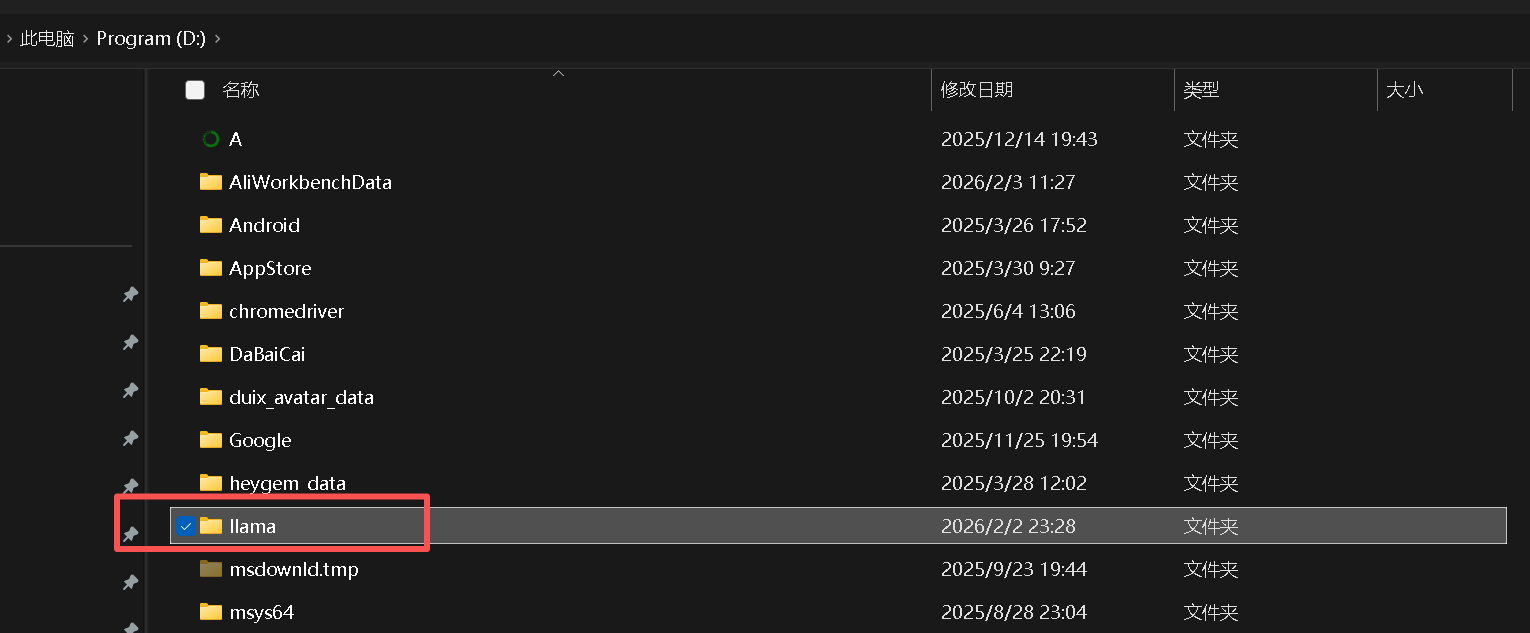

下载完成后,合理的目录管理是避免后续问题的关键。将下载的llama-b7907-bin-win-cuda-13.1-x64.zipD:\llamallama-cli.exeggml-cuda.dll

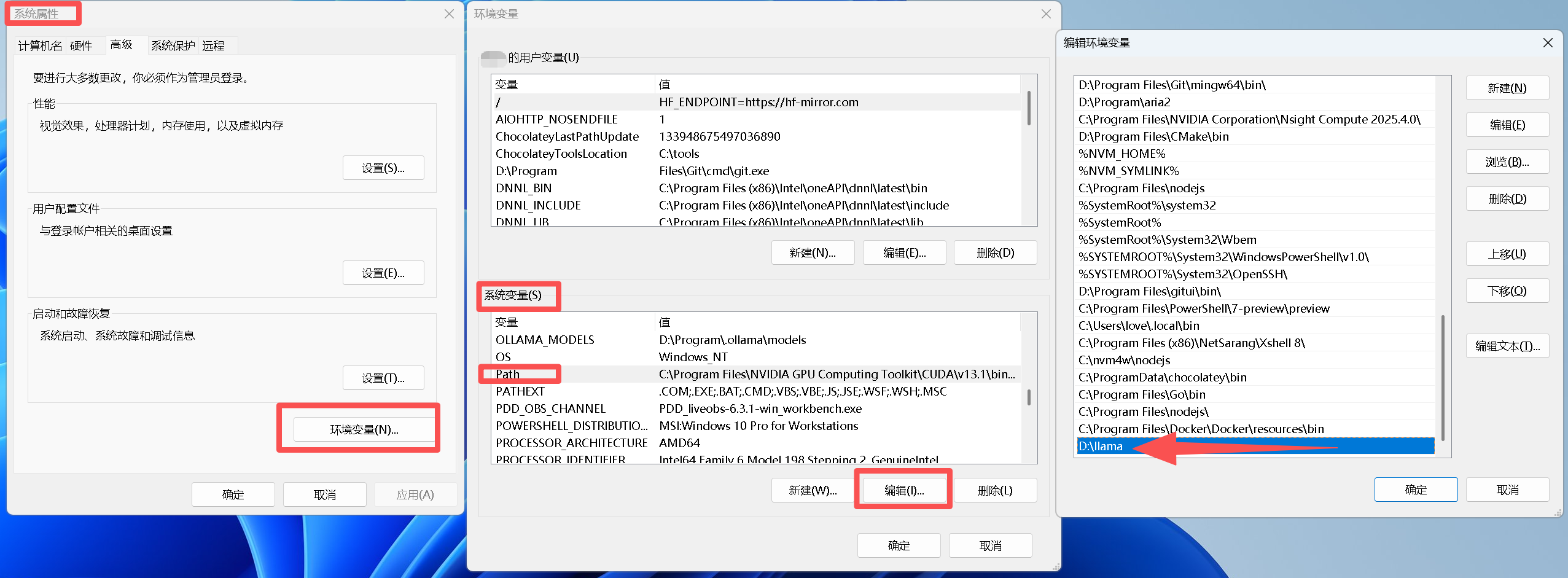

接下来是实现便捷性的核心步骤:配置系统环境变量。这能让你在任意命令行窗口直接调用llama-cli.exe,无需每次都切换到其所在目录。

- 按下

Win + Rsysdm.cpl - 在“系统变量”中找到

PathD:\llama - 保存所有设置,并务必重启命令行窗口或电脑使配置生效。

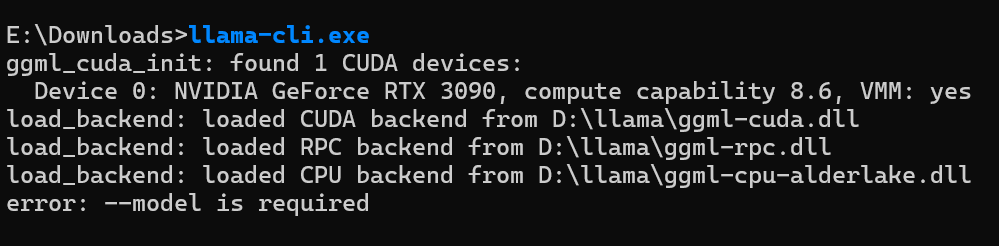

验证是否成功:打开新的CMD或PowerShell,输入where.exe llama-cliD:\llama\llama-cli.exellama-cli.exe

ggml_cuda_init: found 1 CUDA devices:

Device 0: NVIDIA GeForce RTX 3090, compute capability 8.6, VMM: yes

load_backend: loaded CUDA backend from D:\llama\ggml-cuda.dll三、启动与交互:运行你的第一个本地模型

环境就绪后,即可体验本地大模型的魅力。建议将下载的GGUF模型文件(如gpt-oss-20b-base.Q3_K_L.ggufE:\Downloads\LLM_Models

路径示例:

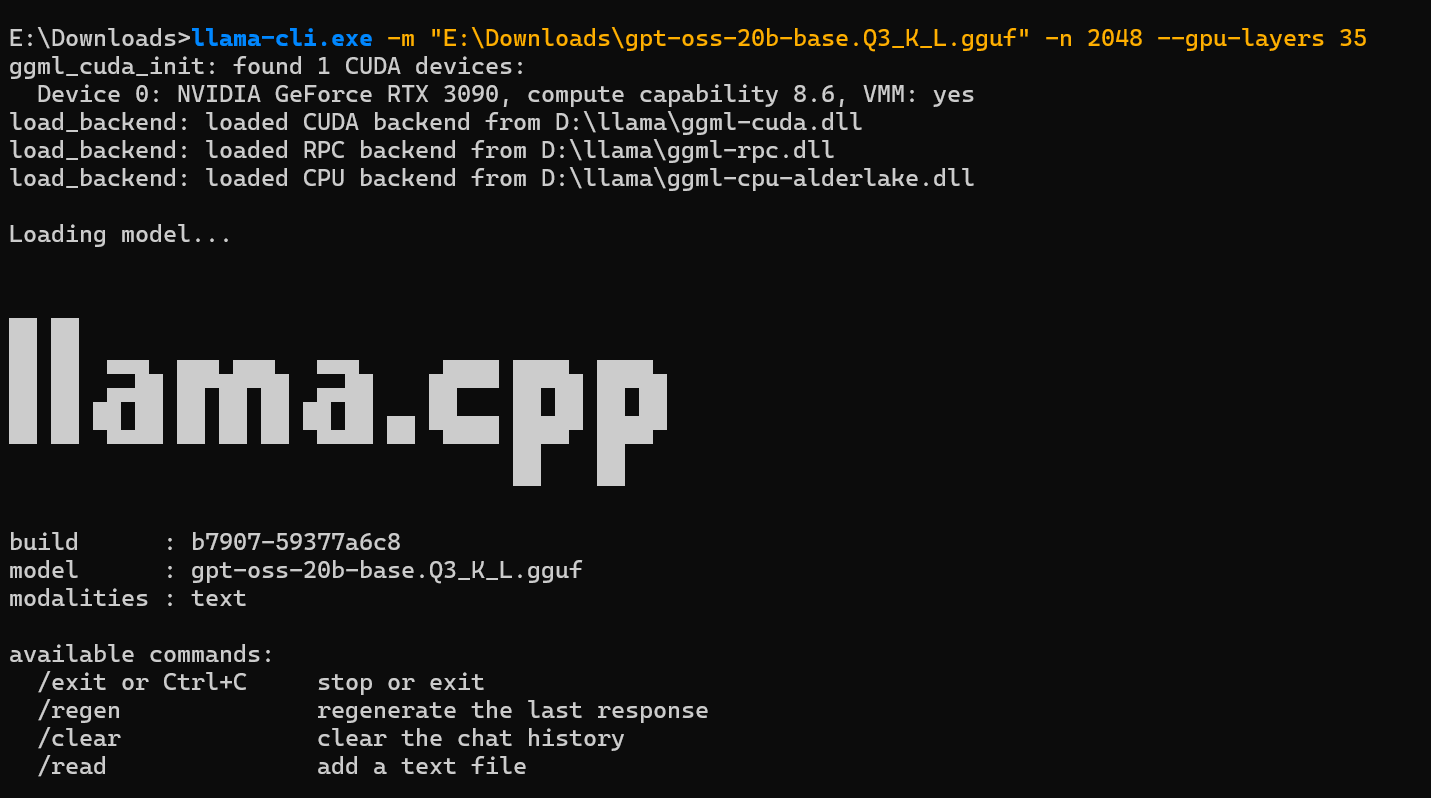

在任意路径的命令行中,使用以下核心命令启动交互式聊天:

-m--gpu-layers-n

llama-cli.exe -m "模型文件路径" -n 2048 --gpu-layers 35llama-cli.exe -m "E:\Downloads\gpt-oss-20b-base.Q3_K_L.gguf" -n 2048 --gpu-layers 35

命令执行后,终端会显示模型加载信息,并进入“>”提示符的交互界面。此时,你可以直接输入问题并得到离线回复。回复末尾会显示推理速度,在CUDA加速下通常远超CPU。

Loading model...

build : b7907-59377a6c8

model : gpt-oss-20b-base.Q3_K_L.gguf

modalities : text

available commands:

/exit or Ctrl+C stop or exit

/regen regenerate the last response

/clear clear the chat history

> 你是哪个模型

常用交互命令:输入/exitCtrl+C/regen/clear

四、常见问题排查与解决方案

部署过程中可能会遇到一些典型问题,以下是快速解决方案:

- “不是内部或外部命令”:检查环境变量Path是否配置正确,并确认已重启终端。路径中不能有中文或空格。

- ⚠️ CUDA设备未找到:确保显卡驱动为最新,且安装的CUDA版本与llama.cpp预编译包匹配(如都基于13.1)。可通过

nvcc -V - 模型加载失败:确认下载的是GGUF格式模型,而非旧的GGML格式。TheBloke仓库是可靠的模型来源。

- ⚠️ 显存不足(Out of Memory):尝试降低

--gpu-layers

对于开发者而言,这种本地部署模式与配置远程Python服务(使用Flask或FastAPI)有异曲同工之妙,但更为轻量和直接。[AFFILIATE_SLOT_1]

五、效率提升与进阶玩法

为了进一步提升使用体验,可以考虑以下优化:

- 创建批处理脚本:避免每次输入长命令。新建一个

.bat文件,内容如下,双击即可启动指定模型。

@echo off

echo 正在启动 CUDA 版 llama.cpp,加载模型中...

llama-cli.exe -m "E:\Downloads\gpt-oss-20b-base.Q3_K_L.gguf" -n 2048 --gpu-layers 35

pause- 开启API服务:利用

llama-server.exe

llama-server.exe -m "E:\Downloads\gpt-oss-20b-base.Q3_K_L.gguf" --gpu-layers 35 --port 8080- 统一资源管理:在

D:\llamaModels

六、总结:开启本地AI开发新篇章

通过以上步骤,你已经在Windows 11上成功部署了一个支持CUDA加速、可全局调用的本地大模型环境。llama.cpp以其轻量、高效和易部署的特性,降低了个人体验和开发AI应用的门槛。你可以自由尝试不同规模和量化等级的GGUF模型,调整--gpu-layers--temp

这不仅是获得一个离线聊天工具,更是开启本地AI应用开发的一把钥匙。无论是用于学习、创作还是作为更复杂项目的本地推理后端,这个稳定高效的本地环境都将为你提供坚实的基础。[AFFILIATE_SLOT_2]

E:\Downloads\gpt-oss-20b-base.Q3_K_L.gguf

浙公网安备 33010602011771号

浙公网安备 33010602011771号