统计学习方法第二版第二章感知机笔记

1. 感知机模型

1.1 定义

1.2 类型

- 感知机是线性分类模型属于判别模型

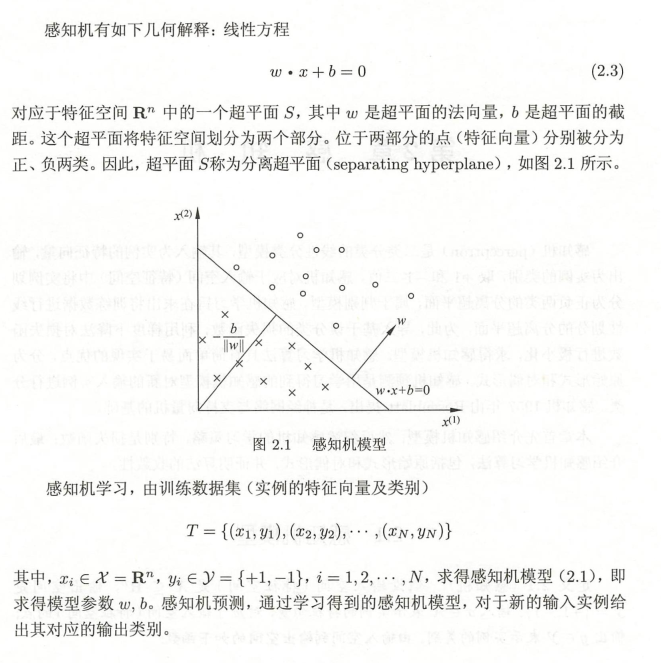

1.3 几何解释

2. 感知机学习策略

2.1 数据集的线性可分性

2.1.1 定义

2.2 感知机学习策略

2.2.1 损失函数

2.2.1.1 定义:

1)误分类点到超平面S的总距离

2.2.1.2 公式:

1)任意一点\(x_{0}\)到S的距离:\(\frac{1}{\left \| w \right \|_{2}}\left | w\cdot x_{0}+b \right |\)

2)对任意误分类点数据\(\left ( x_{i},y_{i} \right ):-y_{i}\left ( w\cdot x_{i}+b \right )> 0\)

2.2.1.3 \(\frac{1}{\left \| w \right \|_{2}}\)不考虑的原因:

1)损失函数是误分类点集合,为保证正确分类所以加上负号,即\(-y_{i}\left ( w\cdot x_{i}+b \right )\)为函数间隔

2)\(\frac{1}{\left \| w \right \|_{2}}\)是归一化超平面法向量,\(-\frac{1}{\left \| w \right \|_{2}}y_{i}\left ( w\cdot x_{i}+b \right )\)是几何间隔,函数间隔和几何间隔的差异在自在于同一个超平面\(\left ( w,b \right )\)参数等比例放大成\(\left ( kw,kb \right )\)之后,函数间隔放大,几何间隔不变

3)推导:

若忽略\(\frac{1}{\left \| w \right \|_{2}}\),参数更新如下:

\(w_{k} = w_{k-1}+\eta y_{i}x_{i},b_{k} = b_{k-1}+\eta y_{i}\)

若不忽略$$,参数更新如下

\(\frac{\partial }{\partial \left \| w \right \|_{2}} = \frac{w}{\left \| w \right \|_{2}},w_{k} = w_{k-1}+\eta y_{i}x_{i}\left ( \frac{I}{\left \| w \right \|_{2}}-\frac{ww^{T}}{\left \| w \right \|_{2}^{3}} \right )+\eta y_{i}b_{k-1}\left ( -\frac{w}{\left \| w \right \|_{2}^{3}} \right ),b_{k}=b_{k-1}+\frac{1}{\left \| w \right \|_{2}^{3}}\eta y_{i}\)

即不考虑\(\frac{1}{\left \| w \right \|_{2}}\)简化计算量

3. 感知机学习算法

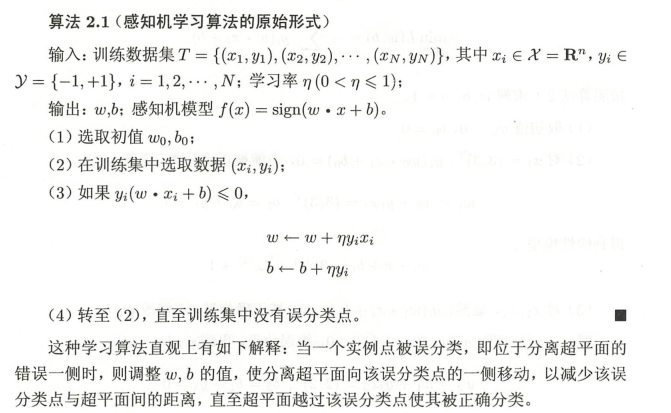

3.1 感知机学习算法的原始形式

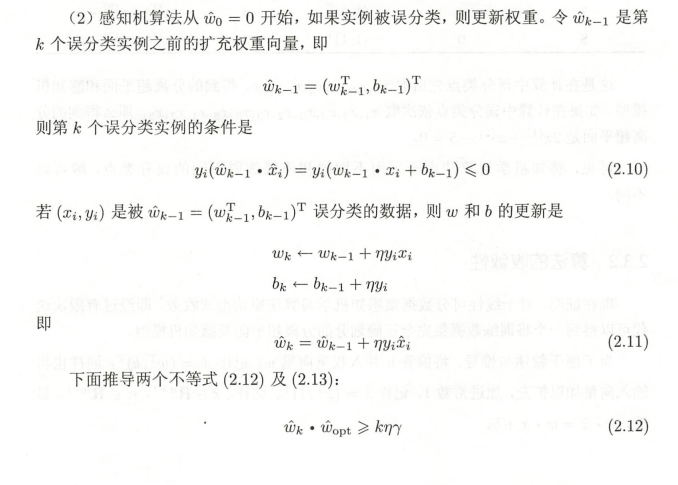

说明:原始形式中,首先任意选取一个超平面,然后用梯度下降法不断极小化目标函数。在这个过程中一次随机选取一个误分类点使其梯度下降算法采取不同的初值或者不同的误分类点,解可以不同

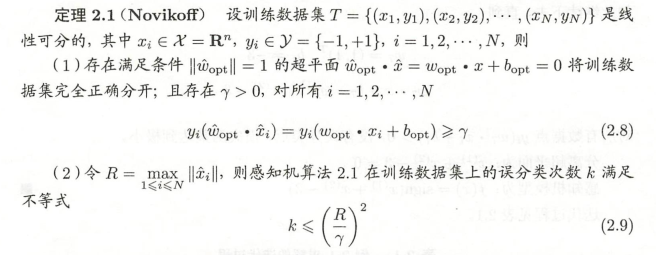

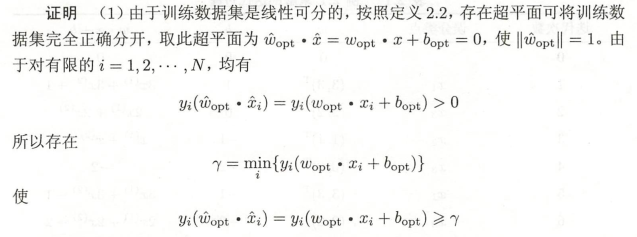

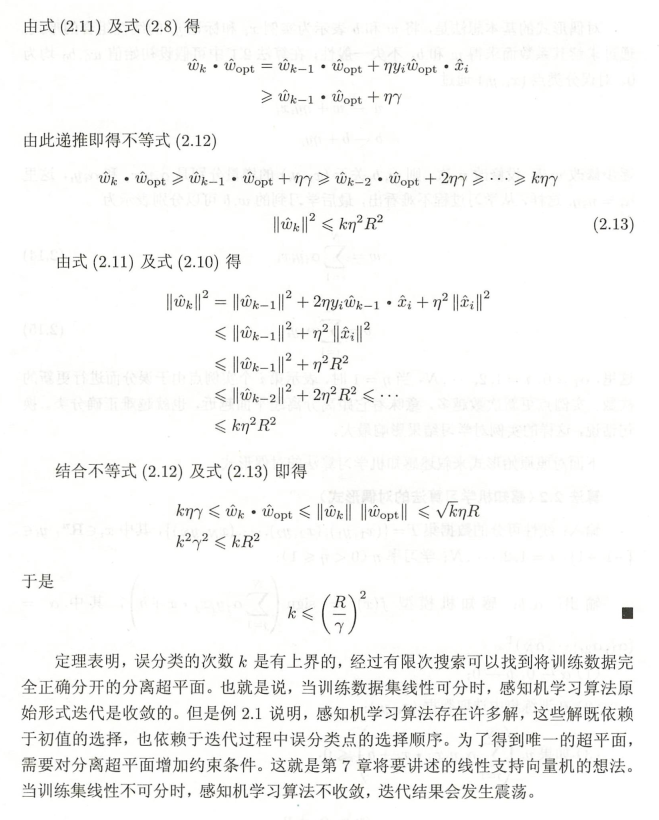

3.2 算法的收敛性

3.2.1 定理

说明:偏置b并入权重向量w,记为\(\hat{w} = \left ( w^{T},b \right )^{T}\),输入向量X加入常数1扩充,记作\(\hat{x} = \left ( x^{T},1 \right )^{T}\),显然\(\hat{w}\cdot \hat{x} = w\cdot x+b\)

3.2.2 (1)的证明

3.2.3 (2)的证明

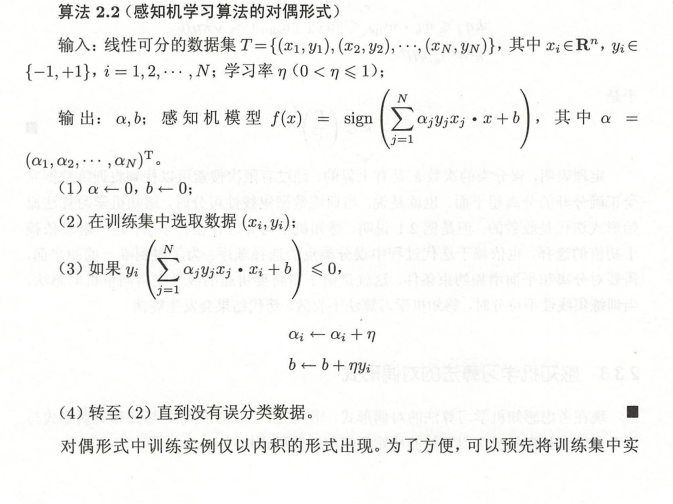

3.3 感知机学习算法的对偶形式

3.3.1 定义

说明:在训练集中选取数据做(3)的判断时,可以将数据先处理成Gram矩阵存储,方便计算

3.3.2 公式说明

步骤(3)展开:\(y_{i}\left [ \left ( \alpha _{1} y_{1}x_{1}+\alpha _{2} y_{2}x_{2}+...+\alpha _{j} y_{j}x_{j} \right )\cdot x_{i}+b \right ] ①\)每次迭代将数据集中的数据代入①计算是否小于等于0,若所有数据计算都大于0则迭代结束,根据\(\alpha _{i}\cdot x_{i}\)计算w,确定最终模型\(f\left ( x \right ) = sign\left ( w\cdot x+b \right )\)

浙公网安备 33010602011771号

浙公网安备 33010602011771号