Ollama导出和导入DeepSeek预训练大模型

为了离线部署大模型,需要从互联网导出模型文件,并拷贝到内网离线布署,本文以Docker布署的大模型为例。

一、从互联网的Ollama中导出大模型

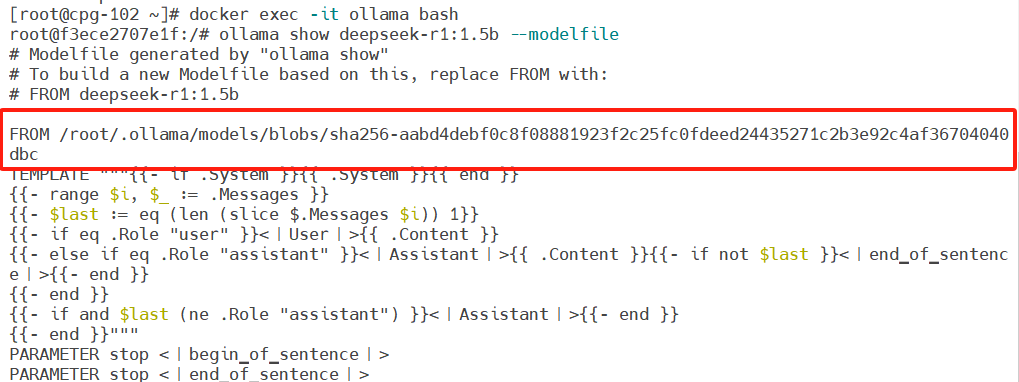

1 docker exec -it ollama bash #前提是ollama已在docker中布署好 2 cd /root 3 ollama pull deepseek-r1:1.5b 4 ollama show deepseek-r1:1.5b --modelfile >> Modelfile

5 cat Modelfile #从Modelfile中找到模型文件所在地址 6 docker cp ollama:/root/.ollama/models/blobs/sha256-aabd4debf0c8f08881923f2c25fcfdeed24435271c2b3e92c4af36704040dbc /root/deepseek-r1:1.5b.gguf

7 docker cp ollama:/root/Modelfile /root

二、在内网中导入并应用大模型

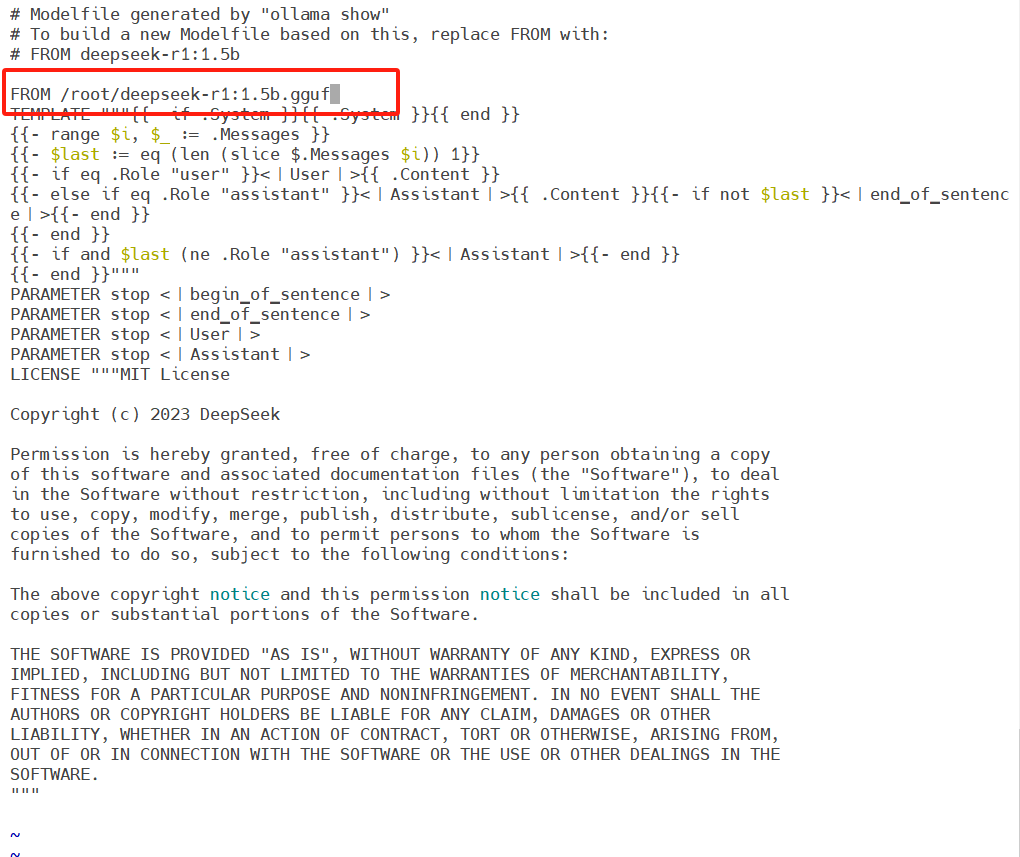

1 cd /root 2 vi Modelfile #将FROM的内容改为如下图所示路径

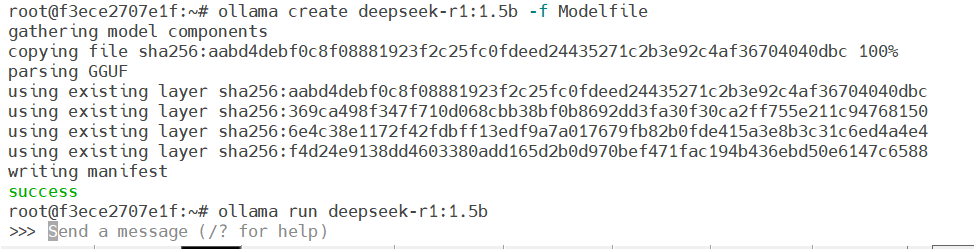

将模型文件拷贝到容器中,使用ollama create命令离线导入模型。

1 docker cp /root/deepseek-r1:1.5b.gguf ollama:/root/ 2 docker cp /root/Modelfile ollama:/root/ 3 docker exec -it ollama bash 4 ollama create deepseek-r1:1.5b -f Modelfile

5 ollama run deepseek-r1:1.5b

这样一个离线大模型就布署好了。

浙公网安备 33010602011771号

浙公网安备 33010602011771号