KNN分类算法及python代码实现

KNN分类算法(先验数据中就有类别之分,未知的数据会被归类为之前类别中的某一类!)

1、KNN介绍

K最近邻(k-Nearest Neighbor,KNN)分类算法是最简单的机器学习算法。

机器学习,算法本身不是最难的,最难的是:

1、数学建模:把业务中的特性抽象成向量的过程;

2、选取适合模型的数据样本。

这两个事都不是简单的事。算法反而是比较简单的事。

本质上,KNN算法就是用距离来衡量样本之间的相似度。

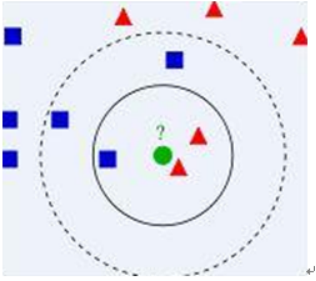

2、算法图示

◊ 从训练集中找到和新数据最接近的k条记录,然后根据多数类来决定新数据类别。

◊算法涉及3个主要因素:

1) 训练数据集

2) 距离或相似度的计算衡量

3) k的大小

◊算法描述

1) 已知两类“先验”数据,分别是蓝方块和红三角,他们分布在一个二维空间中

2) 有一个未知类别的数据(绿点),需要判断它是属于“蓝方块”还是“红三角”类

3) 考察离绿点最近的3个(或k个)数据点的类别,占多数的类别即为绿点判定类别

3、算法要点

3.1、计算步骤

1)算距离:给定测试对象,计算它与训练集中的每个对象的距离

2)找邻居:圈定距离最近的k个训练对象,作为测试对象的近邻

3)做分类:根据这k个近邻归属的主要类别,来对测试对象分类

3.2、相似度的度量

◊距离越近应该意味着这两个点属于一个分类的可能性越大。

但,距离不能代表一切,有些数据的相似度衡量并不适合用距离

◊相似度衡量方法:包括欧式距离、夹角余弦等。

(简单应用中,一般使用欧氏距离,但对于文本分类来说,使用余弦(cosine)来计算相似度就比欧式(Euclidean)距离更合适)

3.3、类别的判定

◊简单投票法:少数服从多数,近邻中哪个类别的点最多就分为该类。

◊加权投票法:根据距离的远近,对近邻的投票进行加权,距离越近则权重越大(权重为距离平方的倒数)

3.4、算法不足

- 样本不平衡容易导致结果错误

◊如一个类的样本容量很大,而其他类样本容量很小时,有可能导致当输入一个新样本时,该样本的K个邻居中大容量类的样本占多数。

◊改善方法:对此可以采用权值的方法(和该样本距离小的邻居权值大)来改进。

- 计算量较大

◊因为对每一个待分类的文本都要计算它到全体已知样本的距离,才能求得它的K个最近邻点。

◊改善方法:事先对已知样本点进行剪辑,事先去除对分类作用不大的样本。

该方法比较适用于样本容量比较大的类域的分类,而那些样本容量较小的类域采用这种算法比较容易产生误分。

4、KNN分类算法python实现(python2.7)

需求:

有以下先验数据,使用knn算法对未知类别数据分类

|

属性1 |

属性2 |

类别 |

|

1.0 |

0.9 |

A |

|

1.0 |

1.0 |

A |

|

0.1 |

0.2 |

B |

|

0.0 |

0.1 |

B |

未知类别数据

|

属性1 |

属性2 |

类别 |

|

1.2 |

1.0 |

? |

|

0.1 |

0.3 |

? |

python实现:

KNN.py脚本文件

1 #!/usr/bin/python 2 # coding=utf-8 3 ######################################### 4 # kNN: k Nearest Neighbors 5 6 # 输入: newInput: (1xN)的待分类向量 7 # dataSet: (NxM)的训练数据集 8 # labels: 训练数据集的类别标签向量 9 # k: 近邻数 10 11 # 输出: 可能性最大的分类标签 12 ######################################### 13 14 from numpy import * 15 import operator 16 17 # 创建一个数据集,包含2个类别共4个样本 18 def createDataSet(): 19 # 生成一个矩阵,每行表示一个样本 20 group = array([[1.0, 0.9], [1.0, 1.0], [0.1, 0.2], [0.0, 0.1]]) 21 # 4个样本分别所属的类别 22 labels = ['A', 'A', 'B', 'B'] 23 return group, labels 24 25 # KNN分类算法函数定义 26 def kNNClassify(newInput, dataSet, labels, k): 27 numSamples = dataSet.shape[0] # shape[0]表示行数 28 29 # # step 1: 计算距离[ 30 # 假如: 31 # Newinput:[1,0,2] 32 # Dataset: 33 # [1,0,1] 34 # [2,1,3] 35 # [1,0,2] 36 # 计算过程即为: 37 # 1、求差 38 # [1,0,1] [1,0,2] 39 # [2,1,3] -- [1,0,2] 40 # [1,0,2] [1,0,2] 41 # = 42 # [0,0,-1] 43 # [1,1,1] 44 # [0,0,-1] 45 # 2、对差值平方 46 # [0,0,1] 47 # [1,1,1] 48 # [0,0,1] 49 # 3、将平方后的差值累加 50 # [1] 51 # [3] 52 # [1] 53 # 4、将上一步骤的值求开方,即得距离 54 # [1] 55 # [1.73] 56 # [1] 57 # 58 # ] 59 # tile(A, reps): 构造一个矩阵,通过A重复reps次得到 60 # the following copy numSamples rows for dataSet 61 diff = tile(newInput, (numSamples, 1)) - dataSet # 按元素求差值 62 squaredDiff = diff ** 2 # 将差值平方 63 squaredDist = sum(squaredDiff, axis = 1) # 按行累加 64 distance = squaredDist ** 0.5 # 将差值平方和求开方,即得距离 65 66 # # step 2: 对距离排序 67 # argsort() 返回排序后的索引值 68 sortedDistIndices = argsort(distance) 69 classCount = {} # define a dictionary (can be append element) 70 for i in xrange(k): 71 # # step 3: 选择k个最近邻 72 voteLabel = labels[sortedDistIndices[i]] 73 74 # # step 4: 计算k个最近邻中各类别出现的次数 75 # when the key voteLabel is not in dictionary classCount, get() 76 # will return 0 77 classCount[voteLabel] = classCount.get(voteLabel, 0) + 1 78 79 # # step 5: 返回出现次数最多的类别标签 80 maxCount = 0 81 for key, value in classCount.items(): 82 if value > maxCount: 83 maxCount = value 84 maxIndex = key 85 86 return maxIndex

KNNTest.py测试文件

1 #!/usr/bin/python 2 # coding=utf-8 3 import KNN 4 from numpy import * 5 # 生成数据集和类别标签 6 dataSet, labels = KNN.createDataSet() 7 # 定义一个未知类别的数据 8 testX = array([1.2, 1.0]) 9 k = 3 10 # 调用分类函数对未知数据分类 11 outputLabel = KNN.kNNClassify(testX, dataSet, labels, 3) 12 print "Your input is:", testX, "and classified to class: ", outputLabel 13 14 testX = array([0.1, 0.3]) 15 outputLabel = KNN.kNNClassify(testX, dataSet, labels, 3) 16 print "Your input is:", testX, "and classified to class: ", outputLabel

运行结果:

浙公网安备 33010602011771号

浙公网安备 33010602011771号