1.逻辑回归是怎么防止过拟合的?为什么正则化可以防止过拟合?

逻辑回归是用正则化来防止过拟合的。

函数在某些小区间里的导数值(绝对值)非常大,由于自变量值可大可小,所以只有系数足够大,才能保证导数值很大。而正则化是通过约束参数的范数使其不要太大,所以可以在一定程度上减少过拟合情况。

2.用logiftic回归来进行实践操作,数据不限。

代码:

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import mean_squared_error

from sklearn.metrics import classification_report

import pandas as pd

import numpy as np

def logistic():

#逻辑回归进行肿瘤的预测

column = ['数据编号', '属性1', '属性2', '属性3', '属性4', '属性5', '属性6', '属性7', '属性8', '属性9','属性10' '类别']

#读取数据

data = pd.read_csv('E:\\da3xia\\jiqixuexi\\breast-cancer-wisconsin_4.csv', names=column)

#print(data)

#缺失值处理

data = data.replace(to_replace='?', value=np.nan)

data = data.dropna() #删掉缺失值

#数据分割 训练集和测试集

x_train, x_test, y_train, y_test = train_test_split(data[column[1:10]], data[column[10]], test_size=0.3)

#进行标准化处理(分别处理) 特征值和目标值

std = StandardScaler()

x_train = std.fit_transform(x_train)

x_test = std.transform(x_test)

#逻辑回归预测

lg = LogisticRegression()

lg.fit(x_train, y_train)

print(lg.coef_)

lg_predict = lg.predict(x_test)

print('准确率:', lg.score(x_test, y_test))

print('召回率:', classification_report(y_test, lg_predict, labels=[2, 4], target_names=['良性', '恶性']))

if __name__ == '__main__':

logistic()

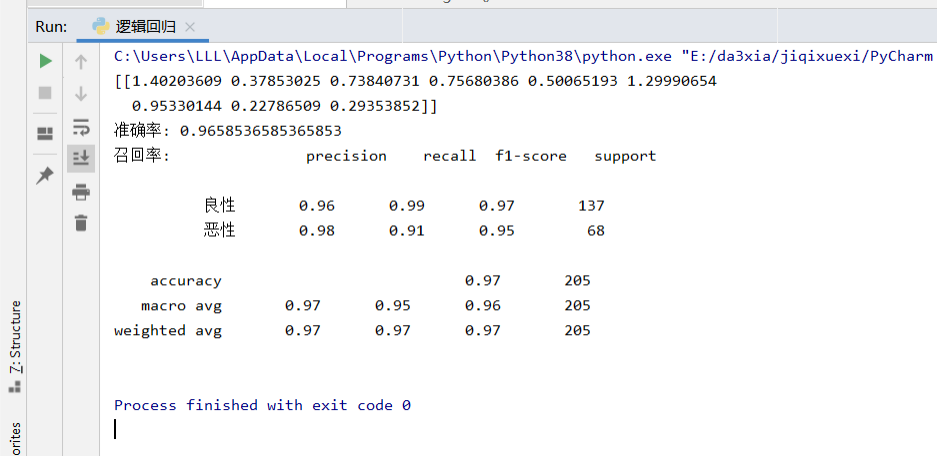

结果:

浙公网安备 33010602011771号

浙公网安备 33010602011771号