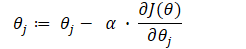

Gradient descent

这是梯度下降算法,θj 是待求的模型假设函数的参数,J(θ) 是代价函数,α 是学习率。

关于学习率α ,它的大小决定了你的算法的优劣,过大有可能导致算法不收敛;过小则会导致迭代次数太多,算法执行时间太长。

因此选择一个合适的 α 是十分重要的,之前老是听别人说什么“调参侠”,可能就是人工调试类似这种参数吧......

这是梯度下降算法,θj 是待求的模型假设函数的参数,J(θ) 是代价函数,α 是学习率。

关于学习率α ,它的大小决定了你的算法的优劣,过大有可能导致算法不收敛;过小则会导致迭代次数太多,算法执行时间太长。

因此选择一个合适的 α 是十分重要的,之前老是听别人说什么“调参侠”,可能就是人工调试类似这种参数吧......