大模型时代必修课:如何针对 SSE 流式场景实施有效的压力测试?

大模型与 AI 应用正在加速落地:智能客服、AI 搜索、代码助手、内容生成、数据分析等场景,几乎都在追求“边算边回、即时可见”的交互体验。为了承载这种流式输出,越来越多的业务采用 SSE(Server-Sent Events) 作为推送通道。

本文将带你系统了解 SSE 的基本原理、它与传统 HTTP 的差异,并结合压测方法、注意事项与指标解读,说明如何借助优测SSE原生压力测试工具高效完成 SSE 流式压测!

Part 1 | SSE 详解

1.1 SSE 是什么?

SSE(Server-Sent Events)是一种基于 HTTP 的服务端推送机制:客户端发起普通 HTTP 请求。服务端以 Content-Type: text/event-stream 返回一个持续不断的流式响应并保持连接,后续不断写入事件。浏览器侧通常用原生 EventSource 或 fetch API 的方式自实现解析接收。

它的工程优势在于:仍是 HTTP 连接,部署与穿透代理通常比 WebSocket 更友好;同时浏览器内建“自动重连”等机制,能较低成本实现实时体验。近年来 SSE 最广泛的落地就是:大模型或 AI Agent 的 token 流式输出、工具调用过程可视化、长任务进度与日志推送。

🔹 典型特点

- 单向推送(Server → Client),更像“订阅/广播”

- 基于 HTTP 长连接,天然穿透大多数网关/代理

- 适合大模型流式输出、进度推送、实时通知、日志/埋点实时回传等场景

1.2 SSE 与传统 HTTP 的区别

| 维度 | 传统 HTTP | SSE |

|---|---|---|

| 连接形态 | 一次请求一次响应,响应结束即断开 | 一次请求连接保持,持续返回多段数据 |

| 数据返回 | 通常一次性返回完整 body | 分片/逐条返回(流式) |

| 业务体验 | 用户等待完整结果 | 用户“先看到一部分”,更快感知与可控 |

| 压测关注点 | RT、TPS、错误率 | 首 token 耗时、推送节奏、连接稳定性、流中断/断连率 |

| 资源压力 | 短连接/连接复用为主 | 长连接占用更多连接/线程/FD/代理资源 |

一句话总结,传统 HTTP 更关注“一次请求完成得快不快”,SSE 更关注“连接能不能稳、第一段来得快不快、后续能不能持续不断”。

Part 2 | 为什么要针对 SSE 压测?

很多技术团队会以为:产品侧把 AI 能力接上、单用户跑通对话链路,体验就“差不多稳了”。但线上真正的考验,发生在高并发时,模型推理、检索/工具调用、网关与鉴权、队列与限流等环节的排队会叠加放大,导致首 token 变慢、输出节奏变差、甚至流式中断。对用户来说,这不是“慢一点”,而是“卡住了/坏了”,从而触发频繁重试与重复提问,进一步放大系统压力。因此,SSE 压测的本质是在验证 AI 产品的真实交互体验,避免把“接入成功”误当成“上线可用”。

哪些场景应该重点关注?

📌 智能助手多轮对话:

多轮上下文会不断变长,推理与编排链路更复杂;高并发下更容易出现“越聊越慢”“中途停更”,直接影响续聊与留存。

📌 长文本/长代码生成:

输出周期长、推送次数多,对长连接稳定性要求更高;一旦断流,用户拿到半截内容,会被感知为“不可靠”。

📌 工具调用 / Agent 场景:

外部系统延迟和失败会放大为流式停顿或卡住;压测要验证依赖抖动时是否会拖垮整体,以及超时、降级、重试策略是否有效。

📌 活动/热点问题带来的流量洪峰:

最容易触发“首段迟迟不来→用户重复点击/重试→压力被放大”的雪崩链路;需要压测验证限流、排队提示、快速失败等策略能否守住体验底线。

📌 “首屏体验”强依赖的产品形态:

用户容忍度低,关键在“尽快看到第一段可用信息”;压测应验证高并发下是否仍能稳定快速输出首屏内容,而不是一直转圈。

Part 3 | 如何针对 SSE 做压测?

SSE 压测建议从“连接、首包、持续推送、关闭”四段来设计,并特别关注长连接带来的系统瓶颈。

3.1 压测脚本 / 场景设计建议

🔹 并发连接数

- SSE 的核心不是 TPS,而是“同时在线多少条流”

- 建议用阶梯加压:100 → 500 → 1000 → 5000…观察拐点

🔹 连接保持时长

- 模拟真实用户停留:30s/60s/5min/更长

- 重点看:连接是否被代理/Nginx/网关提前断掉

🔹 推送频率与数据量

- 大模型场景通常是 token 级/句级流式输出

- 建议同时覆盖:短回答/长回答、不同模型参数、不同上下文长度

🔹 请求参数与鉴权

- 真实模拟:携带 cookie/token、用户标识、会话 ID

- 避免所有压测流命中同一个缓存路径导致“假快”

3.1 压测注意事项

- 超时设置:客户端读超时不能按传统 HTTP 配置,否则会误判失败;

- 连接上限:校验压测机与被测服务两侧的连接数配额与网络资源是否充足,避免因连接资源不足导致结果偏差;

- 代理/网关配置:如 Nginx 的缓冲/超时/连接保持策略可能影响流式输出;

- 服务端线程模型:阻塞式实现容易在高并发长连接下耗尽线程;

- 中途断流检测:不仅要看是否成功建立连接,还要看流是否“持续有事件”、是否出现半开连接。

Part 4:如何解读 SSE 压测指标?

SSE 场景下,“成功”不等于“好用”。建议把指标拆成 3 类:连接类、吞吐类、流式输出类。

🔹 4.1 连接类

- 连接成功率:握手成功/鉴权成功的比例

- 在线连接数:压测期间稳定维持的并发连接数量

- 断连率/重连次数:是否出现大量中断(网关超时、服务端资源不足等)

🔹 4.2 吞吐类

- 每连接推送速率:单条流每秒推送多少数据/事件

- 整体下行吞吐:全局带宽与服务端输出能力是否成为瓶颈

- 总吞吐:并发连接数×单连接推送速率

🔹 4.3 流式输出类

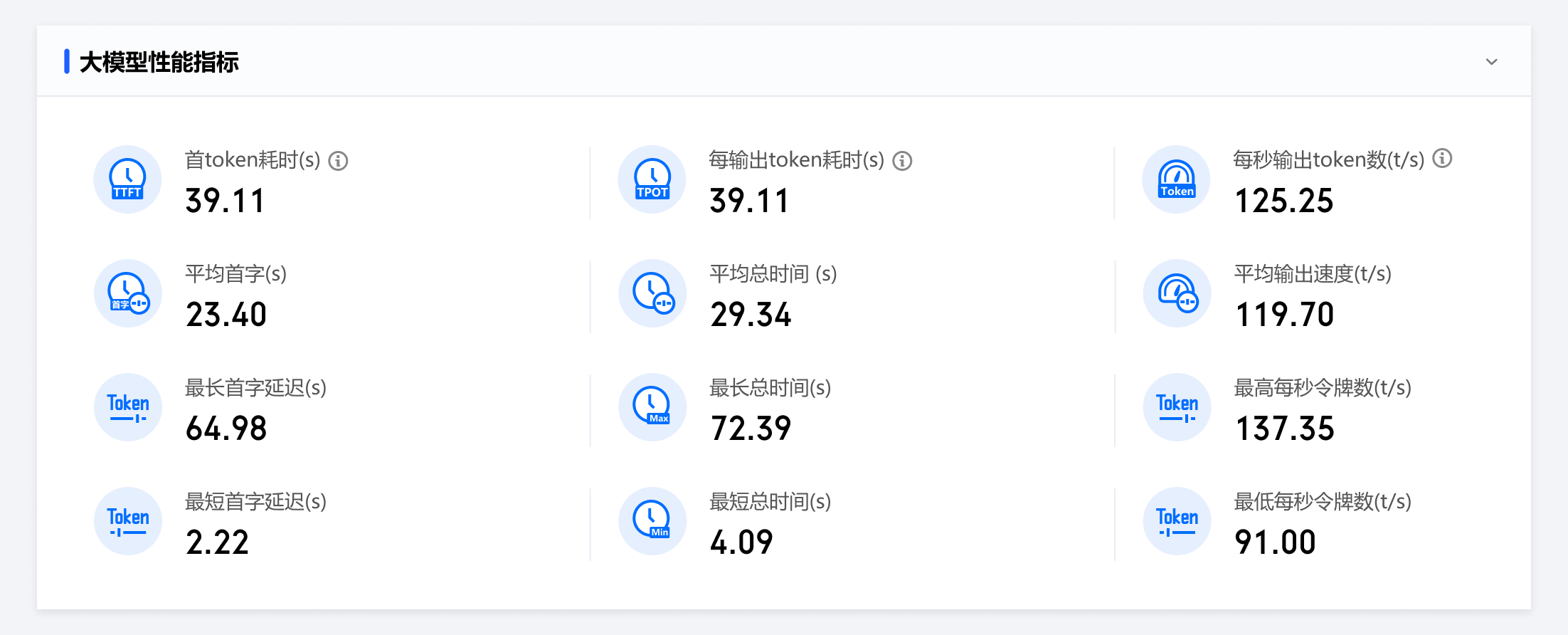

- 首 token 耗时:从请求发起到收到第一段 SSE 数据的时间,即用户“看到第一句话”的速度

- 总 token(输入/输出):衡量费用与负载(上下文越长越吃资源)

- 事件间隔分布:推送节奏是否抖动,是否出现长时间“卡住不推”

- 生成时长/完整响应时长:从开始生成到结束的总耗时

这些指标组合起来,才能回答四个关键问题:是否够快(首 token 耗时)→ 是否够稳(断连/错误)→ 是否扛得住(并发连接)→ 是否划算(token 吞吐与成本)。

Part 5:为什么选择优测压测工具?

💡 优测全链路压力测试工具已上线新能力:原生支持 SSE 场景压测,通过可视化报告完整呈现大模型流式输出关键指标,一站式验证业务场景稳定性、响应速度与资源成本。

通用工具由于无法解析流式帧边界,难以植入推理链路埋点,会导致首 token 耗时与吞吐率数据失真,影响容量评估的准确性。相比于其它工具,优测全链路压测平台在 SSE 场景的优势在于:

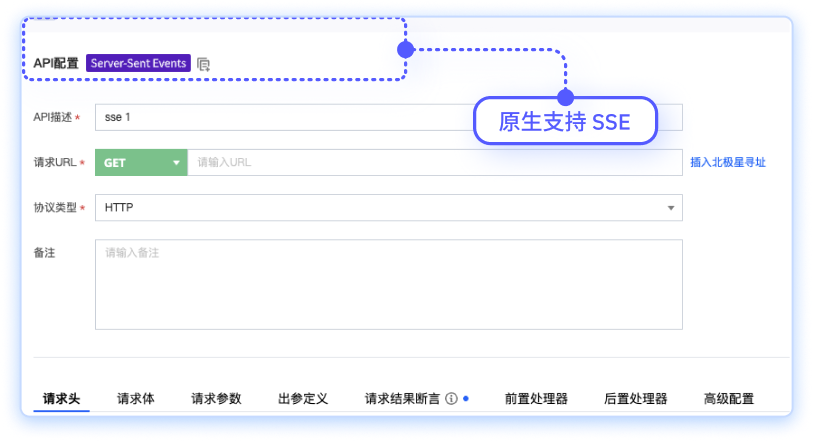

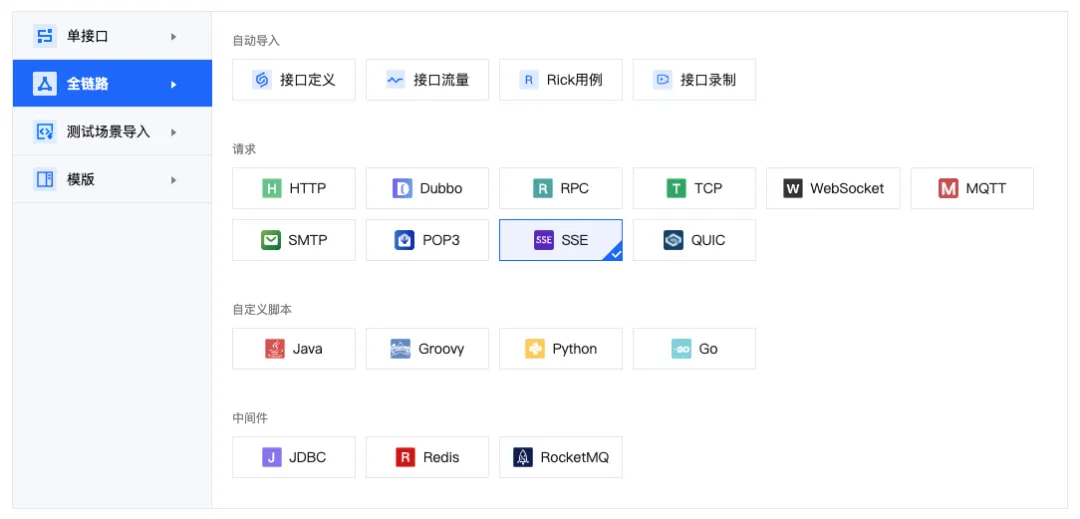

✅ 原生支持 SSE 压测:在测试场景中可直接选择 SSE 类型步骤,贴近真实流式交互;

✅ 压测报告展示大模型相关指标:把首 token 耗时、token 吞吐、生成耗时等关键数据纳入统计视图,定位体验瓶颈更直接;

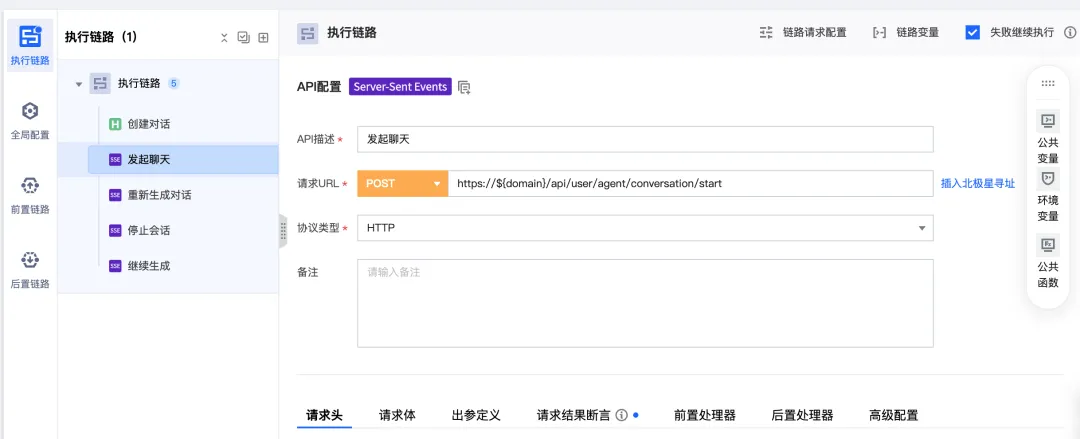

✅ 更贴近业务的场景编排:可按真实用户路径组织压测(建连→对话→持续接收→结束),而不是只压一个接口;

✅ 支持多协议与自定义脚本:覆盖 HTTP / RPC / MQTT 等多种协议能力,并支持通过自定义脚本灵活描述复杂业务逻辑与参数关联。

本文未注明其它来源的内容,其版权归优测云服务平台所有,未经允许不得转载本文内容。如需转载本文,请在显著位置注明出处(优测云服务平台,以及文章链接:https://utest.21kunpeng.com/home/topic/sse260331)

浙公网安备 33010602011771号

浙公网安备 33010602011771号